10 天前

10 天前

你有没有想过,当你给大语言模型输入一句“你好”,它内部的某个角落正发生着一场看不见的“爆炸”?第一个“你”字的激活值会突然飙升到普通词元的数千倍,就像电路里窜出的尖峰;同时,模型里的几十个注意力头会像被磁铁吸住一样,把大部分权重砸向这个字——哪怕它和后续的语义毫无关系。

这些诡异的“尖峰”和“黑洞”现象,曾被当成大模型的“天性”,直到Meta的LeCun团队用一篇论文捅破了窗户纸:它们根本不是智能的必需,而是我们为了训练稳定,给模型加的一个小设计埋下的隐患。

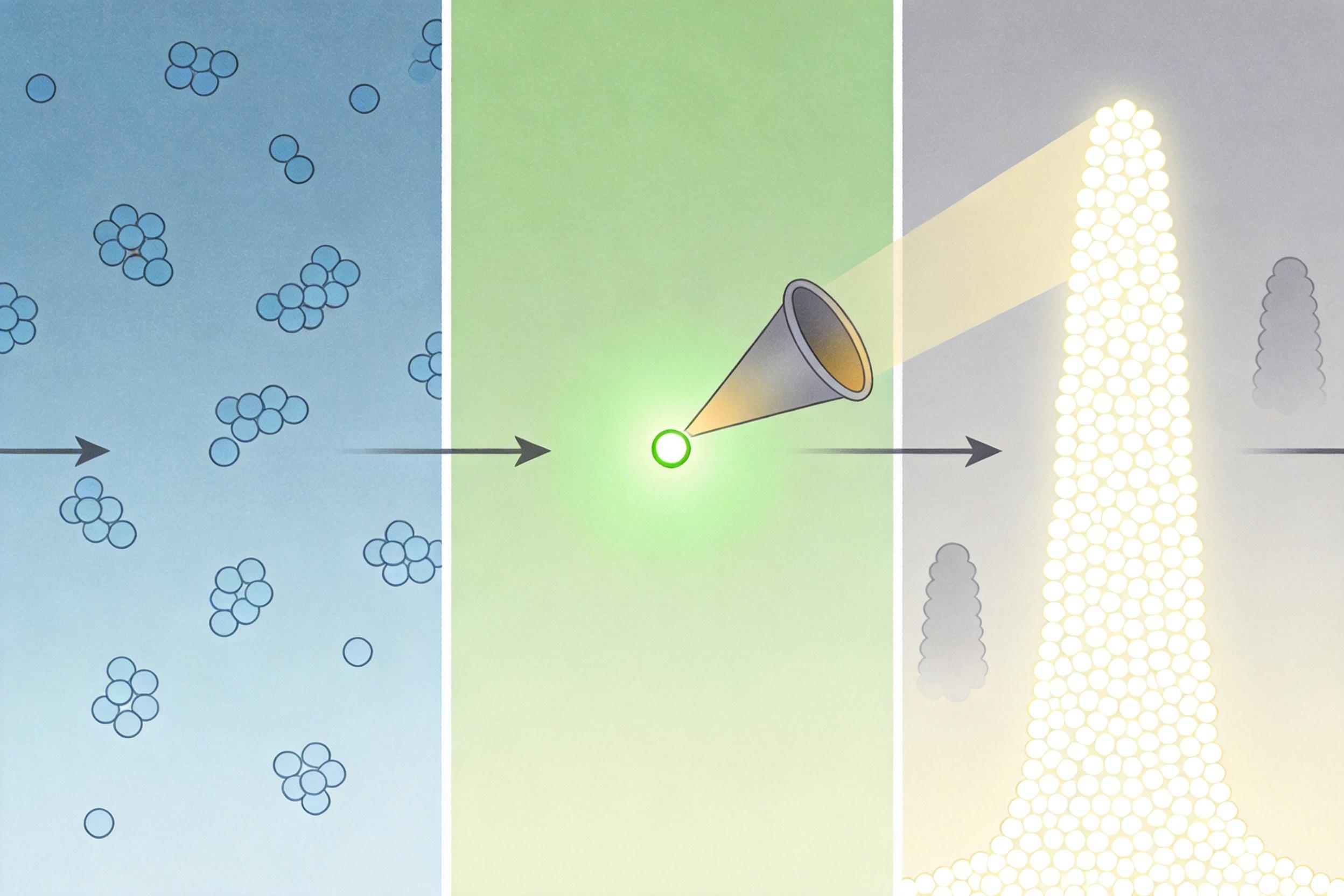

我们先拆解“尖峰”的一生。它不是凭空出现的:模型前几层的前馈网络会像定向放大器一样,对特定词元的输入进行疯狂放大——这个放大器有个固定的“瞄准方向”,而序列第一个词元、句号这类分隔符,恰好天生对准了这个方向。

被放大的激活值会通过残差连接像滚雪球一样在模型里传递,形成一个稳定的“高能量平台”,直到最后几层才被反向的激活信号抵消。整个过程像一场精准的外科手术:早期“抬升”,中期“维持”,晚期“中和”。

而“黑洞”的诞生,全靠前归一化这个关键桥梁。前归一化会把尖峰激活压缩成一个稀疏、恒定的向量——不管是“你”还是句号,归一化后它们的向量几乎一模一样。当这个恒定向量进入注意力机制,部分注意力头的查询向量会天然和它对齐,就像钥匙插进了锁孔:不管当前要处理什么语义,这些头都会把注意力疯狂砸向这个“万能锁孔”。

最颠覆的发现来自论文的消融实验:研究人员把前归一化换成后归一化,结果尖峰现象几乎消失了,但黑洞居然还在——这证明两者完全可以分离。

更关键的是,不管是去掉尖峰,还是用长序列训练消除黑洞,模型的语言建模能力几乎没受影响。也就是说,这些我们习以为常的“智能特征”,其实是模型为了适应架构设计,自己演化出的“权宜之计”:黑洞就像一个临时的“注意力垃圾场”,模型把不知道该放哪的权重全扔进去,好让其他头专注于真正的语义。

但这个权宜之计代价不菲:尖峰激活是低精度量化的噩梦——仅仅2个尖峰词元,就会占据95%的量化误差;黑洞则会浪费宝贵的注意力预算,让模型在处理长文本时力不从心。

这篇论文最有价值的地方,是把大模型从“黑盒玄学”拉回了“工程设计”的轨道。我们一直以为前归一化是训练稳定的最优解,但它带来的副作用,其实正在限制模型的上限。

现在,研究者们有了新的选项:比如重新审视后归一化,或者用混合归一化平衡稳定性和性能;比如给模型设计专门的“注意力弃置槽”,代替自然词元当黑洞;再比如用动态门控机制,从根源上避免尖峰激活的产生。

但这些方案都还面临挑战:后归一化在大规模预训练中的稳定性还需要验证,混合归一化的理论框架尚未完善,动态门控则会带来新的可解释性难题。我们离真正“可控”的大模型,还有一段路要走。

当我们把大模型当成“智能”来崇拜时,这篇论文提醒我们:它更像一个在特定规则下演化出的复杂系统——很多看似神奇的行为,不过是为了适应规则而长出的“冗余器官”。

理解这些冗余,我们才能真正掌控智能。未来的大模型,不该是一个充满意外的黑盒,而该是一套可以精准调试的精密系统。

从理解副作用开始,迈向可控的智能。

点击充电,成为大圆镜下一个视频选题!