对抗知识焦虑,从看懂这条开始

App 下载

AI语音不用选音色,你说啥它就能变啥

多语言支持|音色创造|声音克隆|开源语音模型|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

多语言支持|音色创造|声音克隆|开源语音模型|大语言模型|人工智能

想象一下:你不用在几十个预设音色里反复切换,敲一行“20岁四川姑娘,笑起来带点虎牙气”,就能得到一个从没存在过的专属声音;录5秒日常闲聊,AI不仅能克隆你的声线,还能让它用哭腔念完一整段台词——而且是CD级别的48kHz音质,连呼吸的气音都清晰可辨。这不是科幻片里的设定,是一款开源语音模型刚实现的功能。它把30种语言、9种方言、音色创造、声音克隆塞进同一个模型里,甚至还解决了困扰行业多年的“机器感”难题。

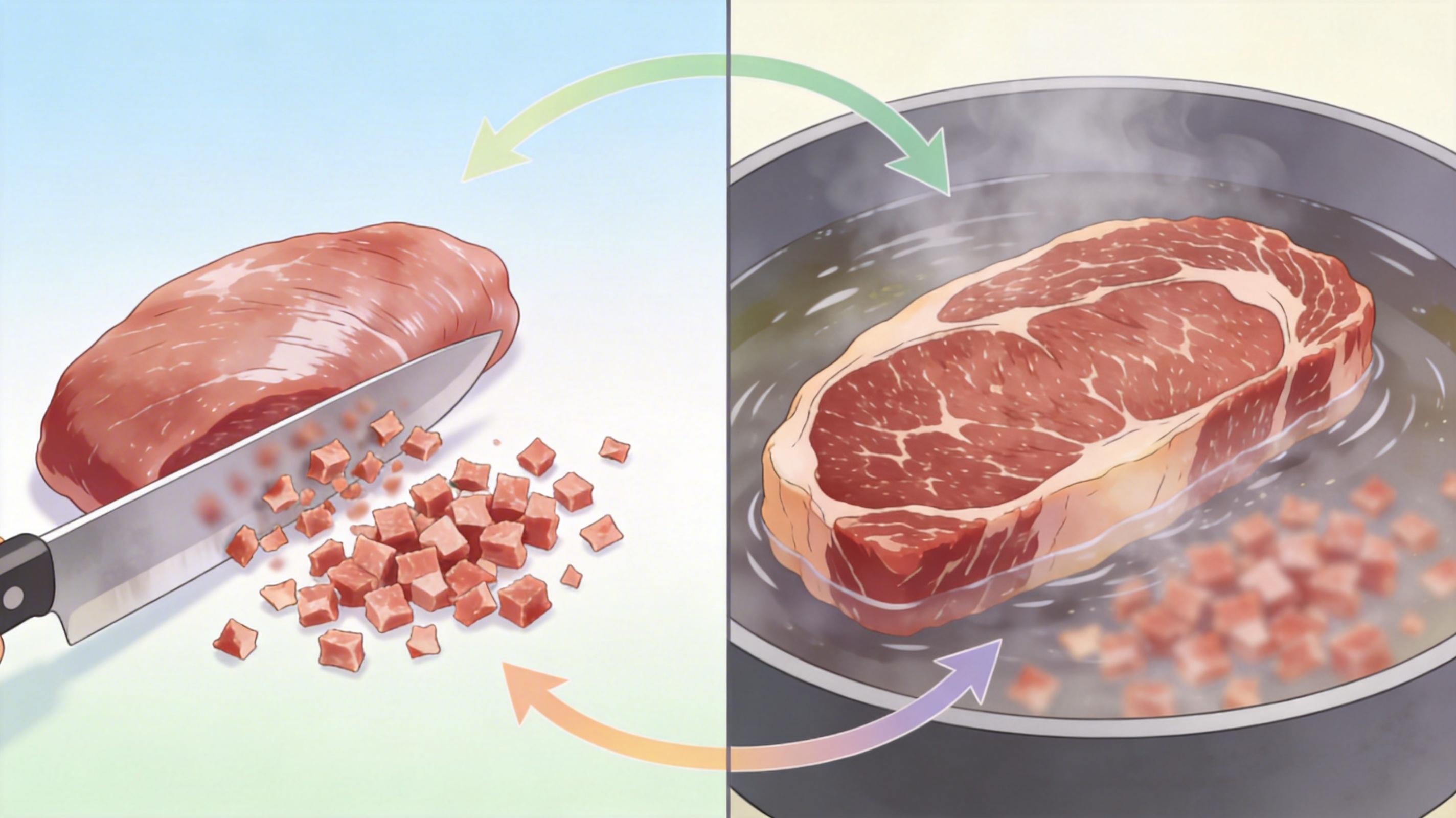

你可以把传统语音合成模型理解成一家只能卖预制菜的餐厅:菜单上的菜是固定的,最多给你加辣或少盐,没法凭空做一道新菜。而这款模型是把整个厨房开放给你——它跳过了“预制音色”的环节,直接在连续的声音“食材”里调配。

核心秘密在于它的无分词扩散自回归架构:传统模型会把声音切成一个个离散的“语音token”,像把红烧肉剁成肉糜再重组,难免损失纹理;而它直接在连续的声音潜空间里生成,就像从生肉开始炖煮,能保留更多细节。

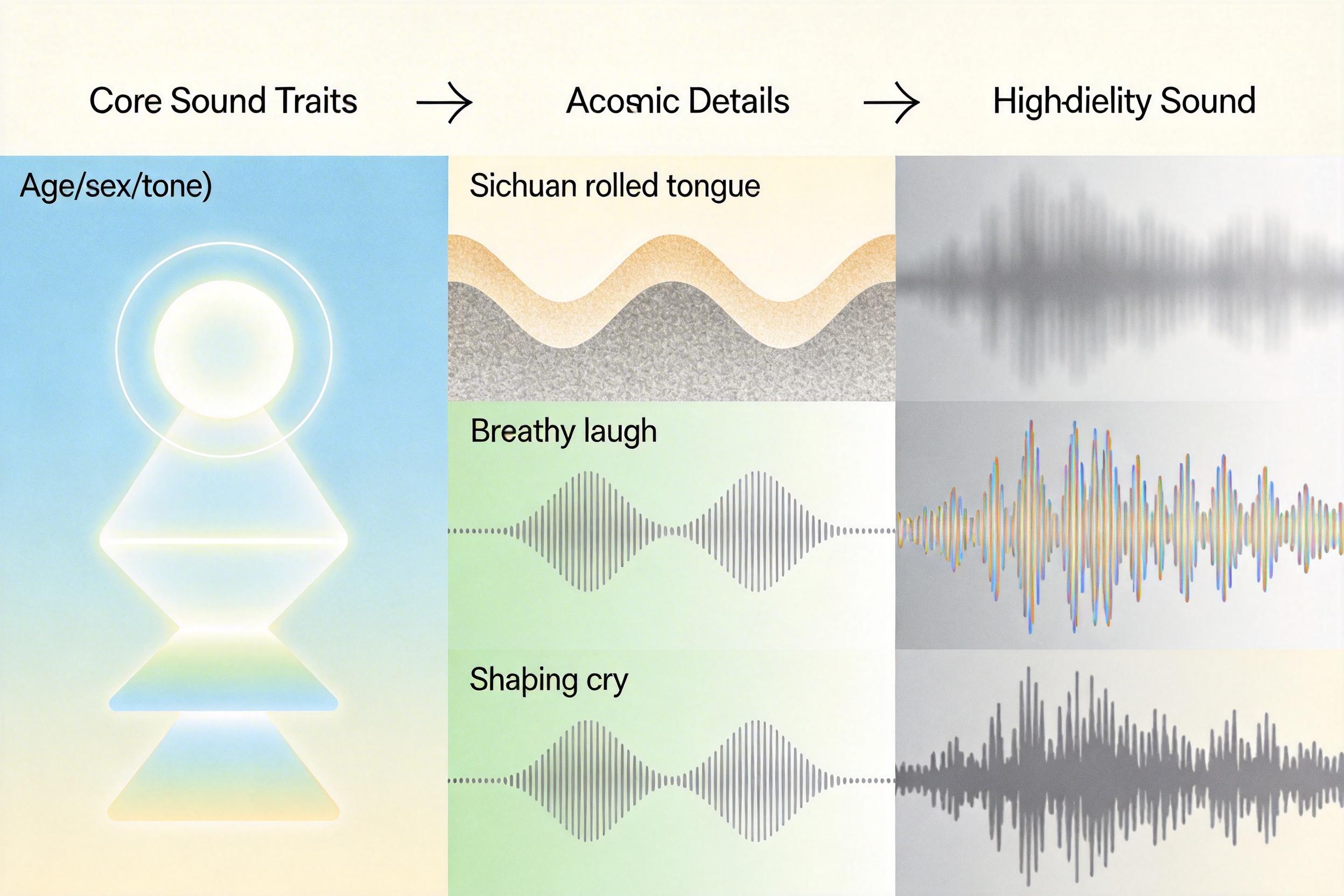

具体来说,它先让文本语义模型生成“声音骨架”——比如年龄、性别、语气的核心特征,再用残差声学模型补上“肉”:四川话的卷舌音、笑起来的气声、哭腔的颤音。最后用扩散解码器逐步“去噪”,把模糊的声音草稿打磨成高保真成品。

更关键的是,它用有限标量量化技术把语义和声学信息做了软分离:就像厨师先定好菜谱(语义),再根据菜谱选食材调火候(声学),既不会跑题,又能灵活调整细节。

过去要做一套完整的语音系统,你可能需要同时部署文本转语音、声音克隆、多语言合成三个模型,就像同时开三家不同的餐厅。而这个模型把所有功能捏进了同一个框架里,相当于一家既能做川菜又能做西餐,还能给你定制新菜的全能厨房。

它的30种语言和9种方言支持,靠的是200万小时多语言语音数据的训练——不是简单的翻译,而是让模型理解每种语言的“发音逻辑”:日语的尾音上扬、广东话的九声六调、四川话的儿化音。甚至不用你指定语言,输入一段泰语文本,它自动就用泰语发音合成。

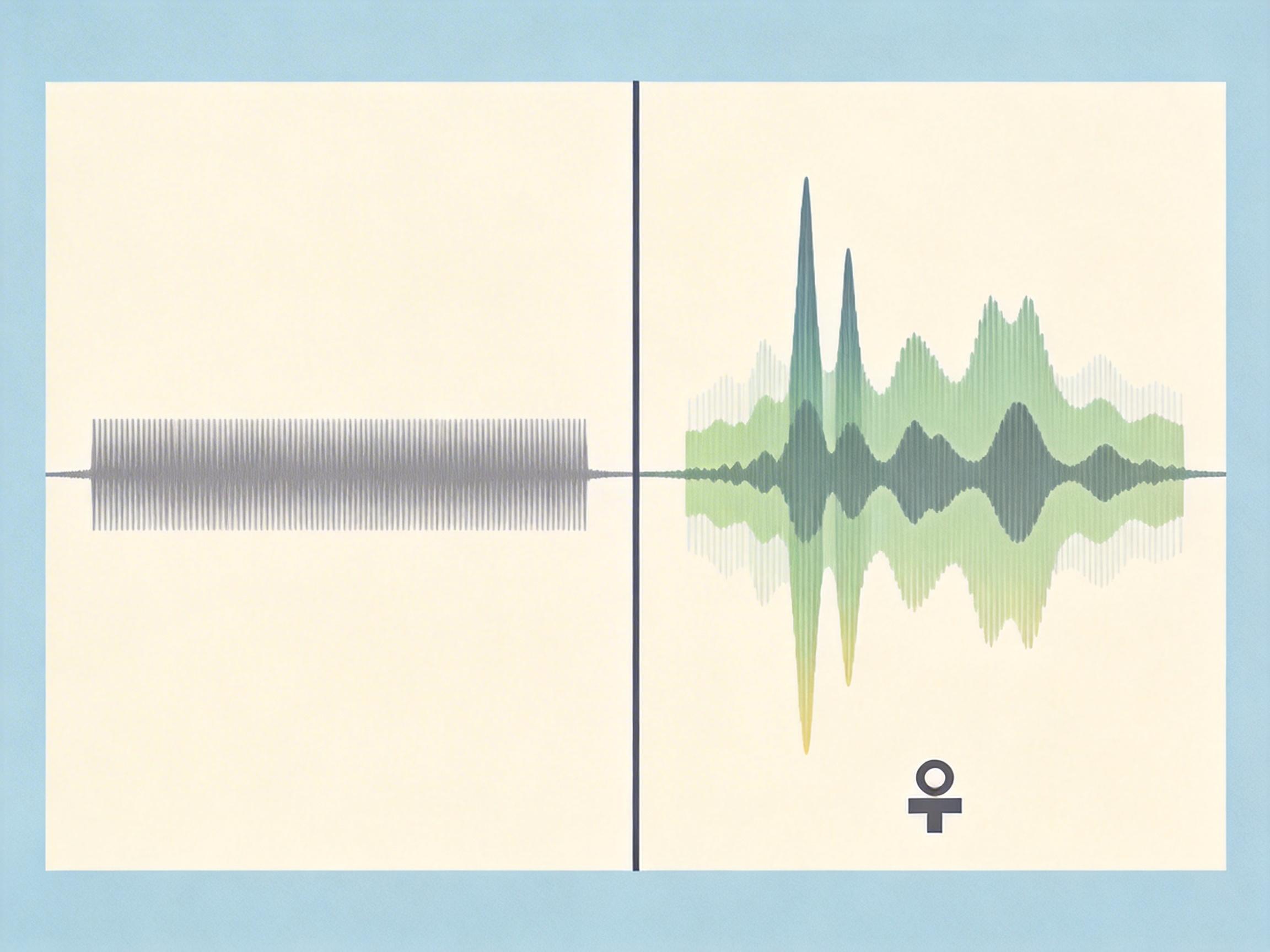

声音克隆的精度也远超同类:传统克隆只能复制“音色”,就像模仿别人的长相却学不会表情;它能连带着把说话的节奏、呼吸的停顿、甚至不经意的口头禅都复刻出来。你录一段“今天吃火锅”的日常语音,它能用你的声线,用严肃的语气念完一份工作报告——但有个小限制:暂时还没法跨性别转换,男声克隆不出女声。

在RTX 4090显卡上,它生成10秒语音只需要1.3秒,比实时速度还快7倍,意味着你可以用它做实时语音直播、游戏实时配音这类对延迟要求极高的场景。

当然,它也不是完美的“万能声音机器”。比如你想用它生成方言语音,必须输入方言本身的文本——不能拿普通话“今天天气好”让它读成四川话,得写“今天天气巴适”,否则就会出现“普通话配方言腔”的违和感。

更值得警惕的是它的滥用风险:5秒就能克隆一个人的声音,意味着诈骗分子可能用它模仿亲友的声音打电话借钱,而普通人很难分辨出真假——有测试显示,听众对AI克隆声音的误判率高达75%。目前它的开发者只在文档里标注了“禁止滥用”,还没有加入强制的水印或识别技术。

对开发者来说,它的20亿参数虽然比同类闭源模型小,但要在普通电脑上运行依然需要高端显卡,离真正的“平民化”还有一段距离。不过它的开源属性让社区有机会做轻量化优化,说不定很快就能在手机上运行。

当AI能凭空创造出任何你想要的声音,我们和机器的对话方式正在悄悄改变——不再是我们去适应机器的“预制音色”,而是机器来匹配我们的想象。

过去十年,语音合成的目标是“像人说话”;现在,它的目标变成了“说你想听到的话”。从0.5亿参数到20亿参数,从16kHz到48kHz,这个模型的每一次迭代,都在把“声音的控制权”从工程师手里交还给用户。

声音不再是机器的附属品,而是可以被设计、被定制、被创造的素材。这可能才是它真正的意义:让每一个人,都能拥有属于自己的“AI声音”。

声音的未来,是没有标准答案的。