内容由AI生成,思考得你完成

App 下载

内容由AI生成,思考得你完成

App 下载

你有没有遇到过这种事:让AI描述一张「猫坐在沙发上看窗外」的图,它开头说对了,接着突然写「因为猫在等刚下班的主人回家」——可图里根本没提主人。这不是AI「看错了」,而是它在某个节点顺着语言惯性「想偏了」。来自多国高校的研究团队发现,这种幻觉的根源,藏在AI推理时的那些「关键犹豫时刻」里。为什么AI会在这些时刻跑偏?又有什么办法能把它拉回正轨?

你可以把AI的多模态推理想象成走迷宫:一开始跟着图像线索走得好好的,可走到「因为」「但是」「不过」这些岔路口时,它突然开始凭记忆里的语言经验选路,忘了看脚下的图像地图。

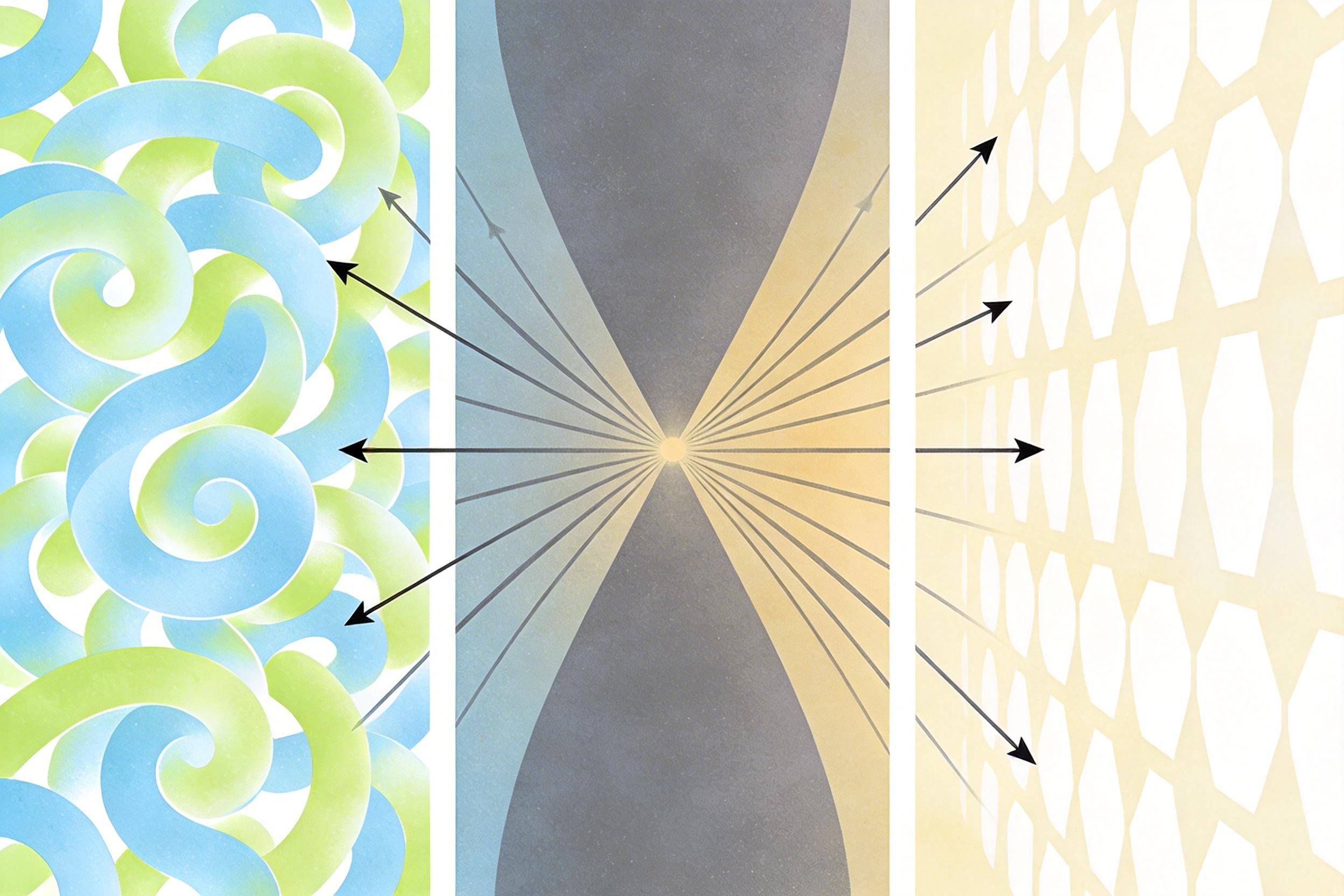

研究团队通过大量实验发现,当AI生成这类带有因果、转折意味的过渡词时,对应的token熵值会飙升——这就像人站在岔路口犹豫,脑子里同时冒出好几种可能性。如果这时强迫AI立刻选一条路走,它大概率会顺着最熟悉的语言惯性跑偏,后面的推理链就全歪了。

更关键的是,这些高熵过渡词往往是推理链的「分叉点」,尤其是出现在推理前半段的过渡词,几乎能决定整条推理的走向。一旦在这儿走歪,后面再怎么推理也拉不回来。

针对这个问题,研究者提出了LEAD(潜在熵感知解码)方案,核心思路就是:在AI犹豫的时刻,别逼它立刻做决定。

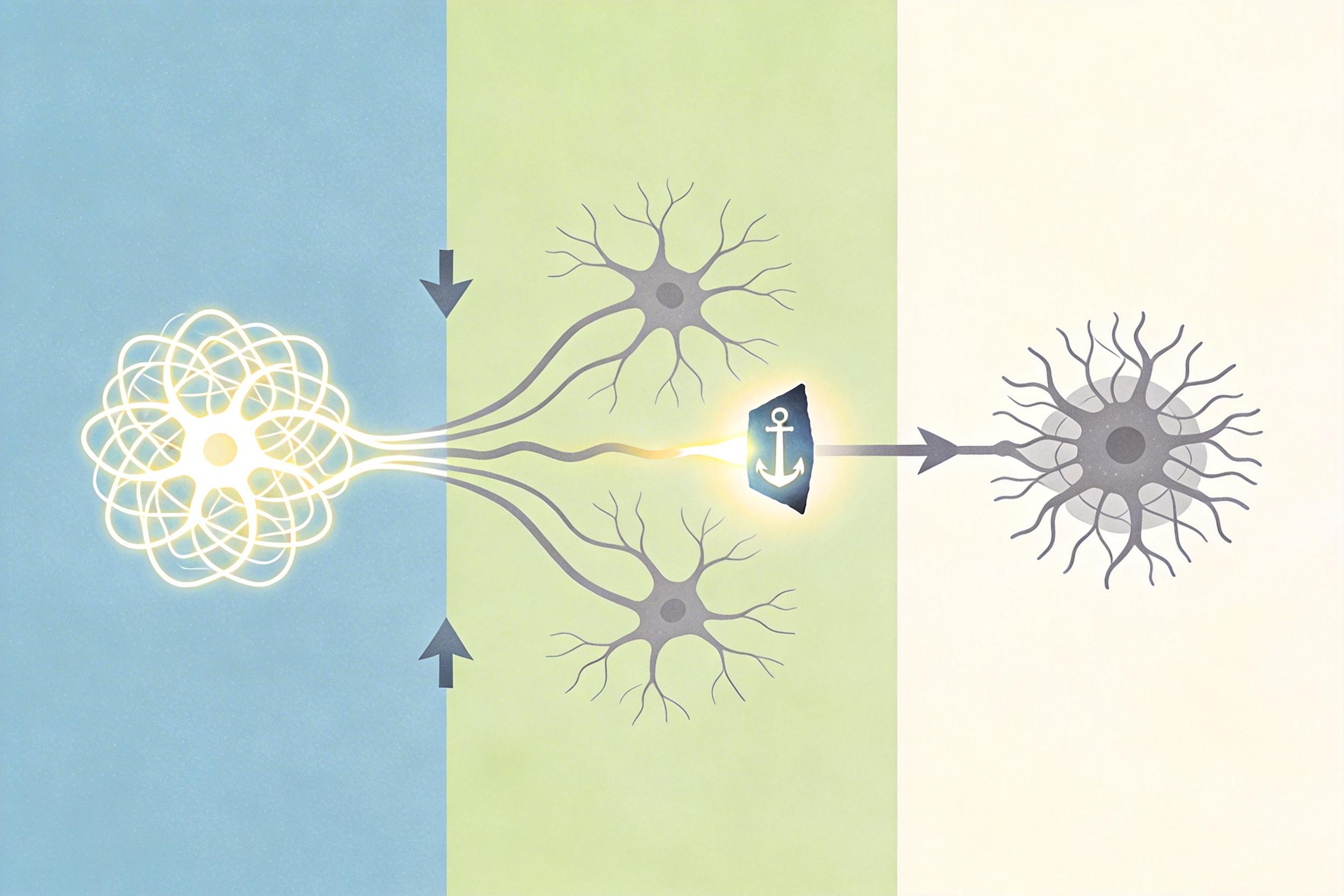

当检测到AI进入高熵的犹豫状态时,LEAD不会让它直接生成一个确定的词,而是在潜在语义空间里保留多种可能的推理方向——就像让AI在岔路口先观察所有路径,而不是急着选一条。同时,LEAD会在这个阶段注入「视觉锚点」,把AI的注意力强行拉回图像证据上,避免它顺着语言惯性越跑越远。

等AI的熵值降下来,确定了最合理的推理路径后,再切换回常规的离散token生成。这种「先探索再收敛」的模式,既保留了推理的灵活性,又用视觉锚点死死拽住了事实。

实验数据显示,LEAD能让多模态模型在多个任务上的准确率提升3%-5%,同时幻觉率显著下降。更有意思的是,它还能让AI的推理步骤更短——不是靠「想更多」取胜,而是靠在关键节点少走弯路。

不过LEAD也不是万能的。研究者通过消融实验发现,视觉锚点的强度必须适中:太强会让AI过度依赖图像,失去推理的灵活性;太弱则拉不住跑偏的AI。动态熵阈值也比固定阈值效果好,因为不同任务里AI的「犹豫程度」不一样。

更值得关注的是,LEAD的本质不是消除AI的不确定性,而是学会和不确定性共处。过去我们总觉得AI推理要「越确定越好」,但这次研究证明,在关键节点保留一定的不确定性,反而能避免更大的错误。这有点像人类做决策:遇到拿不准的事,先别急着拍板,多看看证据,反而能做出更靠谱的选择。

当我们在追求AI「更会思考」时,往往容易陷入「思考得越长越好」的误区。但这次的研究提醒我们,AI推理的可靠性,从来不是靠长度堆出来的,而是靠在关键节点的「精准刹车」。

「犹豫不是缺陷,是修正错误的窗口」——这句话不仅适用于AI,也适用于人类自己。未来的多模态AI,或许不需要变得更「聪明」,但需要学会在该慢下来的时候,别着急往前走。毕竟,靠谱的思考,从来都不是比谁走得快,而是比谁走得稳。