4 天前

4 天前

你可以在iPhone上用AI本地处理病历图片,不用上传云端;可以在断网的山里用手机语音转写会议记录,速度快到像实时对话;甚至能让AI直接控制手机手电筒,全程不碰云服务器。这不是科幻片里的场景——2026年4月,一款能在手机端本地运行的多模态AI模型火了,有人用它在iPhone上跑出了每秒40个词的推理速度,比很多云端服务还快。更重要的是,这一切都不用花钱买token,数据全程留在自己设备里。为什么一款小模型能掀起这么大的波澜?端侧AI的爆发,到底会给整个AI行业带来什么?

要把几十亿参数的AI模型塞进手机,核心是解决两个问题:怎么让模型变小,怎么让它跑得够快。这就像把一台台式电脑压缩成笔记本——不能只砍零件,得重新设计架构。

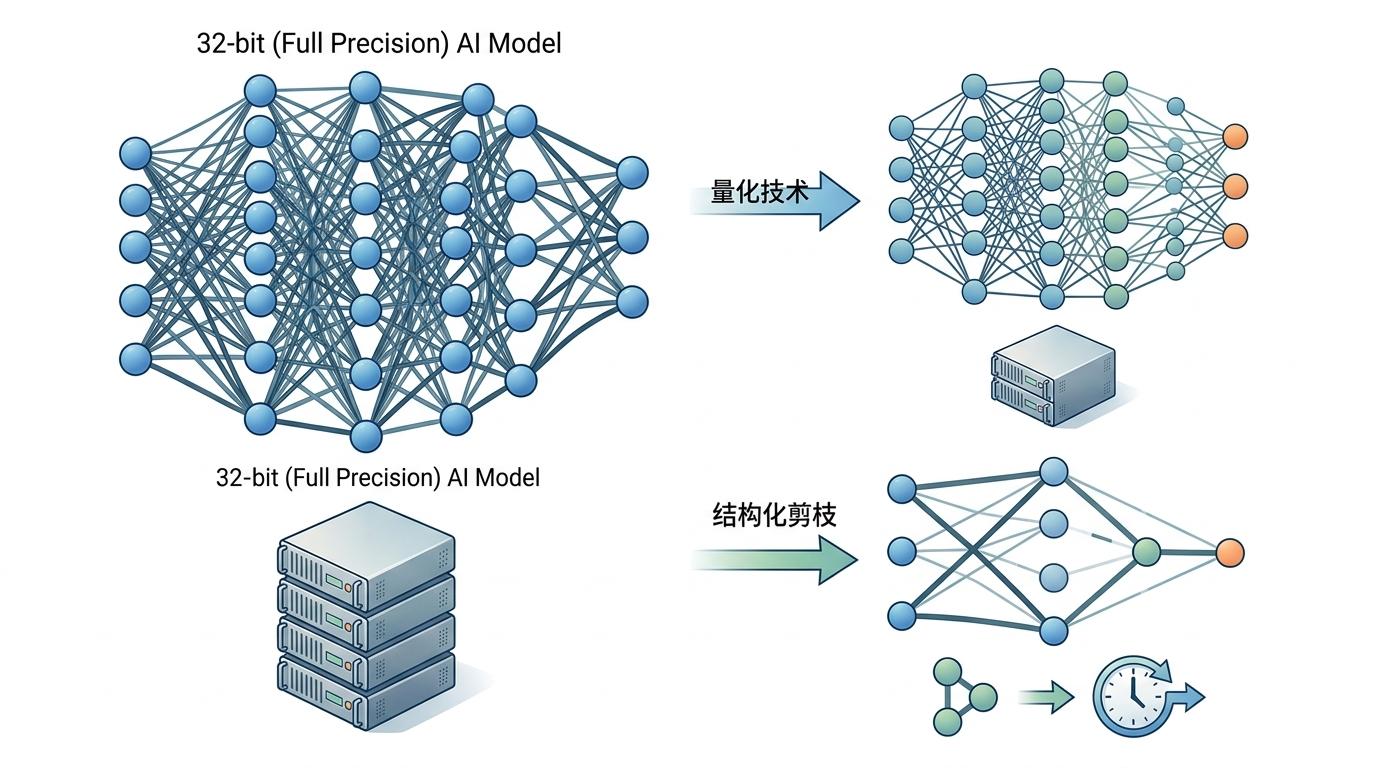

你可以把AI模型想象成一本厚词典,之前要查词得把整本书扛在肩上(占满设备内存),现在工程师用「量化技术」把词典里的字从32位的宋体换成8位的黑体,体积直接缩小到原来的1/4,而且大部分人根本看不出区别。还有「结构化剪枝」,就像把词典里重复的附录、没用的索引删掉,只留下核心词条,模型大小能再砍一半,推理速度却能提升数倍。

但真实的技术比这更精确:比如谷歌的这款小模型用了「每层嵌入」技术,把部分权重存在手机的闪存里,不用全塞进内存;配合苹果MLX框架对芯片的底层优化,让模型在手机上的推理速度突破了每秒40个词——这是个关键阈值,当AI的响应速度和人类对话差不多时,用户就不会觉得「卡」,本地运行的体验才真正能用。

还有128K的上下文窗口,相当于能让AI一次性记住13万个词的内容,差不多是一整本长篇小说。这意味着你可以把一整套病历、一份完整的合同丢给AI,它不用反复联网查资料,就能直接在本地给出分析。

过去AI行业的主流模式是「云端训练+云端推理」,用户每调用一次AI,就要买一次token,就像打电话按分钟收费。但端侧AI的崛起,直接把60%以上的高频简单任务从云端拉回了本地——比如语音转写、图片分类、日常聊天,这些任务不需要最顶尖的模型精度,却占了用户调用量的大头。

有企业做过测算:用Mac Studio M4 Max本地运行AI模型,36个月摊销下来每月约139美元,能支持数万次每日请求,而如果用云端API,同样的调用量每月要花数千美元。更重要的是,医疗、金融这些敏感行业,数据根本不能出本地——你总不能把病人的病历、客户的银行卡号传到云端去处理,端侧AI天生就解决了合规的核心痛点。

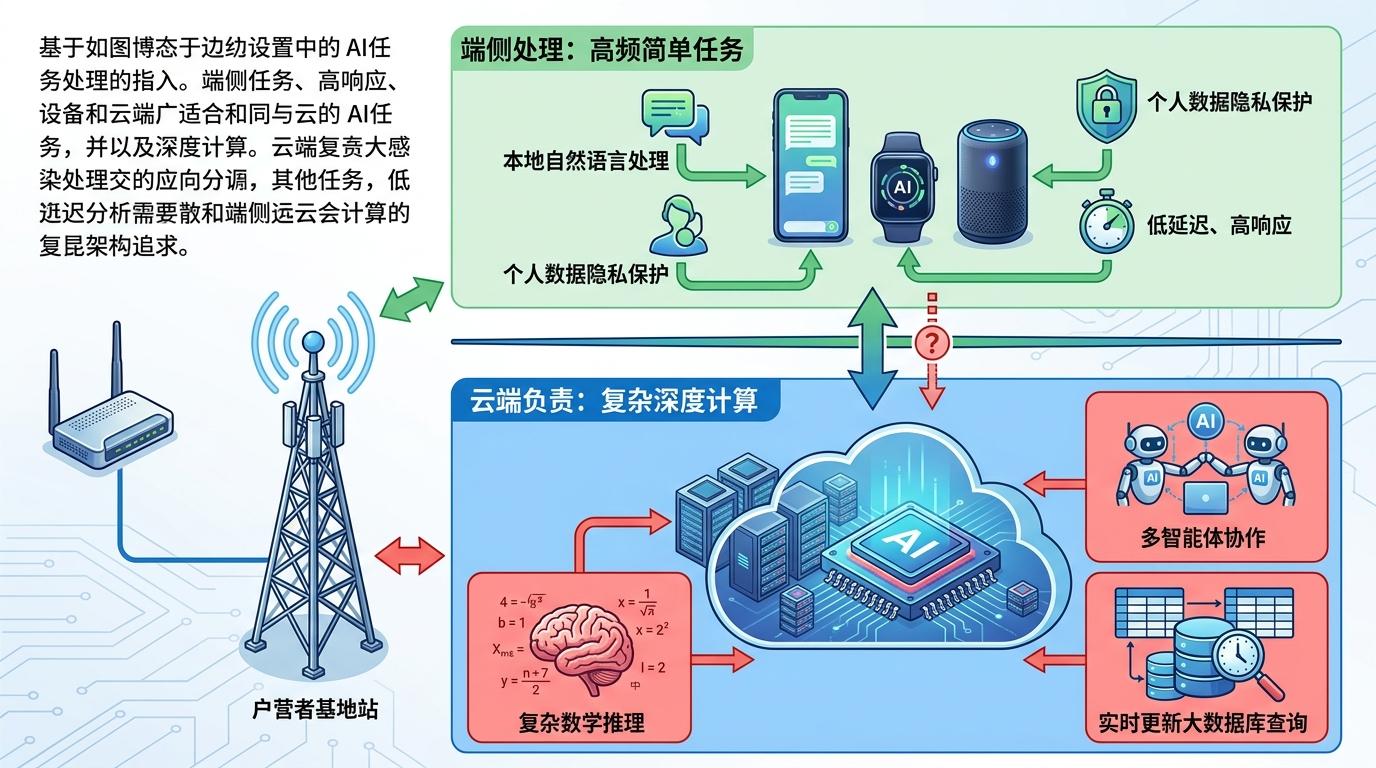

当然,端侧AI还不能完全取代云端。比如复杂的数学推理、多智能体协作、需要实时更新的大数据库查询,还是得靠云端的大模型。但趋势已经很明显:未来的AI会是「混合架构」——端侧处理高频简单任务,云端负责复杂深度计算,就像家里的路由器和运营商的基站分工合作。

这直接冲击了靠卖token吃饭的云端服务商。过去他们只要把模型做大,就能躺着收流量费;现在必须转型——要么做高端复杂推理的「付费会员服务」,要么卖端侧AI的硬件、软件和运维服务,甚至帮企业做混合架构的定制方案。

端侧AI的爆发不代表它没有短板。比如现在的端侧小模型,在处理复杂工具调用时还容易出错——有开发者测试发现,用它当代码助手时,经常会卡住、输出错误的命令,换成专门优化的模型才能正常工作。这就像一个刚学会做饭的新手,煎个蛋没问题,但让他做满汉全席就露馅了。

还有运维的问题:云端模型只要更新一次,所有用户都能用到最新版本,但端侧AI要给上千万台手机更新模型,既要考虑带宽,还要考虑不同设备的兼容性,搞不好就会出现「有的手机能更,有的更不了」的情况。而且端侧设备容易被物理攻击,比如有人篡改手机里的AI模型,让它输出错误的医疗建议,这也是必须解决的安全隐患。

更现实的是,很多中小企业还没有能力部署端侧AI——他们既没有钱买高性能硬件,也没有工程师做模型优化,最后可能还是得依赖云端服务。端侧AI的普及,可能会让AI行业的「数字鸿沟」变得更大:大公司能用本地AI降低成本、提升效率,小公司却只能继续买token。

端侧AI的本质,是把AI的「使用权」从云端还给了用户。过去我们用AI,就像去餐馆吃饭,厨师在厨房做菜,我们只能等上菜;现在我们可以把厨师请到家里,想吃什么直接做,而且食材全程在自己手里。

未来的AI市场,不会是云端一家独大,也不会是端侧完全取代云端,而是形成一种「分层协作」的生态:端侧负责「最后一公里」的实时响应,云端负责「后台」的深度计算,就像手机的本地存储和云端备份一样,各有分工,却又无缝衔接。

AI的未来,是从「云端中心化」到「分布式智能」。 当越来越多的设备能自己运行AI,我们的生活会变得更高效、更安全——而整个AI行业的游戏规则,也会在这场从云端到口袋的迁徙中,彻底被改写。

点击充电,成为大圆镜下一个视频选题!