内容由AI生成,思考得你完成

App 下载

内容由AI生成,思考得你完成

App 下载

你有没有过这种体验:手机相册里的老照片点「超清放大」,结果人脸糊成马赛克,文字扭成麻花?这不是手机偷工减料——图像超分辨率技术,一直卡在一个死循环里:想让模型「看懂」全图的上下文,就得堆计算量;想让手机跑得动,就得砍模型能力,最后细节全丢。

2026年3月,上海交大联合多国团队推出的UCAN模型,把这个死循环砸出了一个口子。它只用不到70万参数——大概是普通Transformer模型的1/20——就在漫画、城市建筑等复杂数据集上,把超分精度推到了轻量级模型的天花板。

关键是,它没搞什么黑科技,只是把「注意力」和「共享」这两件事玩到了极致。

要理解UCAN的核心,得先搞懂「线性注意力」的尴尬。Transformer的标准注意力能捕捉全图关联,但计算量和图像像素数的平方成正比——一张1080P的图,计算量会爆炸到手机根本扛不住。为了轻量化,研究者发明了线性注意力,把计算复杂度降到和像素数成正比,但代价是「偏科」:它只能提取到单调、相似的特征,就像一个画家被限制只能用3种颜色,画出来的细节全是糊的。

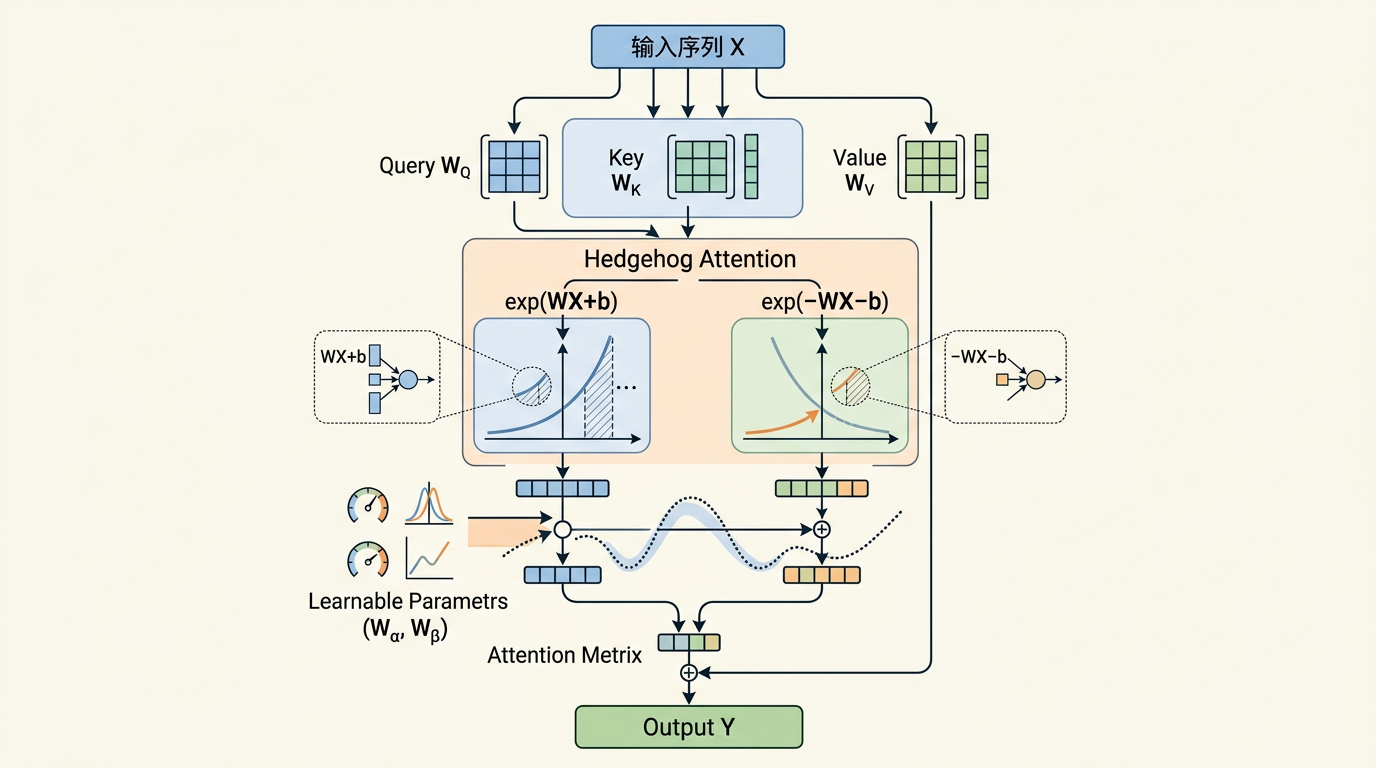

UCAN的解决办法,是给线性注意力装上「刺猬刺」——一种叫Hedgehog Attention的特征映射函数。它不再用ReLU这种「一刀切」的激活函数,而是同时计算exp(WX+b)和exp(-WX-b)两组对称特征,再用可学习的参数让模型自己调整特征的多样性。

你可以把它想象成给每个像素装了正负两个传感器:既记录「亮部的纹理」,也捕捉「暗部的轮廓」,还能根据图像内容调整传感器的灵敏度。实验数据显示,用了刺猬注意力后,特征矩阵的秩从ReLU的个位数飙升到46——相当于画家突然解锁了64种颜色里的46种,细节的层次感一下就出来了。

更关键的是,它还保持了线性注意力的低计算量。在Manga109数据集的4倍超分测试里,UCAN只用68.9万参数,就把PSNR(图像质量指标,越高越好)做到了34.83dB,比参数更多的MambaIRV2还高0.12dB。

如果说刺猬注意力解决了「看得准」的问题,那半共享参数机制就是解决「跑得快」的核心。

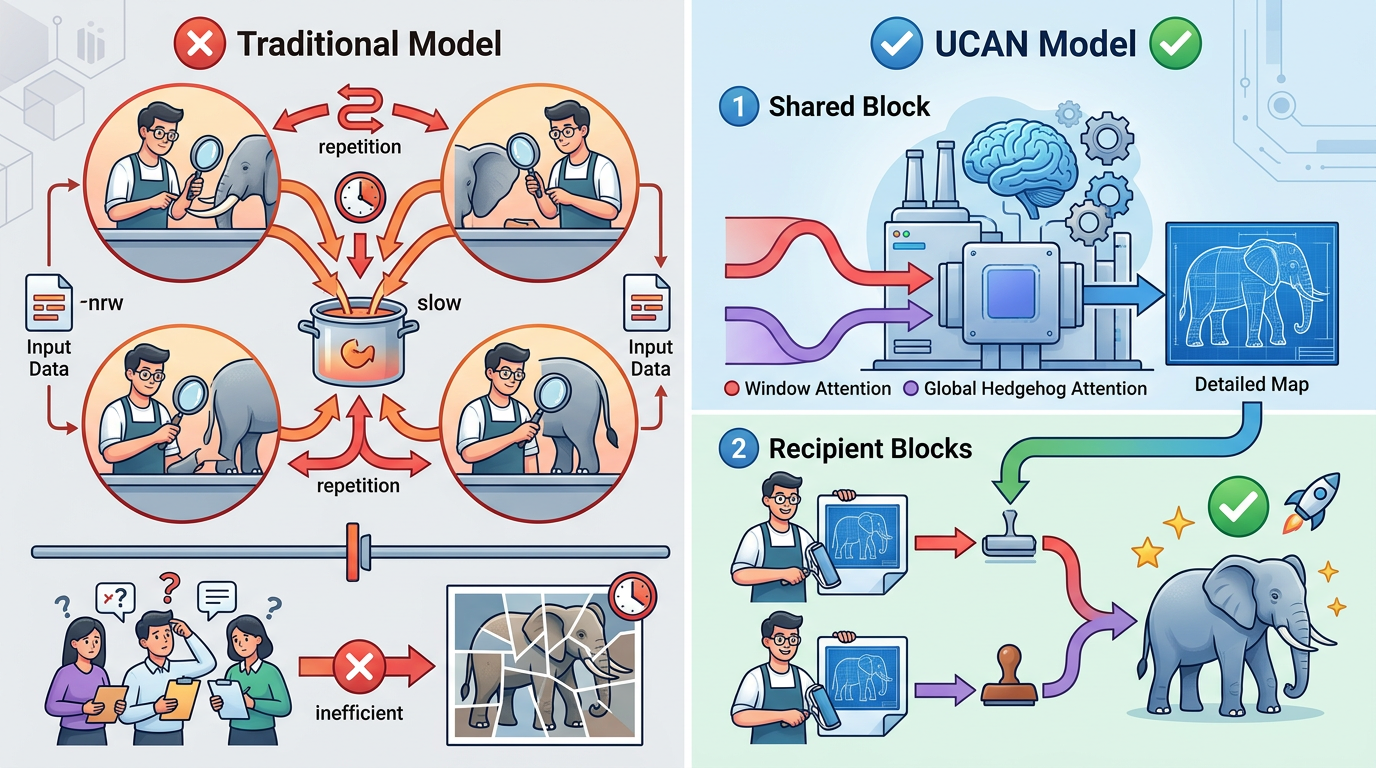

传统模型的每个模块都是独立计算的,就像一群人各自摸象,摸完了再凑一起说感受——重复劳动太多,效率极低。UCAN把模型分成了「共享块」和「接收块」两组孪生模块:共享块先花力气算出窗口注意力图和全局刺猬注意力图,相当于先摸完象画了一张详细的地图;接收块直接拿着这张地图去分析自己负责的特征,不用再重新摸一遍。

这不是简单的参数复用——共享块的注意力图是根据当前输入动态生成的,不是固定的模板。就像哥哥先探路画了地图,弟弟拿着地图走,既不会迷路,也不用再花时间重新探路。论文里的消融实验显示,这种半共享机制能砍掉30%的计算量,而性能下降不到0.1dB——几乎可以忽略不计。

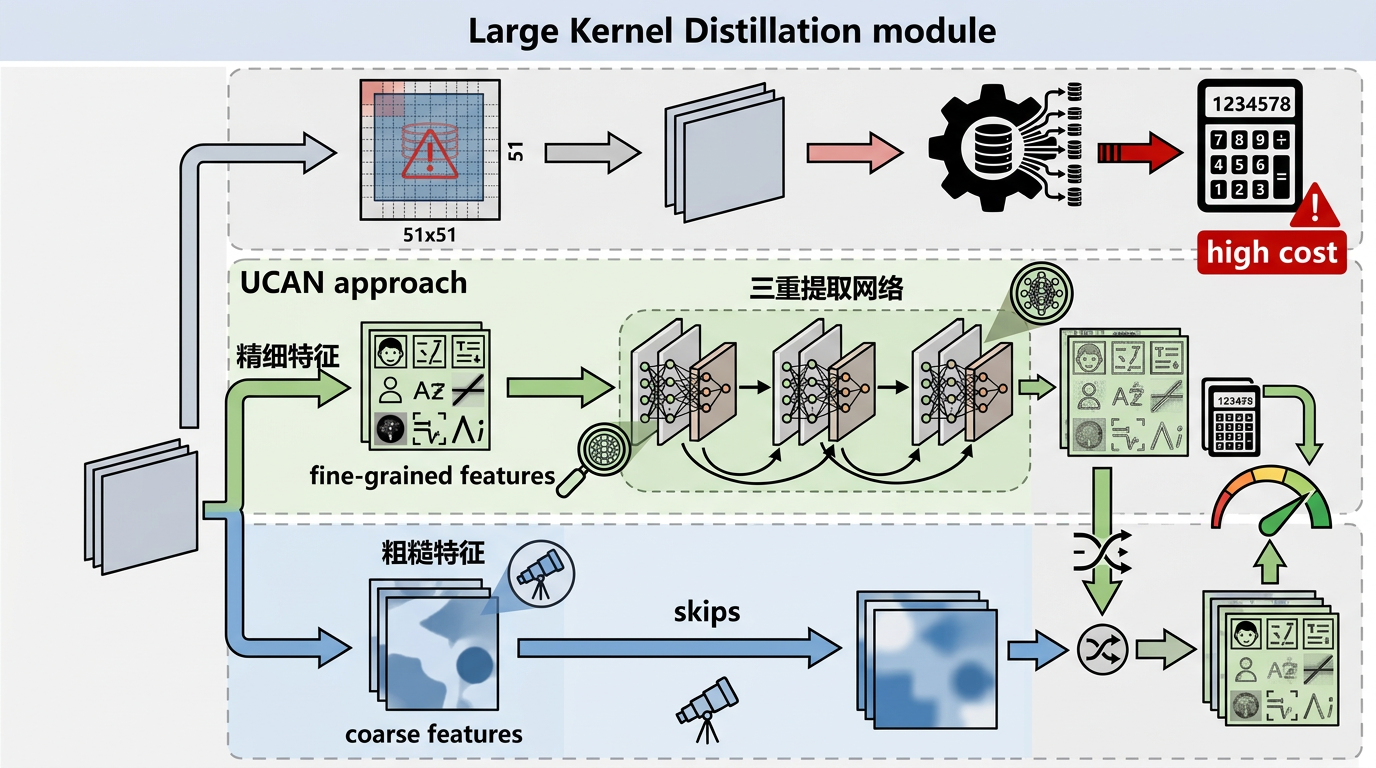

UCAN还加了一个「大核蒸馏」模块,进一步放大效率优势。传统大核卷积能扩大感受野,但51×51的卷积核计算量是灾难。UCAN的办法是「抓重点」:把特征分成精细和粗糙两部分,只给精细特征用复杂的三重提取网络模拟大核效果,粗糙特征直接跳过。相当于只给图像里的人脸、文字这些关键区域用「放大镜」,背景用「望远镜」扫一眼就行,计算量一下就下来了。

我认为,UCAN的最大价值,不是刷新了几个数据集的跑分,而是给轻量级视觉模型设计提供了一个可复制的范式:用精巧的结构创新,替代粗暴的参数堆叠。

过去大家做轻量化,要么是把大模型剪枝、量化,相当于把大象砍成小块塞进手机;要么是设计小卷积核的CNN,结果模型「眼光短浅」,只能看到局部细节。UCAN走的是第三条路:把注意力机制的优势和卷积的高效结合起来,再用参数共享和选择性计算把效率拉满。

这种思路其实已经在其他领域显现出潜力——比如同样是轻量级模型的PocketSR,用在线剪枝和蒸馏把扩散模型塞进了手机;BCRN用蓝图可分离卷积把参数压到28万,还能保持超分精度。UCAN的成功证明,只要把「注意力」「共享」「选择性计算」这几件事玩透,轻量级模型也能拥有大模型的能力。

当然,UCAN也不是完美的。它目前只针对单图像超分任务,能不能迁移到去噪、去模糊等其他视觉任务,还需要验证;在极端噪声或者超低功耗的设备上,它的鲁棒性还有待提升。但这些都不影响它的意义:它让我们看到,轻量化和高性能不是天生的敌人。

当我们还在争论「大模型还是小模型」的时候,UCAN已经用结果给出了答案:未来的AI模型,不会是越大越好,而是越「聪明」越好——能精准分配计算资源,能高效复用已有经验,能在有限的算力里做到最多的事。

轻量不是妥协,而是更高级的设计智慧。

也许用不了多久,我们手机里的「超清」按钮,就真的能把老照片里的皱纹、文字、风景,都清晰地还原出来——而这一切,都不需要我们换一台更贵的手机,只需要一个像UCAN这样,把「效率」刻进骨子里的模型。