对抗知识焦虑,从看懂这条开始

App 下载

AI成量子计算机的“隐形维修工”

算力优化|环境噪声|解码速度|自动校准|量子比特|量子科学|大语言模型|数理基础|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

算力优化|环境噪声|解码速度|自动校准|量子比特|量子科学|大语言模型|数理基础|人工智能

你或许没意识到,一台试图突破经典计算极限的量子计算机,可能正被自己的“脆弱”困住——每1000次量子比特操作,就会有1到10次错误;哪怕实验室温度波动0.1摄氏度,量子比特的关键参数也会漂移,让之前数天的校准全部作废。而现在,有团队用AI模型把量子计算机的校准时间从数天压缩到数小时,解码速度比传统主流工具快2.5倍,精度提升3倍,给这些“娇贵的算力贵族”装上了自动纠错的“隐形维修工”。这背后的逻辑是什么?AI到底是如何驯服量子世界的噪声的?

要理解这一突破,得先看清量子计算的核心困境:量子比特对环境干扰的敏感度,远超经典计算机的晶体管。哪怕是实验室里细微的电磁辐射、振动,甚至空气中的分子碰撞,都能让量子比特的叠加态坍缩,产生计算错误。而要让量子计算机实用化,必须把逻辑错误率压低到10^-12以下——相当于每万亿次操作只允许一次错误,这比现在主流量子设备的错误率低了10个数量级。传统的校准和纠错方法依赖人工调试和预设的噪声模型,不仅效率低下,还无法应对真实量子系统中复杂的串扰、泄漏等非线性噪声。

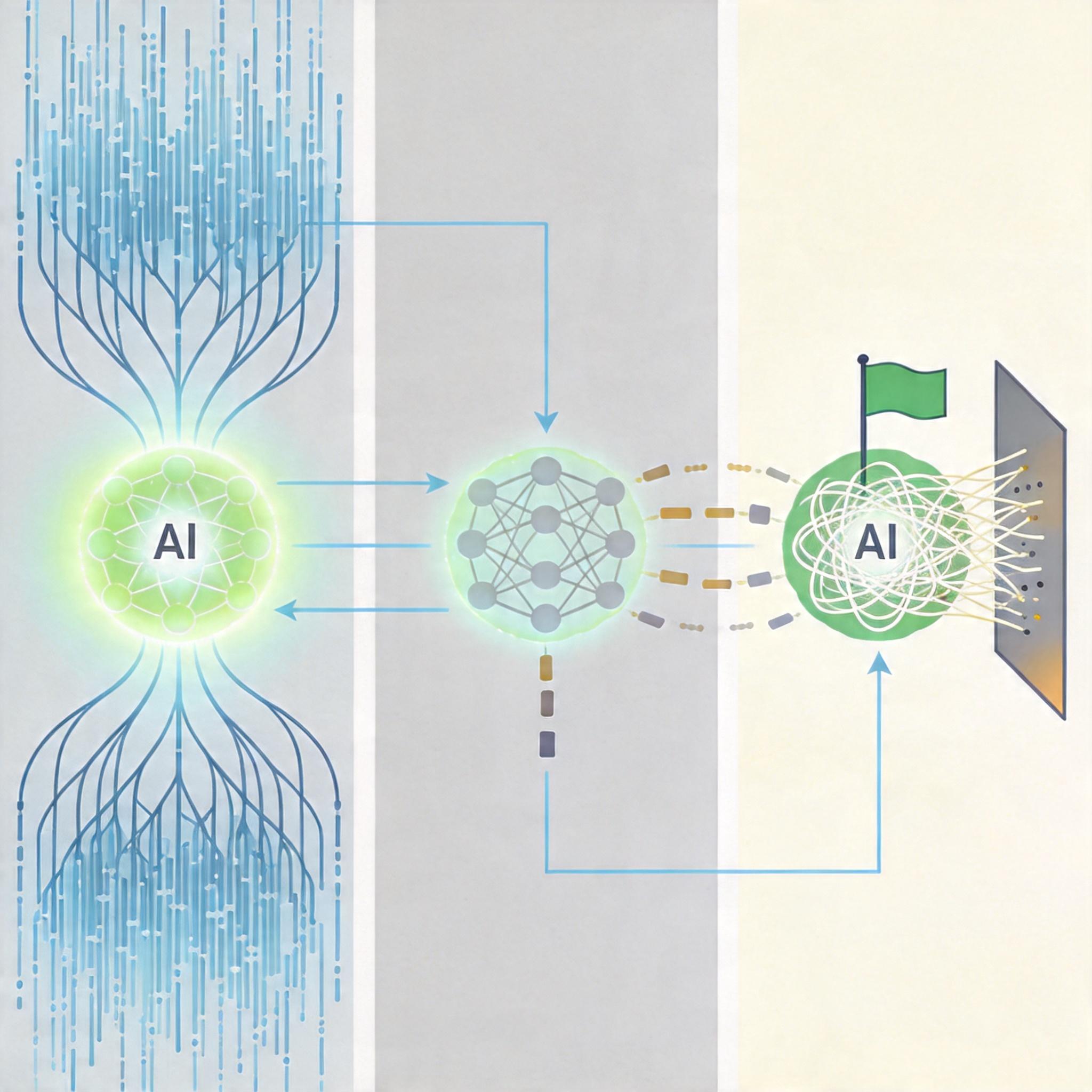

AI模型的优势,正在于它能像经验丰富的维修工一样,从海量数据中学习量子系统的“脾气”。以该团队开发的AI解码器为例,它先用模拟生成的数十亿个错误样本预训练,学习量子错误的基本模式,再用少量真实量子设备的数据微调,就能精准识别真实环境中复杂的噪声。这就像先让维修工在模拟器里熟悉各种故障,再到真实机器上实操,很快就能精准定位问题。用更专业的话说,AI模型通过自注意力机制捕捉量子比特间的长距离关联,用卷积层识别局部错误模式,能突破传统解码器对噪声的简化假设,适配更复杂的真实场景。

自动校准的逻辑也类似。传统人工校准需要逐个调节量子比特的频率、耦合强度等数十个参数,过程繁琐且无法应对参数漂移。而AI校准模型能把这看作一个优化问题,通过强化学习或贝叶斯优化,自动在参数空间中寻找最优解,甚至能实时监测参数变化并动态调整。就像给量子计算机装了个“恒温器”,一旦发现参数偏离,立刻自动修正,让系统始终保持在最佳状态。

但这一突破也并非没有隐忧。AI模型的训练依赖模拟数据,而模拟数据与真实量子系统的噪声总会存在差距,可能导致模型在真实设备上的泛化能力打折扣;同时,AI解码器本身也可能出现“幻觉”,错误地识别噪声模式,反而引入新的计算错误。此外,随着量子比特数量增加,AI模型的训练和推理成本也会指数级上升,如何在算力开销和纠错效果之间找到平衡,仍是待解的难题。

AI与量子计算的结合,本质上是用经典世界的智能,弥补量子世界的脆弱。它没有直接制造出更稳定的量子硬件,却通过“软修复”的方式,让现有量子设备的潜力得到释放。未来,当AI解码器能嵌入量子计算机的冷却腔,实现亚微秒级的实时纠错;当AI校准能在量子比特参数漂移的瞬间完成修正,量子计算机或许才能真正走出实验室,成为改变世界的算力引擎。

算力的未来,藏在脆弱与智能的共生里。