对抗知识焦虑,从看懂这条开始

App 下载

车展上的AI座舱,大多还只是高级聊天框

汽车AI|人机交互|北京车展|车载Chatbot|智能座舱|AI智能体|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

汽车AI|人机交互|北京车展|车载Chatbot|智能座舱|AI智能体|人工智能

2026年北京车展的展馆里,空气里飘着一股「不AI就出局」的焦虑。几乎每台新车的宣传页上都印着「大模型」「智能座舱」的字样,坐进车里喊一句「我有点闷」,AI会温柔地接话,甚至能跟你聊半小时网红餐厅打卡路线。但试完十几台车你会发现一个尴尬的事实:这些能说会道的AI,大多还是个「高级聊天框」——你让它开个窗,它要先问「要不要开」;你说想放松,它只会播放预设歌单,完全不懂结合车速、后排乘客状态调空调、开座椅通风。从「能聊天」到「能办事」,汽车AI还差着一道看不见的门槛。

你可以把车载Chatbot理解成一个被关在玻璃房里的聪明人:它能听懂你的话,甚至能帮你查资料、唠家常,但你不给他钥匙,他连房间门都打不开。而真正的Agent,是那个能拿着钥匙、调动资源帮你把事办了的助手。

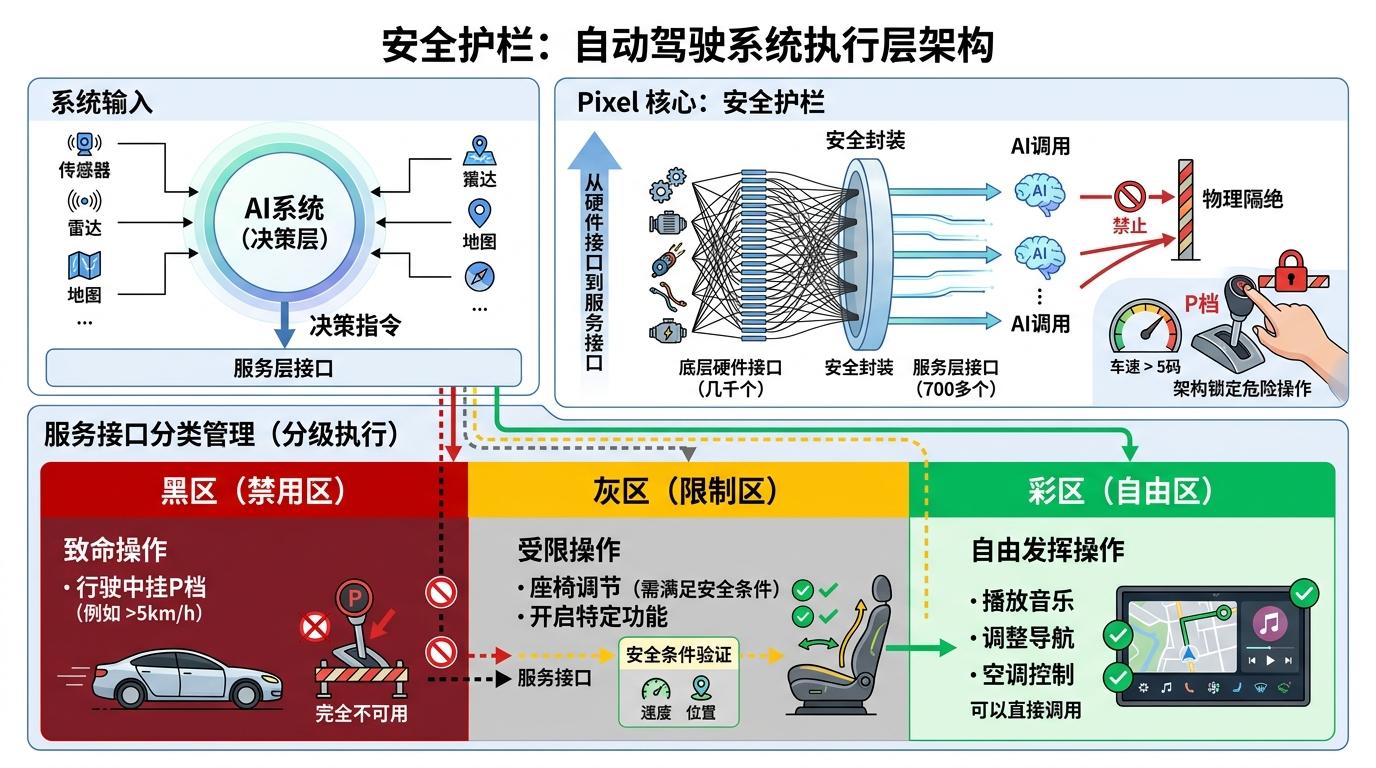

这中间的核心差距,从来不是AI会不会聊天,而是车企敢不敢把汽车的「控制权」交出去。一辆车的底层有几千个硬件接口——空调、车窗、座椅、行车信号……这些原本是给按钮和触屏设计的,每一个接口背后都连着安全逻辑:比如行驶中不能误碰P档,后排有人时不能突然开大音量。如果直接把这些接口暴露给AI,一旦出现误判,后果不堪设想。

现在大多数车企的做法,只是把原来的语音引擎换成了大模型API,相当于给玻璃房里的人换了个更聪明的脑子,但钥匙还攥在自己手里。AI能聊得天花乱坠,却碰不到真正的「控车」按钮。

要让AI既能办事又不闯祸,就得给它搭一套「带护栏的舞台」。目前行业里走得最远的方案,是一套叫CPP的三层架构——你可以把它看成AI的「车载操作系统」,一边给AI开权限,一边给安全上保险。

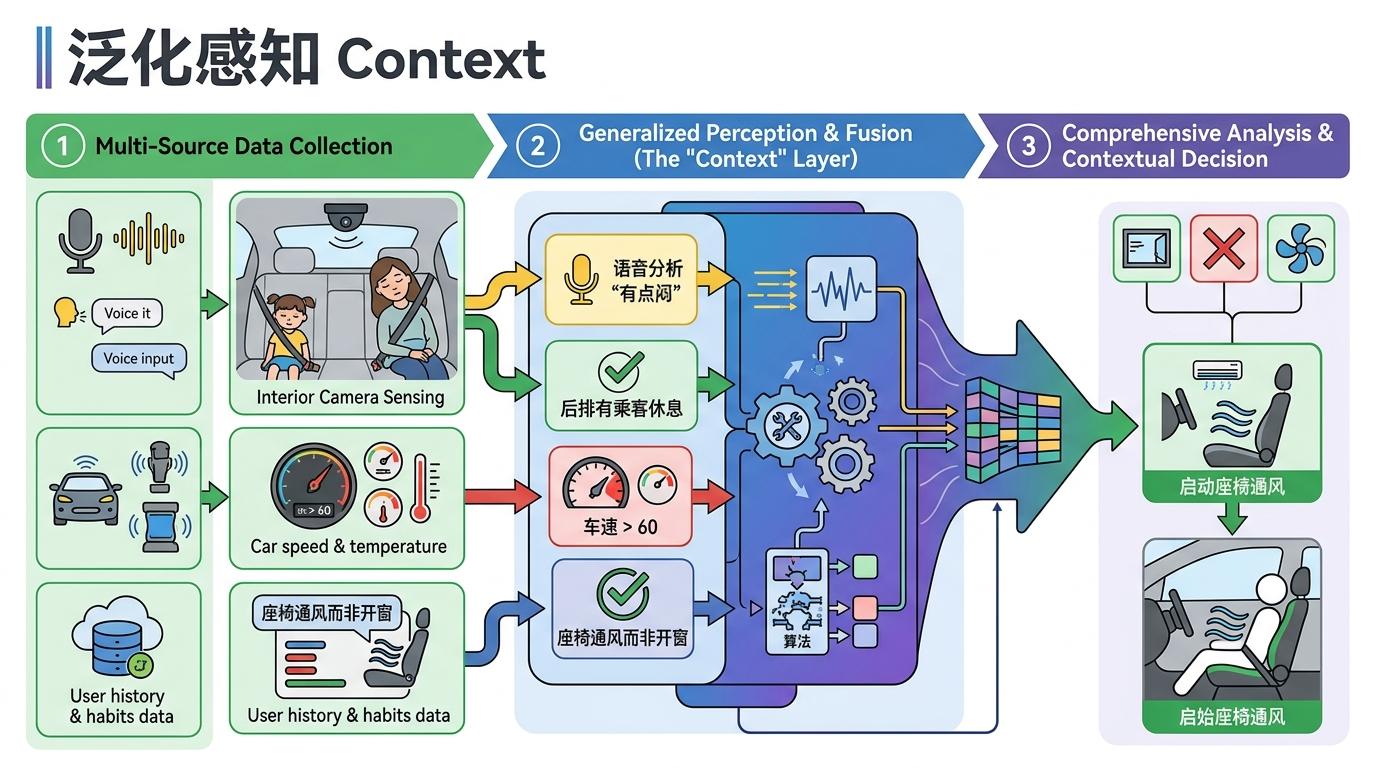

第一层是Context(泛化感知),它把汽车变成一个能「全方面感知」的智能体:不只是听你说话,还能通过车内摄像头看后排有没有人睡觉,用传感器测车速、温度,甚至调取你之前的用车习惯数据。比如你说「我有点闷」,它先会「看」后排有没有乘客在休息,「读」当前车速是不是超过60码,「记」你上次说闷时更喜欢开座椅通风而非开窗,这些信息凑在一起,才是它做决策的依据。

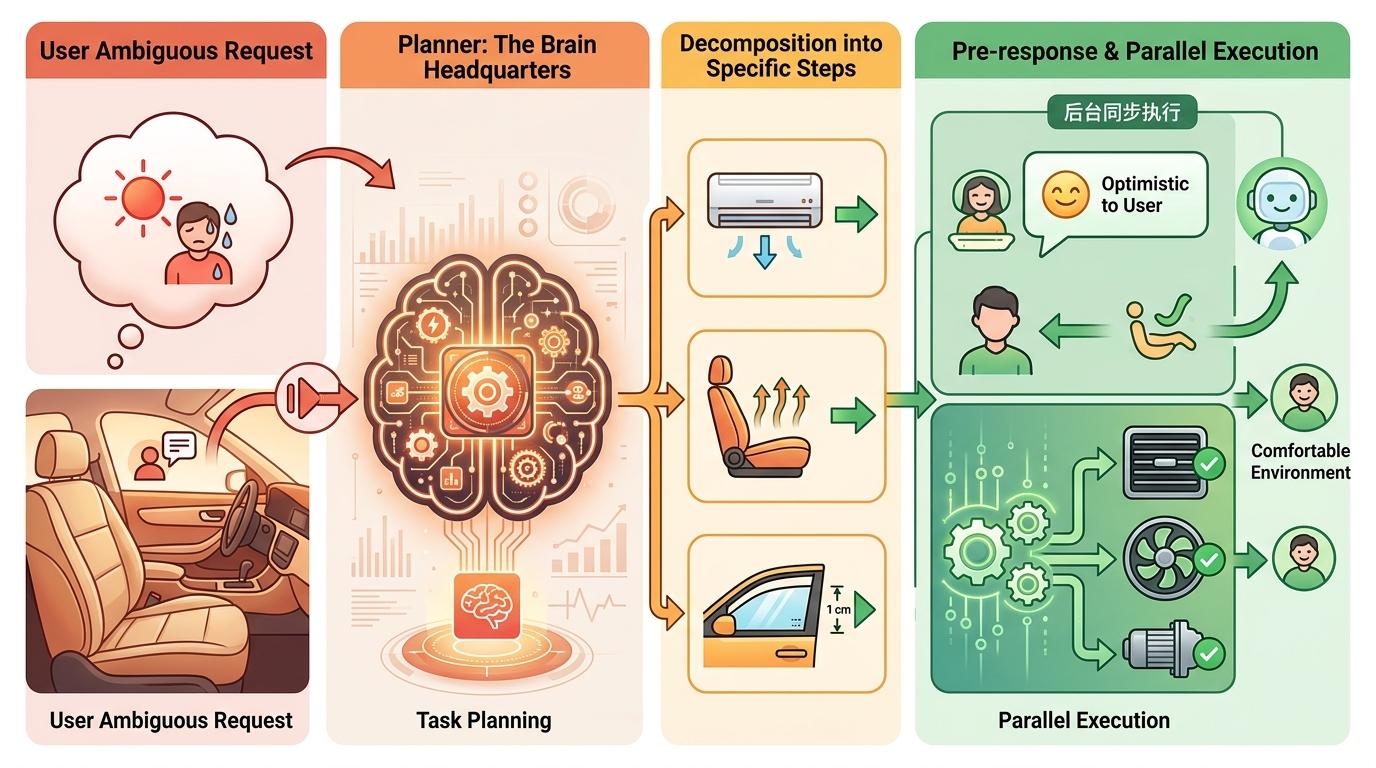

第二层是Planner(任务规划),相当于AI的「大脑指挥部」。它会把你的模糊需求拆成具体步骤:比如「有点闷」会被拆解成「调低空调1度+打开主驾座椅通风+车窗留1厘米缝隙」。为了不让你等得着急,它还有个「预响应」机制:先跟你说「我帮你调下通风和空调」,同时后台已经在同步执行操作,不会让你在沉默里怀疑它是不是死机了。

最关键的第三层是Pixel(像素级执行),这是整套系统的「安全护栏」。研发团队把几千个底层硬件接口,重新封装成700多个经过安全验证的「服务层接口」,AI只能调用这些接口,不能直接碰底层硬件。就像你开车时按P档,车速超过5码就按不动——这不是AI聪明,而是架构层面直接锁死了危险操作的可能。他们把接口分成「黑区、灰区、彩区」:行驶中挂P档这类致命操作是黑区,AI碰都碰不到;调节座椅属于灰区,要满足安全条件才能执行;播放音乐、调整导航是彩区,AI可以自由发挥。

这套CPP架构听起来清晰,但做起来的难度,相当于给一辆已经造好的车,重新换一套「神经中枢」。

首先得车企愿意「拆自己的墙」。要让AI能感知车内状态,就得把原本属于自动驾驶、倒车影像的摄像头信号,重新打通到座舱AI系统里——这涉及到汽车底层电子架构的重构,不是加个软件就能搞定的。有车企算了一笔账,光是把底层接口封装成安全服务层,就需要至少200人团队花两年半时间,还得把十几年积累的代码重新梳理一遍。

其次是AI和汽车的「磨合」。大模型擅长理解自然语言,但对汽车的安全逻辑一窍不通。比如AI说「打开车窗」,它不知道车速120码时开窗会有安全风险,也不知道后排宝宝在睡觉需要留缝隙。这需要把汽车的安全规则,一点点「喂」给AI,还要反复测试极端场景:比如暴雨天说「我有点闷」,AI会不会傻到开窗?

现在行业里能做到这个程度的,还只是少数几家的试点车型。大多数车企还停留在「先把大模型装上车再说」的阶段——毕竟,让用户觉得「车变聪明了」,比真的让车「会办事」容易多了。

当我们在聊AI座舱时,其实聊的是「汽车到底能有多懂你」。未来的车载AI,不该是你需要时刻指挥的工具,而该是一个默默观察你的伙伴:它记得你喜欢22度的空调,知道你开车时不爱被打扰,能在你刚打哈欠时就打开座椅按摩,在你路过母校时自动播放你上学时听的歌。

从Chatbot到Agent,不是AI变聪明了,而是汽车终于愿意把「控制权」交出来,给AI搭起一个能真正做事的舞台。这道门槛背后,藏着汽车从「交通工具」到「智能伙伴」的质变。 懂你的车,才是真的智能车。