对抗知识焦虑,从看懂这条开始

App 下载

低光图像去黑科技:让夜色里的细节和色彩都不丢

无人机安防|近红外摄像头|RGB传感器|频率解耦隐式神经表示|低光图像增强|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

无人机安防|近红外摄像头|RGB传感器|频率解耦隐式神经表示|低光图像增强|多模态视觉|人工智能

黄昏的森林里,无人机的摄像头正对着一片漆黑——不是真的空无一物,而是低光环境下的RGB传感器已经罢工:画面里满是雪花状的噪点,树干的轮廓糊成一团,原本深绿的树叶只剩灰蒙蒙的色块。如果换个近红外摄像头,倒是能看清树皮的纹理,可屏幕上只剩单调的灰度,连哪棵树是目标都分不清。这不是科幻片里的难题,而是安防巡检、应急救援里每天都在发生的困境:要么有颜色没细节,要么有细节没颜色。直到2026年,一支中国团队用「频率解耦隐式神经表示」(FD-INR),给这对「瘸腿搭档」找到了完美的配合方式。

你可以把一张图像想象成一首交响乐:低频是沉稳的大提琴,负责勾勒全局轮廓和整体色调——就像低光RGB里还能勉强分辨的树叶颜色、树干形状;高频是清脆的小提琴,负责演奏细节纹理——比如近红外镜头里清晰的树皮纹路、枝桠边缘。过去的融合方法要么把整首曲子混在一起乱炖,要么硬把小提琴声部贴到大提琴上,结果要么音色浑浊,要么完全走调。

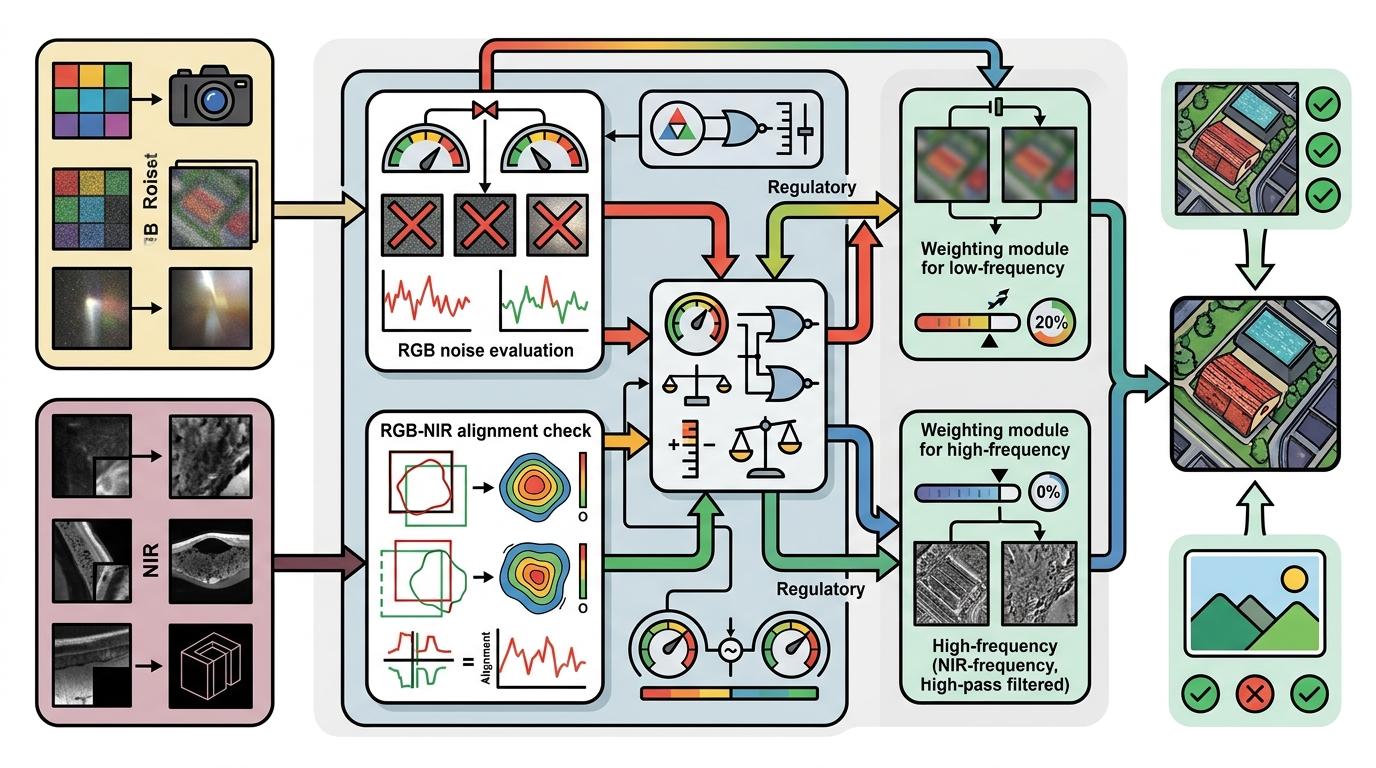

FD-INR的思路简单又精准:用离散小波变换这把「精密调音器」,把图像的低频和高频成分彻底分开。低频部分交给RGB传感器指导,用鲁棒的损失函数约束它只专注于还原自然色彩,自动滤掉雪花状的高频噪点;高频部分则交给近红外传感器监督,用结构相似性损失逼着它只输出纯粹的纹理细节。

为了防止两个频段「串台」,研究者还加了两道保险:频谱解耦正则化会惩罚低频分支里的高频能量,也不许高频分支碰任何低频信息;零均值中心化约束则要求高频分支的输出只能围绕一个固定偏置波动,绝对不能携带全局亮度——相当于给近红外的「灰度信号」上了个「颜色隔离锁」,彻底避免它污染RGB的色彩。

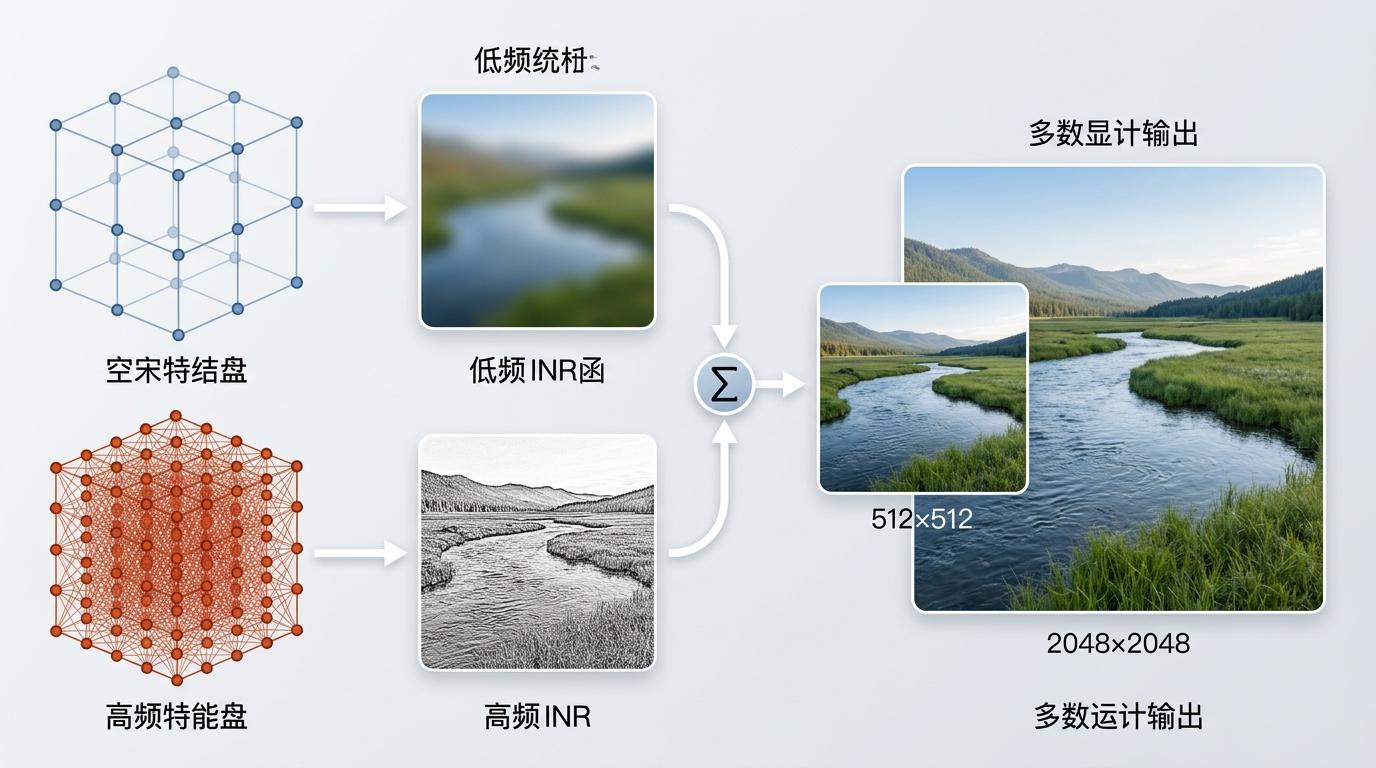

如果说频率解耦是「分工策略」,那隐式神经表示(INR)就是「执行工具」。传统图像处理里,图像是一个个离散的像素点,就像用积木堆出来的画——放大了就能看到缝隙,拼接处还容易有毛刺。INR则把图像变成了一个连续的数学函数:输入任意空间坐标(x,y),就能输出这个点的像素值,相当于用一整块画布来作画,没有缝隙,也能无限放大。

在FD-INR里,低频和高频分支各自是一个INR函数:低频分支用稀疏的特征网格,天然限制了它能表达的最高频率,就像给画布蒙了一层细纱,只允许柔和的色彩透过;高频分支用密集的特征网格,能捕捉最细微的纹理变化,就像用细毛笔勾勒的线条。这种连续表示还有个额外好处:它能直接输出任意分辨率的图像,不需要额外的上采样步骤——比如把512×512的图像直接变成2048×2048,细节依然清晰。

为了让两个分支的配合更默契,FD-INR还加了个「智能调度员」:自适应不确定性加权机制。它会给每个任务「打分」,如果某个区域的RGB噪点特别严重,就自动降低低频分支的权重,让近红外的高频细节多发挥点作用;如果近红外的纹理和RGB的轮廓不太对齐,就调整高频分支的约束强度。这种动态平衡,让模型在复杂场景下也能稳定输出高质量图像。

在真实低光数据集DVD上的测试,给了FD-INR最直接的肯定:它的NIQE指标(衡量图像自然度,越低越好)达到了2.896,是所有测试方法里最低的;NCC指标(衡量结构相似性,越高越好)冲到了0.961,意味着它还原的纹理和真实场景几乎一致。

视觉对比更直观:传统融合方法要么把树叶的颜色弄成诡异的灰绿色,要么把树皮的纹理糊成一团;基线方法虽然提亮了画面,可树叶的边缘还是有模糊的伪影;只有FD-INR输出的图像里,深绿的树叶颜色自然,树皮的裂纹清晰可见,连枝桠上的小分叉都能分辨。

消融实验则拆穿了「黑箱」:去掉零均值中心化约束,图像要么过曝要么暗沉;去掉梯度监督,边缘会出现「油画效应」;去掉频谱解耦正则化,纹理就会变得模糊。每一个模块都在为「细节不丢、色彩不变」这个目标服务,没有多余的设计。

当然,FD-INR还不是完美的。它现在需要对每一对图像单独训练,处理一张512×512的图像要花20毫秒,对于实时视频流来说还是有点慢;如果RGB和近红外图像的空间对齐太差,它的效果也会打折扣。但这些局限更像是成长的注脚,而非致命的缺陷——毕竟它已经找到了一条全新的跨模态融合路径:不是让不同模态的信息「打架」,而是基于物理先验给它们「分工」。

用对的方法,让每个模态都做擅长的事。这句话不仅适用于低光图像去噪,也适用于所有跨模态感知任务。当我们不再强迫AI「用一种方式解决所有问题」,而是学会利用每个传感器的天生优势,夜色里的细节和色彩,自然就都能留住了。