对抗知识焦虑,从看懂这条开始

App 下载

力源信息净利暴增241%,拆解AI浪潮下的“光模块与液冷”逻辑

数据中心|AI服务器|液冷系统|光模块|力源信息|半导体技术|前沿科技

对抗知识焦虑,从看懂这条开始

App 下载

数据中心|AI服务器|液冷系统|光模块|力源信息|半导体技术|前沿科技

当你还在为手机内存不够发愁时,半导体产业链的另一端正在上演一场疯狂的“抢货大战”。2026年第一季度,一家名叫力源信息的公司净利润同比暴涨241%,环比更是飙升756%——这不是什么资本炒作的数字游戏,而是AI浪潮砸向实体经济的第一块“礁石”。

背后的逻辑直白得惊人:AI服务器要“跑”起来,就得靠光模块当“高速网线”、靠液冷系统当“空调”,而这些以前不起眼的配件,现在成了比芯片还抢手的香饽饽。为什么AI一火,这些冷门技术就突然值钱了?这得从数据中心里那些发烫的GPU说起。

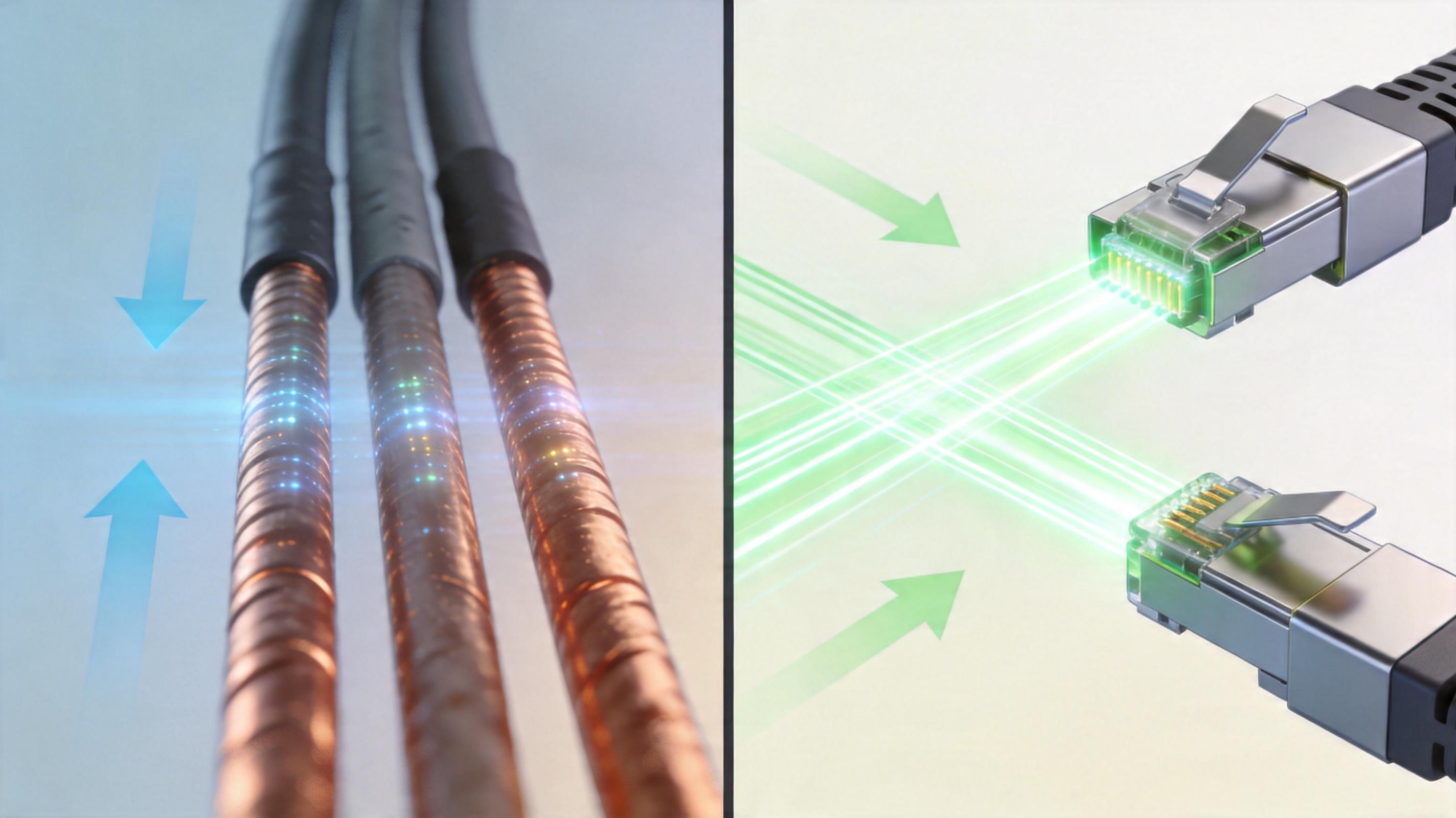

你可以把AI训练集群想象成一个超级大脑,GPU是它的神经元,而光模块就是连接神经元的神经纤维——没有足够粗、足够快的纤维,再聪明的神经元也没法协同工作。

传统的铜缆就像家里的电话线,带宽有限还容易“堵车”,而光模块是用激光在光纤里传数据,速度是铜缆的几十倍。现在AI训练一次动辄要调动几万块GPU,每块GPU每秒要交换几十GB的数据,铜缆根本扛不住,必须换成800G甚至1.6T的光模块。

但真实的技术细节比这个类比更苛刻:光模块里的激光器对温度敏感到“差1℃就罢工”,必须用微型热电冷却器精准控温;为了塞进更多数据,工程师们用上了PAM4调制技术——就像把一条马路从2车道拓宽成4车道,虽然会增加交通管制的难度,但能让数据量直接翻倍。

更关键的是,光模块的需求不是线性增长,而是跟着AI模型的规模指数级暴涨。OpenAI的GPT-4训练一次需要的数据流,相当于把整个互联网的内容传输几十遍,这直接把光模块的订单量推到了历史新高。

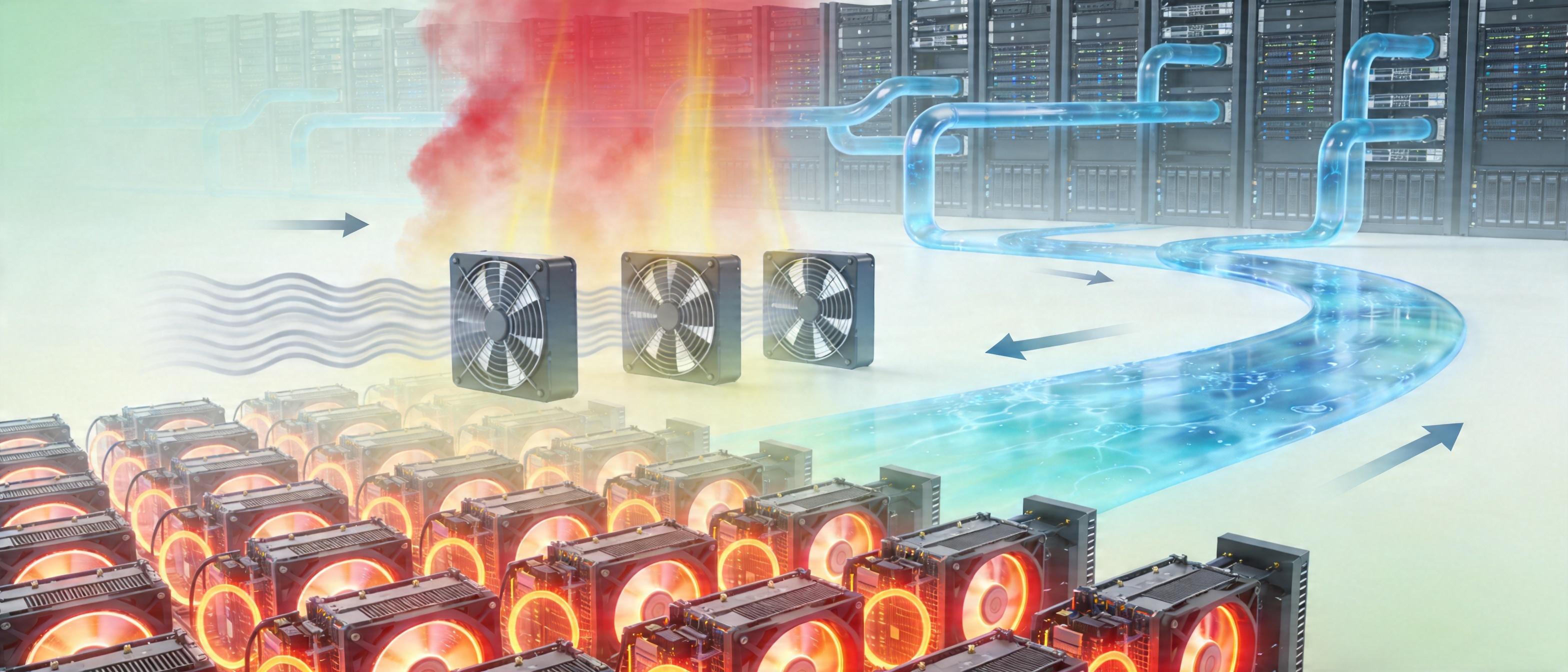

当几万块GPU同时工作时,数据中心的温度会飙升到什么程度?相当于把几千台电磁炉同时开最大功率,传统的风冷系统就像用扇子给火炉降温,完全没用。这时候液冷技术就成了救命稻草。

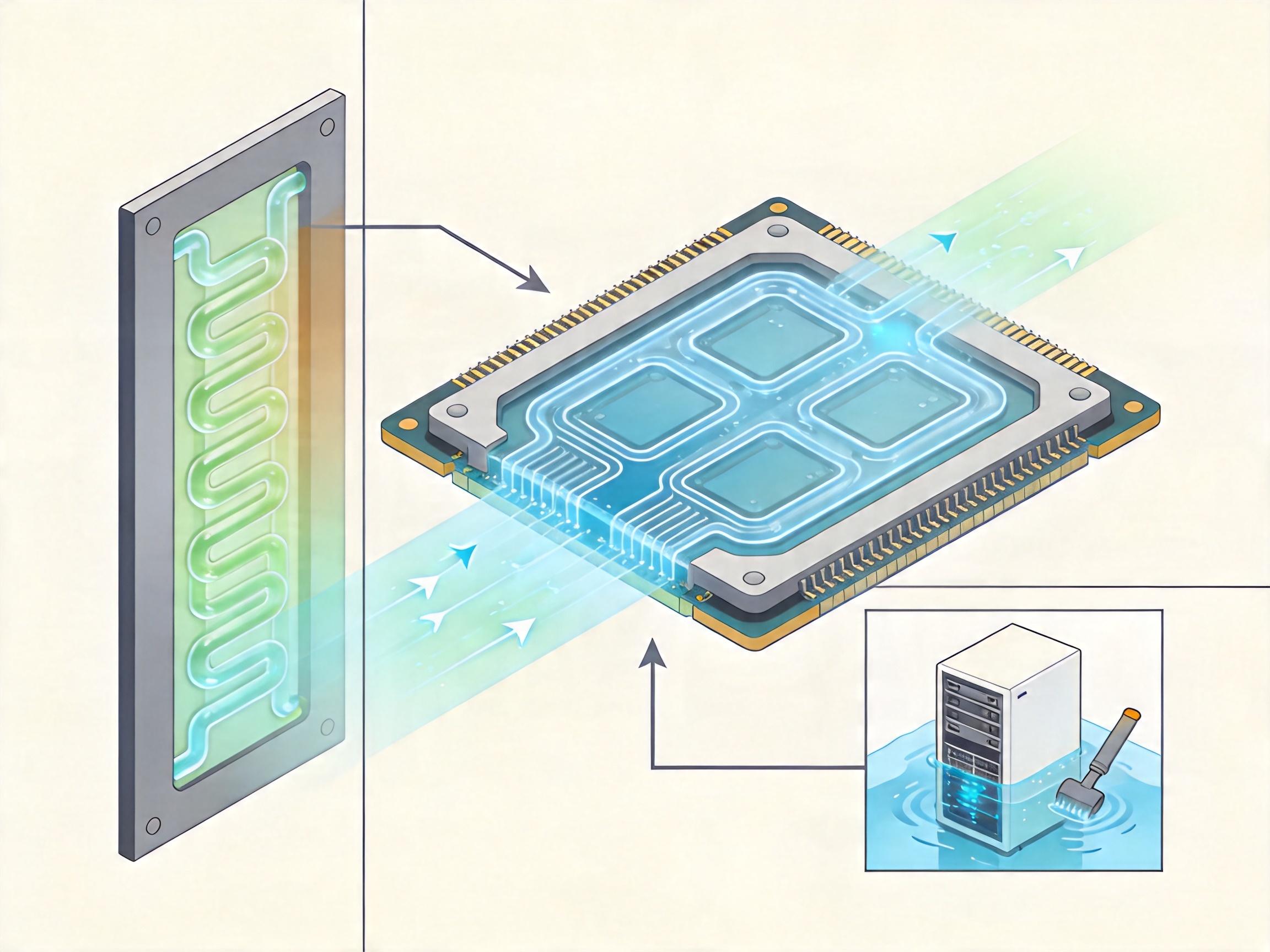

你可以把风冷想象成用风扇吹电脑机箱,而液冷是直接把CPU泡在冷水里——液体的导热效率是空气的几千倍,能瞬间把热量带走。现在主流的液冷技术分两种:一种是“直冷”,用冷板直接贴在GPU上,就像给发烧的病人贴退烧贴;另一种是“浸没式液冷”,把整个服务器泡在绝缘冷却液里,就像给CPU泡冷水澡。

但真实的工程挑战比这复杂得多:微软的工程师甚至在芯片背面蚀刻出微米级的微通道,让冷却液直接流过芯片内部,这样的冷却效率是传统冷板的3倍,能把GPU的温度峰值降低65%。而浸没式液冷虽然效果最好,但要解决冷却液的成本、泄露风险,还有服务器维修时“捞设备”的麻烦。

更值得关注的是,液冷不只是解决散热问题,它还能直接提升AI的训练效率——GPU温度每降低10℃,性能就能提升5%,这意味着同样的电费能跑出更多的AI模型。

力源信息的业绩暴涨,本质上是AI重构了半导体产业链的供需天平。以前是消费电子主导市场,现在AI服务器成了最大的买家,直接把存储芯片、MLCC这些元器件的价格炒上了天。

台积电的高管说,AI芯片的需求至少两年内会超过供应,因为建一座先进制程的晶圆厂需要3年时间,而AI的需求每半年就翻一倍。这种供需错配直接导致了价格的剧烈波动:HBM内存的价格一年涨了50%,光模块的成本翻了3倍,就连不起眼的特种气体都因为AI芯片的需求暴涨而涨价。

但这里藏着一个被忽略的风险:现在整个产业链都在盯着AI的短期需求,却可能忽略了传统市场的产能缺口。比如消费电子的芯片供应已经开始紧张,2026年PC和智能手机的出货量预计会下降10%,这就是AI抢产能的直接后果。

更有意思的是,AI自己也在被用来解决供应链问题——现在很多半导体公司用AI预测需求、优化库存,甚至用数字孪生模拟供应链中断的场景,这算是“解铃还须系铃人”的现实版。

当我们为AI的神奇能力惊叹时,很少有人会想到,支撑它的是那些发烫的GPU、高速的光模块和冰冷的冷却液。力源信息的业绩暴涨不是孤立的事件,而是AI浪潮席卷实体经济的一个信号——它不仅在改变我们的生活,也在重构整个科技产业的版图。

AI向前跑,产业链得先“修路”“降温”。未来几年,光模块和液冷这些以前的冷门技术,会变成AI产业的基础设施,而那些能提前布局的公司,会成为下一轮科技竞赛的赢家。

当你下次刷到AI生成的视频时,不妨想想:这些惊艳的内容背后,是无数光模块在深夜里传输数据,是液冷系统在悄悄带走GPU的热量——科技的进步,从来都是从那些看不见的地方开始的。