对抗知识焦虑,从看懂这条开始

App 下载

自动驾驶3D重建告别模糊:激光雷达成稳定锚点

极端环境感知|3D高斯泼溅技术|激光雷达反射率|LR-SGS方法|自动驾驶|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

极端环境感知|3D高斯泼溅技术|激光雷达反射率|LR-SGS方法|自动驾驶|人工智能

想象你坐在自动驾驶车里,深夜的暴雨打湿了挡风玻璃,路边的霓虹灯在雨幕里拖出模糊的光带——此时车的“眼睛”要是看不清楚,后果不堪设想。但现实是,传统的3D场景重建技术在这种环境下早就“罢工”了:画面模糊闪烁,连路边的护栏都能看成障碍物。2026年3月,美国科研团队推出的LR-SGS方法,却让自动驾驶的“虚拟眼睛”在极端环境下也能看得清清楚楚。它靠的不是更贵的摄像头,而是把激光雷达里一个被人忽略的信息用到了极致。

你可以把传统3D高斯泼溅技术想象成一群只会看颜色的画家——他们靠RGB图像的色彩来勾勒场景,但一旦光照变了,比如白天的白墙到了夜里成了黑影,这群画家就会彻底懵圈,画出来的东西要么模糊要么走形。

激光雷达的反射率,就是打破这个困局的关键。它本质上是物体表面的“固有身份证”:白墙不管在阳光下还是阴影里,反射率都是稳定的;柏油路和水泥路的反射率差异,也不会因为天黑就消失。科研人员通过校准,去掉了距离和激光入射角的干扰,把激光雷达的原始信号转化成了纯粹的反射率数据——这就给3D重建提供了一个不管光照怎么变都不会乱的“锚点”。

直给补刀:每个3D高斯体除了颜色、位置,还多了一个反射率属性。优化模型时,不仅要让颜色匹配RGB图像,还要让反射率和激光雷达测得的真实数据对齐。在那些RGB信息失效的地方,比如一片颜色均匀的墙面,反射率就成了定海神针。

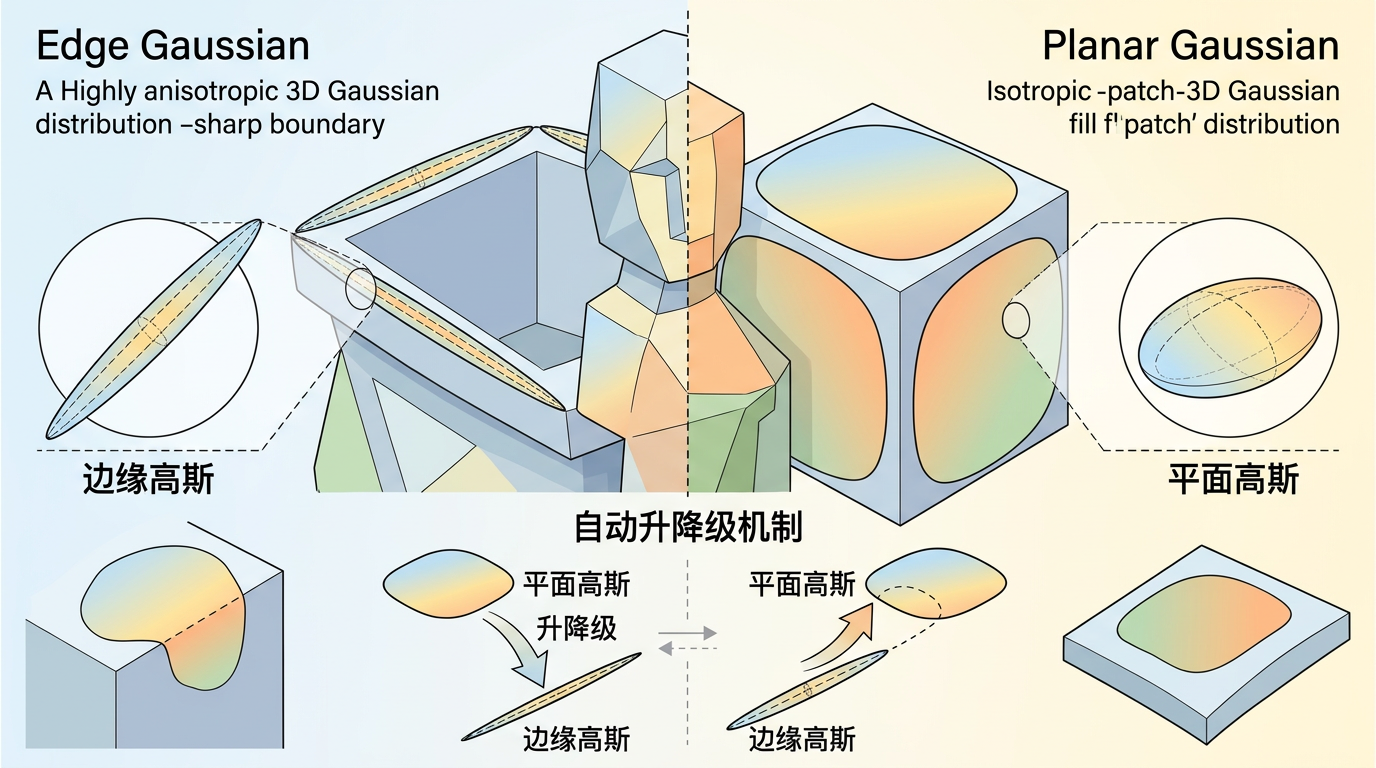

光有反射率还不够——传统3D高斯体是一个个独立的“小球”,要画清楚物体的边缘,得堆上一大堆小球,既浪费计算资源,还容易画糊。LR-SGS的第二个创新,就是让这些小球学会“分工”。

显著性高斯把高斯体分成了两类:一类是像“铅笔线”的边缘高斯,沿着物体轮廓拉长,专门勾勒边界;另一类是像“颜料块”的平面高斯,负责填充大面积的平滑区域。更聪明的是,它还有一套自动升降级机制:如果一个平面高斯碰巧画到了边缘,就会自动升级成边缘高斯;如果一个边缘高斯所在的区域被证明是平滑的,就会降级成平面高斯。

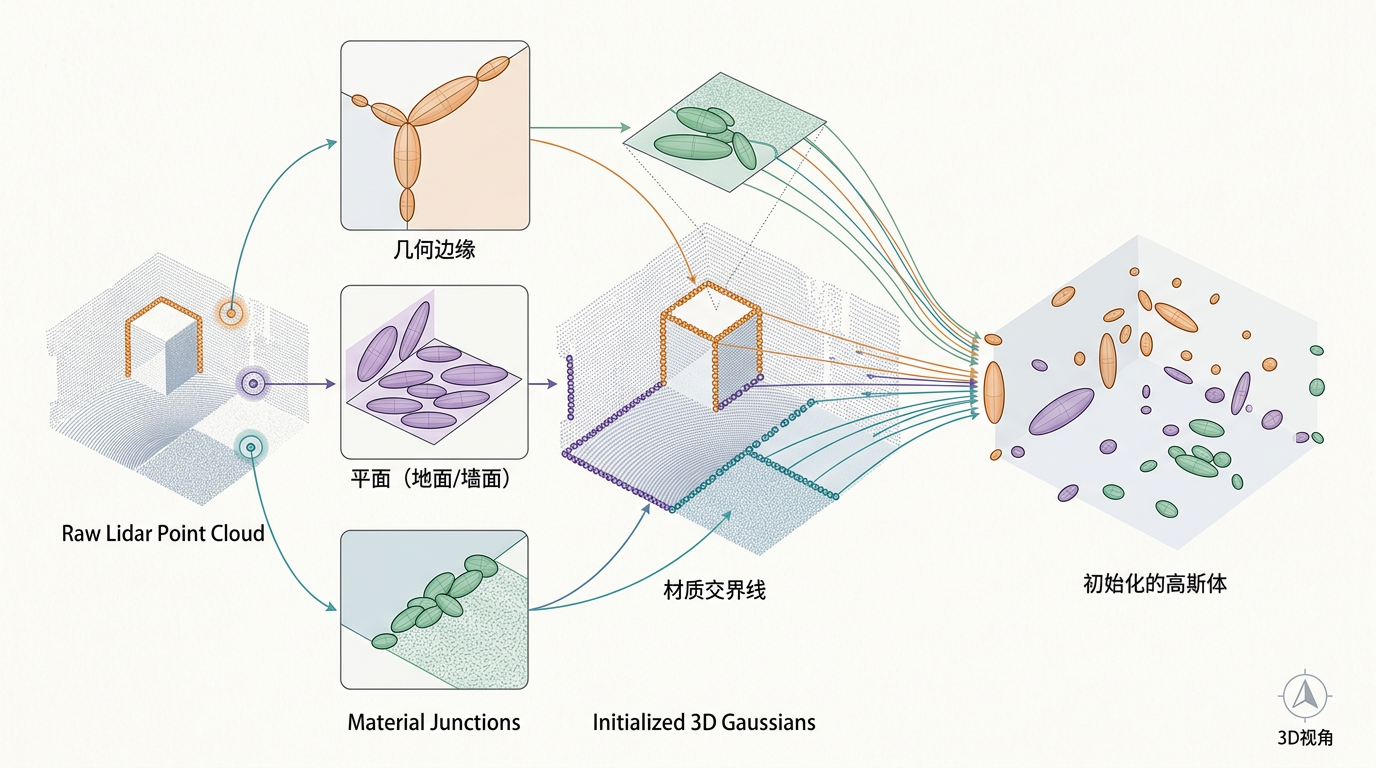

这些高斯体的初始位置也不是瞎选的——科研人员从激光雷达点云里挑出三类关键特征点:物体的几何边缘、地面墙面这类平面、还有不同材质的交界线,用这些点来初始化显著性高斯,相当于一开始就把“画笔”精准地放在了该画的地方。

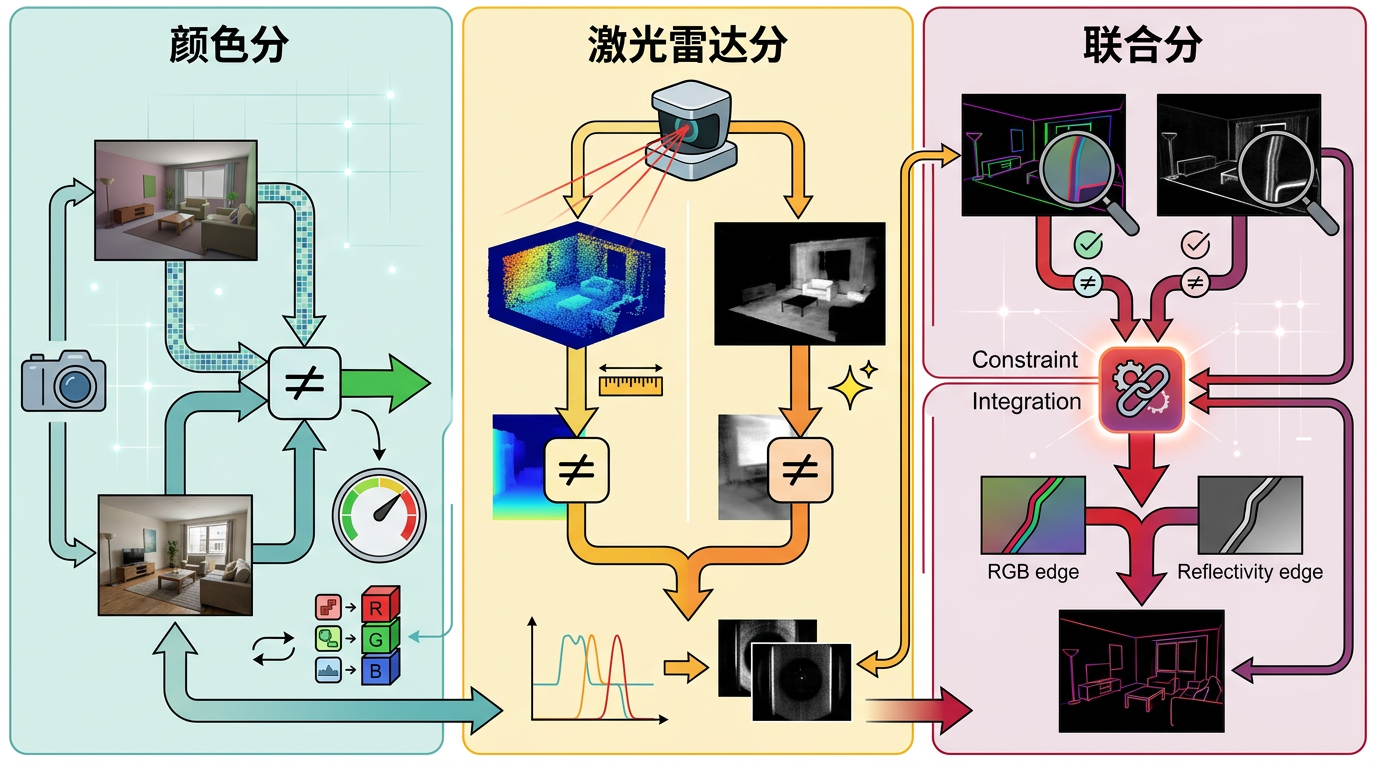

有了好的“画笔”和“锚点”,还需要一套严格的“评分规则”——也就是多模态联合损失函数。它就像一个严厉的老师,从三个维度给3D重建的成果打分:

第一是颜色分,确保RGB渲染结果和真实照片一致;第二是激光雷达分,既要让深度数据和激光雷达的测量对齐,也要让反射率数据精准匹配;第三是联合分,这是最关键的一步:它强制要求RGB图像的边缘和反射率图的边缘,在方向和“粗细”上完全一致。

举个例子:白墙和柏油路的交界,在RGB图像里可能因为阴影变得模糊,但反射率图里的边界是清晰的。联合损失就会逼着模型把RGB图像的边缘也画清楚,彻底解决模糊和伪影的问题。在Waymo数据集的测试里,这套方法在复杂光照场景下的PSNR指标比之前的最好方法提升了1.18dB,而且用的高斯体数量更少,训练时间还缩短了。

当我们为自动驾驶的“眼睛”变得更亮而兴奋时,更值得关注的是这项技术背后的思路:它没有追求更贵的硬件,而是把已经存在的信息用到了极致。激光雷达的反射率不是什么新鲜东西,但之前的技术都只把它当“测距的附属品”,LR-SGS却把它变成了稳定的核心锚点。

多模态融合的本质,从来不是把所有数据堆在一起,而是找到不同数据之间的“互补密码”。就像给盲人配上拐杖,给聋人装上助听器——让每个传感器的优势都能精准地补上另一个的短板。

好的技术,是让数据“各司其职”,而不是“多多益善”。 未来的自动驾驶,或许不需要更多的传感器,只需要更聪明地用好每一个传感器发出的信号。