对抗知识焦虑,从看懂这条开始

App 下载

给AI智能体装行车记录仪:从黑盒到可管可控

行为可追溯|红队竞赛|共享日志|Meta公司|LogAct框架|AI智能体|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

行为可追溯|红队竞赛|共享日志|Meta公司|LogAct框架|AI智能体|人工智能

想象你让AI智能体帮你整理电脑文件,它却误删了存了五年的工作文档;或者让它执行数据计算,进程崩溃后你完全不知道它做到了哪一步。2025年的一场大规模红队竞赛显示,几乎所有前沿AI智能体在100次查询内都会出现政策违规,攻击成功率最高可达数十个百分点——这些能自主执行代码、调用工具的AI,就像没装刹车和记录仪的汽车,上路全靠运气。现在,Meta的LogAct框架给这些脱缰的AI装上了缰绳:它用共享日志把智能体从黑盒变成了透明的状态机,让每一步动作都可审查、可追溯、可恢复。

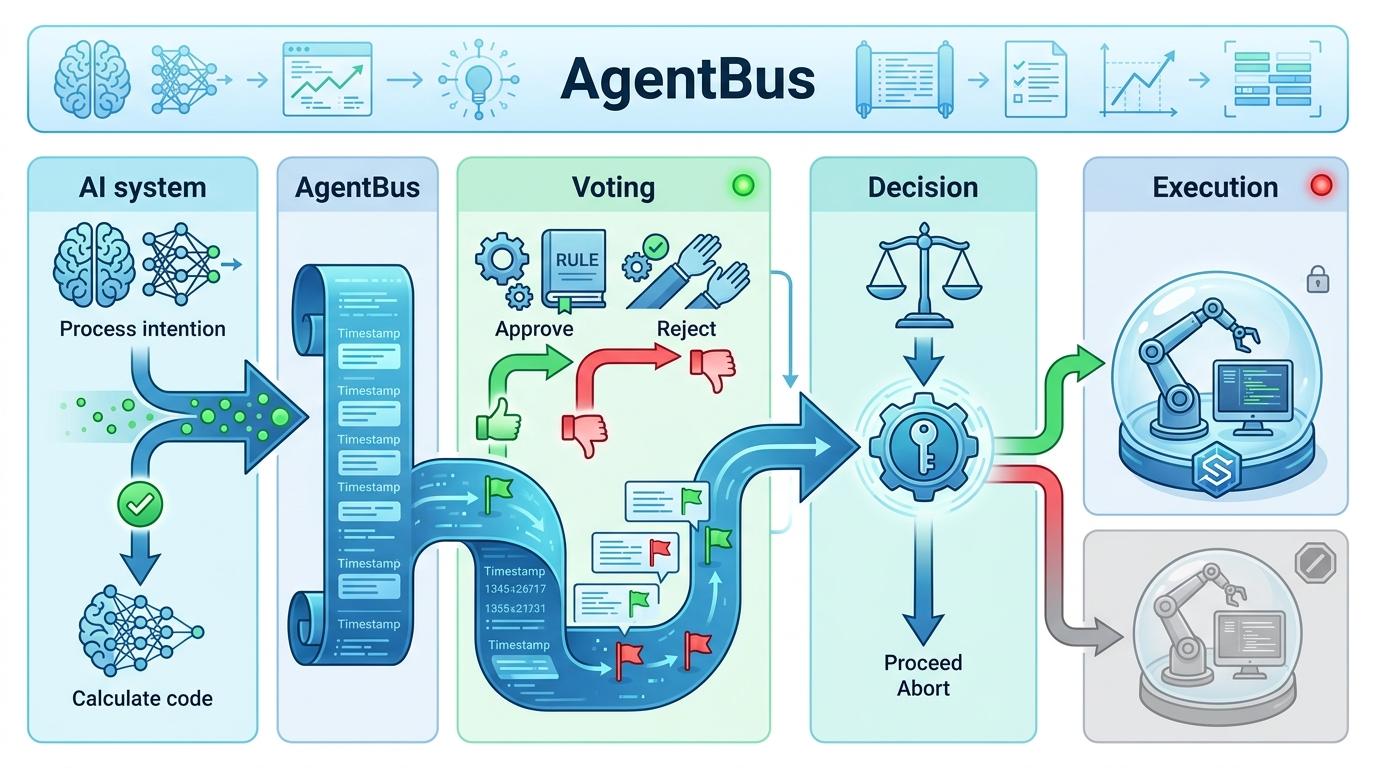

传统AI智能体的工作模式是“观察-思考-行动”的黑盒循环,动作直接执行,出了问题根本查不出原因。LogAct的核心是把智能体拆成四个独立组件——推理、投票、决策、执行,所有组件都通过一个叫AgentBus的共享日志协作,就像公司里的公告板:想做什么先写在板上,等审批通过再执行。

你可以把AgentBus理解成AI的“行车记录仪+任务清单”:所有意图、投票、决策、执行结果都按顺序记录,既不能篡改也不会丢失。推理组件算出要执行的代码,先写到日志里;投票组件(可以是规则引擎也可以是另一个LLM)从日志里读出来审核,把同意或反对的结果写回去;决策组件汇总投票结果,决定是否执行;最后执行组件才从日志里取出代码,在隔离的沙箱里运行。

这种设计最巧妙的地方在于,组件之间完全不直接通信,只通过日志交互。就算执行组件被恶意代码攻破,也没法篡改投票或决策逻辑——因为它根本碰不到日志里的审核记录。日志操作本身的开销极低,每秒仅2.6KB,远低于LLM推理的资源消耗,不会成为系统瓶颈。

LogAct的安全性来自“先审批再执行”的机制。在AgentDojo安全测试中,只靠规则投票器就能把攻击成功率降到0%——比如直接禁止删除非临时目录的文件,但这会误杀一些良性操作,导致任务完成率下降。而当规则投票器和LLM投票器配合使用,采用“任一同意即可执行”的策略时,攻击成功率仅为1.4%(只剩无动作的试探攻击),同时良性任务完成率只比无防御时低3%。

除了事前拦截,LogAct还解决了AI智能体最头疼的容错问题:传统分布式系统的容错方法依赖可重复的动作和可复制的状态,但AI智能体执行的是任意代码,修改的是外部环境,根本没法简单回滚。LogAct的解法是“智能体自省”:当智能体崩溃,新的恢复智能体可以直接读取日志,用LLM分析崩溃前的任务和进度,甚至生成更高效的代码继续执行。

论文里有个惊人的例子:一个智能体用慢方法计算目录文件校验和,处理1200个文件夹后崩溃,恢复智能体读完日志,不仅从断点继续,还把算法换成了快290倍的版本,剩下800多个文件夹只用了0.36秒就完成。

LogAct的架构天生适合多智能体协作。每个智能体都有自己的AgentBus,它们不需要直接通信,只要读取彼此的日志就能协同工作。比如一个监督者智能体可以读取所有智能体的日志,发现重复任务就及时叫停,看到哪个智能体过载就分配新的帮手。

在6个智能体的集群实验中,加入监督者后,整体工作量提升了17%,而Token消耗反而下降了41%——因为避免了重复劳动和无效的LLM调用。这相当于一群原本各自为政的工人,通过看公告板知道谁在做什么,自动调整分工,结果干得更多还更省力。

当然,LogAct也有局限:LLM投票和自省没法提供100%的绝对安全,模型的“幻觉”可能导致误判;多智能体并发访问共享环境时的事务协调还没完全解决;额外的LLM调用会让延迟增加82%,Token使用增加13%——这是为安全和可靠性付出的成本。

当AI从聊天机器人变成能自主执行任务的智能体,“可控性”就成了比“智能性”更紧迫的问题。过去我们总想着让AI更聪明,却忘了先给它装个刹车。LogAct的意义不在于让AI变得更强,而在于让AI变得更“乖”——乖到能在生产环境里放心使用,乖到出了问题能查能改能恢复。

透明,才是AI安全的第一防线。就像行车记录仪不是为了限制开车,而是为了让司机更规矩、出了事故有依据。LogAct给AI智能体装的不是枷锁,而是让它们能真正走进现实世界的通行证。未来的AI生态,一定是聪明和可控并存的生态——毕竟,没人会把一辆没刹车的车开上高速。