对抗知识焦虑,从看懂这条开始

App 下载

AI正在悄悄抹平我们的说话和思考差异

AI写作助手|语言风格标准化|Trends in Cognitive Sciences|南加州大学|认知决策|大语言模型|心理认知|人工智能

当你打开聊天机器人润色刚写完的随笔,看着屏幕上跳出的流畅句子,可能还在为省下的时间沾沾自喜——但你没注意到,那篇初稿里带着你说话习惯的倒装句、藏着你独特观察的比喻,已经被悄悄替换成了所有人都在写的标准句式。

2026年3月,南加州大学的研究团队在《Trends in Cognitive Sciences》上敲下了警钟:当全球数十亿人都依赖少数几款大型语言模型(LLM,就是我们常用的AI聊天机器人),人类独有的语言风格、思考角度甚至推理方式,正在被一种无形的力量标准化。为什么本该服务于我们的工具,反而在重塑我们?

机器的偏好,正在变成我们的习惯

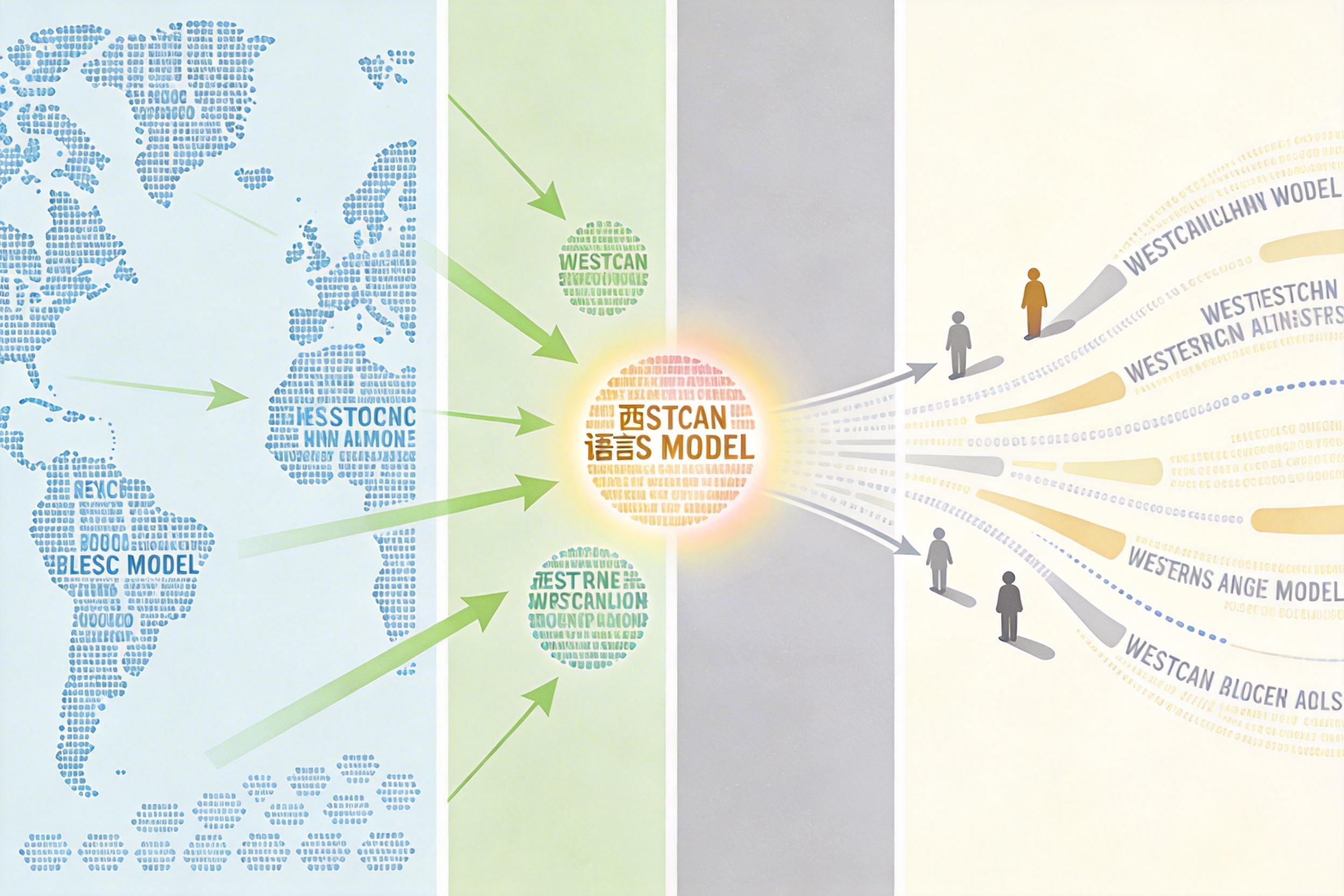

要理解这种标准化的源头,得先剥开大型语言模型的核心——它本质上是个“统计模仿大师”。你可以把它的训练过程想象成:给它投喂一座由互联网文本堆成的大山,它会在里面找出出现频率最高的词汇搭配、句式结构和观点倾向,然后用这些“主流模式”生成新内容。

但真实的机制比这更精确:LLM采用自回归生成,就是逐词预测下一个最可能出现的词,而训练数据里,西方、受教育、工业化、富裕和民主社会的内容占了绝对主导。再加上人类反馈强化学习(RLHF)的微调——标注者大多是英语背景的使用者,这让模型进一步向西方主流价值观和表达习惯倾斜。

直接的结果就是,当你用AI润色文章,它会把你的“土话”改成标准书面语;当你问它怎么思考问题,它会给你一套线性的思维链推理,一步步拆解问题——而那些跳脱的直觉、模糊的抽象思考,因为在训练数据里不够“主流”,被悄悄过滤了。

从个人风格到集体智慧的坍缩

这种标准化的影响,远不止于文字。

个体层面,当你习惯了AI给的“标准答案”,会慢慢失去对自己表达的掌控——华盛顿大学的研究显示,重度依赖AI的用户,写作里的人称代词会减少50%,那些带着个人温度的细节会被抹平,甚至对自己作品的“拥有感”都会降低。更隐蔽的是,AI正在重新定义“可信的言论”:当所有人都用类似的句式表达观点,那些不符合AI风格的表达,会慢慢被认为是“不专业”“不合理”的。

到了群体层面,认知多样性的流失才是真正的隐忧。人类社会的创造力和解决复杂问题的能力,恰恰来自于不同视角的碰撞——有人擅长线性推理,有人靠直觉找方向,有人习惯从微观细节切入,有人总盯着宏观框架。但当数十亿人都用同一套LLM的逻辑思考,这些差异会被磨平,群体的创意数量和多样性反而会下降——研究发现,群体用AI生成的想法,比单纯人类协作的结果更少、更同质化。

更可怕的是“从众效应”的蔓延:就算你不用AI,当身边的人都开始说AI式的语言、用AI式的逻辑,你会不自觉地向这种“主流”靠拢,避免自己显得格格不入。

不是对抗AI,而是给它“补短板”

当然,这不是要我们把AI扔进垃圾桶——问题的核心,从来不是AI本身,而是它的“单一化基因”。

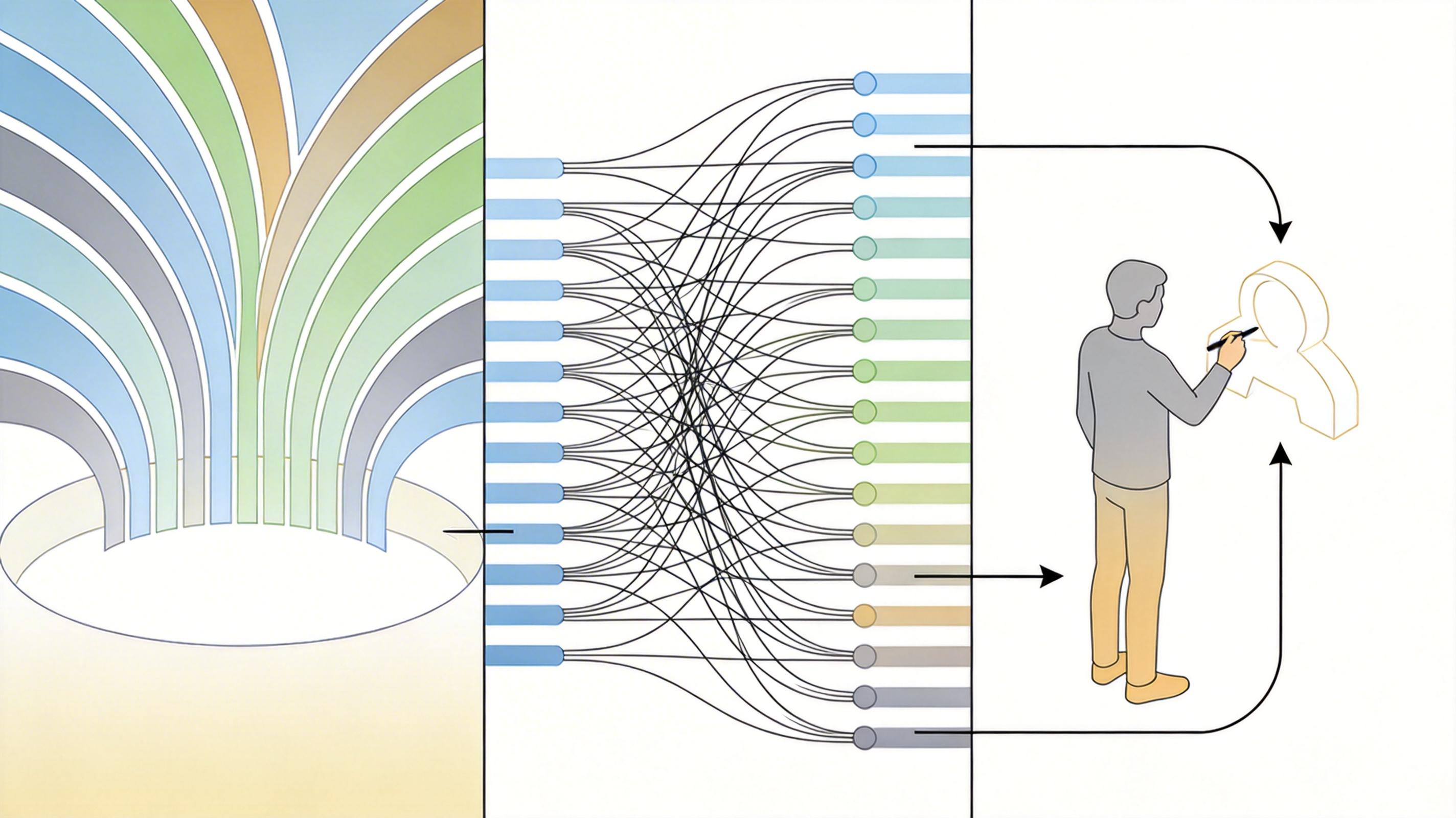

研究者已经找到一些破局的方向:比如在训练数据里加入更多真实的多元文化内容,不是简单翻译西方文本,而是直接采集不同语言、不同文化背景的原生内容——像非洲的Masakhane initiative,就联合30个国家的开发者,收集非洲语言的语音和文本数据;比如用多样化的角色提示和链式思维提示,让AI跳出单一的推理模式,模拟不同视角的思考;还有,在人机交互中设计“延迟介入”,让用户先完成自由创作,再用AI辅助润色,而不是一开始就依赖AI的框架。

更重要的是用户层面的觉醒:把AI当成启发工具,而不是权威答案。比如你用AI生成了一个思路,别急着接受,试着把它往你独特的思考方向上掰一掰;看到AI给出的“标准表达”,多问一句:这真的是我想说的吗?

毕竟,保护认知多样性的本质,是保护人类自身的可能性——那些看起来“不标准”的表达、“不合理”的思考,恰恰是未来创新的种子。

想象一下,如果未来的所有人,说话都用着同样的句式,思考都遵循着同样的逻辑,那世界会变成什么样子?可能会更“高效”,但也会失去那些突如其来的灵感、那些跨文化碰撞的火花、那些属于每个个体的独特光芒。

认知多样性,从来不是“冗余”的存在,而是人类社会的“弹性储备”——当复杂危机来临时,正是这些不同的视角,能帮我们找到破局的钥匙。

让AI服务多样性,而非反过来。这不是技术问题,而是我们每个使用AI的人,都该守住的底线。毕竟,我们需要的不是一个标准化的世界,而是一个因为不同而更精彩的世界。