1 个月前

1 个月前

当你说「帮我设计一个能放下双开门冰箱的厨房」,过去的AI只会给你罗列设计要点,现在的AI会自己打开设计软件,扒完上百张厨房案例图,改三版方案后把渲染图甩给你——全程不用你碰一下鼠标。2026年春天,这个场景已经不是科幻:英伟达CEO黄仁勋在GTC大会上断言,一款叫OpenClaw的开源平台,会是「下一个ChatGPT」。它的核心不是回答问题,而是让AI自己制定计划、解决问题、完成任务。这背后,是AI从「对话工具」到「自主智能体」的关键一跃。

你可以把传统聊天AI想象成一个只会查资料的实习生——问什么答什么,不会主动推进任何事。而OpenClaw的智能体更像一个能独当一面的员工:你只需要说「帮我搞定厨房设计」,它会自己拆解任务:先学AutoCAD操作,再研究户型图的空间限制,对比10种冰箱的尺寸参数,甚至会反思「刚才的方案动线太绕」,然后自动迭代出新版。

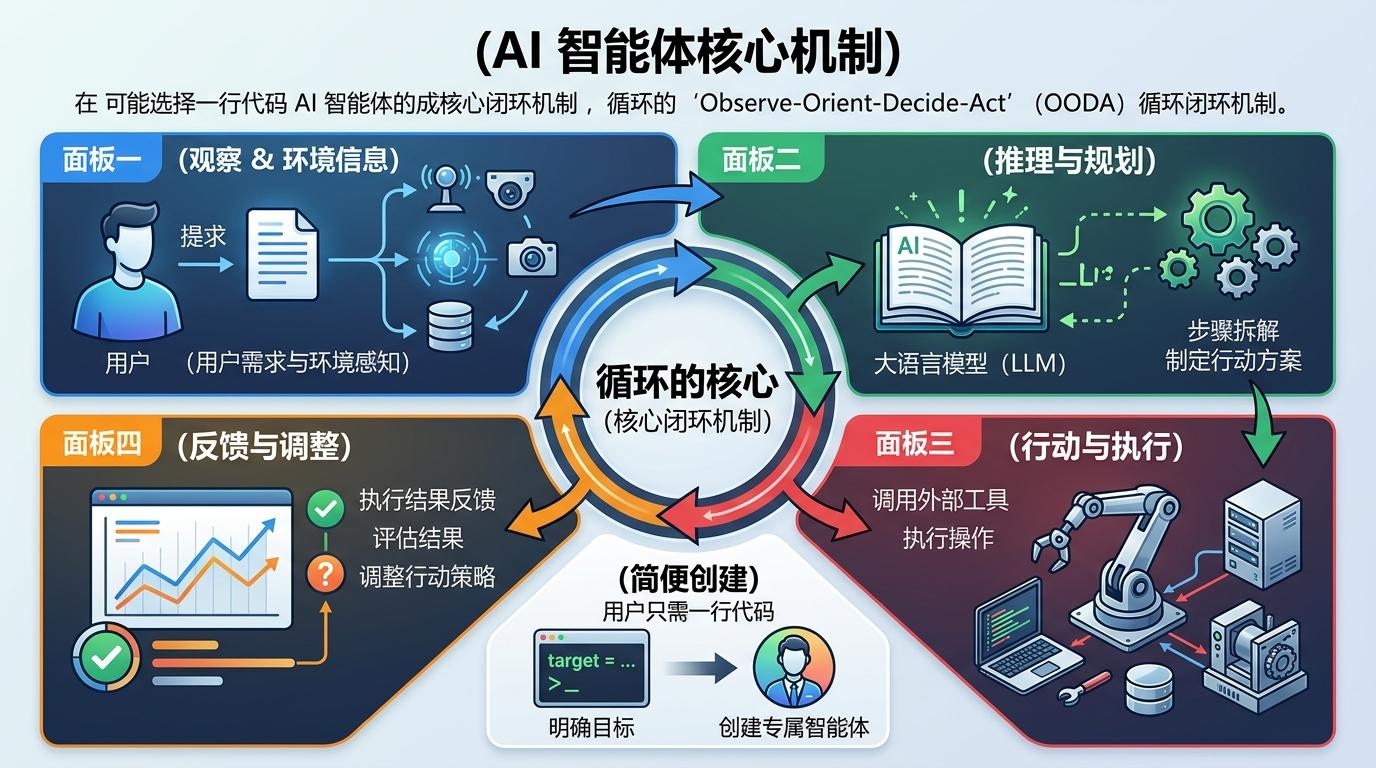

这一切的核心,是一套「观察-推理-行动-反馈」的闭环机制:智能体先读取你的需求和环境信息,用大语言模型拆解出执行步骤,调用工具完成操作,再根据结果调整策略。用户甚至只需要一行代码,就能创建专属智能体——不需要懂复杂的算法,只需要明确「要它做什么」。

更关键的是,它能跨平台联动:处理邮件、整理数据、启动程序、调用API,这些过去需要人在不同软件间切换完成的事,现在一个智能体就能搞定。

但自主能力越强,风险就越大。如果一个智能体能随便调用系统权限、读取文件,那么一句恶意的提示词注入,就可能让它偷偷把公司机密打包发送;一个被投毒的插件,能让它在执行任务时埋下后门。

字节跳动发布的安全规范里,点出了OpenClaw类工具的五大风险:访问控制不当、提示词注入、敏感信息窃取、供应链漏洞、恶意插件投毒。对应的防护逻辑,本质是给「自主的AI」套上缰绳:比如企业版的智能体只能访问授权范围内的文件,不可逆操作必须经过人工确认,所有操作都留下不可篡改的审计日志。

英伟达推出的企业级版本,更是在开源平台基础上加了多层隔离:智能体运行在沙箱环境里,不能直接接触核心系统;调用工具必须经过权限校验,就像员工报销要走审批流程。毕竟,让AI当「员工」的前提是,它不会「监守自盗」。

有人担心,AI智能体会不会抢走人类的工作?但从目前的应用看,它更像一个「超级助手」:设计师不用花3天查案例,能把精力放在创意构思上;程序员不用重复写测试代码,专注于核心功能开发;销售不用手动整理客户资料,把时间花在沟通上。

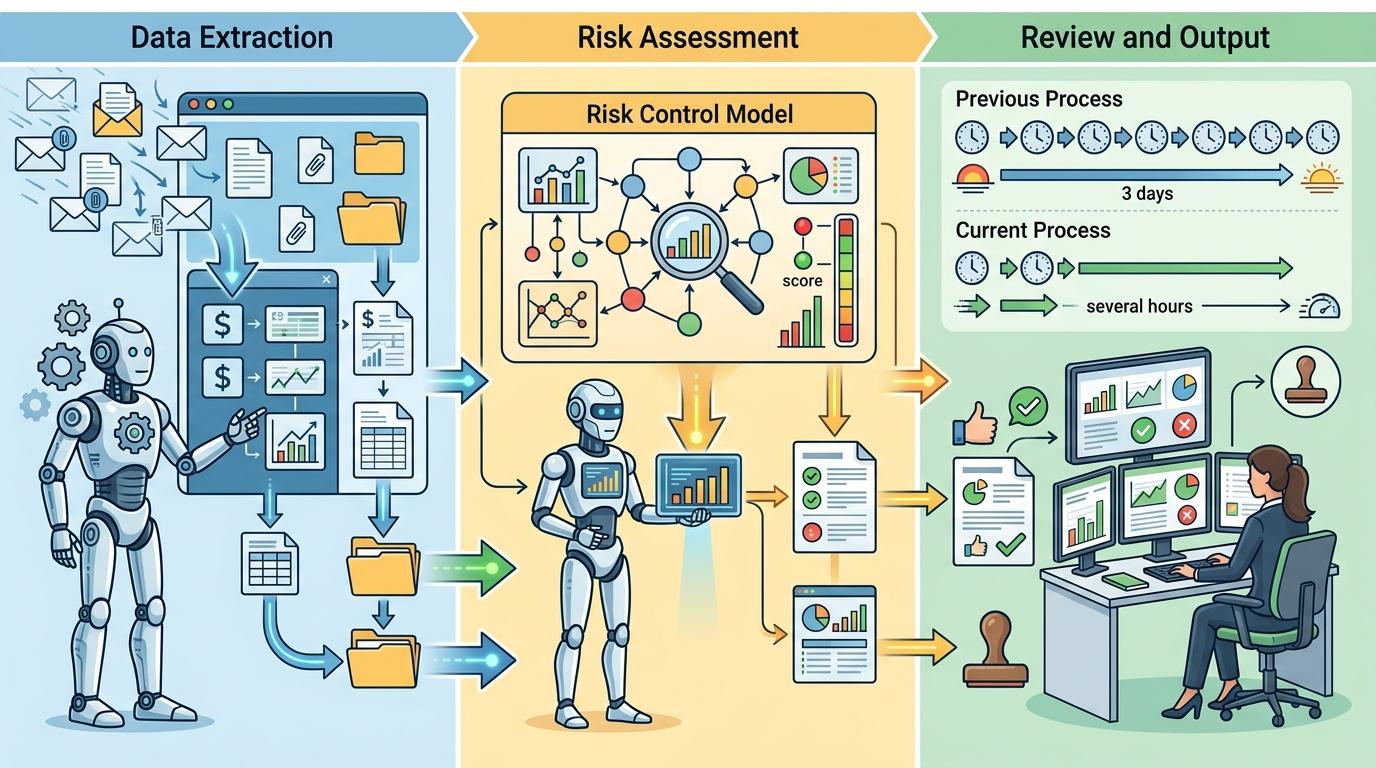

在企业场景里,智能体已经能协作完成复杂任务:比如贷款审批,一个智能体负责从邮件里提取财务数据,另一个负责对比风控模型,最后把结果汇总给人工审核员——原来需要3天的流程,现在几小时就能完成。

但它也有局限:目前的智能体还只能处理规则相对明确的任务,面对需要情感判断、伦理决策的场景,依然离不开人类的介入。比如给客户写一封安抚邮件,AI能生成草稿,但真正能打动客户的共情,还是得靠人来调整。

从1950年代的规则系统,到今天的自主智能体,AI用了70多年,终于从「会思考」走到了「会做事」。这不是一次简单的技术升级,而是人与AI关系的重构:过去我们是AI的「提问者」,现在我们成了AI的「管理者」。

未来的办公室里,可能会有一群看不见的「数字员工」,它们不用打卡,不会摸鱼,能24小时处理重复任务;而人类的工作,会越来越偏向那些需要温度、创意和判断的事。

AI不是来替代人,而是让人回到「人」的位置。

点击充电,成为大圆镜下一个视频选题!