对抗知识焦虑,从看懂这条开始

App 下载

不用相机位姿,AI给视频换光比拍电影还真

材质编辑|北京智源研究院|南京大学|视频光照重建|Relit-LiVE|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

材质编辑|北京智源研究院|南京大学|视频光照重建|Relit-LiVE|多模态视觉|人工智能

你有没有过这种遗憾:拍了一条海边散步的视频,夕阳把海面染得暖黄,但人物脸上的阴影却暗得看不清细节;或者深夜拍的美食,暖光灯把食物照得诱人,却在桌面留下了生硬的光斑。想重拍?光线早变了。用后期软件调?要么玻璃上的反射全乱了,要么人物的阴影飘得跟场景不搭。

现在,南京大学、北京智源研究院等8家机构的团队,把这个难题给解决了——他们推出的Relit-LiVE,不用知道相机每一秒的位置和角度,就能给视频换出物理逻辑自洽、帧间丝滑连贯的新光照。玻璃的折射、金属的反光、人物发丝的阴影,全都能精准匹配新光源。更关键的是,它不止能换光,还能直接在视频里改材质、插物体,连阴影都能自动生成。

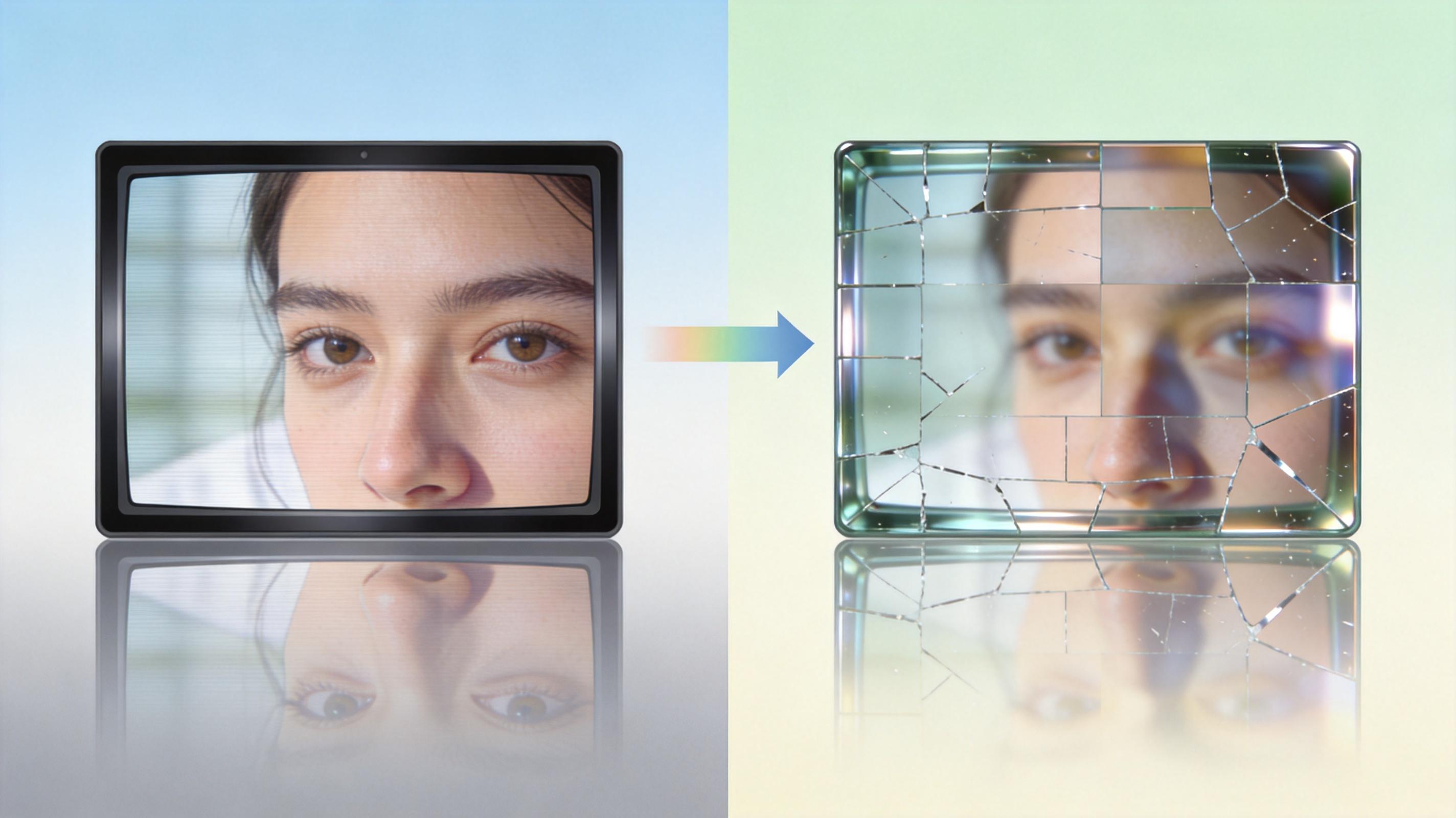

传统视频重光照的思路,一直是「先拆再装」:先把视频分解成物体的材质、形状、深度这些固有属性,再用新的光照参数重新渲染。听起来逻辑完美,现实却一碰就碎——真实世界里的透明玻璃、金属反光、皮肤的次表面散射,根本没法被精准分解,一旦分解出错,再渲染出来的画面要么像打了马赛克,要么阴影和反射全是错位的。

Relit-LiVE的第一个聪明之处,就是给模型递了张「RGB小抄」:它不执着于把视频拆得干干净净,而是从原视频里随机抽一帧原始RGB图像,和分解出来的固有属性一起喂给模型。这张「小抄」就像带着所有细节的参考答案,哪怕分解出来的材质有误差,模型也能从原始RGB里找回玻璃折射的弧度、金属高光的位置。

为了不让模型偷懒直接抄原光照,它还做了两个设计:一是每一步去噪都随机换一张「小抄」,逼模型学习本质的材质规律;二是把属性相似的固有参数分组相加——比如把金属度和粗糙度、深度和法线分别合并,既减少了计算量,又让模型能更快抓住关键特征。

传统重光照的另一个死穴,是必须知道相机每一秒的位置和角度——不然新的环境光照根本没法和场景的几何结构对齐,换出来的光要么照在空气里,要么阴影方向完全不对。但真实拍摄的视频里,想精准算出相机位姿,要么得用专业设备,要么得花大量时间后期处理,普通创作者根本碰不起。

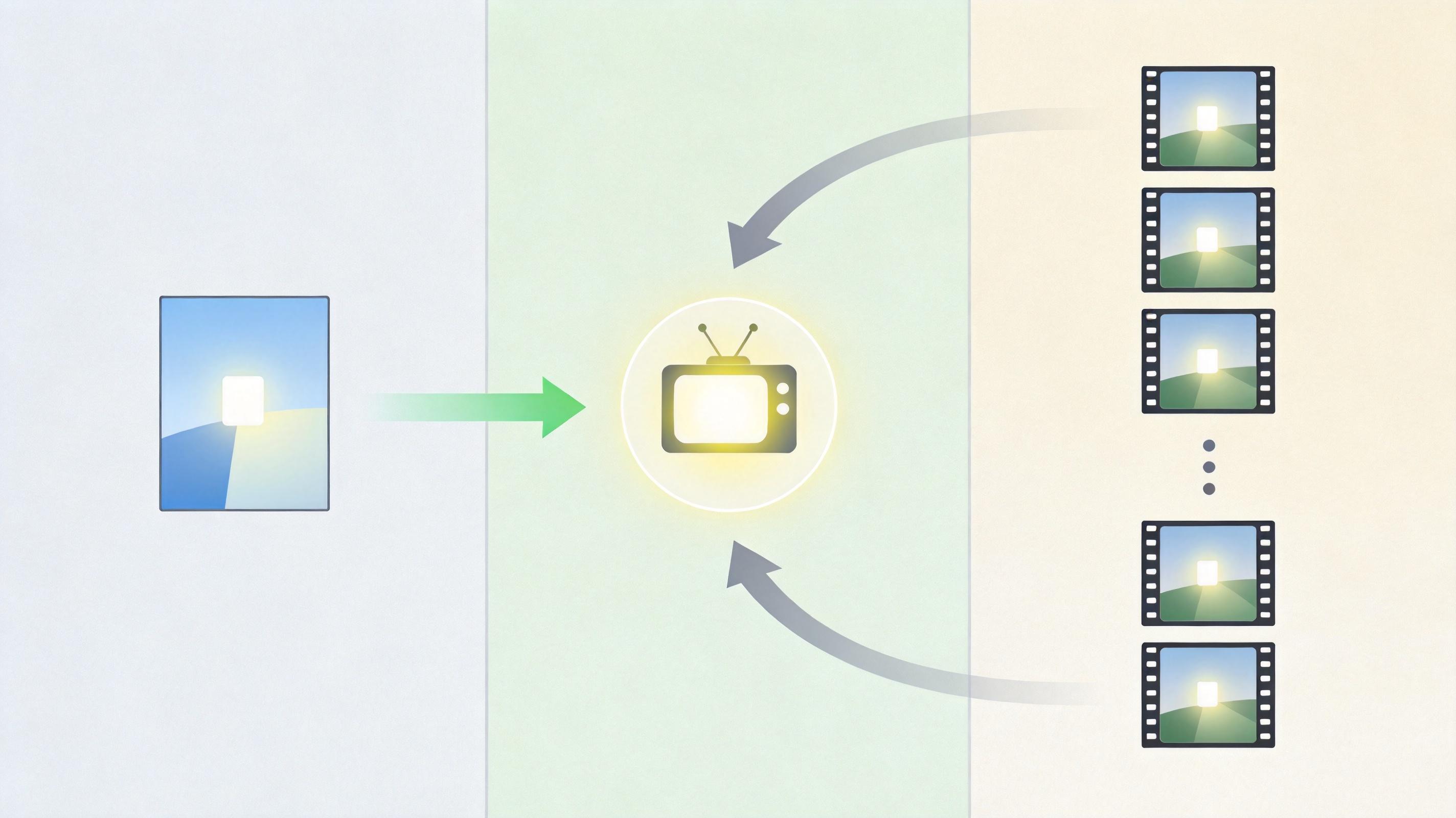

Relit-LiVE的第二个神来之笔,是把「光照对齐」变成了模型自己要解决的问题。它不再要求输入每帧的相机位姿,而是只给第一帧的环境光照图,然后让模型在生成重光照视频的同时,自动输出每帧对应的「环境视频」——也就是当前相机视角下,环境光应该呈现的样子。

相当于模型一边给视频换光,一边自己在脑子里模拟:当相机移动到这个位置时,头顶的光源应该从哪个角度照下来,墙面的反光应该是什么形状。这种「隐式对齐」不仅绕开了相机位姿的难题,还让光照和场景的匹配度更高——实验里它预测的环境光照,和真实参考的角度误差比之前的方法小了近30%,而且帧间的光照变化完全没有闪烁。

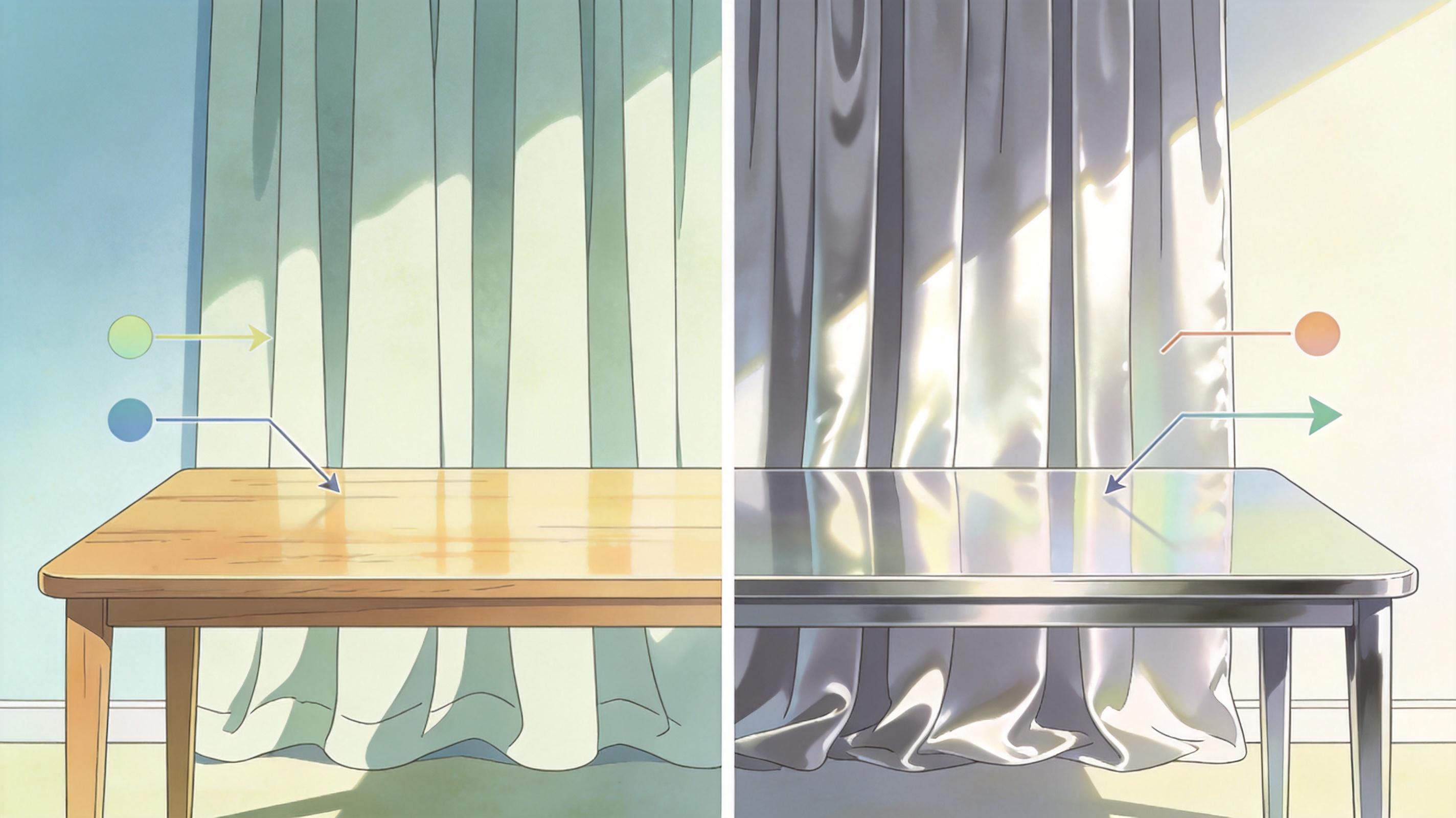

Relit-LiVE的潜力远不止换光。因为它本质上是在理解场景的材质和光照逻辑,只要修改中间的条件,就能衍生出一堆实用功能:

比如场景编辑:把视频里的窗帘从布纹改成丝绸,模型会自动调整它的反光和褶皱阴影;把桌面的木质改成金属,新的高光和反射会和环境光完全匹配。

再比如物体插入:往视频里放一只小狗,模型会根据当前的光照方向,自动在地板上生成对应的阴影,甚至小狗毛发上的高光也会和场景里的光源一致。

还有去光照:把视频里的高光全部去掉,还原物体本来的颜色,这对3D重建、深度估计这些下游任务来说,相当于提供了干净的「素材底版」。

更贴心的是,它支持长视频的分片流式处理——把几小时的长视频切成小段,每段的环境光照会自动衔接,不会出现前半段是下午光、后半段突然变成傍晚的断层。

当我们还在为「怎么把视频拍得更亮」「怎么调阴影更自然」头疼时,Relit-LiVE已经把「光照」从拍摄的限制,变成了创作的工具。它不用昂贵的专业设备,不用复杂的后期技巧,只要你有一段视频,就能随心所欲地给它换个太阳、加盏暖灯,甚至模拟出霓虹灯闪烁的街头。

更值得关注的是,它代表了AI视觉的一个新方向:不再执着于「精准还原物理世界」,而是学会用「参考+学习」的方式,绕开那些暂时解决不了的难题。技术的终极目标,从来不是完美,而是好用。 或许用不了多久,我们拍视频时再也不用等光、追光,因为光,随时可以被创造。