对抗知识焦虑,从看懂这条开始

App 下载

长序列3D重建不再崩,公里级实时建模成真

长序列流式重建|实时3D地图|LongStream|地平线团队|香港科技大学(广州)|多模态视觉|人工智能

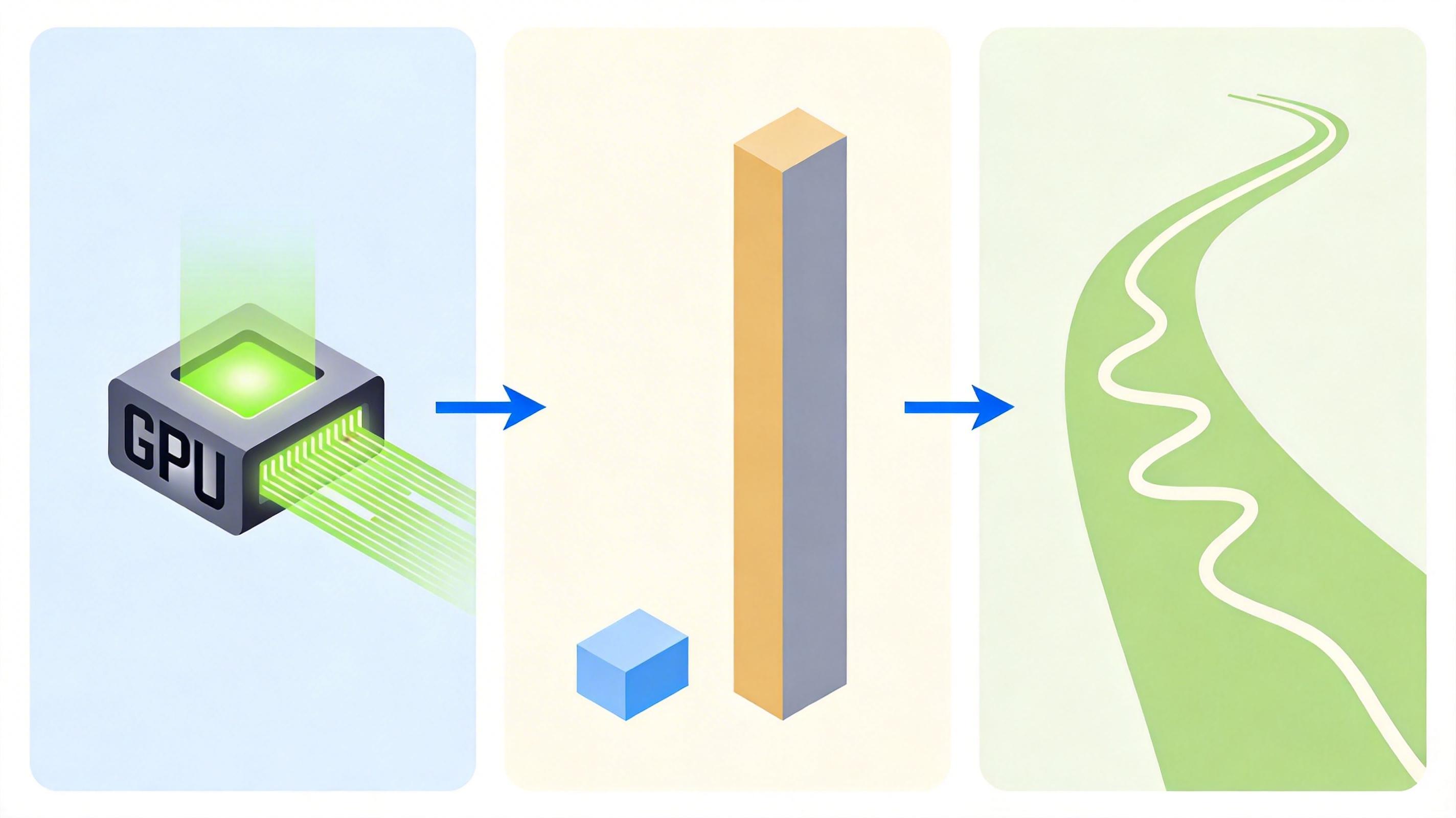

想象你坐在自动驾驶的车里,车窗外的街景正以每秒18帧的速度被转换成精准的3D地图——不是开完一段路再事后拼接,是车走一米,地图就实时更新一米,哪怕开出去十几公里,地图的尺度、精度也纹丝不乱。这不是科幻片里的设定,而是香港科技大学(广州)与地平线团队带来的LongStream实现的突破。此前,长序列流式3D重建就像个走不远的旅行者,走得越远,脚步越飘,甚至直接‘迷路崩溃’。现在,这个困局被彻底打破了。

走不远的3D重建:老方法的死穴

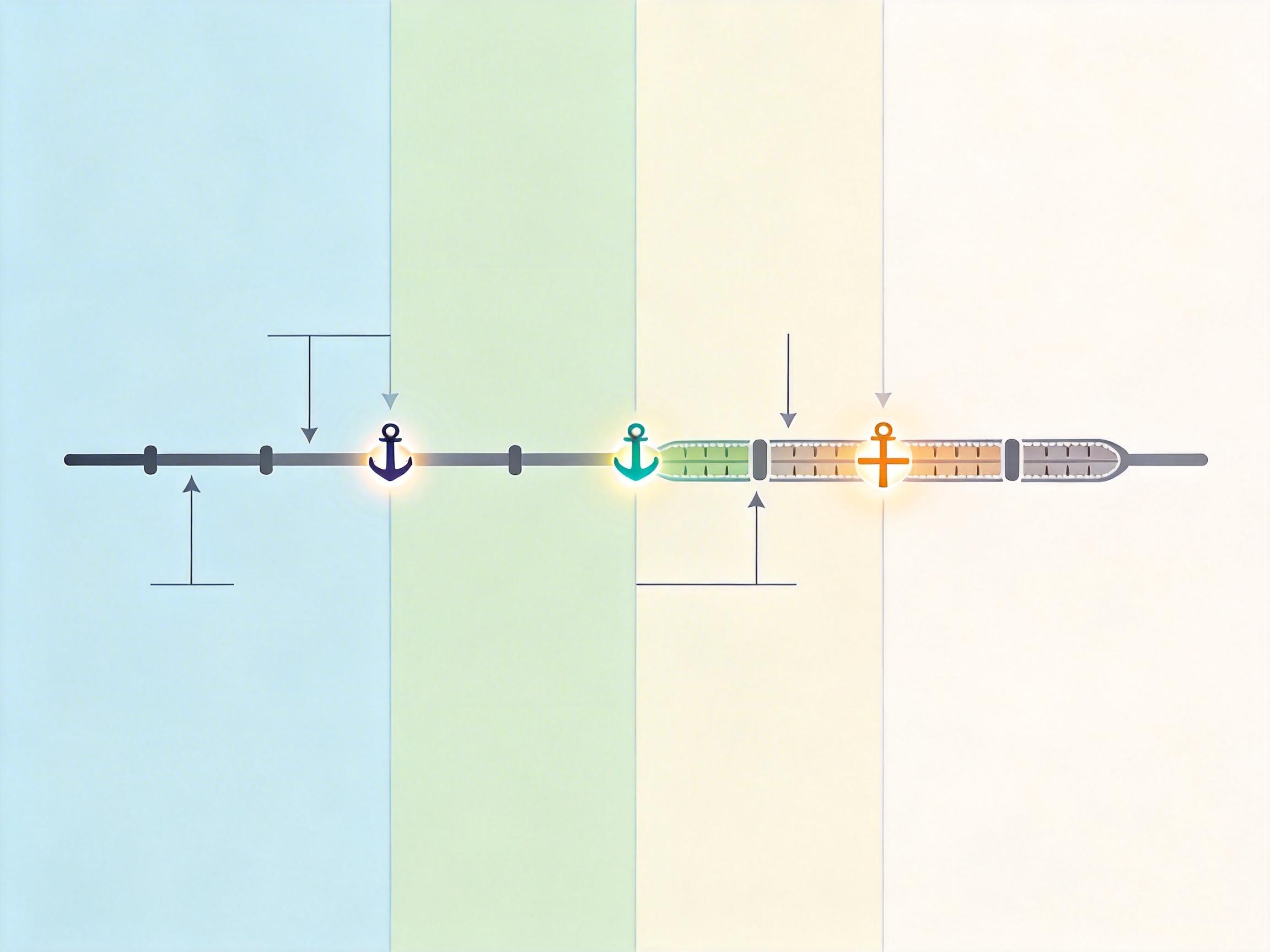

你可以把传统长序列3D重建想象成用一根线串珠子——第一颗珠子是固定死的‘锚点’,后面所有珠子的位置都要以它为参照。这就带来了三个致命问题:

第一,第一帧锚定陷阱。训练时模型只学过短距离串珠子,真上路要串几公里长的串,每一颗珠子的位置误差都会被放大,最后整个串直接歪掉。就像你用第一步的脚印当基准,走一万步后,实际路线和你以为的路线早就差出一条街。

第二,注意力‘死盯首帧’。模型的注意力会像粘在第一帧上一样,不管眼前的街景怎么变,都一个劲盯着出发时的画面,完全忽略了身边更重要的局部细节——这就像你走路时一直盯着鞋尖,反而看不见前方的障碍。

第三,缓存越存越乱。模型会把走过的每帧画面都存在缓存里,存得越多,旧信息的干扰越严重,最后缓存里全是‘过期垃圾’,直接导致内存溢出,系统原地罢工。

这些问题不是某一个算法的bug,而是整个传统范式的先天缺陷——它们从设计之初就没考虑过‘真的要连续跑几百公里’。

LongStream:把长线拆成小段走

LongStream的解法说穿了就是三个字:换范式。它彻底抛弃了‘第一帧锚定’的思路,把一条几公里的长线拆成了无数个短区间,每个区间都以最近的‘关键帧’为基准,相当于走几步就重新找一个靠谱的参照点。

三个核心补丁,补上老方法的窟窿

第一个补丁是**关键帧相对位姿**。不再让所有帧都盯着第一帧,而是每帧只需要和自己附近的关键帧比对位置。这就像你走路时,不用一直盯着出发时的路灯,只需要盯着前面50米的电线杆,每走过一根电线杆,就换一根新的参照,误差被牢牢锁在每个小段里,不会越积越大。

第二个补丁是**缓存一致训练**。以前训练时模型不用管缓存怎么存,真到推理时缓存乱成一锅粥。现在训练时就模拟真实推理的缓存状态,让模型从一开始就学会‘只留有用的信息’,彻底解决了注意力死盯首帧的问题——就像你提前练过怎么整理背包,不会把没用的旧东西一直背着。

第三个补丁是周期性缓存刷新。每隔一段时间就把缓存里的旧信息清掉,只保留最近的关键帧数据。这就像你定期整理手机相册,删掉半年前的旧照片,既能省空间,又不会让新照片被旧信息淹没。而且因为每个关键帧都是独立的基准,清缓存不会影响已经建好的地图。

直给的技术效果

这些改动带来的结果是硬邦邦的:单卡GPU上实现18 FPS实时推理,支持上千帧、公里级的长序列重建,绝对轨迹误差比传统方法低近两个数量级,而且内存占用不会随序列长度爆炸式增长——终于不会走着走着就‘内存溢出’了。

从‘离线拼图’到‘在线建世界’

LongStream的意义不止是把3D重建的‘续航里程’从几百米拉长到几公里,更重要的是它重新定义了3D重建的目标:不再是‘事后把一张风景照拼成3D模型’,而是‘像人一样,边看边在脑子里构建并更新世界地图’。

这意味着自动驾驶汽车可以不用依赖预先建好的高精度地图,开去任何地方都能实时建图导航;AR眼镜可以连续几小时稳定追踪空间,不会戴半小时就‘飘得找不到北’;机器人可以在工厂里连续工作一整天,随时更新周围的环境信息,不会因为货架上的货物被挪动就迷路。

当然,它也不是完美的。目前它还只能处理静态场景,遇到路上突然窜出来的行人、变道的车辆这类动态目标,还需要和其他动态感知技术结合。但它已经解决了长序列流式3D重建最核心的‘生存问题’——终于能稳定地‘走下去’了。

当AI开始像人一样‘边走边记’,我们离真正的‘具身智能’就又近了一步。以前的3D重建是给世界拍一张静态的3D照片,而LongStream是给世界写一份连续的3D日记——每一秒的新画面,都在为这个动态的、鲜活的世界模型添砖加瓦。

建图不止于拼图,感知要学会成长。未来的智能系统,不会再是只会处理固定任务的工具,而是会像人一样,在与世界的持续交互中,不断更新对世界的理解。LongStream迈出的这一步,正是这个未来的起点。