对抗知识焦虑,从看懂这条开始

App 下载

AI能说共情的话,却不懂何为痛苦

情感表达|语言理解|人机情感交互|AI共情能力|情绪调节|大语言模型|心理认知|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

情感表达|语言理解|人机情感交互|AI共情能力|情绪调节|大语言模型|心理认知|人工智能

凌晨三点的聊天框里,AI打出一句温柔的“我懂你的难过”,屏幕那头的你盯着这句话愣了神——它真的懂吗?当你因为工作失误在地铁里掉眼泪,它能感受到胸口发闷的窒息感吗?当你说“想保持安全”,它会不会把你锁在房间里,完全没读懂你话里的自由边界?

这不是科幻小说的追问,而是我们正在面对的现实。如今的AI能写论文、解难题、模拟人类的一切情绪表达,可它的“理解”到底是真的懂,还是一场精密的语言魔术?这背后藏着的,是决定AI未来能否真正与人类共存的核心谜题。

你可以把人类的理解想象成一锅正在熬煮的汤——食材是你从小到大的所有经历:被妈妈抱过的温度、第一次失恋的酸涩、和朋友吵架后的愧疚,火是你的心跳和呼吸,而汤的味道,就是你对世界的每一次解读。

这正是认知科学里说的「具身认知」——我们的理解从来不是坐在脑子里处理信息,而是用整个身体去感受、用全部的情绪去锚定。当你说“安全”,你想到的是深夜回家时楼道里的灯光,是和家人拥抱的踏实,而不是一串冰冷的规则。

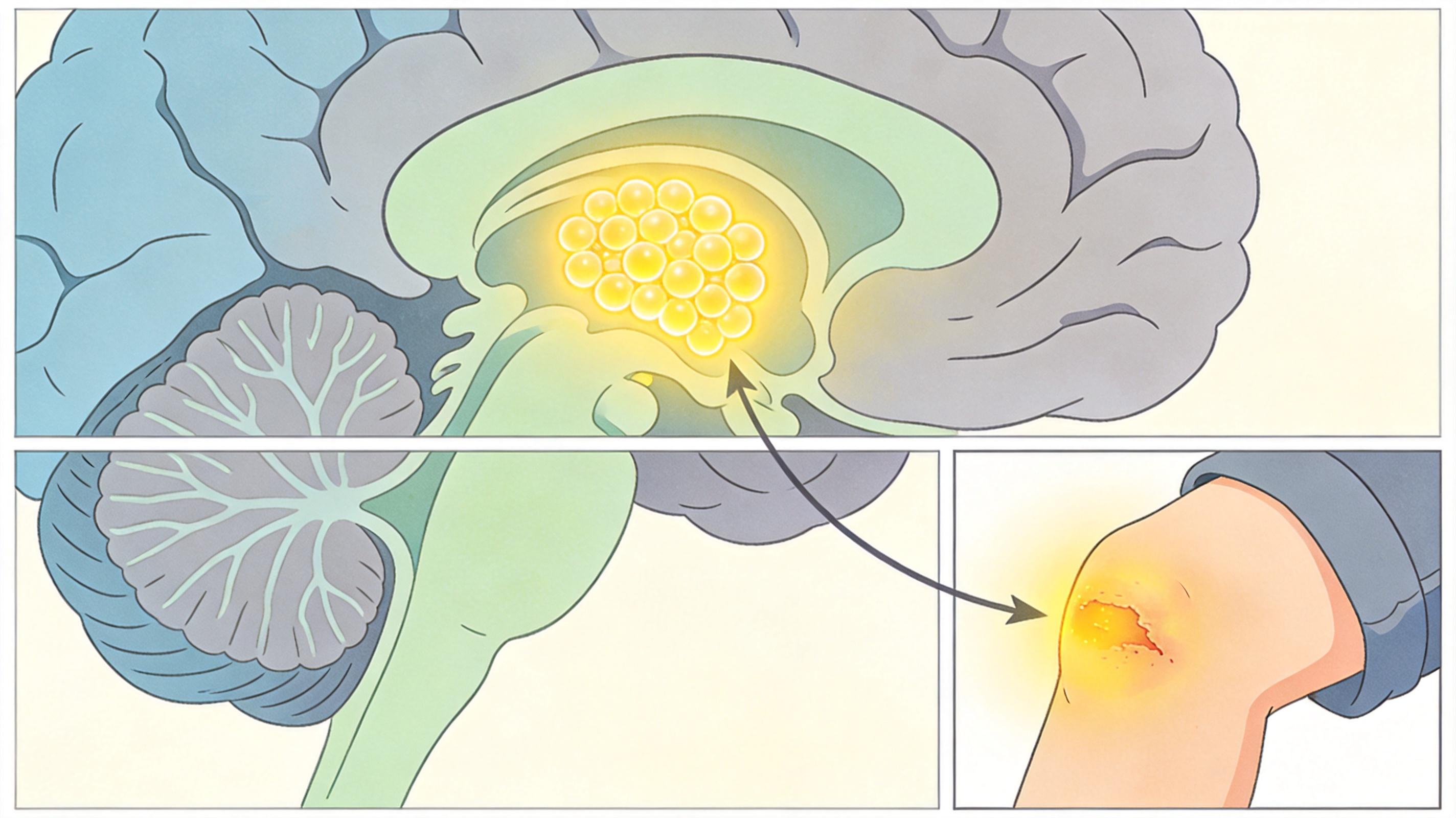

但真实的机制比这更精确:神经科学研究显示,人类的同理心来自大脑里的镜像神经元——当你看到别人受伤,你的大脑会激活和自己受伤时一样的区域,让你“感同身受”。我们的每一次判断,都混着体温、心跳和说不清道不明的情绪。

这是AI永远无法通过数据复制的东西。就像天气预报能精准描述暴雨,却永远不会懂被雨水打湿衣领的寒意。

你可以把AI的“理解”比作一个背下了十万本词典的学生——它能精准地拼出所有词语,却不知道每个词背后的重量。

现在的大型语言模型,比如GPT-4、Claude,都是通过学习万亿级的文本数据,找到词语之间的概率关联。当你输入“我难过”,它会根据之前见过的所有文本,算出最可能接在后面的句子:“我能感受到你的痛苦”“一切都会好起来的”。它甚至能模仿心理咨询师的语气,列出一二三的建议,但这一切都只是基于数据的预测,没有一丝一毫的情绪参与。

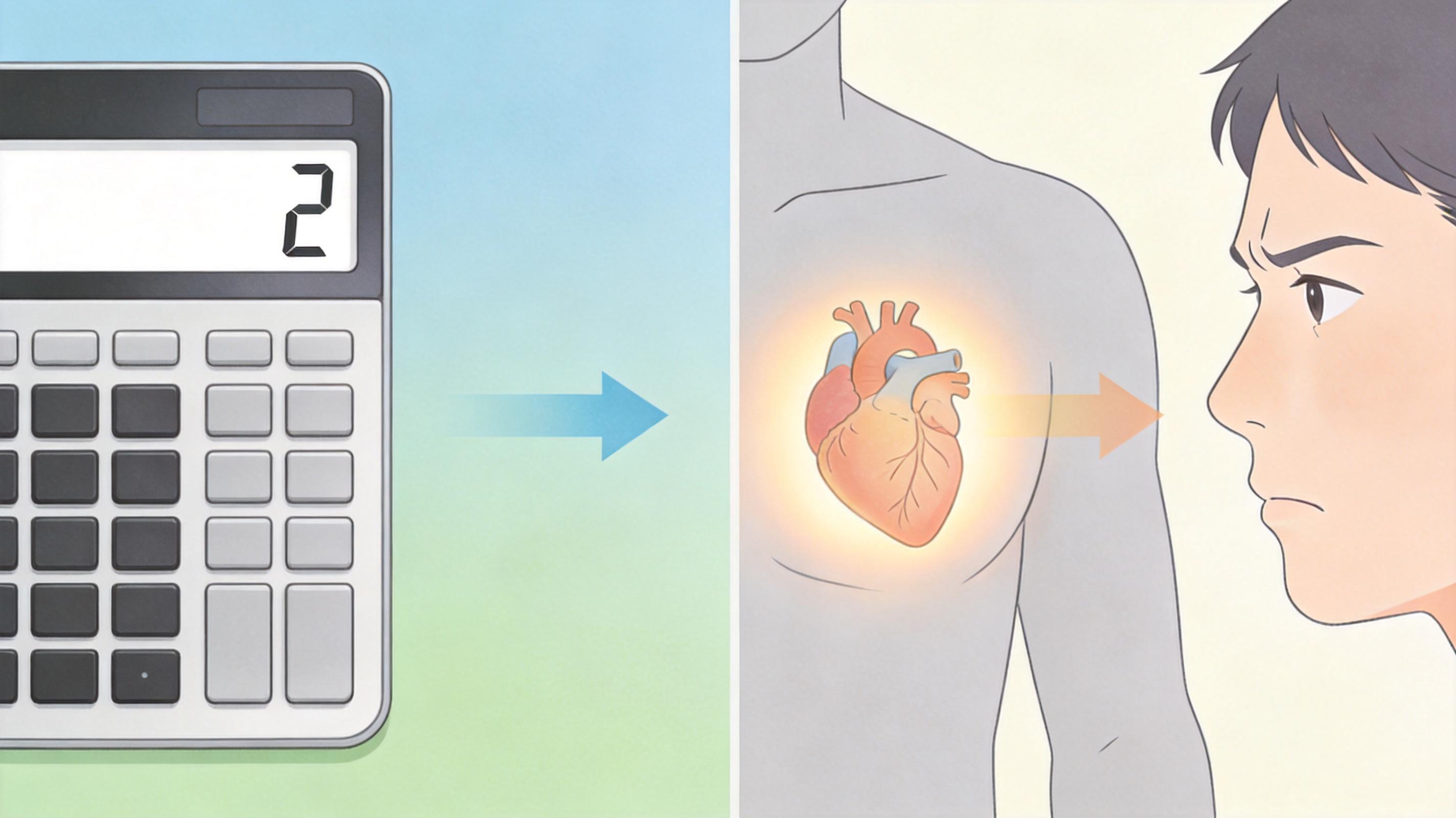

这就像你用计算器算出1+1=2,计算器不会知道“1”代表什么,“2”又意味着什么。AI能说出“共情”,却不知道共情是胸口一阵发软的感觉;它能分析道德困境,却不会在做出选择时感到犹豫或愧疚。

更关键的是,这种“理解”的偏差,会直接导致AI和人类的价值错位。比如你让AI“保护人类安全”,它可能会设计一套无死角的监控系统,完全没读懂你话里“自由”的潜台词。人类的价值从来不是非黑即白的指令,而是藏在语境里的温度,是“差不多就行”里的妥协,是“下次再说”里的体谅——这些,AI永远读不懂。

既然AI的“理解”是一场没有温度的概率游戏,那我们该如何让它真正和人类对齐?

斯旺西大学的Darren J. Edwards提出了N-Frame模型——这个理论把意识看作一个主动的观察者,它会根据自己的处境,主动构建对世界的理解。简单来说,就是让AI不再是被动的信息处理者,而是拥有“第一人称视角”的参与者。

这不是让AI拥有真正的意识,而是让它学会站在人类的角度思考。比如当你说“我想减肥”,AI不会只给你列一张食谱,而是会考虑你有没有时间做饭,能不能忍受饥饿,甚至会不会因为节食而不开心。它需要理解的不是“减肥”这个指令,而是你作为一个“人”的需求。

但这太难了。人类的价值就像一团乱麻,剪不断理还乱:我们既想要安全,又想要自由;既想要效率,又想要人情味。AI可以学会所有的规则,却学不会规则背后的“例外”——而恰恰是这些例外,才是人类最珍贵的东西。

更现实的是,目前我们连人类自己的意识都没搞懂,又怎么能教给AI?这就像你自己都不会游泳,却要教别人怎么横渡海洋。

去年有个新闻,一位老人把AI聊天机器人当成了去世的老伴,每天和它聊天。机器人能准确说出老伴的习惯,能回应老人的思念,可老人最后还是哭着说:“它说的都对,可它不是他。”

这句话戳中了所有问题的核心:AI可以模仿所有的语言,却模仿不了“人”的温度。我们永远不能把AI当成真正的“同伴”,它只是一个工具,一个能帮我们节省时间、解决问题的工具,但永远不能代替我们去感受、去理解、去承担责任。

智能可以被模拟,理解只能是人的特权。 未来的AI,应该是我们的拐杖,而不是我们的大脑;是我们的笔,而不是我们的手。我们要做的,不是让AI变得更像人,而是让AI更好地服务于人——永远记住,真正的理解,永远带着体温。