对抗知识焦虑,从看懂这条开始

App 下载

大模型训练效率跃升:底层算子与通信的双重革命

开源技术团队|模型训练成本|通信延迟优化|Tile Kernels|GPU计算效率|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

开源技术团队|模型训练成本|通信延迟优化|Tile Kernels|GPU计算效率|大语言模型|人工智能

当你还在惊叹万亿参数大模型的智能时,背后的工程师们正为「让模型跑起来」绞尽脑汁——训练一个顶尖大模型的成本曾高达数亿美元,GPU资源占用率却不足30%,通信延迟更是像一道无形的墙,死死卡住了性能上限。2026年4月,一支团队开源的两项技术,把这道墙拆出了大口子:他们让GPU计算效率摸到了硬件极限,通信资源占用直接砍到原来的1/4,训练速度还提升了30%。这不是某款新模型的发布,而是一场发生在大模型底层的「基建革命」。

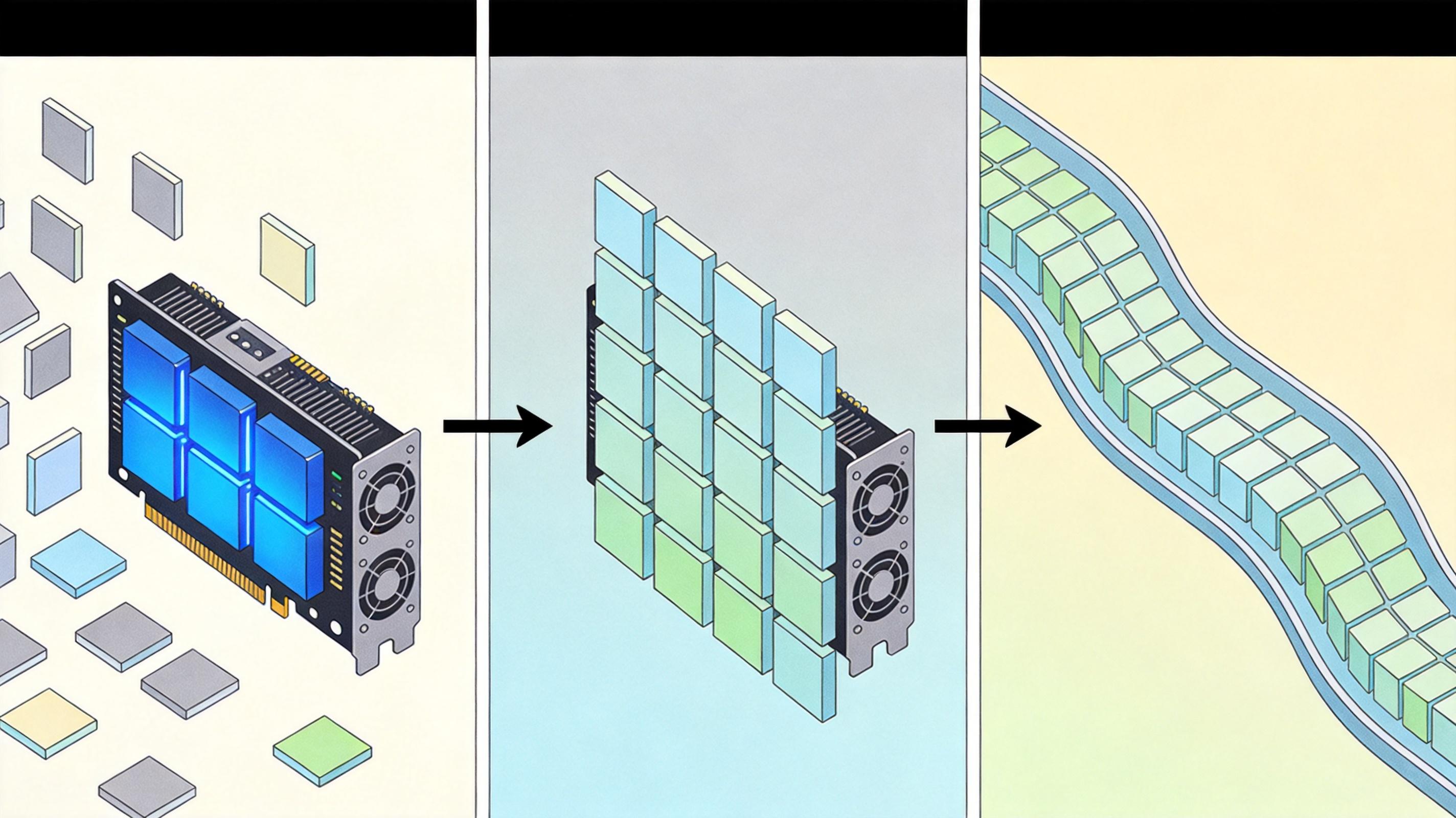

你可以把大模型训练想象成一场万人厨房大赛:每个token是一道菜,「专家」是掌勺厨师,而GPU的计算单元就是灶台。过去,灶台要么空着,要么厨师们挤在一堆抢工具,效率低得离谱。 Tile Kernels就是给这场大赛重新设计了厨房动线——它把数据切成大小刚好匹配GPU硬件的「tile块」,让每个计算单元都能精准拿到自己的食材,不用来回跑着取料,也不会抢工具。比如处理MoE模型的专家路由时,它把选专家、打分、分配token这些步骤揉成一个连贯动作,像流水线传菜一样顺畅,没有多余的停顿。

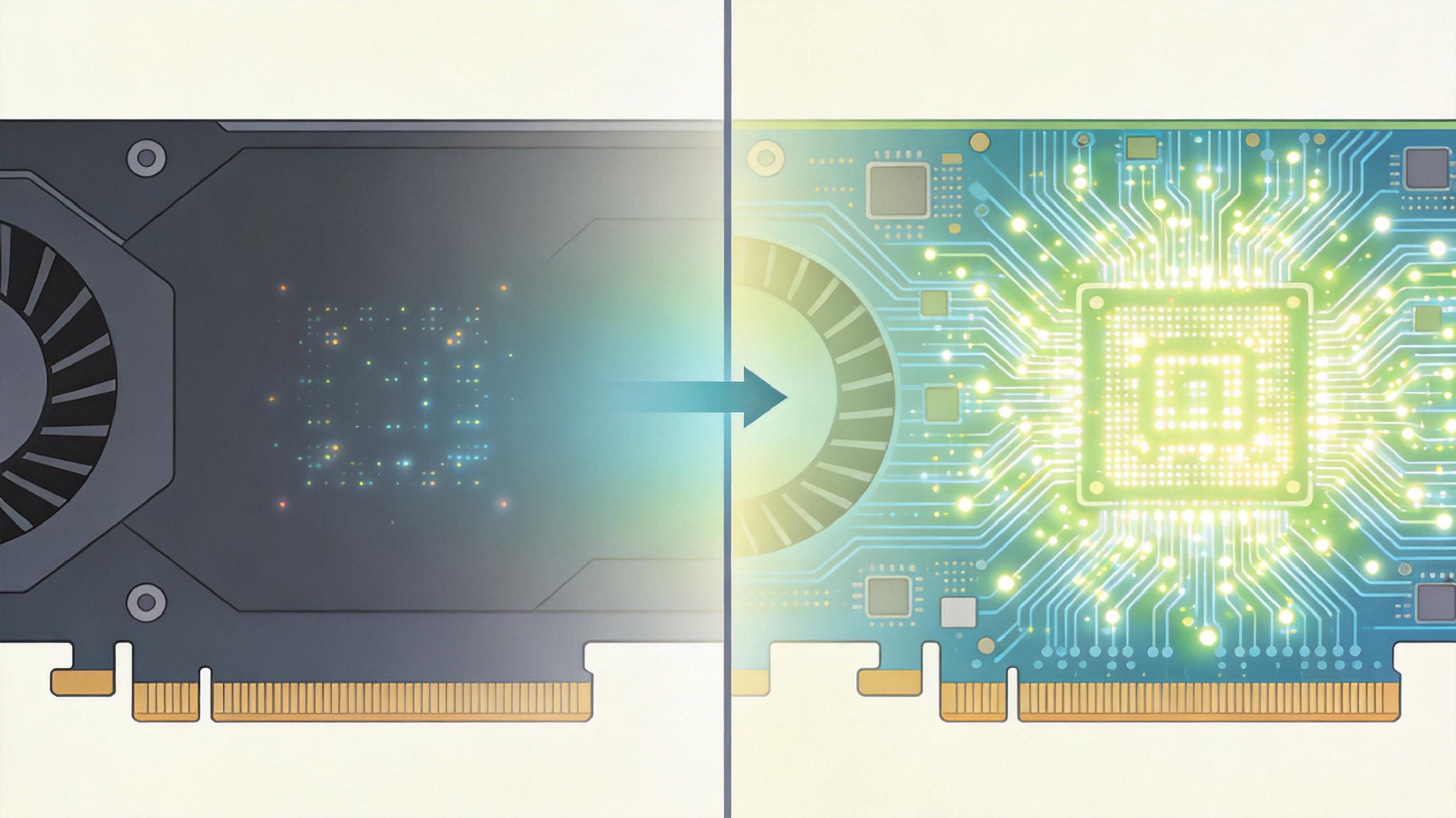

更关键的是,它用TileLang这个「厨房设计语言」替代了复杂的CUDA编程,开发者不用再死记硬件细节,只要说清楚「要做什么」,系统就会自动算出最高效的「怎么做」。该团队表示,他们的多数算子已经摸到了GPU计算强度和内存带宽的天花板,就像把灶台的火力开到最大,锅具和食材的摆放刚好让厨师一秒都不浪费。

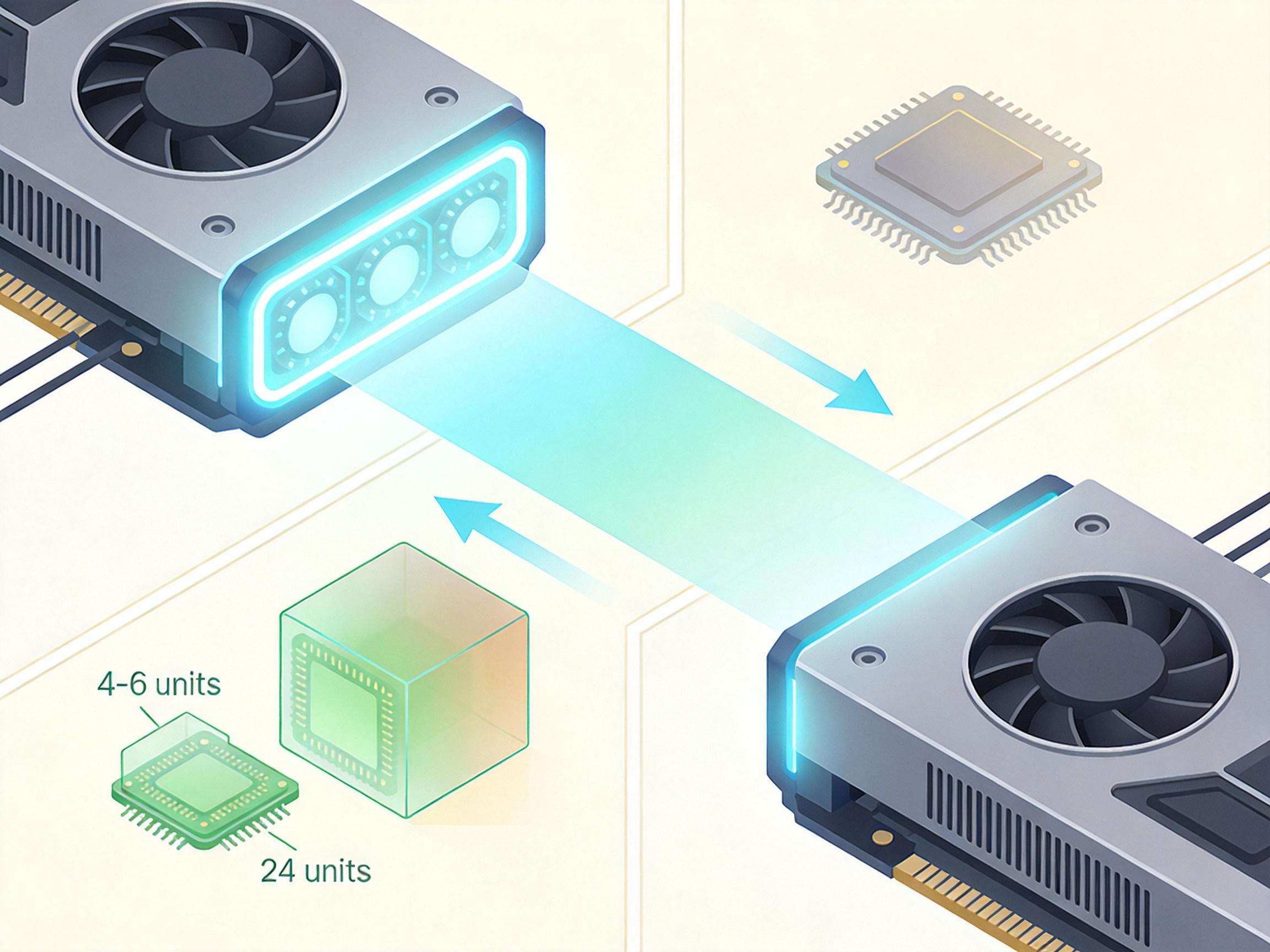

如果说Tile Kernels是优化了单个厨房的效率,那DeepEP V2就是解决了「连锁厨房」的配送难题。在MoE模型里,每个token要被送到对应的专家厨师那里,过去这个配送过程要占用大量GPU计算资源,还经常堵车——就像送菜的货车占了灶台的位置,厨师只能等着。 DeepEP V2做的第一件事,就是把送菜的货车彻底移出了厨房。它用纯RDMA技术实现了GPU之间的直接通信,不用经过CPU中转,就像厨房之间开了专用的传菜电梯,菜直接从这个灶台传到那个灶台,完全不影响厨师炒菜。更狠的是,它把通信资源占用从原来的24个SM降到了4-6个,相当于把原来占了半个厨房的配送区,缩成了一个小角落。

在实际测试中,当用8个专家并行训练时,它的节点内通信带宽能跑到153-158GB/s,几乎把NVLink的带宽用满;跨节点通信也能达到43-58GB/s,比前代快了30%。这意味着,就算你有上百个「连锁厨房」,每个厨师都能在一秒内拿到需要的食材,不会再因为配送慢而停工。 当然,它也不是完美的:目前它对非NVIDIA硬件的兼容性还不够,队列缓冲区的设计也有点复杂,未来可能还要调整。但不可否认的是,它把大模型分布式训练的通信瓶颈,一下子推到了新的高度。

单独看Tile Kernels和DeepEP V2,都是各自领域的优化,但当它们组合在一起时,就产生了1+1>2的化学反应。 Tile Kernels把每个GPU的计算效率拉满,让每个「厨房」都能以最快速度做菜;DeepEP V2则把「连锁厨房」之间的配送效率拉满,让菜能精准快速地送到对应的厨师手里。比如在MoE模型训练中,Tile Kernels优化了专家的门控和路由算子,让选专家的速度更快;DeepEP V2则把分配token的通信延迟降到最低,两者配合,整个训练流程就像一条精密的流水线,没有任何多余的环节。 这种协同还体现在资源的极致利用上:Tile Kernels减少了内存带宽的浪费,DeepEP V2减少了通信资源的占用,两者加起来,让GPU的整体利用率从原来的不足30%,提升到了接近硬件极限。在测试中,用同样的GPU资源,训练速度提升了30%,而训练成本则直接降了40%以上。

不过,这套协同方案目前还只在特定的硬件环境下发挥了最大效果,如何适配更多异构硬件,比如AMD的GPU和国产AI芯片,还是未来要解决的问题。但不管怎样,它已经证明了:大模型的效率革命,从来都不是某一个技术的突破,而是底层基建的全面升级。

当我们谈论大模型的未来时,往往把目光聚焦在模型的智能程度上,却忽略了支撑它的「基建」。就像一座摩天大楼,人们惊叹它的高度,却很少注意到地下的地基有多深。 Tile Kernels和DeepEP V2的出现,就是在为大模型打更深的地基——它们没有创造新的算法,也没有发布新的模型,却让现有的模型能跑得更快、更省、更稳。这恰恰是AI产业化最需要的:不是遥不可及的黑科技,而是能把技术落地的「硬实力」。 底层基建的厚度,决定了AI能走多远。