对抗知识焦虑,从看懂这条开始

App 下载

英特尔单月涨114%,“智能体AI”重构CPU算力格局

美股行情|智能体AI|CPU算力|英特尔|AI产业应用|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

美股行情|智能体AI|CPU算力|英特尔|AI产业应用|人工智能

2026年4月的美股行情里,有个数字像颗突然炸响的信号弹:英特尔单月股价暴涨114%,创下上市以来最佳纪录。要知道就在半年前,这家老牌芯片厂还因产品延迟、良率不足,在AI芯片竞赛里被甩在台积电和英伟达身后,华尔街几乎把它归为“过气选手”。

更反常的是,这次拉动英特尔的不是GPU,而是它压箱底的CPU——那个曾被认为在AI时代只能做GPU“陪衬”的通用计算核心。是什么让CPU突然成了香饽饽?答案藏在一个叫“智能体AI”的新概念里。

你可以把传统AI想象成一个只会做题的学霸:给它一道明确的题目(比如生成文案、识别图片),它能用GPU的数千个并行核心快速算出答案,CPU只需要负责把题目递过去、把答案拿出来,工作量不到10%。

但智能体AI不一样——它是个能自己找题做的“自主执行者”。它要帮你订机票,得先查航班、对比价格、调用支付接口,中途发现没身份证还得提醒你补充;它要写代码,得先拆解需求、查文档、调试bug,甚至会自己上网找参考案例。这些任务没有办法靠GPU的并行计算一次性完成,每一步都需要逻辑判断、流程调度和不同工具的协同,而这些正是CPU的强项。

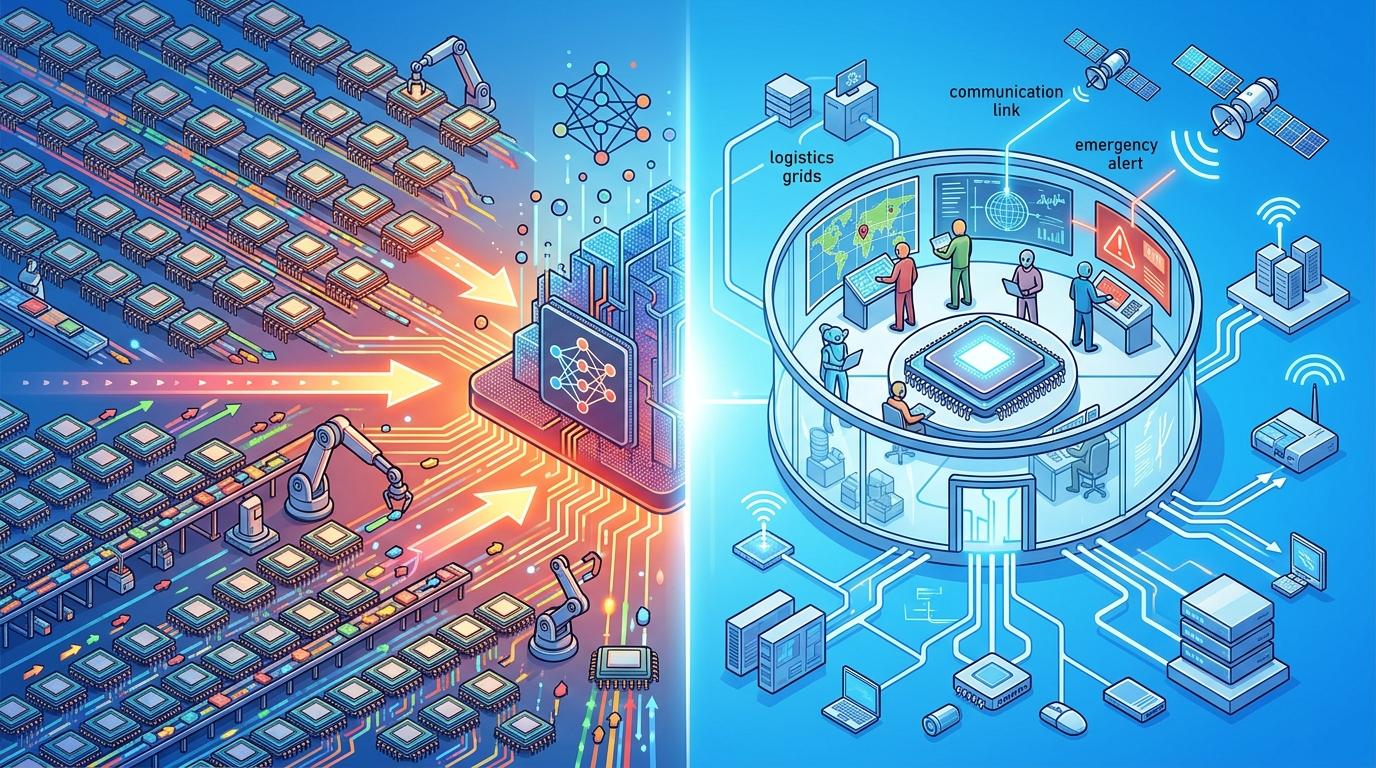

行业数据显示,在智能体AI的运行负载中,CPU承担的计算延迟占比高达50%-90%,GPU反而退居到只负责模型推理的“后台”。美国银行的预测更直接:到2030年,CPU市场规模会因为智能体AI翻番。

过去几年,市场的注意力全被GPU吸走了——毕竟训练大模型离不开它的并行计算能力,英伟达的股价神话就是最好的证明。但很少有人注意到,AI的重心正在从“训练”转向“推理”:当大模型训练完成后,真正支撑AI走进日常应用的,是无数次实时的、小批量的推理请求。

而推理场景恰恰是CPU的主场。比如你用AI客服咨询订单,你需要的是毫秒级的响应,而不是GPU批量处理的高吞吐量;智能工厂里的AI质检,要同时处理传感器数据、控制机械臂、记录检测结果,这些逻辑复杂的任务,GPU根本“转不动”。

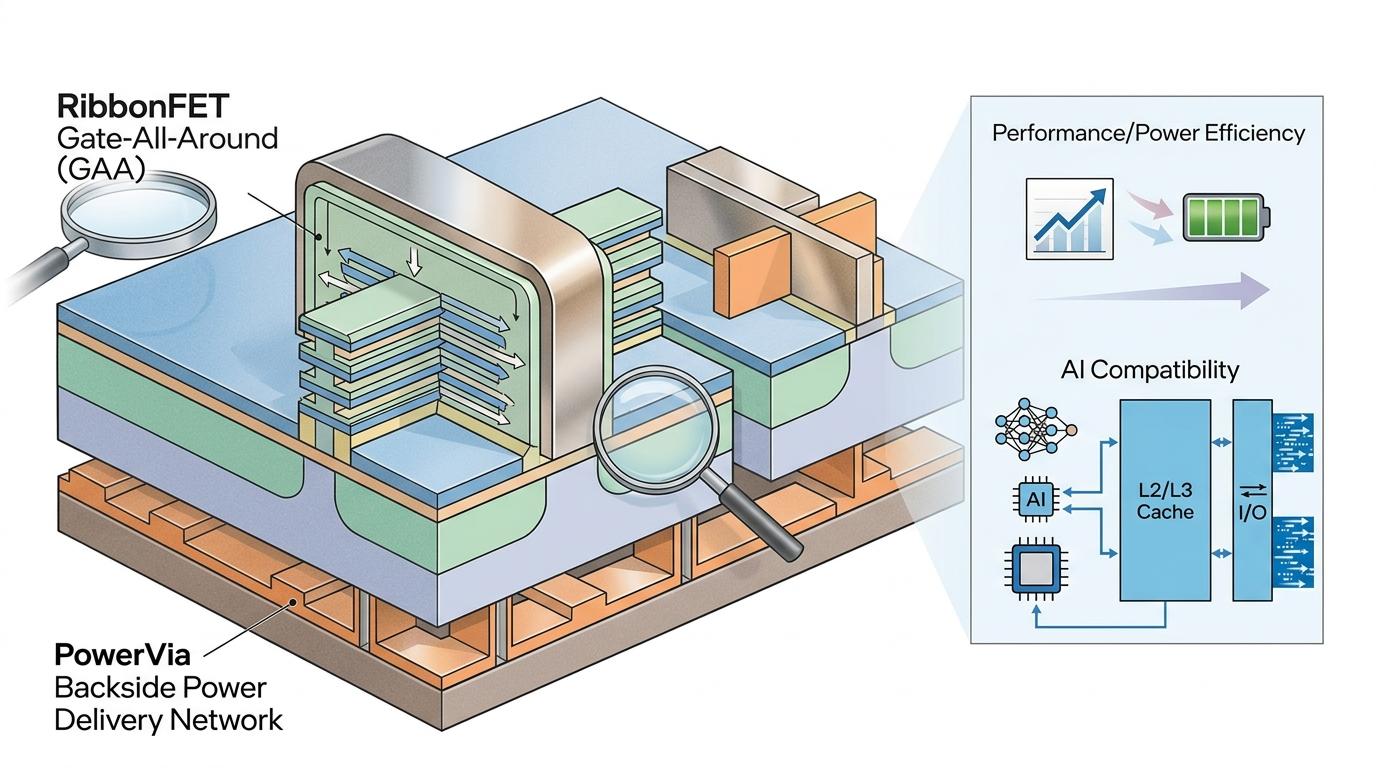

英特尔的18A工艺芯片在这个节点上实现量产,刚好踩中了需求爆发的节奏。这款采用全栅极环绕晶体管和背面供电技术的芯片,性能功耗比提升了15%,能完美适配智能体AI对高单核频率、大缓存和高速I/O的需求。数据中心的订单像潮水一样涌来,甚至出现了“售罄加价”的情况——英特尔不得不把消费级CPU的产能砍掉,优先供应数据中心。

但这场逆袭也有隐忧。当前CPU的供应紧张,本质是产能调整跟不上需求的突然爆发:台积电的先进制程产能优先留给GPU,英特尔自己的18A工艺良率还在爬坡,服务器CPU的交付周期已经拉长到6个月以上。而且智能体AI对CPU的要求还在升级,未来需要的不仅是更多核心,更是更强的内存带宽和更高效的多任务调度能力。

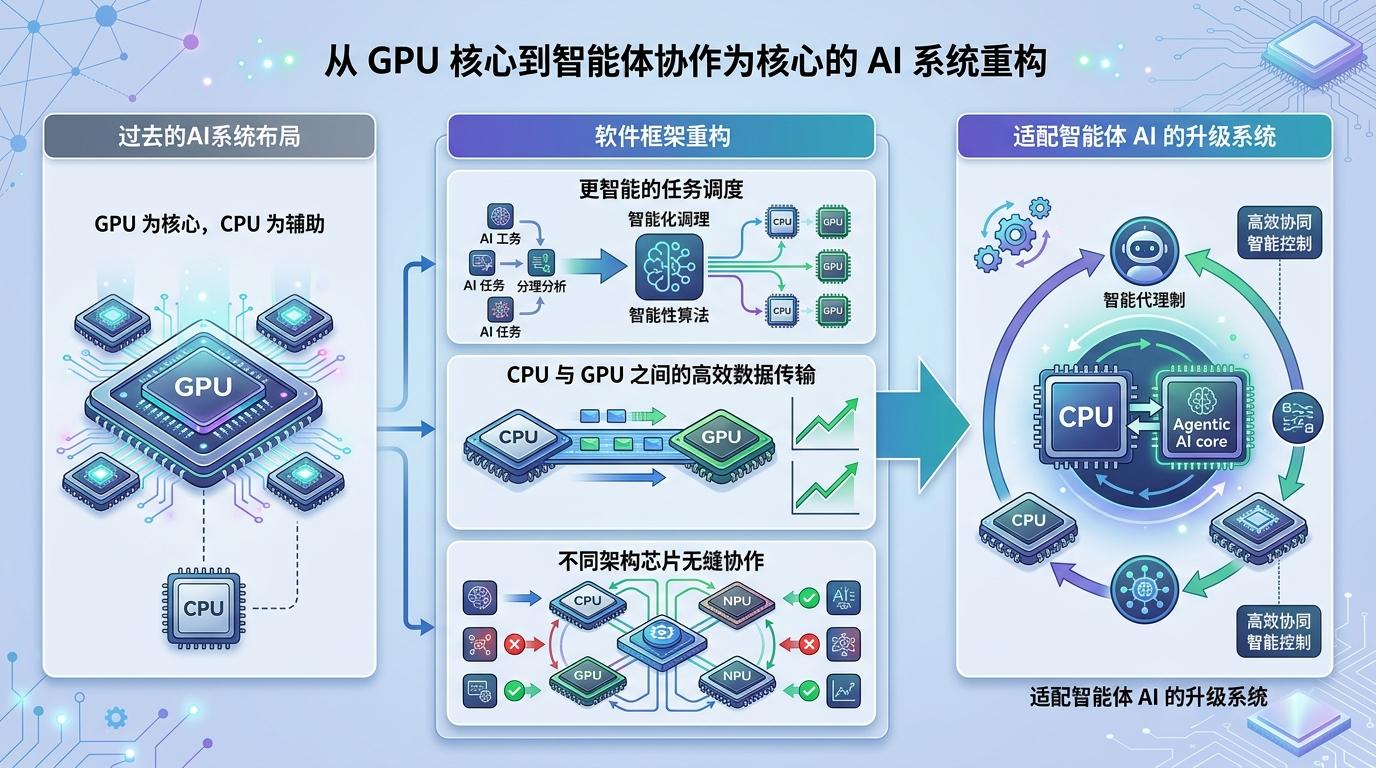

很多人把这次CPU的逆袭解读为“GPU时代的终结”,但事实刚好相反——智能体AI需要的不是“CPU取代GPU”,而是“CPU+GPU”的协同共生。

就像一个公司的运转:GPU是负责批量生产的车间,能快速完成重复性的繁重任务;CPU是统筹全局的办公室,要协调各部门、处理突发状况、对接外部资源。没有GPU,大模型训练不出来;没有CPU,智能体AI连最基本的任务都没法启动。

现在的问题是,过去的AI系统都是围绕GPU设计的,CPU只是个“边缘角色”。要适配智能体AI的需求,不仅需要芯片硬件的升级,更需要软件框架的重构:比如让任务调度更智能,让CPU和GPU之间的数据传输更高效,让不同架构的芯片能无缝协作。

亚马逊的Graviton定制CPU、英伟达的Vera CPU,都是为这个新生态量身打造的产品。它们不再追求“全能”,而是专注于智能体AI需要的低延迟、高可靠性和多任务处理能力。这意味着,AI芯片的竞争不再是“谁的核心更多”,而是“谁能更好地适配真实的AI应用场景”。

英特尔的股价暴涨,本质上是市场对AI算力逻辑的一次“补票”——当所有人都在盯着GPU的并行计算能力时,智能体AI突然揭开了AI的另一面:真正的智能,从来不是只会快速计算,而是能自主完成复杂任务。

“算力的未来,是分工而非垄断。”这句话正在被验证。GPU不会消失,CPU也不再是配角,它们会在智能体AI的驱动下,形成一个更均衡、更贴近真实需求的算力生态。而这场变革的影响,才刚刚开始显现。