对抗知识焦虑,从看懂这条开始

App 下载

AI能拍好莱坞大片,却过不了小学推理题

认知理解能力|全球高校测试|小学推理测试|好莱坞电影制作|AI视频生成|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

认知理解能力|全球高校测试|小学推理测试|好莱坞电影制作|AI视频生成|多模态视觉|人工智能

当你刷到一段AI生成的视频——雪山脚下的木屋升起炊烟,猎犬追着落叶跑进树林,画面逼真到能闻到松针的味道——你可能会感叹,AI已经能当好莱坞导演了。但如果给它出一道小学水平的推理题:「球从桌子上掉下来,会往哪个方向滚?」顶尖AI的答对率还不到70%。这不是段子,是32所全球顶尖高校联合做的测试结果。我们总在惊叹AI的「画功」,却忽略了一个更关键的问题:它真的「懂」自己画出来的世界吗?

过去几年,视频AI的竞赛全在「颜值」上——谁能生成更清晰的画面、更流畅的动作、更贴合文本的场景。从模糊的光影碎片到能以假乱真的电影镜头,「好不好看」的比拼已经到了天花板。但没人追问:这些模型是真的理解物理规律,还是只是把看过的画面碎片重新拼接?

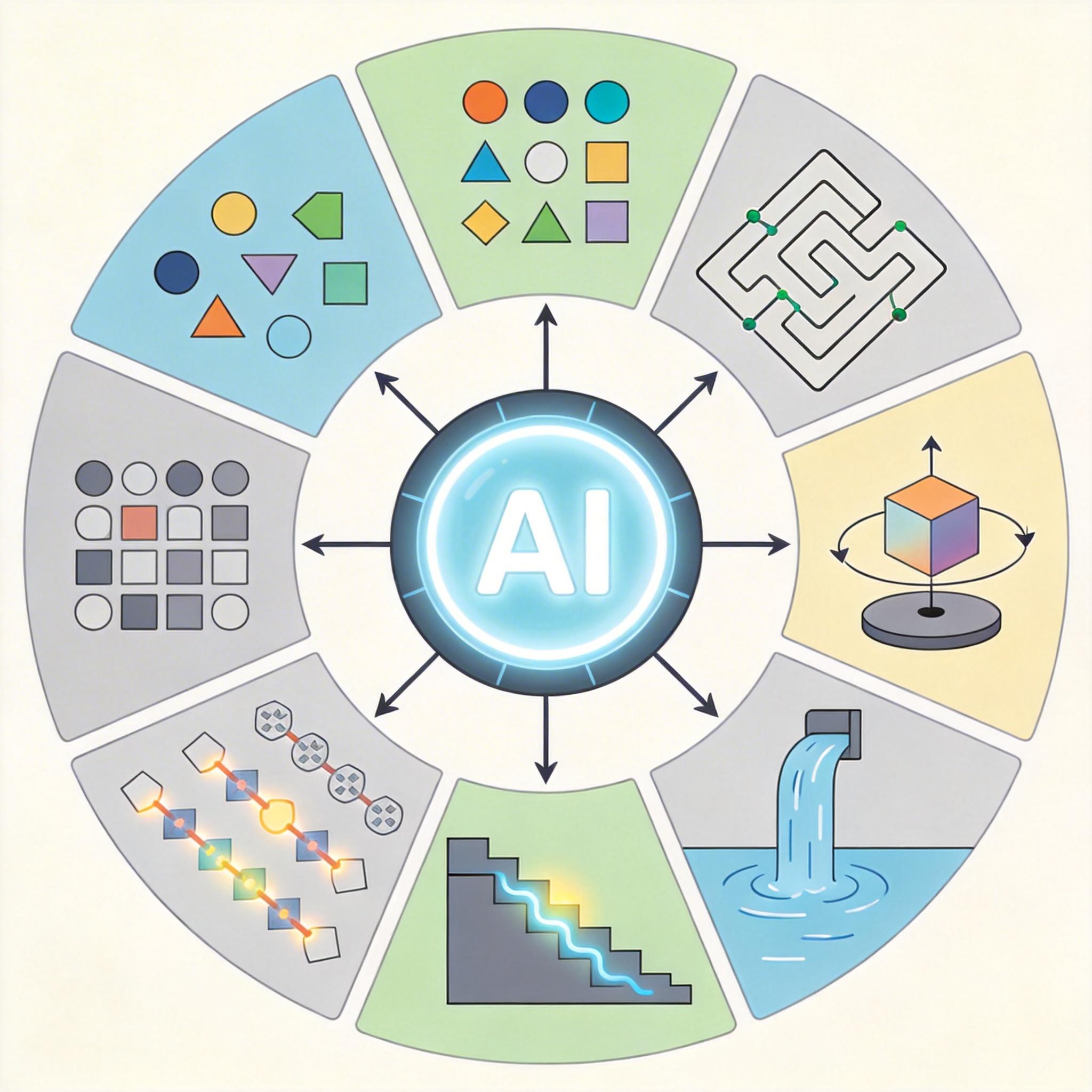

来自NTU、CMU、斯坦福等32所高校的研究者,决定给AI来一次系统性的「认知高考」。他们打造了VBVR——一个包含100万条视频、200种推理任务的超级数据集,把AI需要具备的推理能力拆解成六大「认知支柱」:感知(能不能认出颜色形状)、空间性(会不会走迷宫)、变换(能不能想象物体旋转)、知识(懂不懂水往低处流)、抽象(能不能从例子里找规律)。

这不是零散的测试题,而是一套覆盖人类基础认知能力的完整考卷。每道题都有唯一标准答案,还能自动生成新题目,避免AI靠「刷题」蒙混过关。

以前评测AI视频,就像老师改作文——靠人眼「看个大概」,或者让大语言模型当评委,结果全凭运气:同一个视频换个提示词,得分可能天差地别。这种模糊的评测,只会让AI在「讨好视觉」的路上越走越远,根本没法衡量它的「智商」。

VBVR彻底推翻了这套逻辑,改用「规则判卷」——给每道推理题制定明确的得分规则,比如迷宫题要看路径是否合法、有没有穿墙,物理题要检查物体运动是否符合重力。这套自动评分系统和人类判断的吻合度超过90%,而且完全可复现——不管谁来判,结果都一样。

测试结果让人大跌眼镜:顶尖AI模型的整体得分只有0.685(满分1),连人类水平的7成都没到。更关键的是,当把测试题换成AI没见过的「新题型」,得分直接掉了15%——说明它不是真的学会了推理,只是在记忆训练数据里的模式。

有意思的是,研究人员发现,得分高的模型都有一个共同点:「非必要不修改」。比如让它把红色方块旋转90度,它只会动方块,不会随便改动背景或其他物体,像做外科手术一样精准。这种「可控执行」的能力,才是AI从「视觉脑补」转向「逻辑推理」的关键。

有人说,给AI喂更多数据不就行了?研究人员也做了这个实验:把训练数据从0加到20万条,AI的得分确实从0.371跳到了0.685,提升了84.6%。但超过20万条后,得分就再也涨不动了——单纯堆数据,碰到了「结构性天花板」。

这背后的问题在于,现在的视频AI模型,本质上还是「概率生成器」:它靠统计数据里的画面规律来生成内容,而不是像人类一样,先理解世界的规则,再根据规则生成画面。比如它知道「球掉下来会往下」,是因为看过一万个球下落的视频,而不是真的理解「重力」这个概念。

要突破这个瓶颈,光加数据没用,得给AI换「脑子」——比如加入显式的状态跟踪模块,让它能记住视频里物体的位置和状态;或者增加结构化推理模块,让它像人一样一步步推导,而不是靠概率蒙答案。

我们总把AI的「逼真」等同于「智能」,就像把一个能背下整本物理书的机器人,当成了能搞懂物理的科学家。VBVR的出现,第一次把「懂不懂」和「像不像」分开,给AI的智能水平画了一条清晰的及格线。

能模仿,不等于会理解。 当我们不再只盯着AI的「画功」,转而要求它「讲道理」,真正的通用智能才会慢慢浮现。毕竟,能拍出好莱坞大片的AI很多,但能像孩子一样,靠推理理解这个世界的AI,才是我们真正需要的。