1 个月前

1 个月前

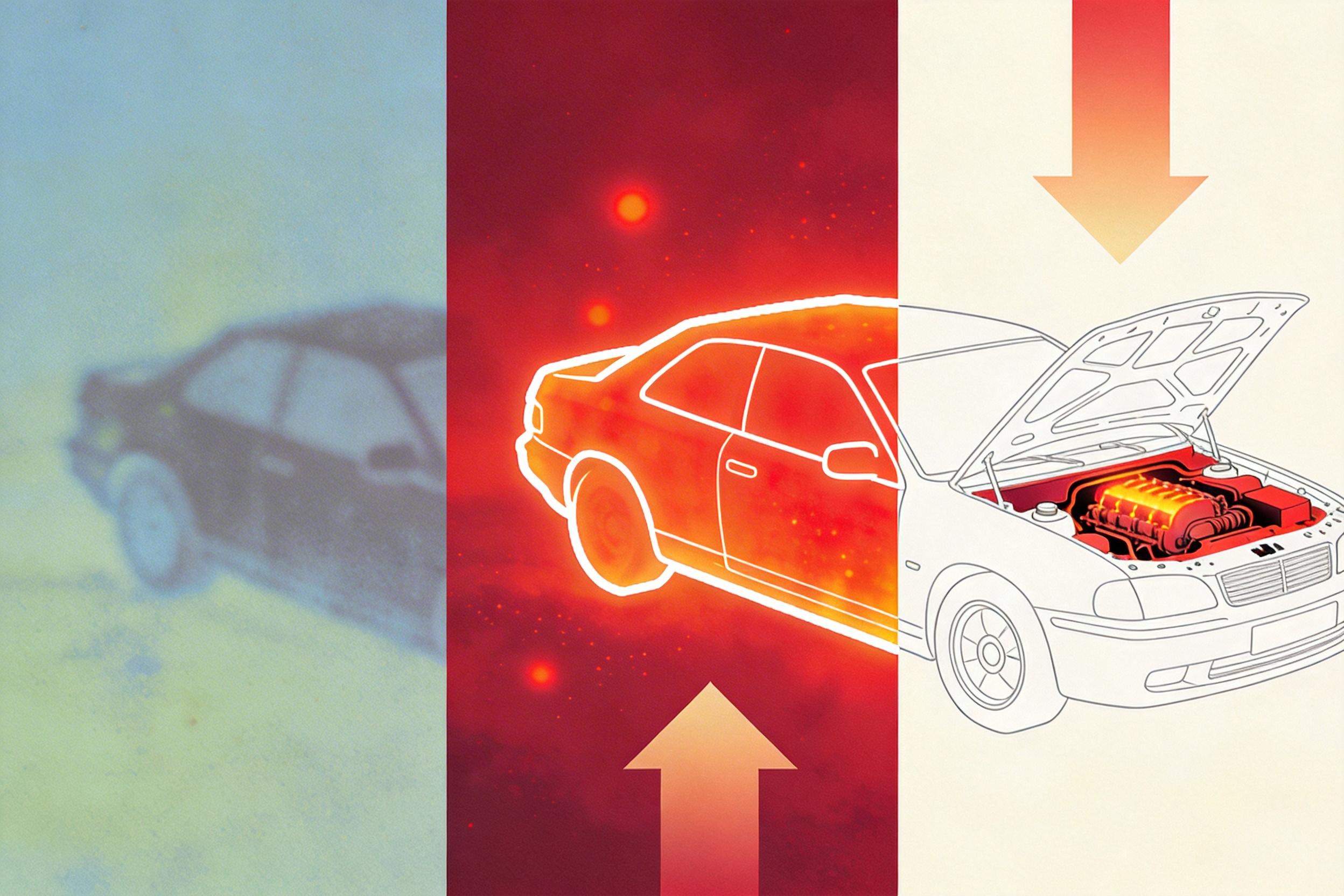

深夜的高速公路上,自动驾驶汽车的红外摄像头捕捉到前方一团模糊的热源——可能是横穿马路的行人,也可能是路边发热的广告牌。如果摄像头只能输出糊成光斑的低清图,汽车的决策系统就会陷入致命的犹豫。过去十年,红外图像超分辨率技术一直在解决这个问题,但绝大多数方法都犯了同一个错:只追求视觉上的清晰,却违背了红外成像最核心的物理规律。直到西北工业大学等团队的Real-IISR框架出现,才第一次把“看得清”和“符合物理”捏合在了一起。

你可以把可见光成像理解成给物体“拍反光”——光线照在汽车上,车身反射出的轮廓、纹理被相机捕捉,细节和结构高度统一。但红外成像完全是另一回事:它拍的是物体自己“散发热量”,发动机舱的热辐射会扩散到车身之外,冰冷的轮胎却可能和地面温度融为一体。这种“热源和结构错位”的特性,让传统超分模型彻底失灵:要么把热斑当成物体轮廓放大,要么把真实边缘当成噪声过滤。 更棘手的是真实世界的复杂退化。实验室里用“下采样”模拟的模糊,和实际拍摄中因失焦、运动产生的非均匀模糊完全是两码事。过去的研究全靠合成数据训练,模型在实验室里拿满分,一到真实公路上就直接“失明”。

Real-IISR的突破,本质是给超分模型加上了“红外思维”,而不是让它用可见光的逻辑瞎猜。 第一个关键是**热力-结构引导模块(TSG)**。它会先从模糊的低清红外图里拆出两份信息:一份是“热力图”——标出哪里温度高;另一份是“边缘图”——勾出物体的真实轮廓。然后用可学习的注意力门控机制,给不同区域分配不同权重:发动机舱这种热源主导的区域,就重点参考热力图;车身轮廓这种结构清晰的区域,就优先看边缘图。相当于给模型配了一副“红外眼镜”,既能看到热量,又不会认错物体形状。

第二个核心是**条件自适应码本(CAC)。传统超分模型的“纹理库”是固定的,面对不同模糊程度的区域只会输出同一种纹理。而CAC会根据当前区域的退化情况,动态调整纹理库的参数:严重模糊的区域,就调出更细腻的修复纹理;轻微模糊的区域,就用更简洁的特征还原。这就像给修图师配了可调节的画笔,不同的坑用不同的补法。 最具洞察力的设计是热力顺序一致性损失(L_TOC)**。红外图像的铁律是“温度越高,亮度越高”,但传统的像素损失会因为微小的图像错位,惩罚本来正确的亮度关系。L_TOC不管具体亮度值,只关心“谁比谁亮”的顺序:如果真实图里A点比B点热,重建图里A点就必须比B点亮,至于亮多少可以灵活调整。这就抓住了红外成像的本质——物理规律的一致性,比像素的绝对准确更重要。

巧妇难为无米之炊,过去红外超分的最大瓶颈其实是数据。没有真实的高低清红外图像对,再聪明的算法也练不出来。 Real-IISR团队直接扛着专业FLIR红外相机,跑遍6个城市、跨越3个季节,采集了1457对真实的高低清红外图像。他们的采集方法堪称“教科书级”:先让相机自动对焦拍一张高清图,再随机调整对焦环故意失焦,拍下模糊图后再下采样得到低清图——这样得到的模糊,和真实场景里的失焦、运动模糊完全一致。

这个名为FLIR-IISR的数据集,第一次给红外超分研究提供了“真实考场”。测试结果显示,Real-IISR不仅在所有指标上全面领先,推理速度还达到了2.45 FPS,比很多扩散模型快了数倍——这意味着它能真正用在自动驾驶、安防监控这些需要实时处理的场景里。

很多时候,AI技术的突破不是来自更复杂的模型,而是来自对问题本质的理解。过去我们总想让红外超分“模仿”可见光超分,却忽略了红外成像的物理规律;现在我们把物理规律当成算法的核心约束,反而得到了更清晰、更可靠的结果。 这也给所有AI研究提了个醒:尊重物理规律,比盲目堆参数更重要。当我们不再让AI“猜”图像,而是让它“懂”图像背后的世界,才能真正做出能解决真实问题的技术。未来的红外成像,不仅能看得清深夜的行人,还能准确判断发动机的温度、电力设备的故障——而这一切的起点,是我们终于学会了用红外的方式思考。

点击充电,成为大圆镜下一个视频选题!