对抗知识焦虑,从看懂这条开始

App 下载

AI只写代码不执行,测试自动化终于落地

代码生成|防火墙架构|自动化测试代码|微软Edge QA团队|AutoGenesis|AI产业应用|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

代码生成|防火墙架构|自动化测试代码|微软Edge QA团队|AutoGenesis|AI产业应用|人工智能

想象一下:一个不懂编程的外包员工,用几句大白话描述测试场景,就能生成专业级的自动化测试代码;这套代码每月跑200万+步骤,通过率稳定在99%,覆盖四大平台700+用例。这不是科幻场景,而是微软Edge QA团队开源的AutoGenesis正在做到的事。长久以来,测试自动化卡在两道坎上:写代码门槛高,写出来的脚本又因UI变动频繁失效。AutoGenesis用一个反常识的思路破局——让AI只做擅长的「代码生成」,把「稳定执行」还给确定性程序。

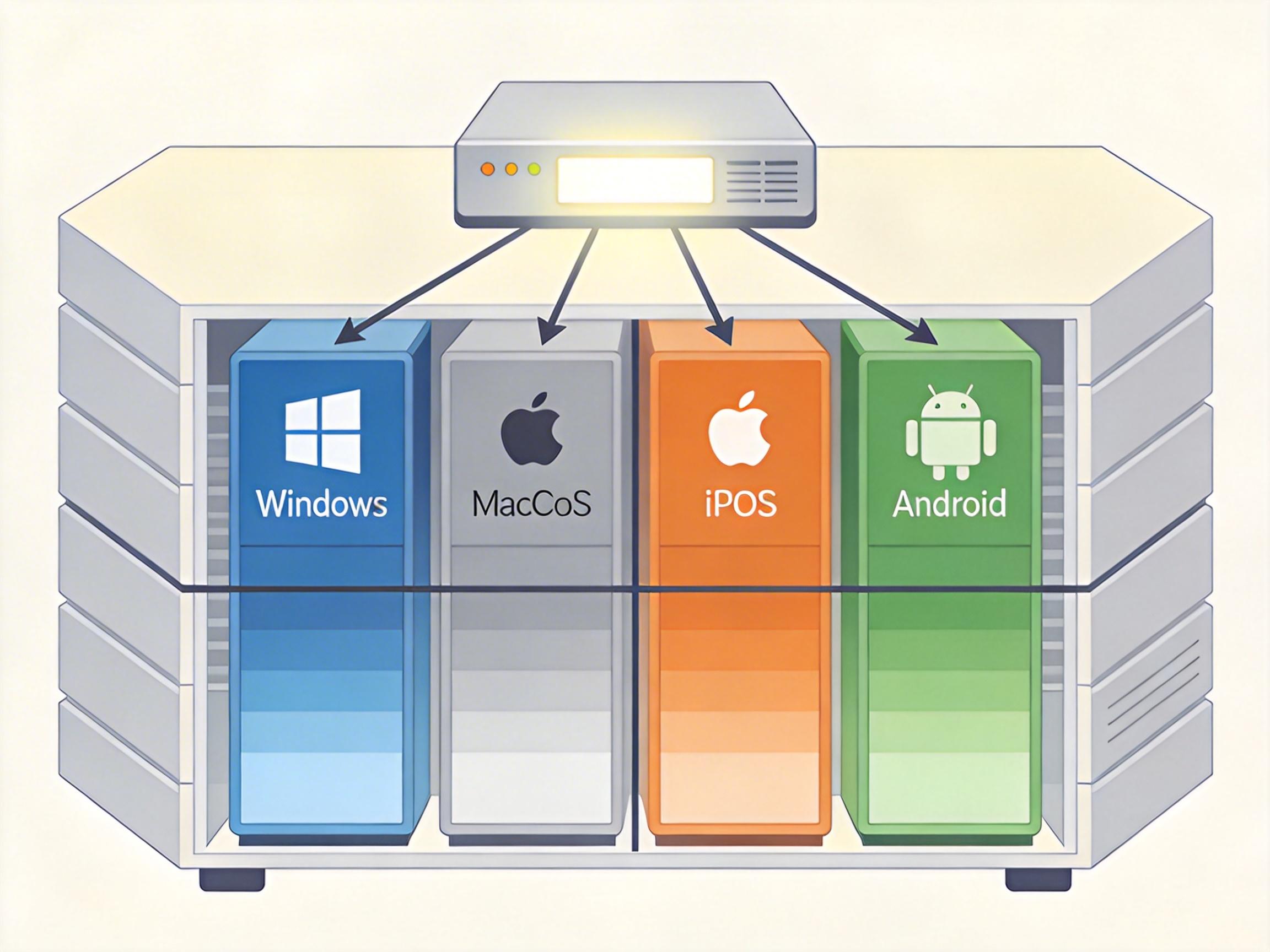

AutoGenesis的核心是四层分工的「防火墙」架构,把AI的活动严格限制在第二层:

最上层是用户层,测试人员用接近自然语言的Gherkin格式写场景——比如「打开Edge浏览器,输入msn.com,验证页面标题」,不用管代码怎么写。

第二层是LLM层,AI只干一件事:把自然语言场景翻译成符合MCP协议的Python代码。MCP(Model Context Protocol)是一套标准化的AI与外部系统交互协议,相当于给AI的输出套上了「格式模板」,避免它「乱写代码」。

第三层是MCP Server层,统一封装了Windows、macOS、iOS、Android四大平台的自动化能力——就像给不同型号的手机装了统一的充电接口,不管底层用PyWinauto还是Appium,对外都是一样的调用方式。

最底层是执行层,用成熟的Behave BDD框架跑代码,全程不碰AI。这层的关键是「确定性」:相同输入一定得到相同输出,不会像AI执行那样「走神」或「误判」。

这个架构的妙处在于,把AI的创造力和程序的稳定性彻底分开。AI不用操心「怎么点按钮」「怎么等页面加载」,只需要理解人类的测试意图;执行层不用处理模糊的自然语言,只需要跑确定的代码。

传统自动化测试的死穴,是把非技术人员挡在了门外。Edge团队里外包人员占大多数,他们懂业务但不会写代码,之前只能做手工测试。AutoGenesis让他们的角色直接升级:

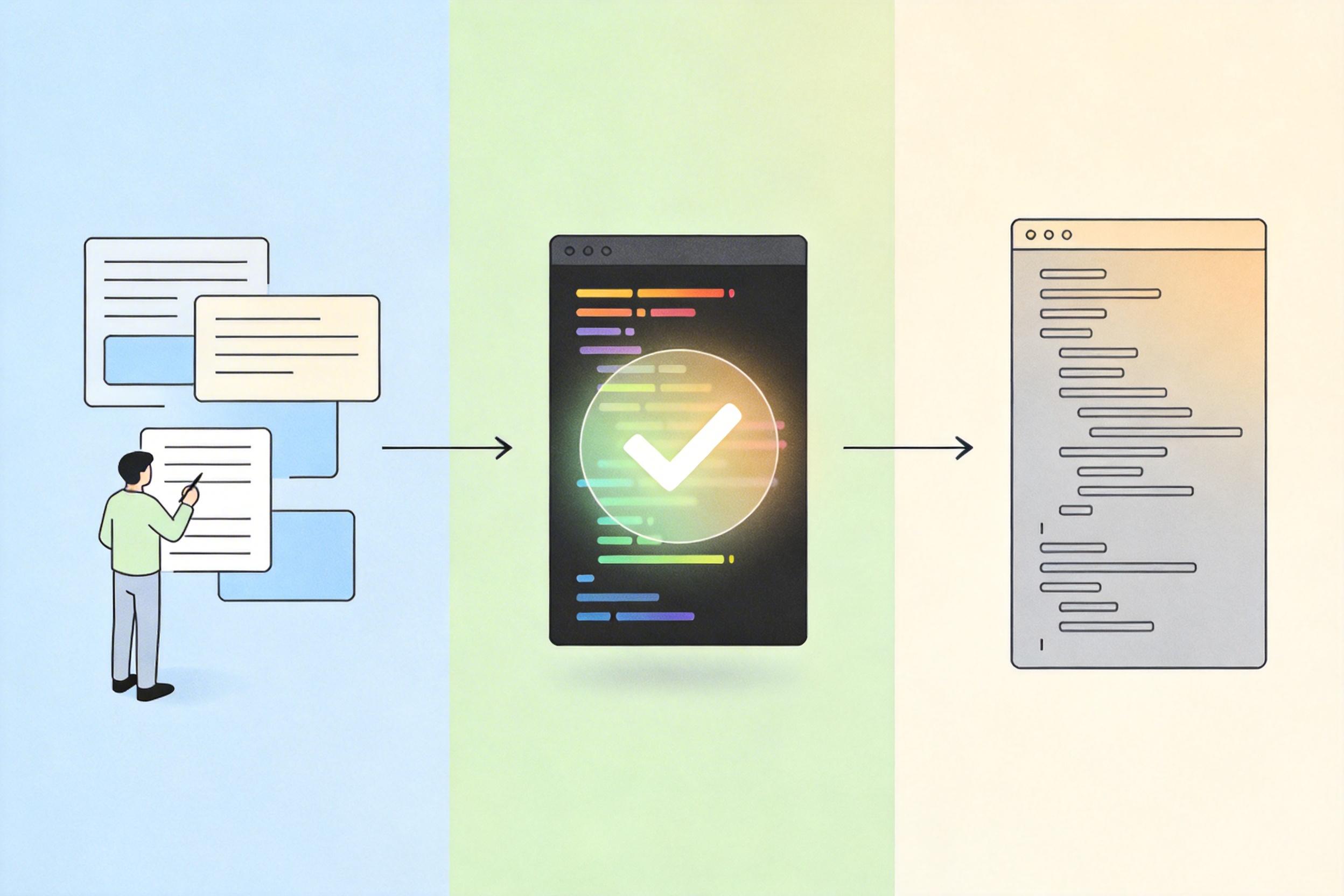

现在,外包人员只需要用Gherkin写测试场景,点击VS Code插件里的「Send to Copilot」按钮,AI就会生成代码。生成前还有个「三阶段确认流程」:先缓存AI的操作调用,生成代码差异预览,人工确认无误后再写入文件——相当于给AI加了个「审核岗」,避免它生成不靠谱的代码。

数据最有说服力:团队里的外包人员已经贡献了413个PR,单个测试场景的编写时间从2-3小时压缩到10-15分钟。更重要的是,执行阶段完全脱离AI,每月200万+执行步骤的通过率能稳定在99%——这是AI直接执行根本做不到的稳定性。

当然,这套方案也不是没有局限:AI生成的代码依然需要人工审核,复杂的业务逻辑还是得靠技术人员把关;MCP协议的学习成本虽然比写代码低,但也需要团队花时间适应。但它确实解决了自动化测试最核心的两个痛点:让更多人能参与,让跑起来的测试能稳定。

AutoGenesis的诞生,不是为了赶AI的风口,而是Edge团队被逼出来的解决方案。Edge跟着Chromium高频发版,每次更新都可能导致之前的测试脚本失效,维护成本高到离谱。

他们试过让AI直接执行测试,结果发现问题百出:AI执行长任务时会「忘记上下文」,重复点击同一个按钮;用截图判断测试结果时,会把「看起来像成功」误判为「真的成功」;出错了还没法追溯原因——因为AI的判断过程是黑盒。

于是他们换了个思路:既然AI擅长理解自然语言和生成代码,那就只让它干这个;执行和判断这种需要确定性的活,交给传统程序。这个思路刚好踩中了AI测试的「甜蜜区」:用AI降低门槛,用程序保证稳定。

这种「AI做助理,人类掌方向盘」的模式,其实也是当前AI落地的最优解。比如在代码安全领域,AI生成的代码必须经过人工审核和静态扫描;在知识管理领域,AI生成的文档需要人工验证后才能入库。AutoGenesis的实践证明,AI不是要替代人类,而是要解放人类——把人从重复的代码编写中解放出来,去做更有价值的事,比如设计测试策略、分析测试结果。

AutoGenesis的意义,不止是给测试自动化提供了一个可落地的方案,更是给AI与工程实践的融合打了个样:AI的价值,不在于炫技式的「全自动化」,而在于找到和人类能力互补的平衡点。

当我们不再执着于「让AI干所有事」,而是让AI干它擅长的事,把需要人类判断和确定性的事留给人或程序,反而能把AI的价值发挥到最大。这也是AutoGenesis给所有团队的启示:技术的终极目标,从来不是替代人类,而是让人类的工作更高效、更有价值。

AI做生成,程序做执行,人机各归其位。