对抗知识焦虑,从看懂这条开始

App 下载

病理切片告别切豆腐,AI用连续函数找癌细胞

名古屋大学|癌细胞检测|连续函数|WSI-INR方法|病理切片|新药研发|大语言模型|医学健康|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

名古屋大学|癌细胞检测|连续函数|WSI-INR方法|病理切片|新药研发|大语言模型|医学健康|人工智能

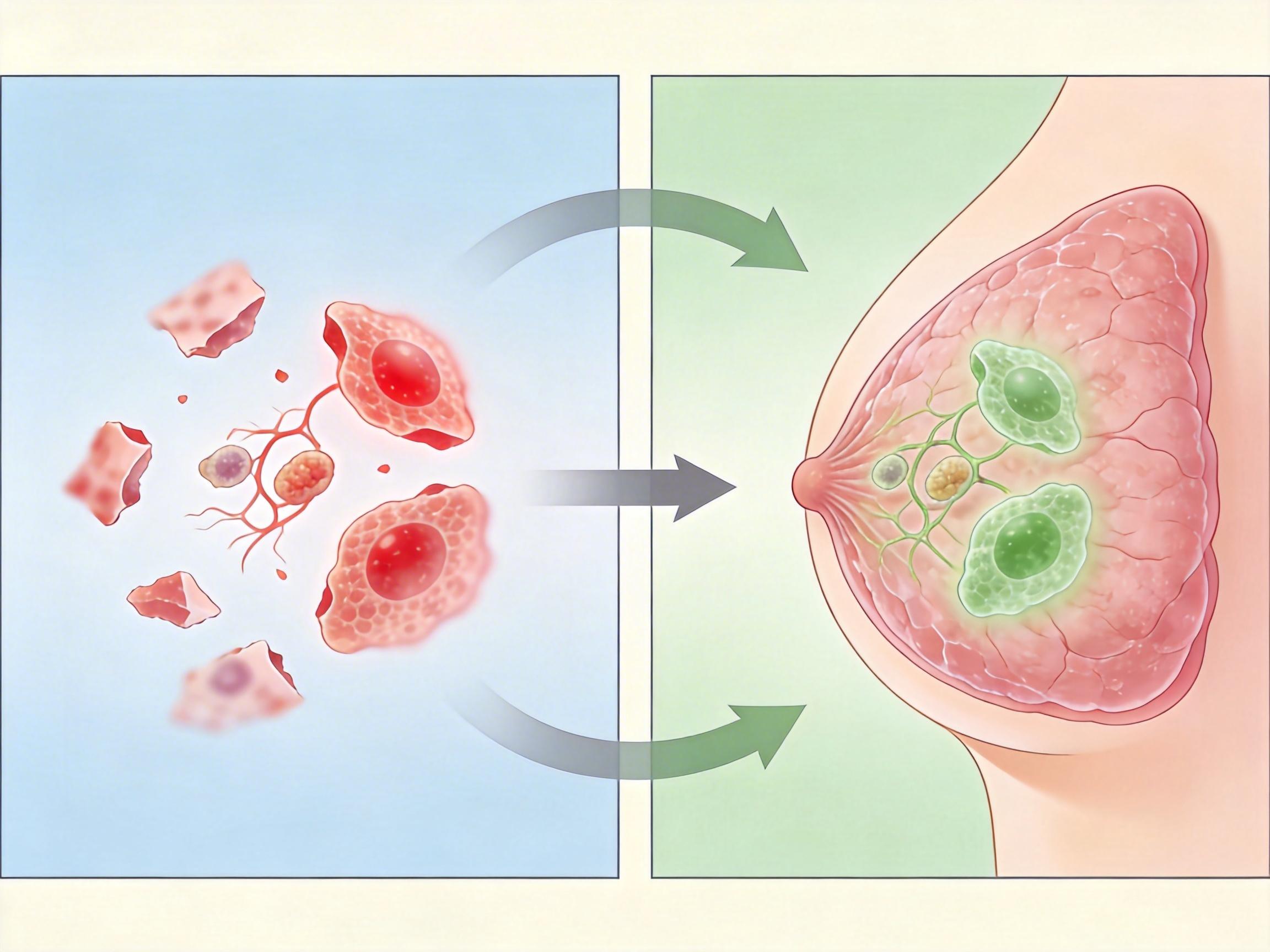

想象你面前摊开一张比城市地图还大的病理切片——数亿像素里,藏着只有“几个街区”大的癌细胞。过去AI只能像切豆腐一样把它剁成上万块小图,拼起来时早已把组织的连续结构切碎;换个放大倍数,模型更是直接懵圈,给出的结果前后矛盾。2026年3月,名古屋大学、慕尼黑工业大学的团队联手,用一个连续函数解决了这个困扰病理AI多年的难题。他们是怎么让AI“看懂”整张切片的?

你可以把传统病理AI的工作模式想象成一群盲人摸象——每个人只摸一小块,最后拼出来的大象要么缺鼻子少腿,要么各部分衔接不上。而这次的WSI-INR方法,直接让AI“看见”了完整的大象。

核心是隐式神经表示(INR)——这是一种用神经网络学习连续函数的技术。传统图像是离散的像素集合,就像用无数小瓷砖拼出来的画;INR则是画的“设计图纸”,输入任意坐标(x,y),它就能告诉你这个点的颜色、甚至是不是癌细胞。对于病理切片这种超大规模图像来说,这意味着AI终于不用再切分图像,而是直接学习一个覆盖整张切片的连续映射:从空间坐标,到组织的语义特征。

这个思路的妙处在于,它天然保留了组织的空间连续性。传统方法里被切碎的血管、细胞连接,在INR的函数里是平滑连续的曲线和区域,不会再出现“切一刀就丢了上下文”的问题。

但光有连续函数还不够——病理医生看片时,总需要在低倍镜扫全景、高倍镜看细节之间切换,传统AI一换分辨率就“失忆”,WSI-INR怎么解决这个问题?

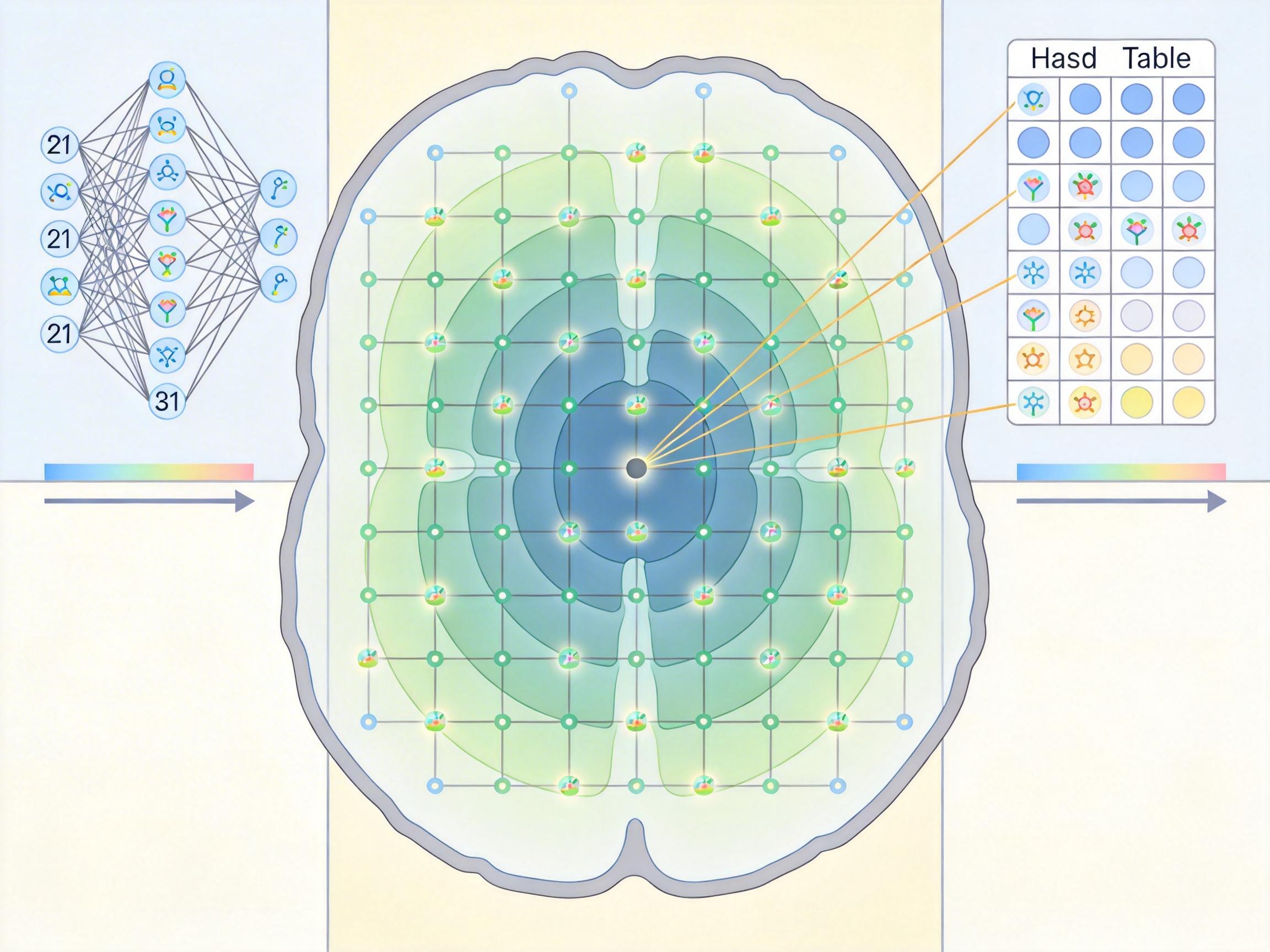

答案是多分辨率哈希网格编码,这项原本用于3D重建的技术,被巧妙嫁接到了病理分析上。你可以把它想象成用多层渔网去捞同一片水域:最粗的渔网(低分辨率网格)捞的是整片海域的地形,比如哪里是大陆架哪里是海沟;最细的渔网(高分辨率网格)则能捞到单个鱼虾的细节。

具体来说,模型用21层不同精细度的网格覆盖整张切片,每层网格的顶点都对应一个可学习的特征向量,存在哈希表里。当输入一个坐标点时,模型会在每一层网格里找到它周围的顶点,通过插值得到该层的特征,最后把所有层的特征拼起来——这就像同时用粗渔网看全局、细渔网看细节。

更聪明的是,哈希表会自动“分配资源”:如果某个区域是结构简单的正常组织,精细网格的特征会被压缩;如果是病变边缘这种复杂区域,模型会把更多计算资源倾斜过来。这完美适配了病理切片“90%是背景,10%是关键病变”的特点。

最关键的是,无论你输入的是高倍镜还是低倍镜下的同一个物理位置,它都会被同一个哈希网格系统处理。低倍镜下,精细网格的细节会被“模糊”,但粗网格的全局结构始终一致——就像你站远看画,虽然看不清笔触,但构图不会变。这让AI真正学会了“理解组织本身”,而不是“记住某个分辨率下的像素”。

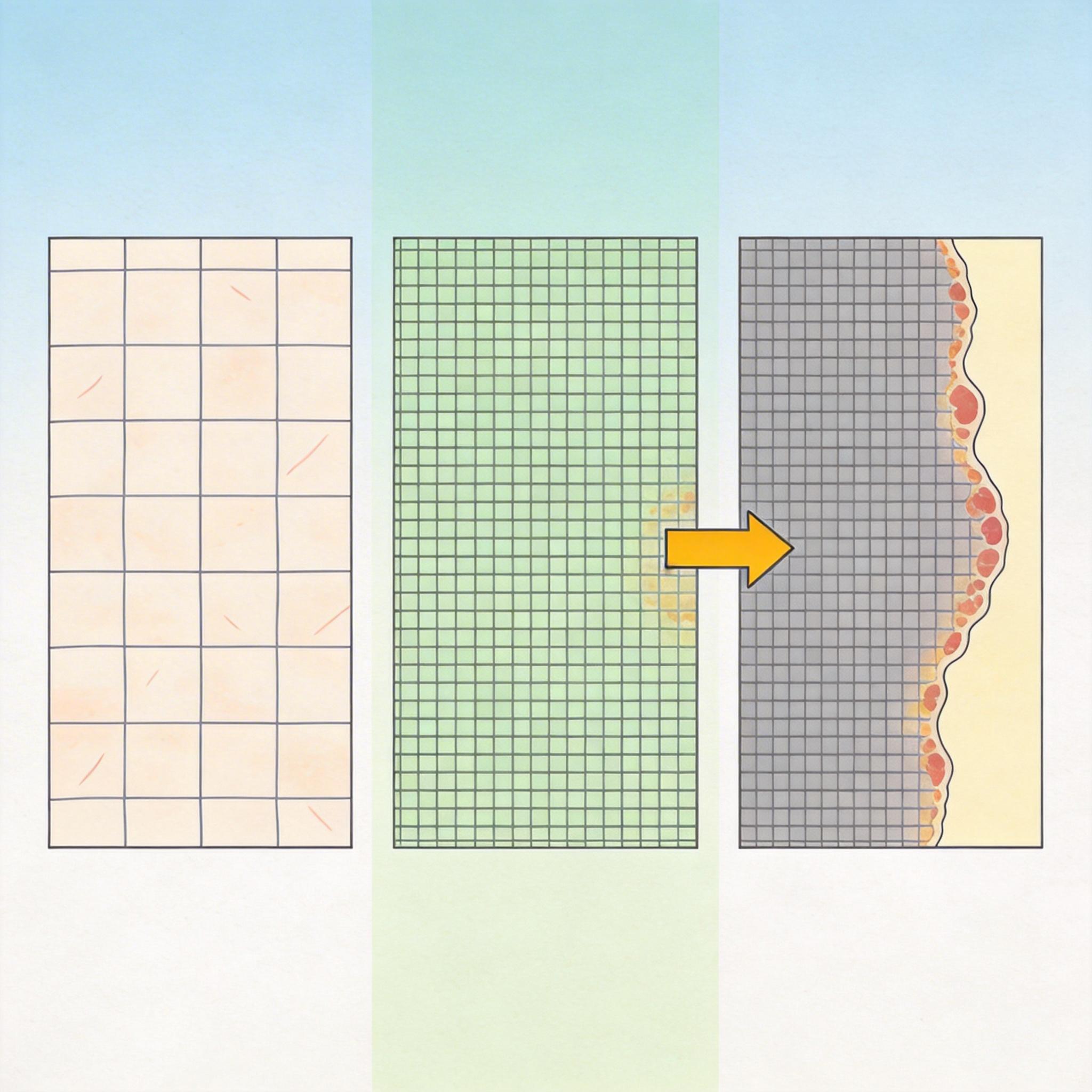

为了避免AI走捷径,研究团队设计了一套“先学懂,再判断”的两阶段训练策略。

第一阶段,模型只做一件事:“画地图”。它要根据坐标点,精准重建出病理切片的原始图像。这就像让AI先把整张切片的每一个细节都摸透,从细胞的纹理到组织的排布,建立起对组织结构的精确理解。如果跳过这一步直接让AI找癌细胞,它很可能会偷懒——比如只记住“病变区域颜色更深”这种表面特征,而完全不懂背后的组织逻辑,换个染色风格就彻底失效。

第二阶段,模型会“失忆”重建能力,只专注于“找地标”。此时,第一阶段训练好的哈希编码器和解码器会被冻结,只训练分割头——也就是让AI在已经学懂的“地图”上,标记出癌细胞的位置。这种方式保证了AI是基于对组织的理解来判断病变,而不是靠表面特征蒙混过关。

在CAMELYON16乳腺癌淋巴结转移数据集的测试中,这种策略的效果一目了然:传统U-Net在分辨率降到1/4时,Dice分数暴跌54%,分割结果碎成渣;而WSI-INR在分辨率特异优化下,Dice分数反而提升了26%——换个分辨率,AI反而看得更准了。

当然,这项技术还没到完美的地步:它对只有几个细胞大的微转移病灶识别还不够精准,跨医院、跨扫描仪的泛化能力也需要更多验证,每张切片6分钟的推理时间,也还满足不了实时诊断的需求。

但它的意义,远不止是提升了病理分割的准确率。它第一次把“连续函数”的思路引入了高度异质的病理图像分析,打破了长期以来“切分图像”的思维定式。从离散的像素,到连续的函数——这不仅是技术的升级,更是AI理解医学影像的底层逻辑的转变。

连续建模,才是医学影像的未来。