对抗知识焦虑,从看懂这条开始

App 下载

AI幻觉减半的背后,是学会了回头查错

概率驱动生成|错误检测机制|回溯推理|AI幻觉|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

概率驱动生成|错误检测机制|回溯推理|AI幻觉|大语言模型|人工智能

当你对着一道算错步骤的根号方程发呆时,AI的反应正在悄悄改变——以前它要么说“没问题”,要么发现不对就直接宣布“无解”,现在它会顺着你的推导往回走,揪出哪一步展开错了,再重新算出正确答案。这不是某个程序员的临时补丁,而是大模型幻觉率减半的核心逻辑:从“出错就放弃”到“主动找错”。

要理解这背后的突破,得先搞懂什么是大模型的“幻觉”——它不是真的“编造”,更像是一种概率驱动的“顺口胡说”。传统大模型的训练目标是“预测下一个最可能的词”,而非“保证每句话都正确”,就像你凭语感填空,偶尔会写出语法通顺但事实错误的句子。当它在复杂推理中走错一步,后续的所有推导都会顺着错误滑下去,最后给出一个逻辑自洽但完全错误的结论。

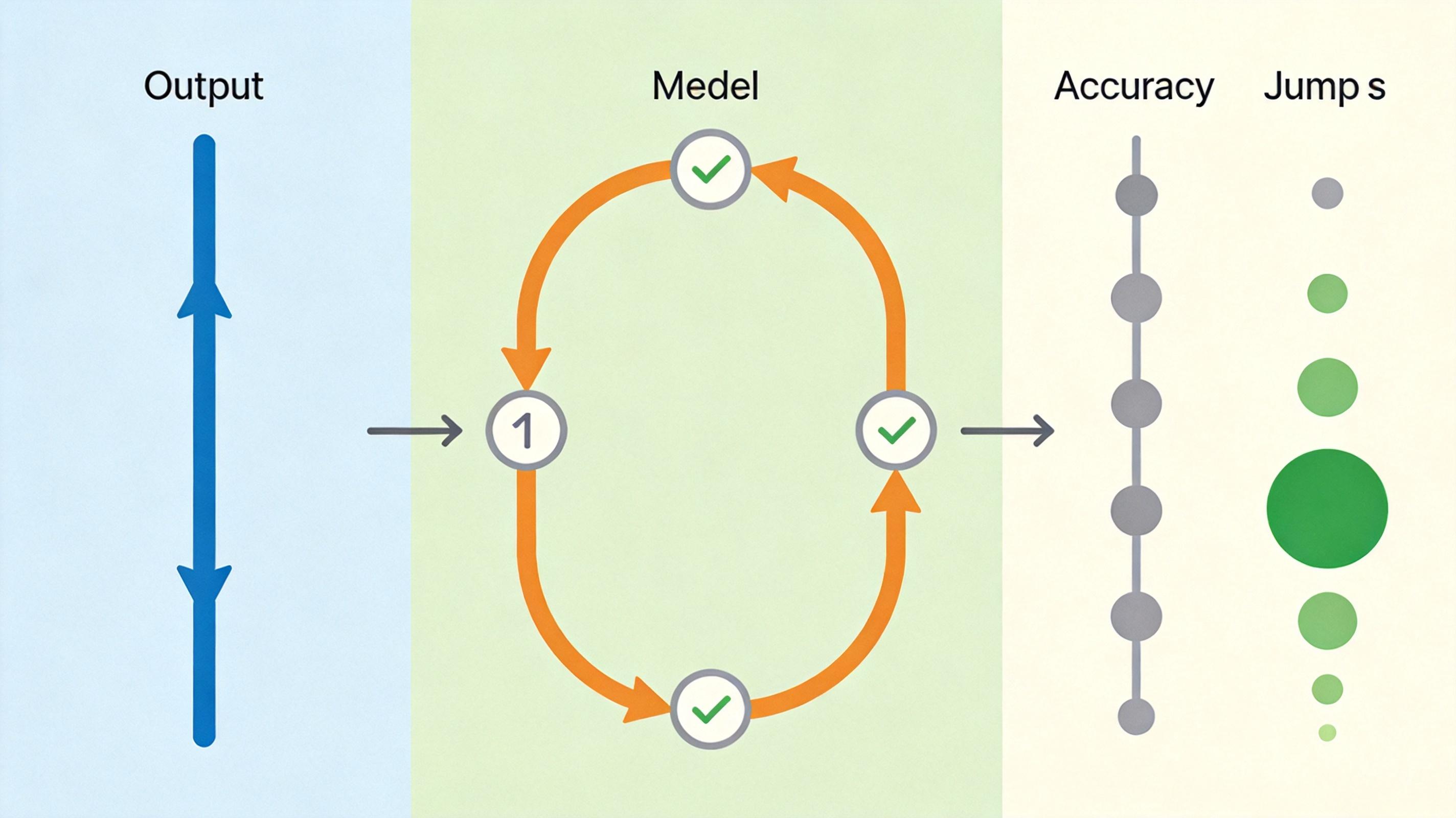

这次的关键改变,是给模型加了一套“自我校验回路”。它不再是单线程的“推导-输出”,而是多了一个“复盘”环节:先按直觉给出初步答案,再把结果倒推回问题起点,或者拆解每一步的推理链,检查有没有矛盾或漏洞。就像学生做完题后验算,一旦发现结果不对,不是直接撕卷子,而是从第一步开始核对草稿。这套机制在数学、科学题上的提升最明显——竞赛数学题的正确率从65.4%跳到81.2%,博士级科学题的得分也涨了7个百分点。

但这种“回头查错”的能力,背后是巨大的工程挑战。首先是计算成本的平衡:多一轮校验就意味着多消耗算力,要在保证响应速度的同时完成自查,得靠硬件协同优化和推理算法的精打细算——比如只在高风险领域启动校验,或者用更轻量的模型做初步核查。其次是训练数据的难题:要让模型学会“找错”,就得给它喂足够多的“错误样本”,包括人类的错题、标注过的错误回答,还要教会它区分“哪里错了”和“为什么错了”。

更重要的是,幻觉永远无法被彻底消除。大模型的本质是统计模型,只要训练数据存在长尾知识、矛盾信息,它就可能在极端场景下“胡说”。现在的突破,更像是把幻觉从“高频随机错误”变成了“低频可控错误”——就像汽车装上了防抱死系统,不能杜绝事故,但能大幅降低失控的概率。

这也意味着,我们对AI的期待正在从“无所不能”转向“可靠可用”。以前我们惊叹于AI能写诗、能聊天,现在我们更在意它能不能在医疗诊断时不瞎编病例,在金融分析时不搞错数据。幻觉减半的意义,从来不是让AI变成不会犯错的神,而是让它终于能成为一个靠谱的工具——一个会在出错时停下来,回头找问题的工具。