对抗知识焦虑,从看懂这条开始

App 下载

一个模型搞定全码率,极端压缩不再靠堆模型

扩散模型|中科大|上海交大|极端低码率压缩|ASSR-EIC模型|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

扩散模型|中科大|上海交大|极端低码率压缩|ASSR-EIC模型|多模态视觉|人工智能

当无人机在山区传回模糊到辨不清植被的监控图,当卫星遥感数据因为带宽限制只能丢三落四,你大概会想:就不能把图像压得更小还更清楚吗?过去的答案是——能,但要付出代价:每换一种带宽,就得重新训练一个动辄几十GB的扩散模型,成本高到中小团队根本用不起。直到上海交大和中科大的团队拿出了ASSR-EIC:一个模型,就能覆盖从0.05到0.1bpp的全范围极端低码率,感知质量和结构保真还双双碾压传统方案。它到底是怎么把「一个萝卜一个坑」的死局,变成「一把钥匙开所有锁」的?

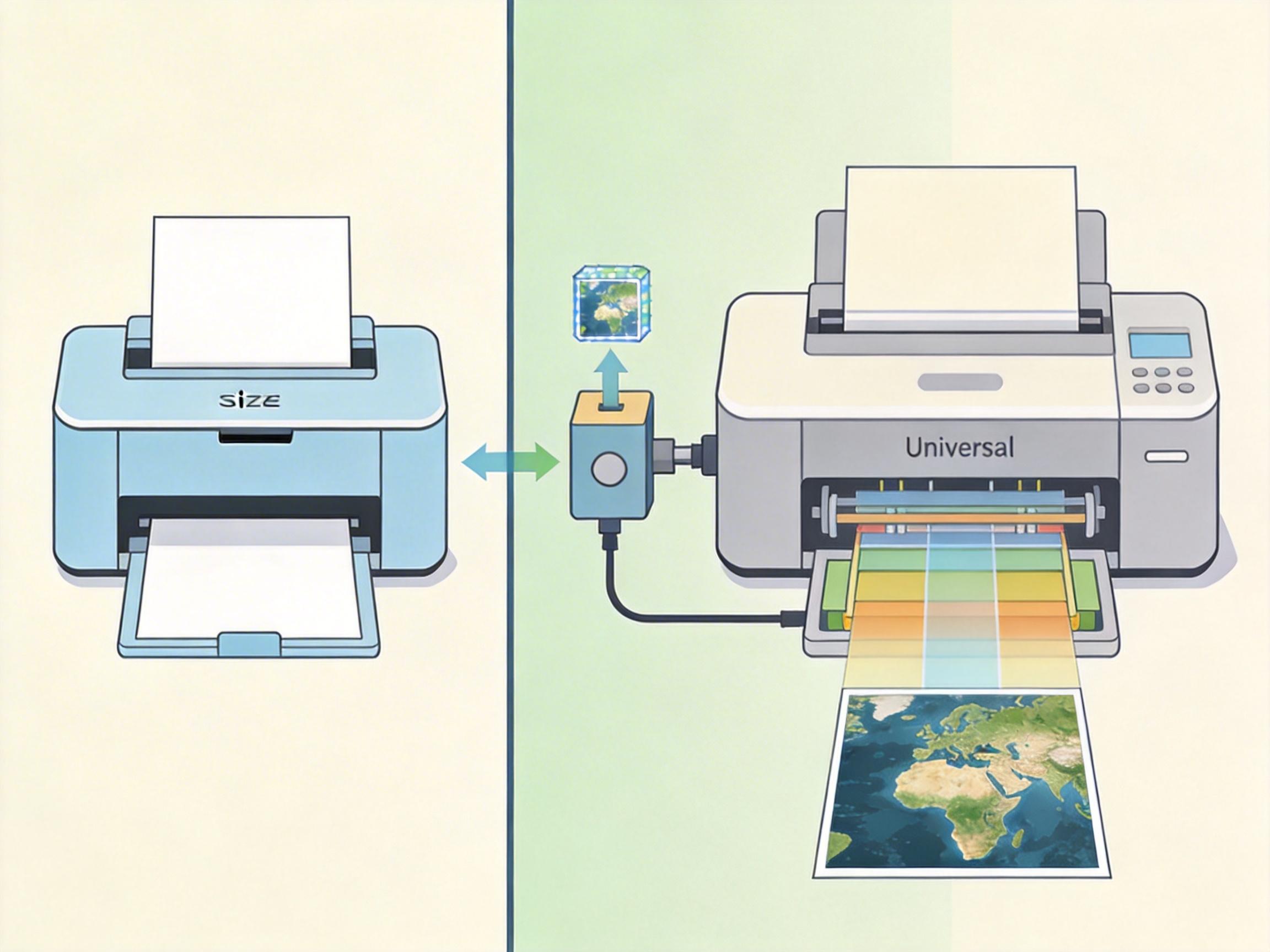

你可以把过去的扩散压缩模型理解成「定制化打印机」——只能打印固定大小的纸张,要换尺寸就得换一台新机器。ASSR-EIC的核心思路,是把「定制机器」改成「通用打印机+可调缩放器」:编码端先把高清图按任意比例s缩小,再用成熟的编解码器(比如VVC)压缩传输;解码端再用一个「聪明的放大器」把小图放大回原尺寸,同时补上压缩丢失的细节。

这个缩放因子s,就是控制码率的旋钮:缩得越小,传输的数据量越少,码率就越低。实验数据直白得惊人:缩放2倍时,码率能降到原来的1/3左右。更妙的是它的兼容性——当不需要极端压缩时,把s设为1,它就自动变回你原本在用的编解码器,完全不用额外适配。

但光靠缩放还不够——不同压缩方式给图像造成的「伤害」天差地别:传统编解码器会留下块状伪影,学习型编解码器容易让图像发糊;压缩越狠,细节丢失越严重。如果模型只会一套修复流程,要么把清晰的地方修出伪影,要么把严重损坏的地方修得模糊。

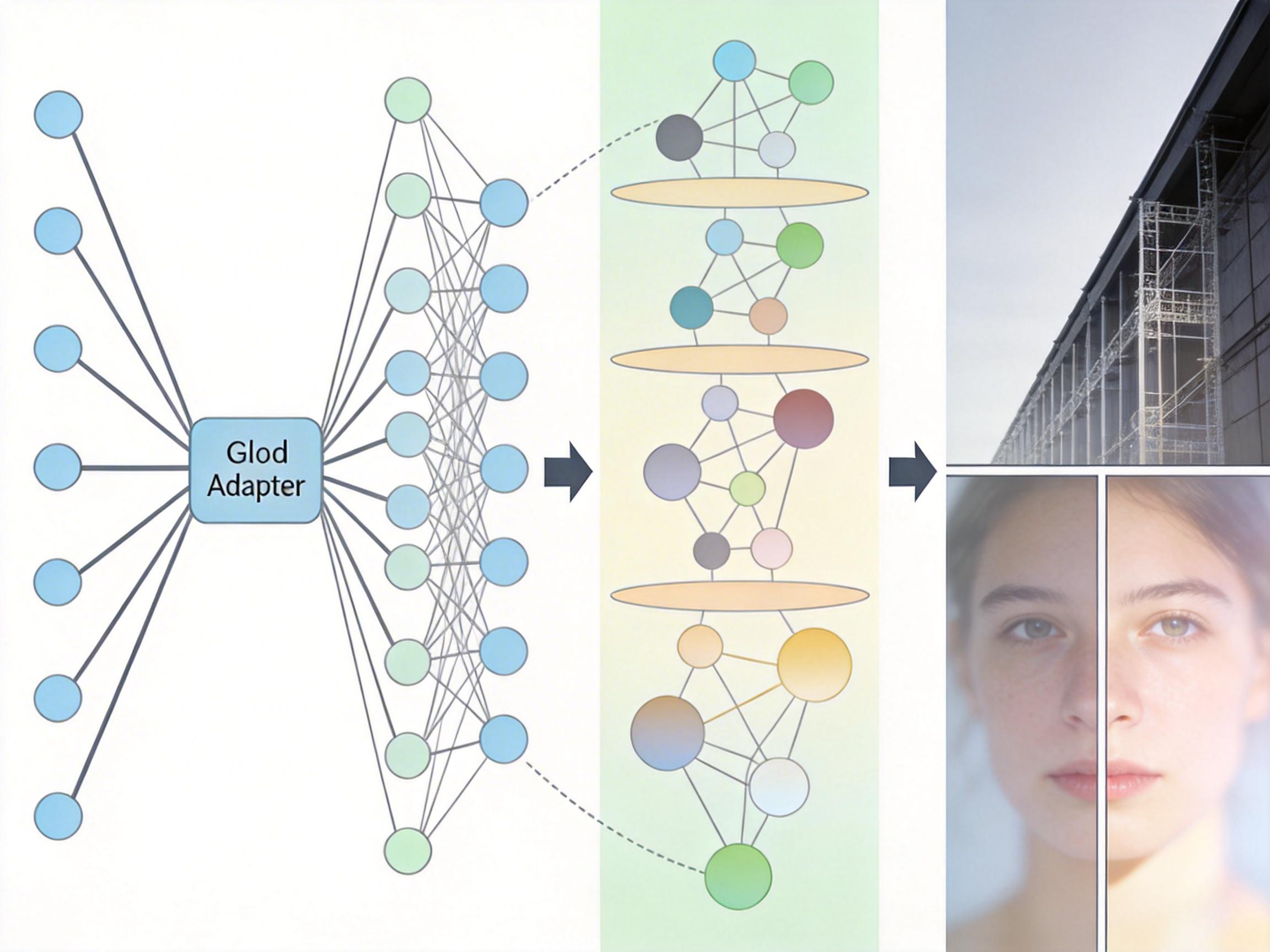

ASSR-EIC的破局点,是给模型装上了「退化感知雷达」:它会先读取三个关键参数——编解码器类型、压缩质量参数、缩放因子s,把这些信息转换成模型能理解的特征向量。然后通过两个模块实现「精准修复」:

**全局压缩-缩放适配器像总指挥,把这些特征注入到扩散模型的每一层,让模型从一开始就明确「我要处理的是哪种烂摊子」,定下整体修复策略;局部压缩-缩放调制器**则是精准的「火候控制器」,它会给图像的每个像素动态生成一对调节参数,在退化严重的区域(比如被压糊的人脸)多「脑补」细节,在退化轻微的区域(比如清晰的建筑边缘)多保留原始结构。

为了进一步提升修复的准确性,模型还引入了双重语义增强:用原图的文本描述提供全局语义指导,用SAM分割模型提取的特征强化对物体结构的理解。这套组合拳打下来,模型终于能「见招拆招」——不管是块状伪影还是模糊失真,不管是0.05还是0.1bpp的码率,都能给出最优的修复方案。

当然,ASSR-EIC也不是没有短板。最突出的问题,是解码端的扩散模型计算量极大,解码延迟远高于传统方法——在A100 GPU上,50步采样也需要数秒才能完成一张图的解码,这让它暂时无法应用在视频通话这类低延迟场景。但研究者也给出了折中方案:把采样步数从50步减到20步,能在质量损失很小的情况下,把解码速度提升一倍以上。

从实验数据看,它的优势足够亮眼:在Kodak、MS-COCO等数据集上,它的FID(衡量真实感)、LPIPS(衡量感知差异)等指标全面领先现有SOTA方法;BD-RATE指标显示,在相同感知质量下,它比传统VVC编解码器能节省超过70%的码率。更重要的是,它的泛化能力极强——即使从未见过JPEG、BPG这类编解码器的压缩损伤,也能给出不错的修复效果。

当我们谈论AI的实用化,往往关注的不是「能不能做到」,而是「能不能低成本地做到」。ASSR-EIC的价值,就在于它把扩散模型从「实验室里的奢侈品」,变成了「工程上能用的工具」——不用再为每个码率训练一个模型,不用再担心不同编解码器的兼容性问题,只需要一个模型,就能应对绝大多数极端低码率的压缩场景。

真正的技术突破,往往是把复杂的问题,变成一个可调的旋钮。 未来随着扩散模型推理速度的提升,我们或许能在更多实时场景看到它的身影:比如在偏远地区实现清晰的视频通话,让无人机传回的图像不再模糊,让卫星遥感数据能完整落地——而这一切,都从「一个模型搞定全码率」的微小革命开始。