对抗知识焦虑,从看懂这条开始

App 下载

Google Maps用AI把导航变成交谈中的助手

实时位置服务|出行场景|自然语言交互|AI助手|Google Maps|AI产业应用|人工智能

当你攥着只剩10%电量的手机,在陌生城市的街头急着找地方——你不用先搜充电站、再筛咖啡店、最后翻评论看排队时长。现在对着Google Maps说一句“找个能充电不用排队买咖啡的地方”,3秒内就能得到带实时位置、用户贴士和导航按钮的答案。这不是科幻片里的场景,是2026年3月Google Maps十年来最大更新的日常。它不再是那个只会给你指方向的工具,而是能听懂你所有复杂需求的“出行伙伴”。但这一切的背后,真的只是加了个AI聊天框吗?

从搜关键词到说需求,交互的本质革命

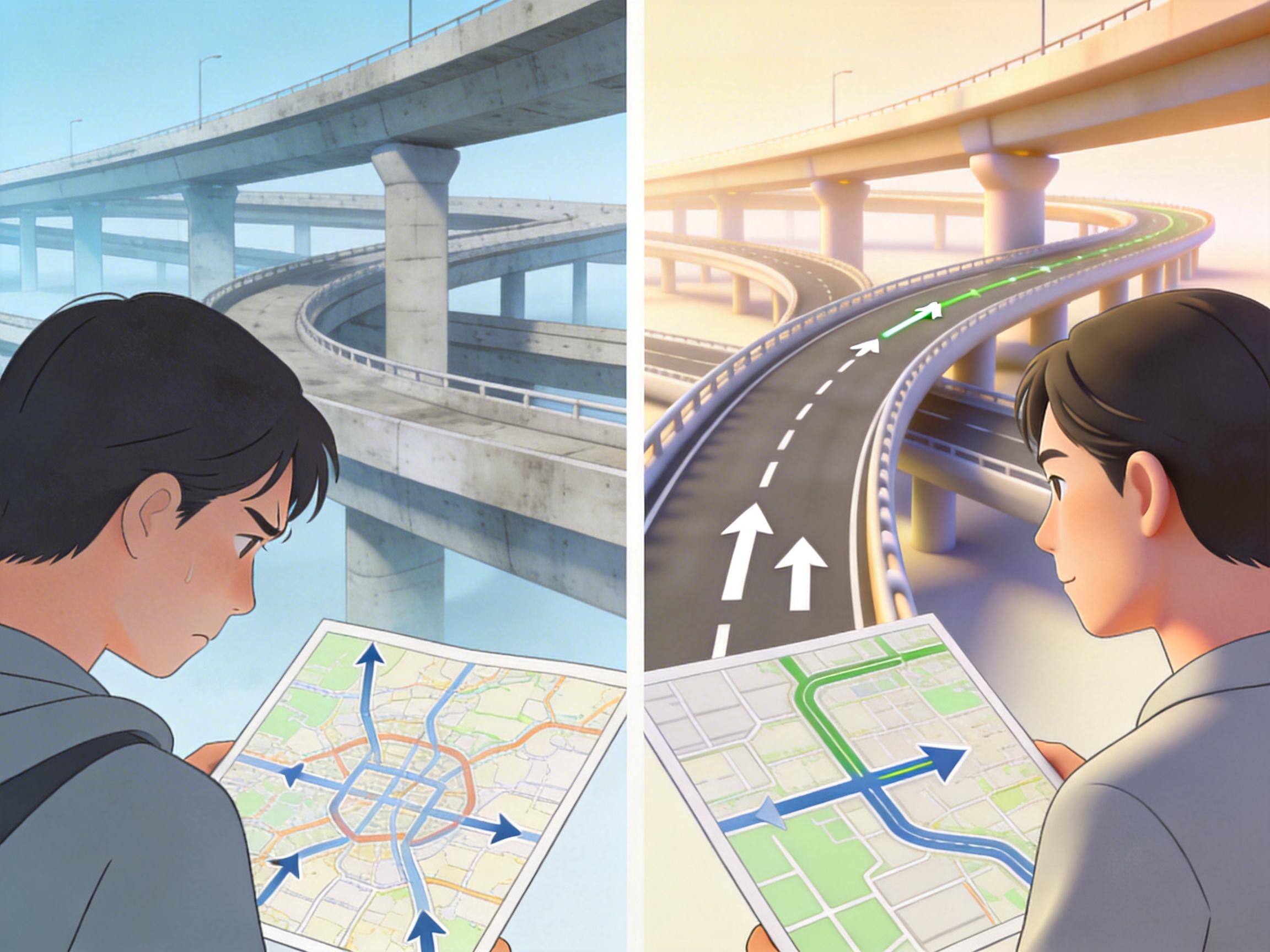

你可以把传统地图的交互比作对着自动售货机按按钮——必须精准选对标签,才能拿到想要的东西。而Ask Maps把这台机器换成了懂你的店员:你说“今晚要和三个朋友在城东碰面,找个7点开门、氛围好的素食餐厅”,它会自动把你的素食偏好、碰面的中间位置、4人桌的需求打包,从3亿个地点里筛出最合适的选项,还能直接在地图里完成预订。 这背后是Gemini大模型的自然语言理解能力在起作用。你可以把它想象成一个同时读了5亿条用户评论、记牢3亿个地点实时状态的超级秘书——它能拆解你句子里的所有隐藏条件:电量焦虑对应的充电站、不想排队对应的实时客流数据、素食偏好对应的历史记录,然后在庞大的数据库里完成交叉匹配。 更关键的是,它实现了从“找信息”到“做决策”的闭环。以前你在地图找到餐厅,得跳转到点评App看评价、再跳转到外卖App预订;现在所有动作都在一个对话里完成,甚至能直接导航过去。

把真实世界“搬”进导航,AI的空间魔法

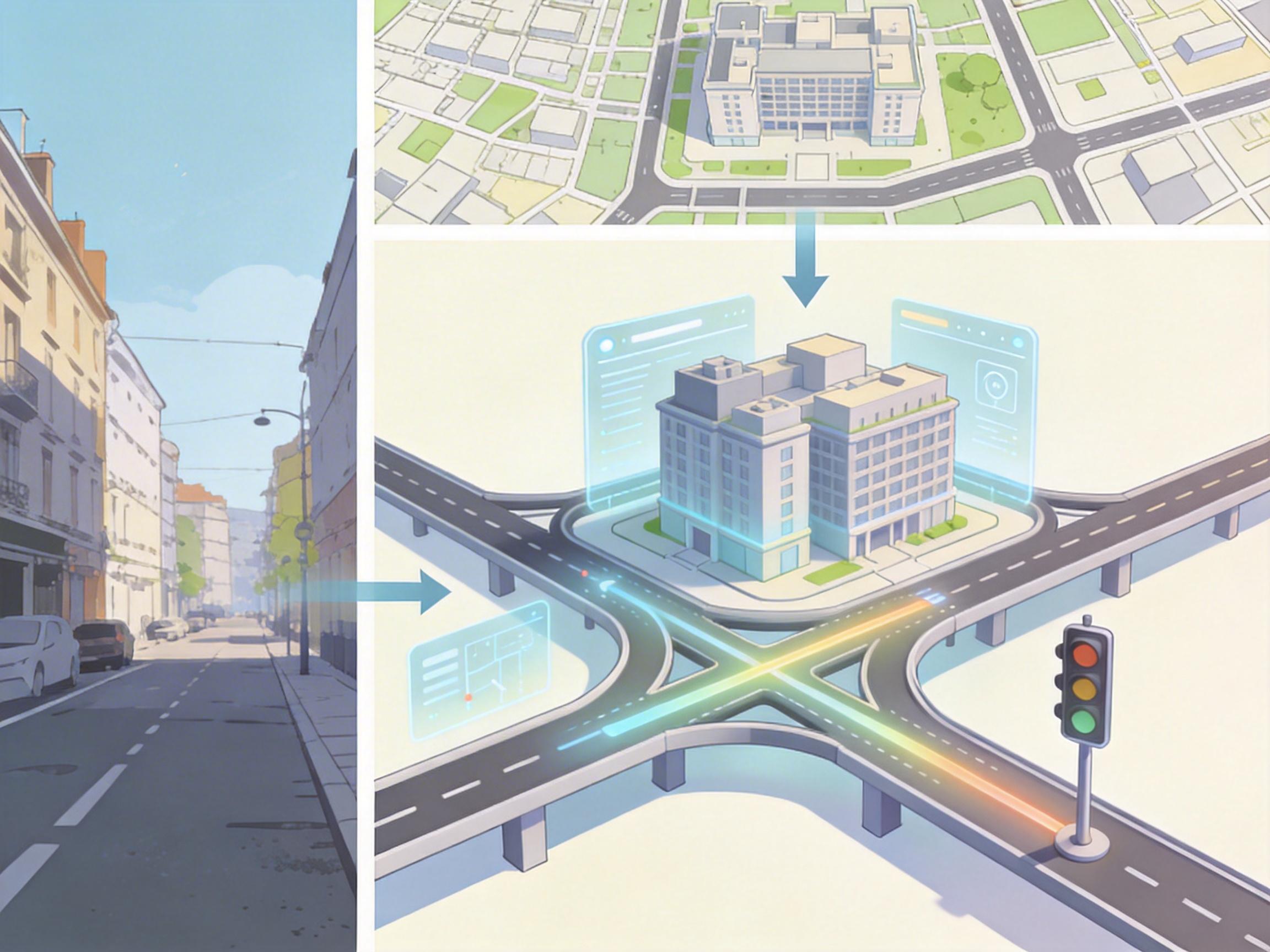

如果说Ask Maps解决了“去哪”的难题,Immersive Navigation则解决了“怎么去”的焦虑。你有没有过在复杂立交桥前盯着2D地图箭头发呆的时刻?“我到底走哪条车道?”“这个出口是不是我的?”现在这些疑问会被一张和真实世界几乎一模一样的3D地图解决。

Gemini在这里的角色是“空间翻译官”——它要把Street View的2D街景照片、航拍的俯视图像,翻译成导航界面里可交互的3D元素。比如它能从一张街景图里识别出建筑的高度、立交桥的分叉、红绿灯的位置,然后在导航时实时渲染出来,还会在你需要并线、转弯时高亮对应的车道。

这不是简单的3D建模,而是AI对空间逻辑的理解。它知道哪些建筑会挡住你的视线,所以会自动把它们做透明处理;它知道你在接近复杂路口时需要提前预判,所以会智能放大那片区域,甚至把语音提示从机械的“500米后右转”改成更像朋友提醒的“过了这个出口,下一个下去走Illinois 43 South”。

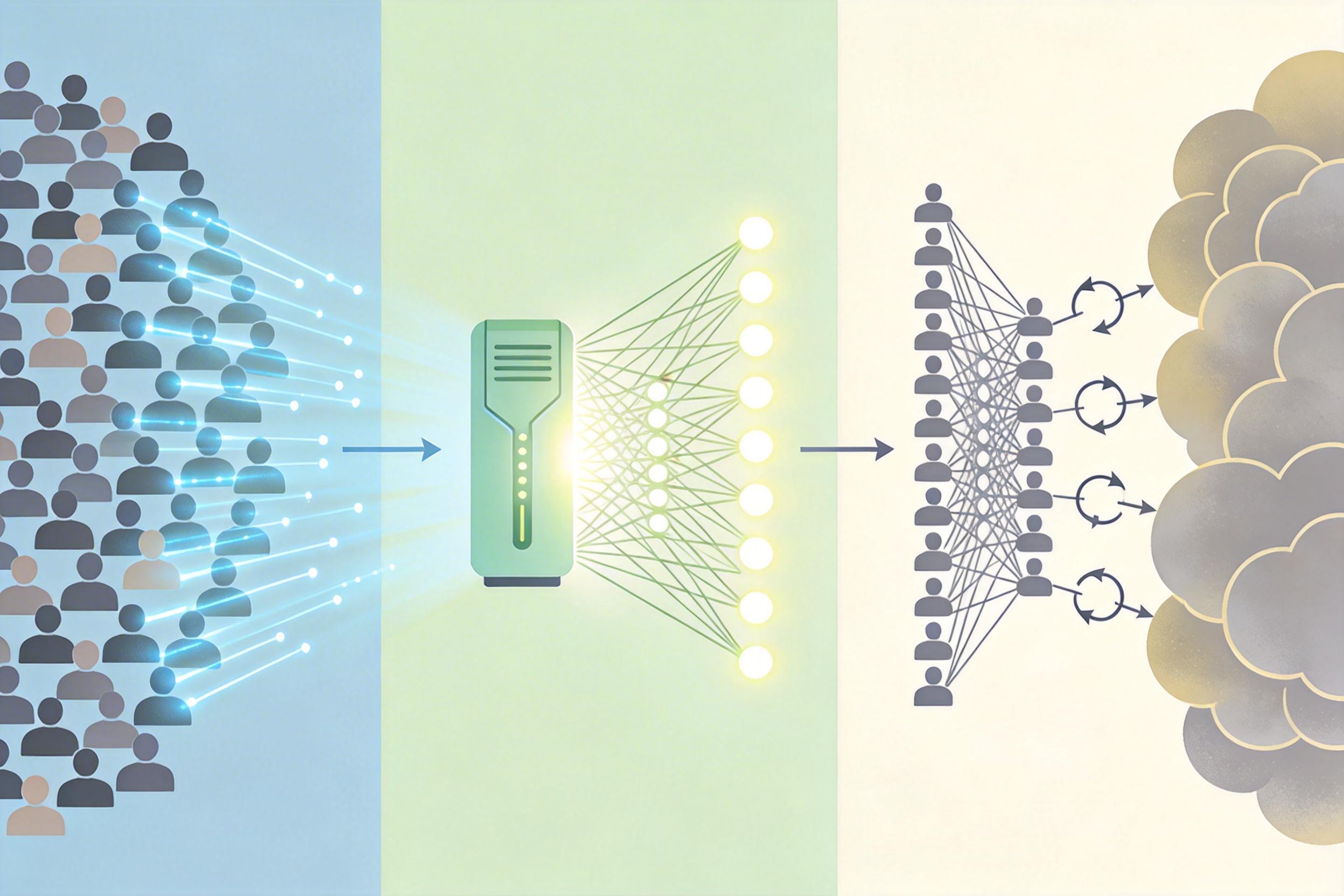

数据飞轮转起来,对手很难追上

我认为这次升级最值得关注的,不是AI功能本身,而是Google Maps背后的数据飞轮——这才是真正的护城河。 你可以把这个飞轮想象成一个滚雪球的循环:20亿月活用户每天产生的搜索、导航、评论数据,喂给Gemini模型让它更精准;更精准的推荐又吸引更多用户,产生更多数据。现在这个雪球已经滚到了3亿个地点、5亿社区贡献者、每秒500万条交通更新的规模。

对比国内的高德、百度地图,或者苹果的Maps,它们或许能在单个功能上追上,但要复制这个数据飞轮太难了。Google的优势不仅在于地图数据,还在于它能整合搜索、YouTube、Android设备等多维度的用户行为数据——比如它能从你平时的搜索记录里知道你爱逛博物馆,在规划旅行路线时自动给你推荐沿途的展馆。 更重要的是,这个飞轮是自我强化的。用户用得越多,AI越懂你;AI越懂你,用户就越离不开它。

当我们谈论这次Google Maps的更新时,其实是在谈论一个信号:地图正在从连接人与地点的工具,变成连接人与生活的入口。它不再只是帮你找路,而是帮你解决“今晚去哪吃饭”“周末去哪玩”“旅行怎么规划”这些具体的生活问题。 未来的地图会是什么样?可能是你刚开口说“我想…”,它就已经帮你规划好了一切;可能是你开车时,它能提前预判前方的交通事故并帮你绕路;甚至可能是你在陌生城市里,它能像当地朋友一样给你推荐只有本地人知道的隐藏景点。 工具的终极形态,是成为人的延伸。 而Google Maps这次的升级,正是朝着这个方向迈出的一大步。