对抗知识焦虑,从看懂这条开始

App 下载

全球AI云集体涨价,读懂「Token计价」与算力新逻辑

API限流|Token计价|算力通胀|AI云厂商|AI产业应用|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

API限流|Token计价|算力通胀|AI云厂商|AI产业应用|人工智能

2026年的春天,AI开发者们突然发现自己陷入了和抢春运票相似的困境:调用大模型API频繁限流,给智能体派的任务半天不动,唯有充值才能恢复正常。从谷歌、亚马逊到国内三家头部云厂商,全球AI云算力集体涨价,最高涨幅达34%。这不是普通的价格调整——它标志着持续数年的「低价算力红利期」彻底结束,AI行业第一次直面真实的算力通胀。为什么云厂商突然不再「亏本赚吆喝」?这场涨价背后,藏着算力供需关系的底层重构,而「Token」这个陌生的计价单位,正是解开所有谜题的钥匙。

你可以把Token理解为AI世界的「计价硬币」——1000个Token约等于750个英文单词,是AI处理文本的最小单位,输入的提示词和输出的结果都要按Token计费。过去两年,开发者习惯了低价甚至免费的Token调用,却忽略了一个关键:Token的价格从未反映真实的算力成本。

高端GPU一卡难求时,云厂商靠补贴维持低价;当多模态应用爆发,单个智能体任务的Token消耗是传统对话AI的百倍以上,供需彻底失衡。这就像菜市场里猪肉已经涨到30元一斤,摊主却还在按10元的价格卖——不是慈善,是为了抢客源。但现在客源抢得差不多了,摊主终于要把价格调回真实成本。

更重要的是,Token的消耗逻辑远比想象中复杂:思路链推理会让Token膨胀数倍,写满冗余代码的任务比清洁代码多消耗50%的Token,甚至提示词里的一句废话,都会变成真金白银的成本。当云厂商不再兜底,这些浪费的Token,终于要由使用者自己买单。

这次涨价不是普涨,而是一场精准的「分层定价」——通用云服务继续降价,AI算力却对重度用户大幅提价。背后是云厂商看清了一个现实:不同用户的算力依赖度,早已拉开了鸿沟。

AI开发者、自动驾驶团队这些重度用户,迁移成本高到离谱:换个云平台,训练好的模型要重新适配,实时推理可能出现排队、限速,业务直接受影响;自建算力集群又拿不到稳定的高端GPU货源,只能被云厂商「锁定」。而中小企业和政企用户对价格敏感,大不了转向自建本地算力池,或者用更便宜的基础云服务。

这就形成了新的供需逻辑:云厂商在价格敏感的大众市场继续打价格战,在高粘性的高端市场掌握定价权。而Token作为计价单位,成了区分用户的「标尺」——消耗越多,对算力的依赖就越强,也就越容易被传导成本压力。

但这种分层也埋下了隐患:当高端算力价格持续上涨,中小开发者可能被挡在创新门外,形成新的「算力鸿沟」。

短期来看,开发者只能接受算力成本上涨的现实,靠优化提示词、缓存重复查询、用小模型处理简单任务来压缩Token消耗。但要从根本上解决算力通胀,还要看「多元异构算力融合」——这是云厂商正在押注的长期解法。

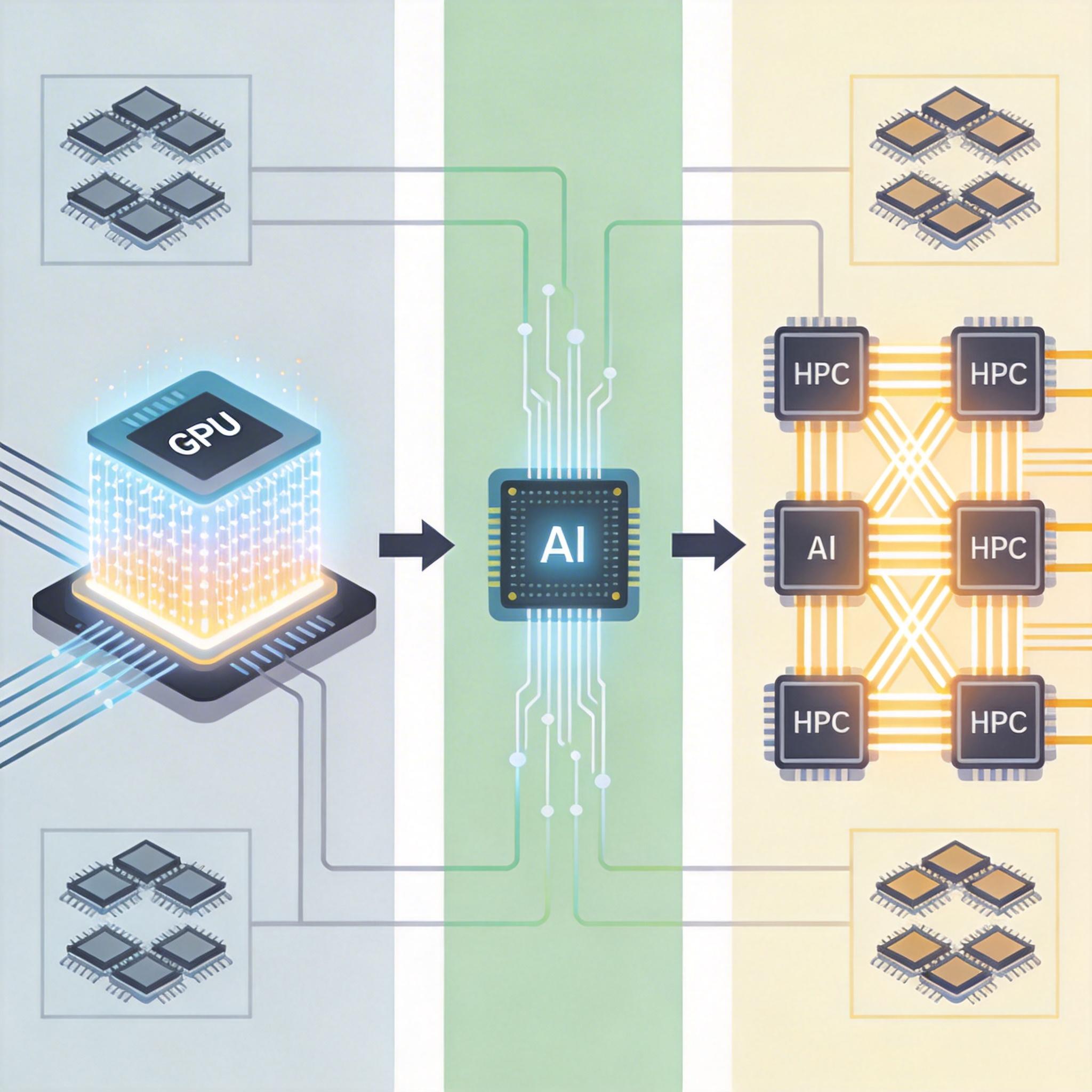

简单说,就是让不同架构的芯片协同工作:用GPU处理复杂的并行计算,用自研的AI芯片做推理,用HPC集群跑高性能计算任务,再通过高速互联网络把它们连起来。比如华为的昇腾芯片和DeepSeek模型联合优化,能达到和英伟达芯片相当的性能;谷歌的TPU集群,靠专用互联技术把数千颗芯片紧密耦合,大幅提升算力利用率。

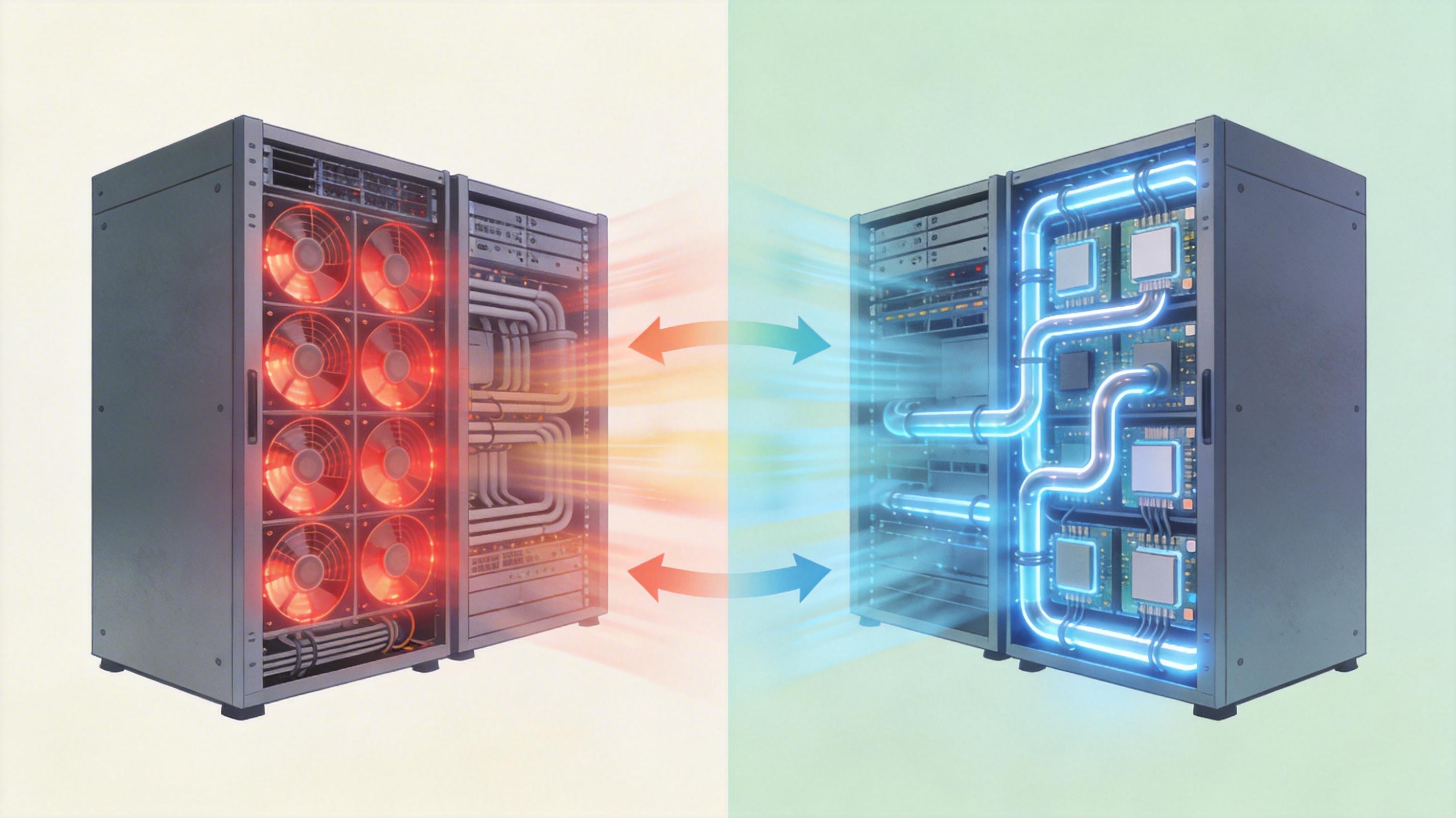

液冷技术也成了关键支撑——传统风冷已经扛不住单机架135kW的热负载,而直达芯片的液冷系统能把数据中心的PUE(能源使用效率)降到1.2以下,既降低能耗成本,又能容纳更高密度的算力。这些技术不是为了追求极致性能,而是为了让每一份算力都用在刀刃上,从源头抑制成本上涨。

这场AI云涨价,本质是算力市场的「挤泡沫」——过去靠低价催生的无效算力消耗,终于要被真实成本约束。开发者们开始像抠水电费一样抠Token,企业开始重新核算AI的投入产出比,这未必是坏事:它会倒逼整个行业从「拼算力规模」转向「拼算力效率」。

算力不是无限的廉价资源,而是需要被高效利用的生产资料。「Token计价」让算力的消耗变得透明,「异构算力」让算力的供给变得多元,当价格回归真实成本,AI行业才能走得更稳。毕竟,靠补贴烧出来的繁荣是虚的,靠效率堆出来的增长才是实的。