对抗知识焦虑,从看懂这条开始

App 下载

舱驾融合:汽车从代步工具变智能伙伴

智能汽车|驾驶辅助系统|智能座舱|舱驾融合技术|AI产业应用|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

智能汽车|驾驶辅助系统|智能座舱|舱驾融合技术|AI产业应用|人工智能

当你刚坐进车里,座椅自动调到你习惯的角度,空调开启常选的24度,导航默默规划好避开早高峰的路线——这不是科幻片里的场景,而是舱驾融合技术正在实现的日常。简单说,它就是把车内的智能座舱和驾驶辅助系统彻底打通,让车不再是只会执行指令的机器,而是能读懂你状态、预判你需求的伙伴。2026年这项技术的量产落地,为什么会被看作智能汽车的关键转折点?我们得从它的核心逻辑说起。

你可以把传统汽车的座舱和驾驶系统想象成两个各干各活的部门:座舱管娱乐、导航、座椅调节,驾驶辅助管跟车、避障、车道保持,偶尔通过简单信号打个招呼,大部分时候互不干涉。

舱驾融合要做的,就是把这两个部门合并成一个高效团队。它靠一块能同时处理座舱和驾驶任务的高性能SoC芯片做基础——比如3纳米制程的芯片能提供超1000K DMIPS的计算能力,还能通过芯粒技术扩展3到4倍算力。硬件上的融合只是第一步,真正的关键在软件:通过虚拟化技术和统一的AI操作系统,让娱乐、导航这些非关键功能,和制动、转向这些安全关键任务共享资源却互不干扰,就像同一间办公室里,有人在做创意策划,有人在处理财务报表,各自专注又能随时配合。

最直观的改变在感知层面:以前座舱只盯着你的指令,驾驶辅助只盯着车外路况;现在它们会一起收集数据——座舱的摄像头监测你是否疲劳,驾驶辅助的雷达盯着前方的行人,这些信息会被统一送到AI模型里分析,一旦发现你眨眼频率变高,系统会自动打开车窗透风,同时让驾驶辅助保持更安全的跟车距离。

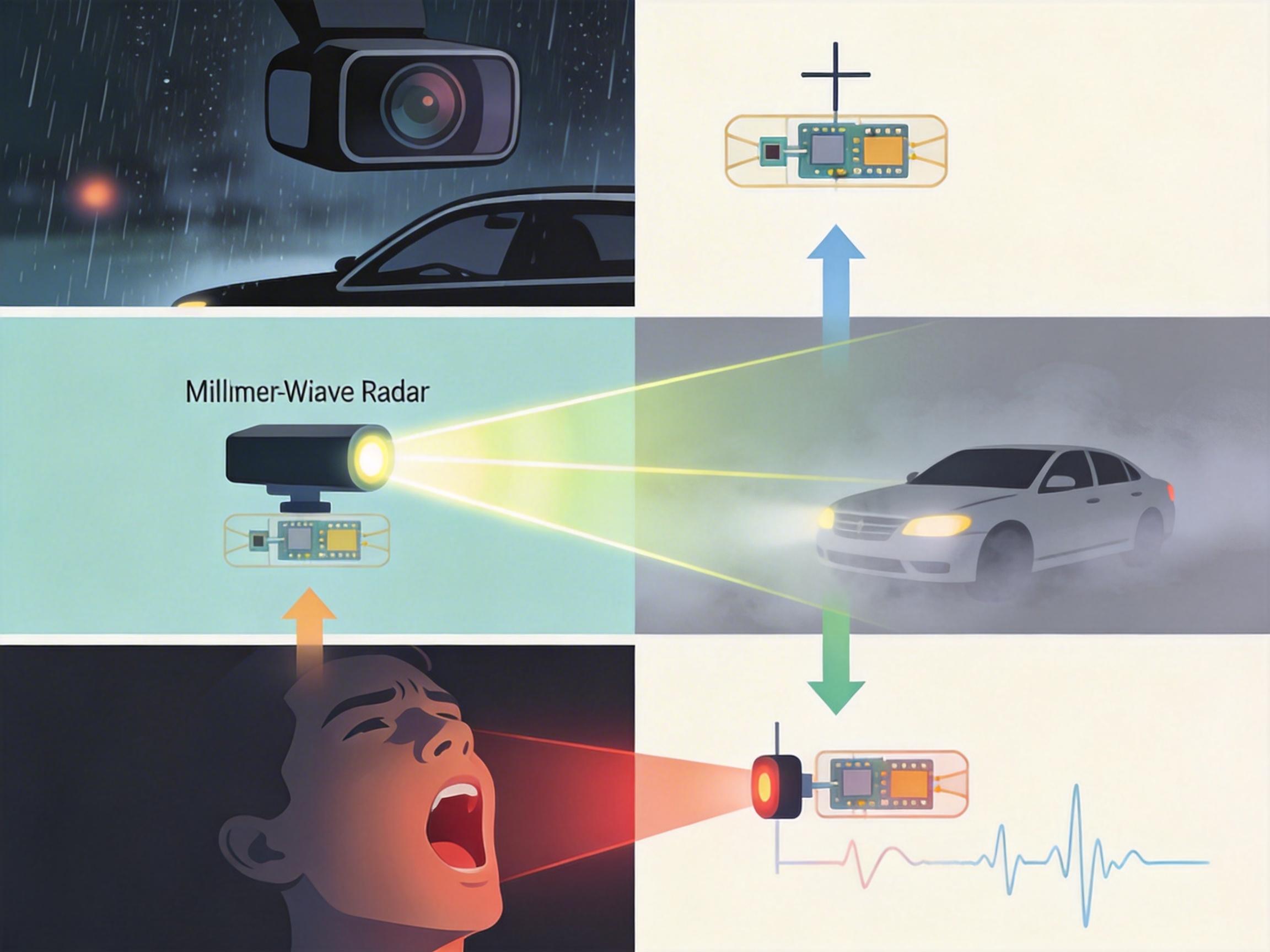

要让车真正懂你,单靠一种传感器远远不够。就像我们自己感知世界要靠眼睛、耳朵、皮肤一起配合,舱驾融合的核心是多模态传感器的协同工作。

摄像头是车的“眼睛”,能捕捉你脸上的表情、手势,识别路边的交通标志,但到了晚上或者暴雨天就会“视力下降”;毫米波雷达是车的“触觉”,能穿透黑暗和雨雾,精准测出前方车辆的距离和速度,还能监测你细微的呼吸、心跳,甚至发现被遗忘在后排的孩子;红外传感器是车的“夜视仪”,在昏暗的地下车库也能看清你是否在打哈欠。

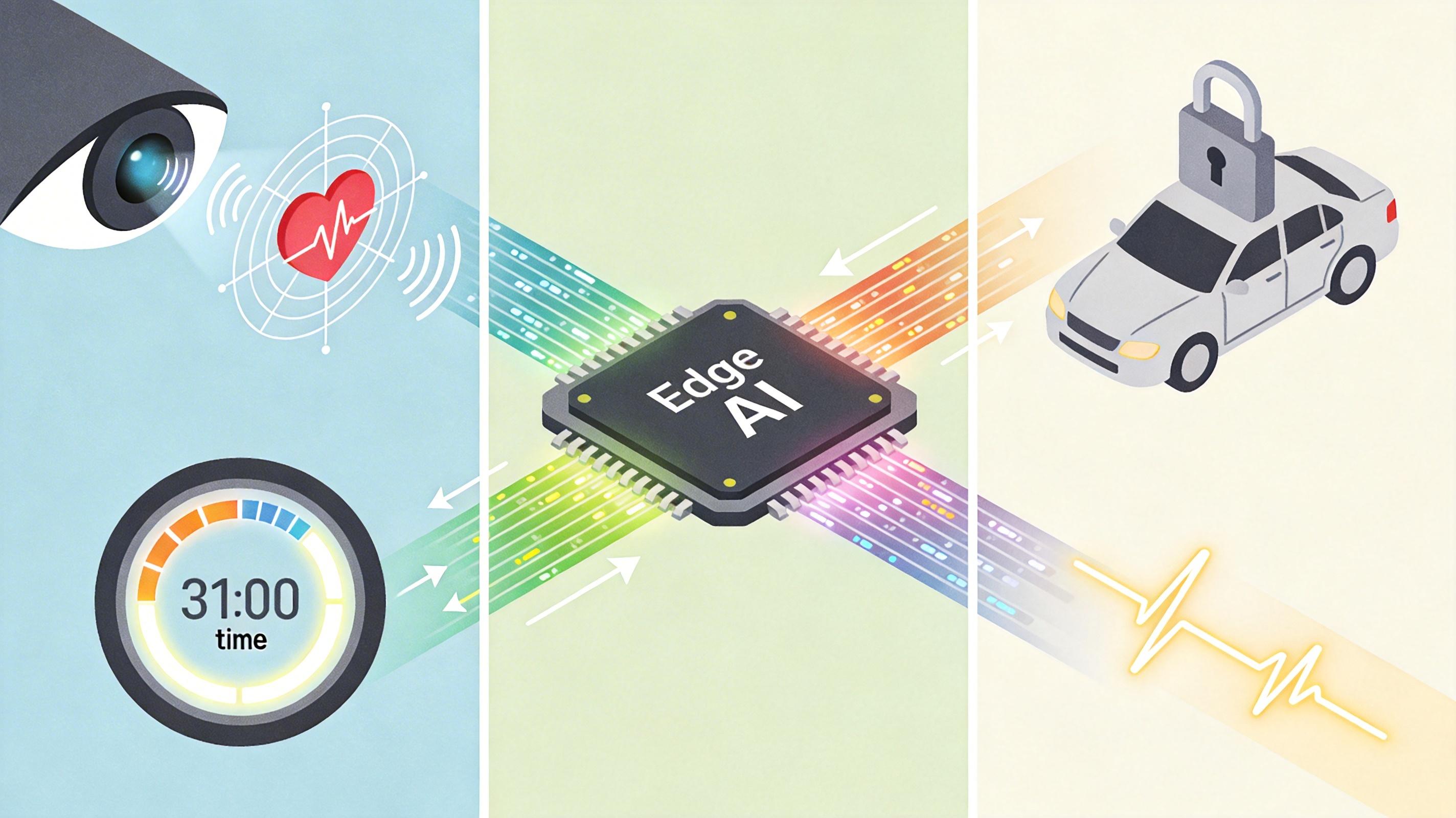

这些传感器的数据不会各自为政,而是会在边缘AI芯片里实时融合。比如判断你是否疲劳,系统会同时参考摄像头捕捉的眨眼频率、雷达监测的心率变化,再结合你连续驾驶的时长,综合给出判断,准确率能超过95%。而且这一切都在车里本地完成,不用把你的隐私数据传到云端,既保证了响应速度,也守住了隐私边界。

当然这也带来了挑战:不同传感器的数据格式、更新速度都不一样,就像让说不同语言的人一起开会,得先统一翻译标准。工程师们靠深度学习模型解决这个问题,它能自动提取不同数据里的关键特征,再把它们拼成完整的“认知拼图”。

舱驾融合的最终目标,是让车从“被动响应指令”变成“主动提供服务”,这就得靠AI智能体来实现。

这个智能体就像车里的一个智能管家,它会记住你的所有习惯:你早上喜欢听新闻,下午下班爱听民谣;你开车时不喜欢被打扰,导航只会在关键路口说话;你有腰伤,座椅会自动调到支撑最舒服的角度。更重要的是,它会根据场景主动做事——比如看到你上车时眉头紧锁,它会播放你常听的舒缓音乐;如果导航显示前方要经过医院,它会自动把车内音量调小。

这种主动服务的背后,是大模型和边缘计算的结合。7亿参数的边缘端大模型能在车里本地处理复杂的语义理解,不用等云端的响应;同时它会通过“影子模式”持续学习你的行为,比如你上周三次在同一个路口选择绕行,它下次就会主动给你推荐这条路线。

不过目前它还有局限:面对极端复杂的场景,比如你突然因为身体不适需要紧急停车,它的反应速度和决策准确性还需要进一步验证。而且统一的跨品牌服务标准还没建立,你换一辆车,可能又得重新设置所有习惯。

从最早的手动挡汽车,到后来的智能座舱,再到现在的舱驾融合,汽车的进化一直围绕着“人和车的关系”。以前人是车的操控者,后来人是车的指令发出者,而现在,车正在变成人的伙伴。

舱驾融合不是简单的技术叠加,它是把“以车为中心”变成“以人为中心”的开始。未来的智能汽车,会像你身边最懂你的朋友,不用你说太多,就知道你需要什么。

懂你的车,才是真正的智能汽车。