对抗知识焦虑,从看懂这条开始

App 下载

给细线做AI分割,这次终于不“断线”了

流匹配方法|薄结构分割|伊利诺伊大学厄巴纳-香槟分校|FMS2框架|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

流匹配方法|薄结构分割|伊利诺伊大学厄巴纳-香槟分校|FMS2框架|多模态视觉|人工智能

桥梁上一道头发丝粗的裂缝,能决定整座桥的安全;医学影像里一根断裂的毛细血管,可能误导医生的诊断。但过去几十年,AI给这些“薄结构”做分割时,总像个手抖的新手——要么把连续的线切得七零八落,要么要花天价人工标注,换个拍摄场景就直接“失明”。2026年3月,伊利诺伊大学厄巴纳-香槟分校的团队拿出了FMS2框架,只用一个统一思路,就把这三个老大难问题一起解决了:平均分割精度提了17.2%,拓扑错误率砍了37.3%,甚至只用25%的真实标注,就能追平全量数据的效果。这背后的关键,是把“分割”这件事,彻底换了个思路。

你可以把传统分割模型想象成一个只会看单个像素的猜谜者——它逐个判断“这个像素像不像裂缝/血管”,却完全不管像素之间的连接关系。就像拼拼图时只看每块的颜色,不管边缘能不能对上,拼出来的自然是碎成渣的细线。

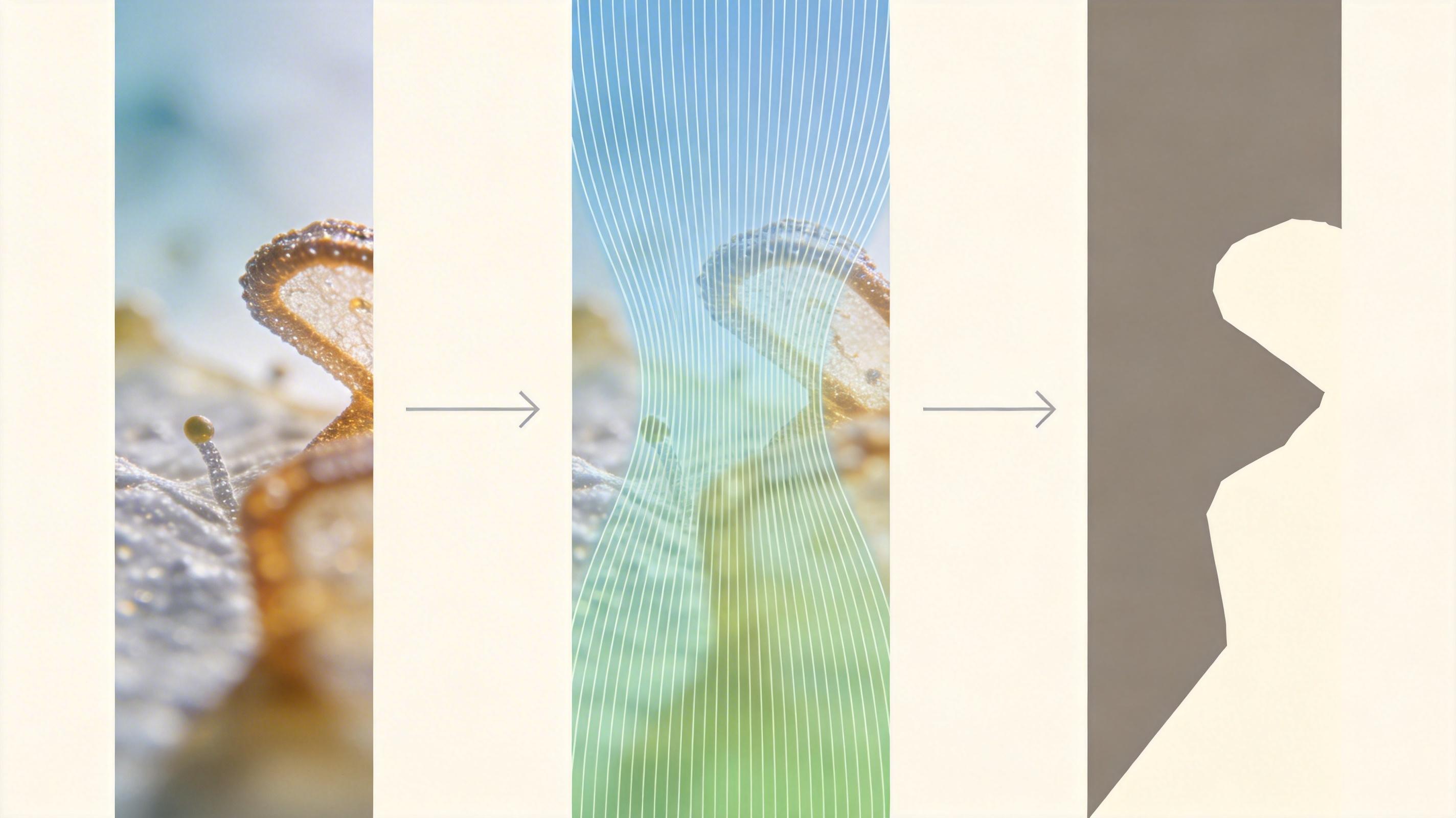

FMS2的SegFlow模块把这件事彻底推翻了:它不再让AI猜单个像素,而是让整个图像“流动”起来。从输入图像(t=0)到最终的分割掩码(t=1),AI要学习每个时刻的“速度场”——就像给每个像素安排好移动路线,让它们一步步从原图“流”到目标分割结果。

训练时,它用的是一种“轨迹级监督”:不是只检查最后拼出来的图对不对,而是监督每一步的流动方向是否正确。比如,要让图像里的裂缝从模糊到清晰,每个像素的移动路径必须连续,一旦中间某步断了,后续的速度场就必须“修复”这个断裂——这相当于把“保持连通”刻进了AI的本能里,根本不用额外加什么拓扑约束。

更聪明的是,它还加了个“自条件机制”:AI在规划当前像素的移动方向时,会先看一眼自己上一步画的草稿,用全局的结构信息来修正局部决策,就像画画时先打轮廓再填细节,自然不会把线画断。

薄结构分割的第二个噩梦是标注——要让人工在成千上万张图里描出所有一两个像素宽的细线,不仅成本高到离谱,不同标注员画的线还粗细不一,AI学起来只会更困惑。

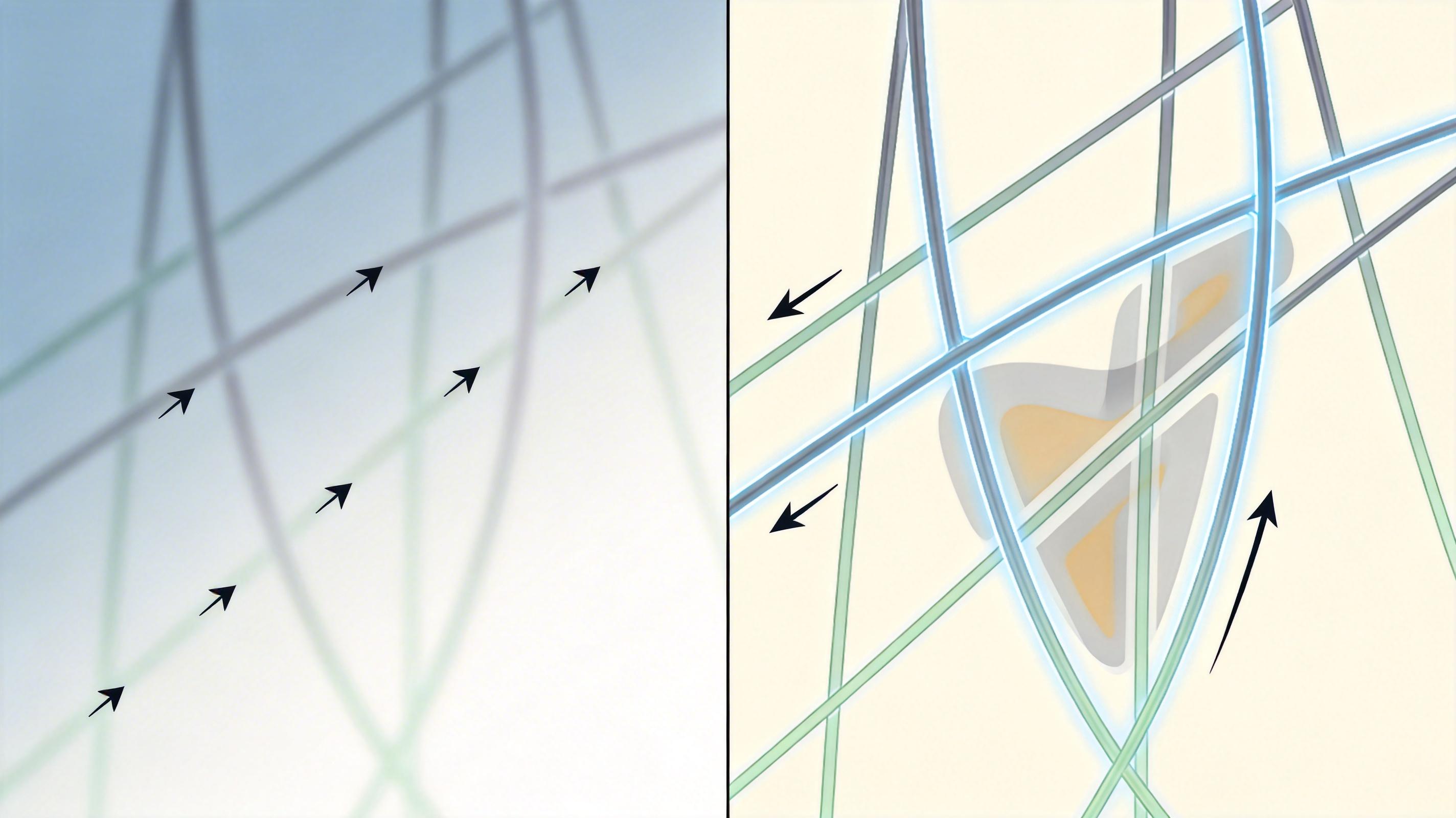

FMS2的SynFlow模块刚好补上了这个缺口:它是一个“以形生图”的生成器,给它一个裂缝或血管的掩码,它就能生成一张像素级对齐的真实图像。关键是,它解决了生成模型最容易犯的错:不会把细线“画歪”。

传统的生成模型在处理细线时,很容易在多次缩放中把结构信息弄丢——就像你反复复印一张细线图,最后线会变得模糊甚至消失。SynFlow专门设计了拓扑感知掩码注入(TAMI)模块:一方面用多尺度注入,在网络的每一层都保留掩码的结构信息;另一方面用边界门控,让AI把计算资源集中在最容易出错的细线边界上,确保生成的图像和输入掩码严丝合缝。

更厉害的是,它还能生成各种形态的薄结构——更密的裂缝网、更细的血管、更多的分支。只用25%的真实标注数据,再配上64倍的合成数据,SegFlow的性能就能接近用100%真实数据训练的效果,直接把标注成本砍了四分之三。

当然,FMS2也不是完美的。它的推理速度比传统模型慢——因为要一步步“流动”生成结果,相当于把模型跑10到20次,对实时性要求极高的场景比如视频巡检,目前还不太适用。而且,SynFlow生成的数据质量高度依赖训练集,如果真实数据太少、场景差异太大,生成的样本可能也会“走形”。

但它的核心价值,在于跳出了“卷网络结构”的老路,从问题的根源入手解决了三个核心痛点:

在五个主流的裂缝和血管数据集上,它的表现碾压了传统的U-Net、Transformer甚至Mamba模型——平均mIoU提升17.2%,拓扑错误率降低37.3%,这些数字都是实打实的突破。

从像素级分类到连续流匹配,FMS2的本质是让AI从“看局部”变成了“看全局”。它没有在模型参数上堆料,而是换了一种更符合薄结构本质的思路——毕竟,细线的核心从来不是单个像素,而是像素之间的连接。

未来,它或许能用到更多领域:从电网的电线巡检到芯片的电路检测,从神经纤维的医学分析到道路网络的自动提取。这些场景里,“连通性”都是命门,而FMS2已经找到了打开这扇门的钥匙。

好的技术,从来不是解决复杂问题,而是让复杂问题变简单。