对抗知识焦虑,从看懂这条开始

App 下载

AI越聪明,我们越不懂它在做什么

挑战者号事故|理查德·费曼|系统透明性|AI黑箱问题|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

挑战者号事故|理查德·费曼|系统透明性|AI黑箱问题|大语言模型|人工智能

1986年1月,美国挑战者号航天飞机升空73秒后爆炸,7名宇航员全部遇难。调查委员会里,身患癌症的理查德·费曼没有坐在会议室听官僚们念报告,而是找工程师要了一块O型密封圈——就是那个被NASA管理层忽略的零件。他把密封圈泡进冰水里,再拿出来轻轻一掰,橡胶硬得像块塑料。

这个10秒的实验,戳破了所有冠冕堂皇的安全说辞。30年后的今天,当我们对着能写论文、诊疾病的AI惊叹时,费曼的冰水实验像一根针,扎破了我们对技术的盲目信任:我们真的懂这些系统在做什么吗?

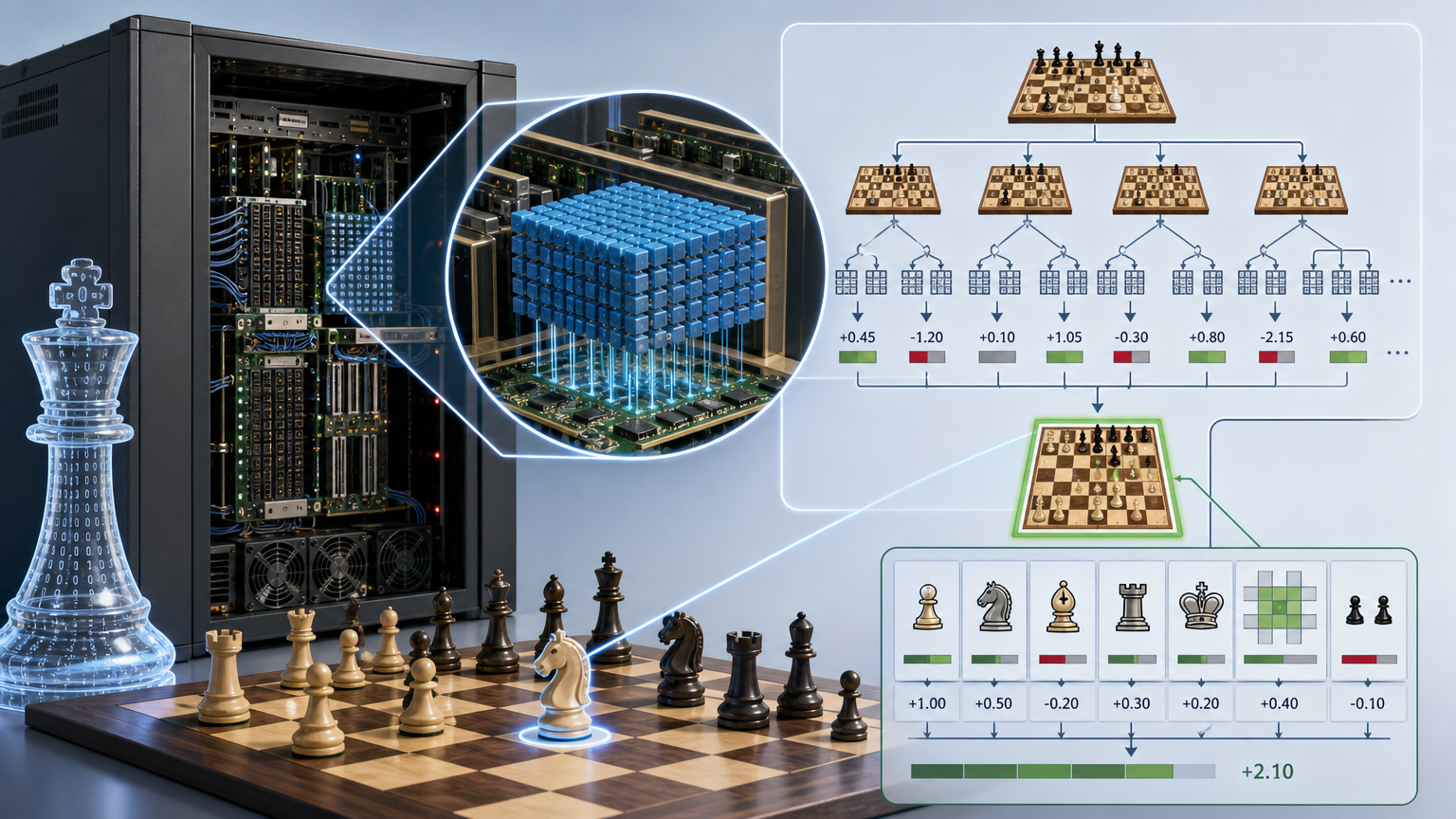

1997年击败国际象棋冠军的深蓝,是个敞亮的“白箱”——它的每一步决策都基于明确的规则:计算35亿种可能走法,用预设的评分函数选出最优解。程序员能清晰追踪它的思考路径,甚至能告诉你它为什么选了这步棋。

2012年,AlexNet横空出世。这个8层的卷积神经网络,用6000万个参数把图像识别错误率砍了一半,也把AI推进了黑箱时代。没人能说清它是怎么认出猫的——不是通过“有耳朵、有尾巴”的规则,而是通过数百万个神经元对像素的非线性映射。就像你能认出朋友的脸,却没法说清是哪条皱纹、哪个眼神帮你做了判断。

到了GPT-5,数万亿参数的模型在黑暗里自己演化出了语言逻辑。它能写出流畅的法律文书,却会在简单的算术题上出错;它能诊断罕见病,却没法解释为什么得出这个结论。开发者们能调整它的参数,却看不懂它的“思维”。

这不是技术复杂度的问题,而是本质的转变:从“规则驱动”到“数据驱动”,AI不再是人类逻辑的延伸,而是在数据里长出的陌生智能。

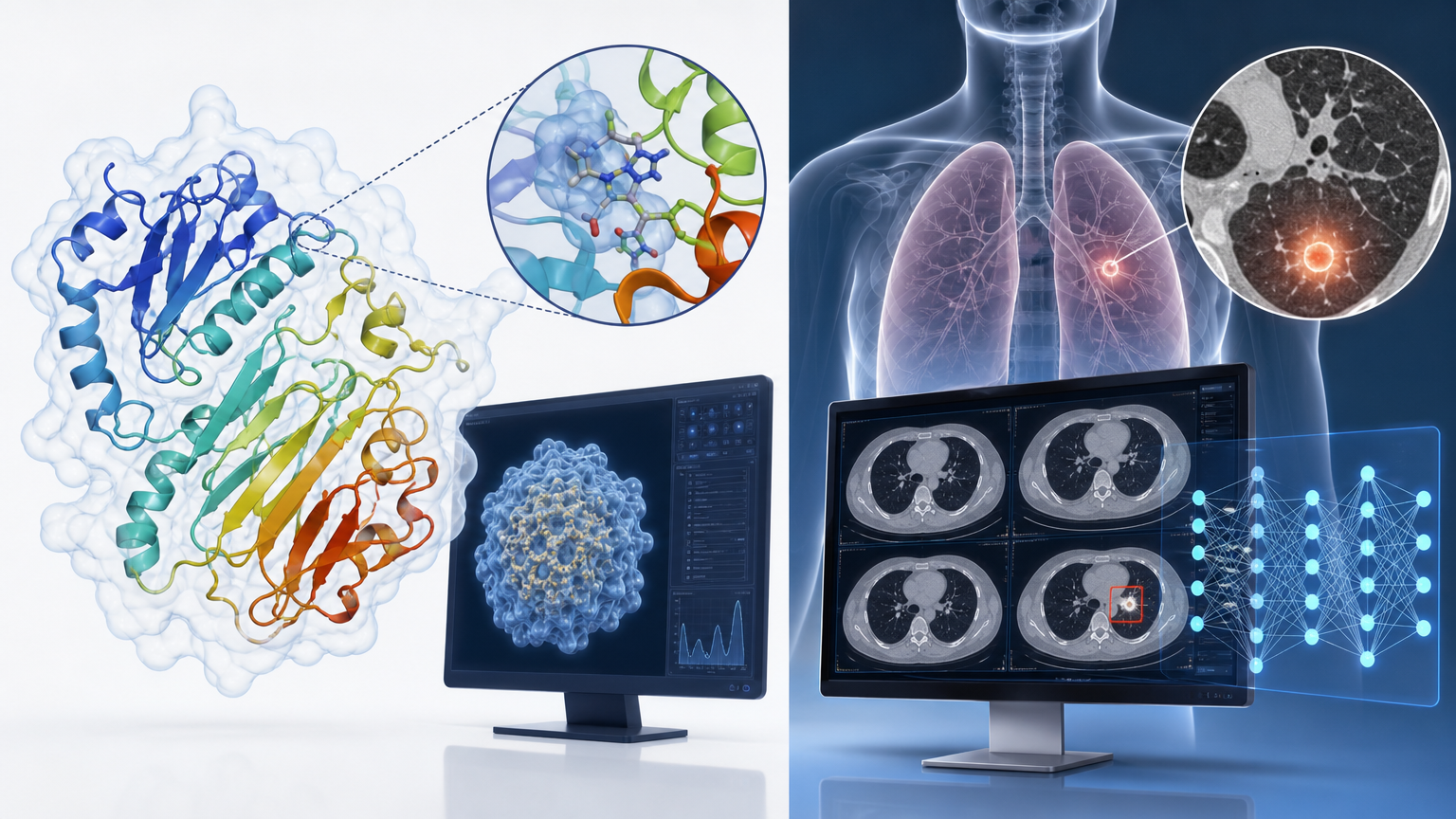

AlphaFold能预测98%的蛋白质结构,精度超过人类科学家;AI能从CT片里揪出早期肺癌,准确率比资深医生还高。这些耀眼的成绩,让我们很容易把“预测准确”等同于“理解深刻”。

但斯坦福和哈佛的研究给了我们一盆冷水:顶尖医疗AI给出的建议里,12%到22%是“有害的”——比如把哮喘患者判定为低风险,理由是“数据里哮喘患者住院率更高,说明他们恢复得快”。它没理解因果:不是哮喘患者恢复快,而是他们一发病就被送进ICU,所以住院率高。

这就是费曼说的“草包族科学”——南太平洋岛民模仿美军修跑道、插木杆,以为这样飞机就会送来物资。我们用AI做出了准确的预测,却像岛民一样,不知道背后的真正逻辑。

科学的核心是理解“为什么”,而AI只给我们“是什么”。它能找到数据里的相关性,却分不清因果关系;它能模仿科学的结果,却学不会科学的精神——那种不断怀疑、不断验证的诚实。

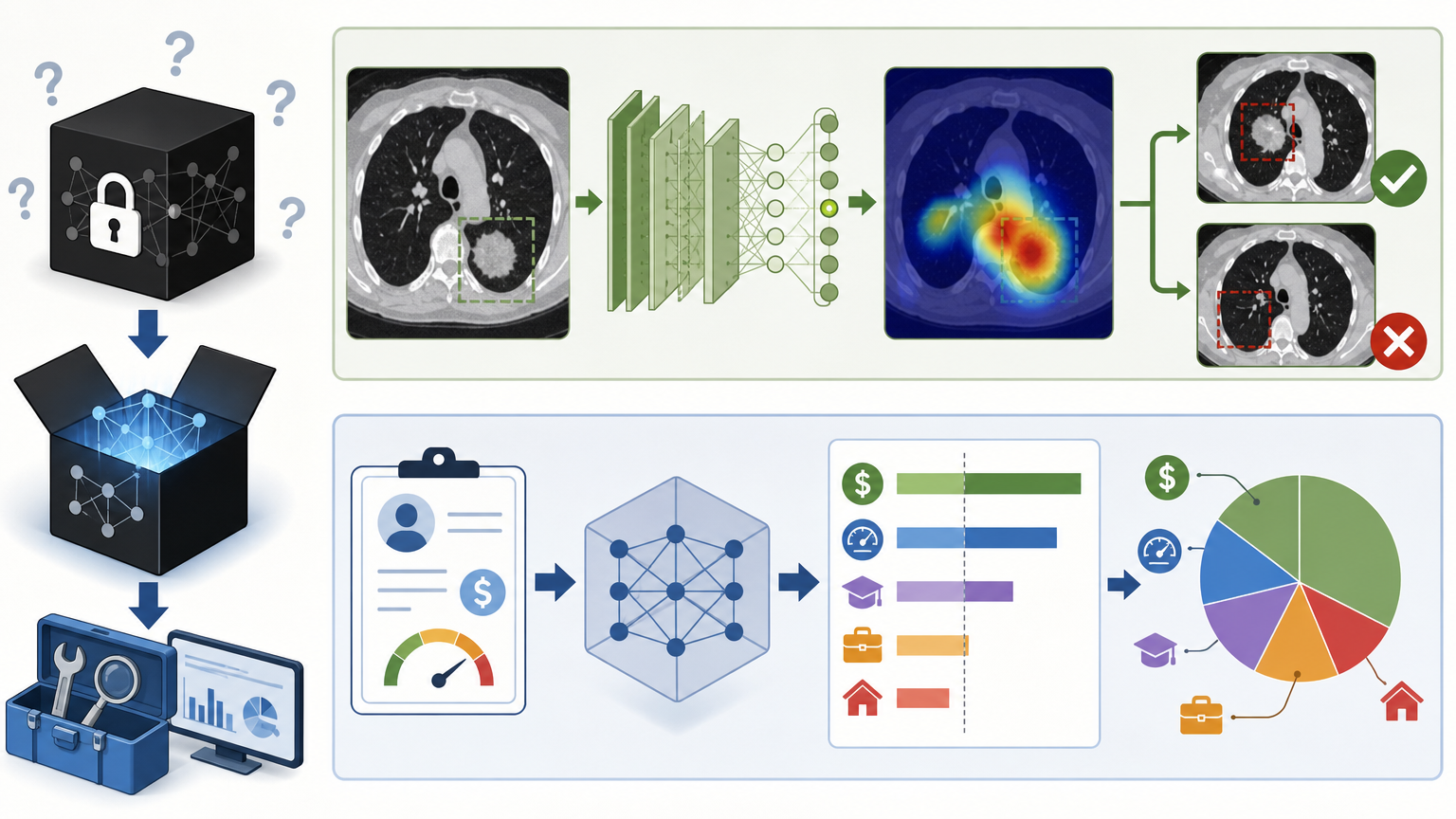

为了撬开AI的黑箱,科学家们发明了各种工具。Grad-CAM能画出AI看图像时的“注意力热力图”,告诉你它是盯着肿瘤还是背景里的阴影;SHAP值能量化每个输入特征对输出的影响,比如在贷款审批里,收入和信用评分各占了多少权重。

但这些方法都有局限。热力图能告诉你AI“看”到了哪里,却没法告诉你它“想”了什么;SHAP值能拆解单个决策,却没法解释整个模型的逻辑。就像你能看到朋友的表情,却没法完全读懂他的心思。

更棘手的是,解释本身也可能是“伪透明”。LIME能给每个预测生成一段自然语言解释,但研究发现,它会编造不存在的理由——比如判定一个人不能贷款,理由是“年龄太大”,实际却是因为训练数据里年龄大的人违约率高。

欧盟的AI法案已经生效,要求高风险AI必须提供“清晰且有意义的解释”。但监管者很快发现,他们面临着费曼说的“规范差距”:你没法用模糊的规则,去约束一个更模糊的系统。

费曼在黑板上写下过一句话:“凡是我不能创造出来的,我就不理解。”这句话不是要求我们亲手造出AI,而是要求我们保持一种诚实的怀疑——不要因为AI能给出答案,就停止追问“为什么”。

AI是一把钥匙,既能打开科学发现的天堂之门,也能关上人类理解的窗。它的聪明,不应该成为我们放弃思考的理由;它的黑箱,也不应该成为我们盲目信任的借口。

真正的智能,从来不是机器能做什么,而是人类能清醒地知道,我们不知道什么。