对抗知识焦虑,从看懂这条开始

App 下载

AI代理不再只是工具,成了你的全职协作者

自主智能|品牌营销自动化|自由职业者自动化|智能协作者|AI代理|AI智能体|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

自主智能|品牌营销自动化|自由职业者自动化|智能协作者|AI代理|AI智能体|人工智能

当自由职业者还在对着银行流水抓耳挠腮,AI已经能自动挖出每年平均1249美元的隐藏税务扣除;当品牌营销团队还在手动筛选达人,AI代理已经能基于历史ROI自动完成从匹配到投放的全流程闭环。2026年春,一批AI产品集中亮相,它们不再是只会执行指令的静态工具——而是能理解上下文、自主规划任务、甚至跨系统协作的智能协作者。这场从「工具」到「伙伴」的转变,背后是AI代理与多模态模型的深度融合,正在重塑智能自动化的技术链条。但这一切是如何实现的?我们离真正的「自主智能」还有多远?

你可以把多模态模型理解成AI的「全感官系统」——它不像传统AI只能看懂文字,而是能同时处理文本、图像、语音、视频甚至基因数据,就像人类用眼睛看、耳朵听、嘴巴说一样感知世界。

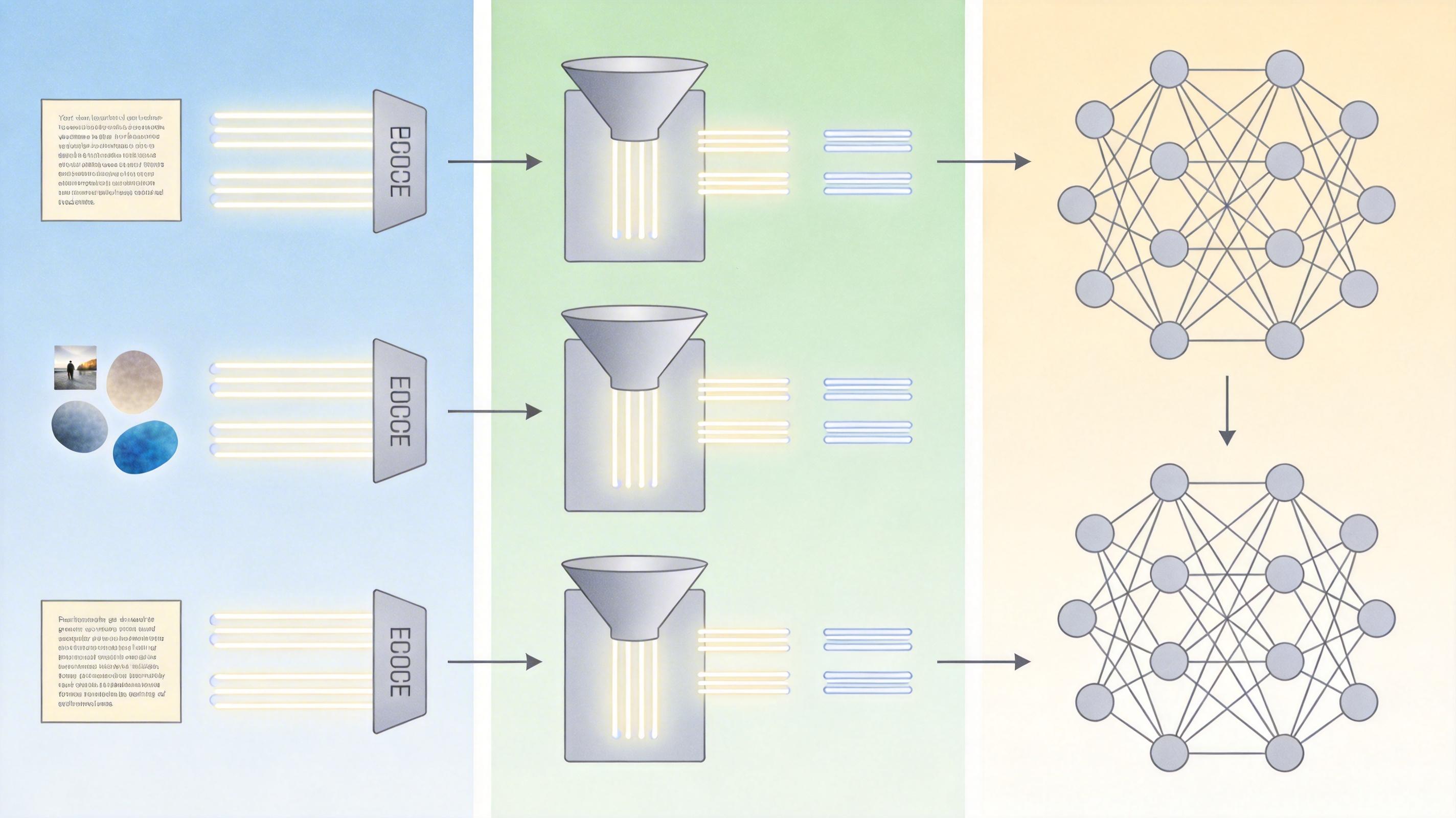

它的工作逻辑分三步:先用专用编码器把不同类型的数据转换成统一的「语义语言」,比如用BERT处理文本、ViT处理图像,让文字和图片都变成相同维度的数字向量;再通过门控注意力机制过滤冗余信息,精准对齐跨模态特征——比如把图片里的「咖啡杯」和文字里的「办公耗材」对应起来;最后用图卷积网络挖掘特征间的隐藏关联,让AI能理解「咖啡杯」和「办公扣除项」之间的逻辑关系。

这种全感官能力,让AI代理终于能跳出「指令执行者」的角色,变成「任务理解者」。比如税务AI能同时识别银行流水的数字、发票的图片、甚至语音记录的办公支出,自动归类到对应的报税项目里,准确率能达到96%。

过去AI要处理复杂任务,必须依赖云端的大模型——数据传上去,结果传下来,不仅延迟高,还存在隐私泄露风险。但现在,本地部署正在成为新的趋势,核心就是让AI在你的设备上直接完成推理。

这背后是模型压缩技术的突破:通过量化把32位的模型权重压缩到4位,体积缩小到原来的1/8;通过剪枝砍掉对结果影响极小的神经元,让模型变得更「轻盈」。比如Google的Gemma 4系列,最小的2B参数模型能在手机上流畅运行,还支持图像、音频等多模态输入;Ollama v0.19针对Apple Silicon优化后,推理速度提升了58%-60%,解码速度直接翻倍。

本地部署的好处显而易见:敏感数据不用离开设备,彻底解决隐私问题;没有网络延迟,AI代理能实时响应你的需求;长期来看,还能省下一大笔云端API调用费用。但它也有局限——本地设备的算力毕竟有限,复杂的多代理协作任务,还是需要云端和边缘设备的协同。

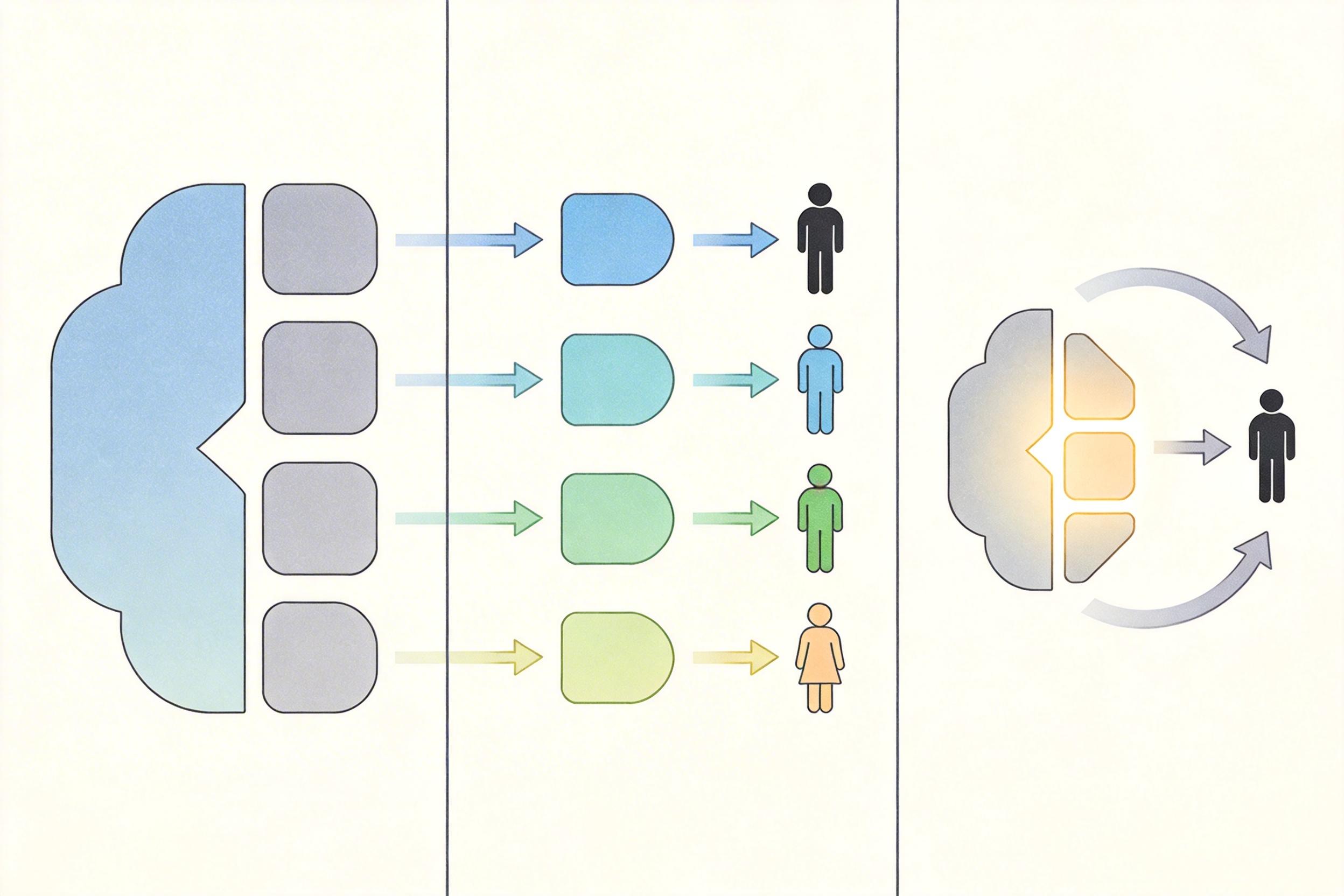

当单个AI代理能完成单一任务,多代理协作就能解决复杂的系统性问题——这就像一个分工明确的团队,有人负责收集信息,有人负责分析,有人负责执行。

AI代理的协作靠的是「任务分解+动态调度」:先把复杂目标拆成多个子任务,比如「完成报税」可以拆成「导入流水」「分类交易」「挖掘扣除项」「生成报表」;再根据每个代理的「专业能力」分配任务,比如让税务代理处理分类,让文档代理生成报表;最后根据任务执行的反馈,动态调整策略——如果发现某个交易分类错误,就自动让代理重新学习对应的规则。

但多代理协作也带来了新的安全挑战:代理间的数据共享可能导致敏感信息泄露,被攻击的代理可能会执行恶意操作。这就需要建立零信任的安全架构,给每个代理设置严格的权限,实时监控它们的行为,确保每一步操作都可追溯、可审计。

当AI代理能自动帮你报税、筛选达人、管理工作流,我们突然发现,智能自动化已经跳出了「替代人类劳动」的框架,变成了「延伸人类能力」的工具。它不是要抢走你的工作,而是要帮你把那些重复、繁琐、消耗精力的事情处理掉,让你能专注在更有创造性的工作上。

技术的迭代永远比我们想象的更快,但真正决定AI价值的,从来不是它的能力有多强,而是我们如何用它来解决真实的问题。智能的本质,是让工具懂你,而非你懂工具。 未来已来,只是还没完全普及——而那些先学会和AI协作的人,已经走在了前面。