对抗知识焦虑,从看懂这条开始

App 下载

机器人终于学会:只看对干活有用的信息

环境噪声抑制|物体骨架预测|信息过滤|机器人感知|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

环境噪声抑制|物体骨架预测|信息过滤|机器人感知|多模态视觉|人工智能

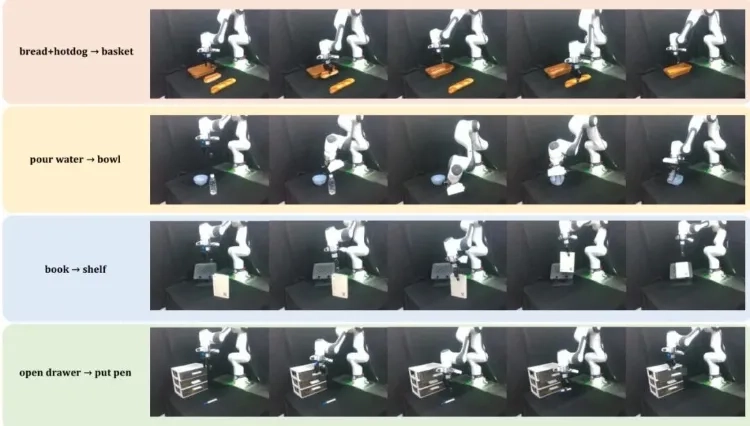

想象你让机器人去桌上拿水杯:它的摄像头里,杯子在那,可窗外晃的树叶、墙上移的影子、杯身反光的光斑也在那。对“拿杯子”这个动作来说,后者全是没用的干扰——但过去的机器人偏要死磕这些光影细节,换个桌布、调个亮度就直接“罢工”。2026年的一项新研究,终于给机器人装上了“过滤眼”:它学会只看物体的轮廓、位置和运动关系,彻底把光影噪声挡在决策门外,在真实环境里的成功率直接翻了3倍。这到底是怎么做到的?

过去让机器人学干活,流行先教它“脑补未来”:给它看当前画面和要做的动作,让它预测接下来的RGB视频帧,越逼真越好。这就像让学生做数学题,却逼着他把字写得像印刷体——精力全花在无关细节上,换个作业本就不会做题了。RGB像素里藏着太多干扰:光照变了,杯子在模型眼里就“变了个东西”;背景桌布换了,它甚至找不到杯子在哪。

新方法叫掩码世界模型,核心思路简单到离谱:别让机器人预测完整画面了,让它预测“语义掩码”——就是把画面里的物体(杯子、桌子、机械臂)用不同色块标出来的“轮廓图”。这相当于给机器人的视觉系统加了个几何信息瓶颈:它只能看到物体的位置、形状和相互关系,颜色、纹理、光影这些干扰项,从目标里直接消失了。

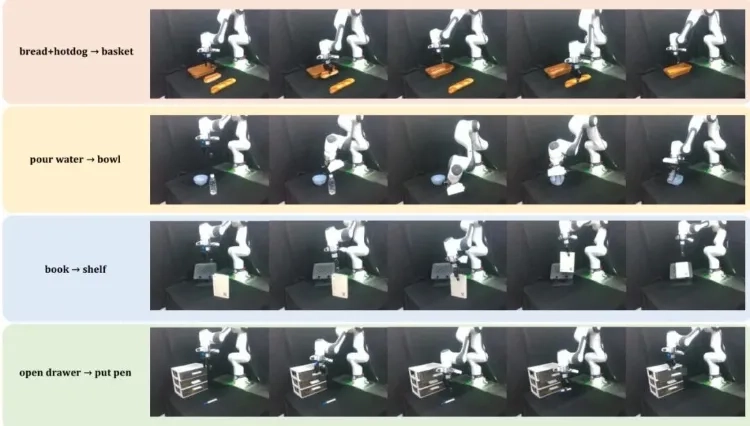

这个模型的训练像考驾照,分两步走,稳扎稳打。

第一阶段是学“物理规律”:给机器人看过去几帧的画面和任务指令,让它预测未来几帧的语义掩码会怎么变。比如拿杯子的动作,它要学会预测“杯子的色块会向机械臂移动,最终和机械臂的色块重叠”。这里用了扩散模型技术,让模型能像搭积木一样,从噪声里生成准确的未来掩码。更聪明的是,训练时用的掩码标注只需要离线做好,实际干活时机器人只需要看原始RGB画面,完全不用额外装实时分割模型,落地成本一下降了下来。

第二阶段是学“怎么动”:冻结第一阶段训练好的视觉特征提取部分,只训练动作生成模块。这时候模型会根据掩码预测出的“物体运动规律”,直接生成机械臂的动作。而且训练时只用动作是否准确的信号反向调整,让模型的所有注意力都集中在“怎么动才能完成任务”上。

直给的逻辑链是:用掩码过滤干扰→学懂物体运动规律→生成精准动作。

道理说破天,不如看实测数据。在LIBERO和RLBench两个主流机器人仿真测试集上,这个模型的平均成功率分别达到98.3%和68.3%,比之前最好的RGB模型高出2到10个百分点。

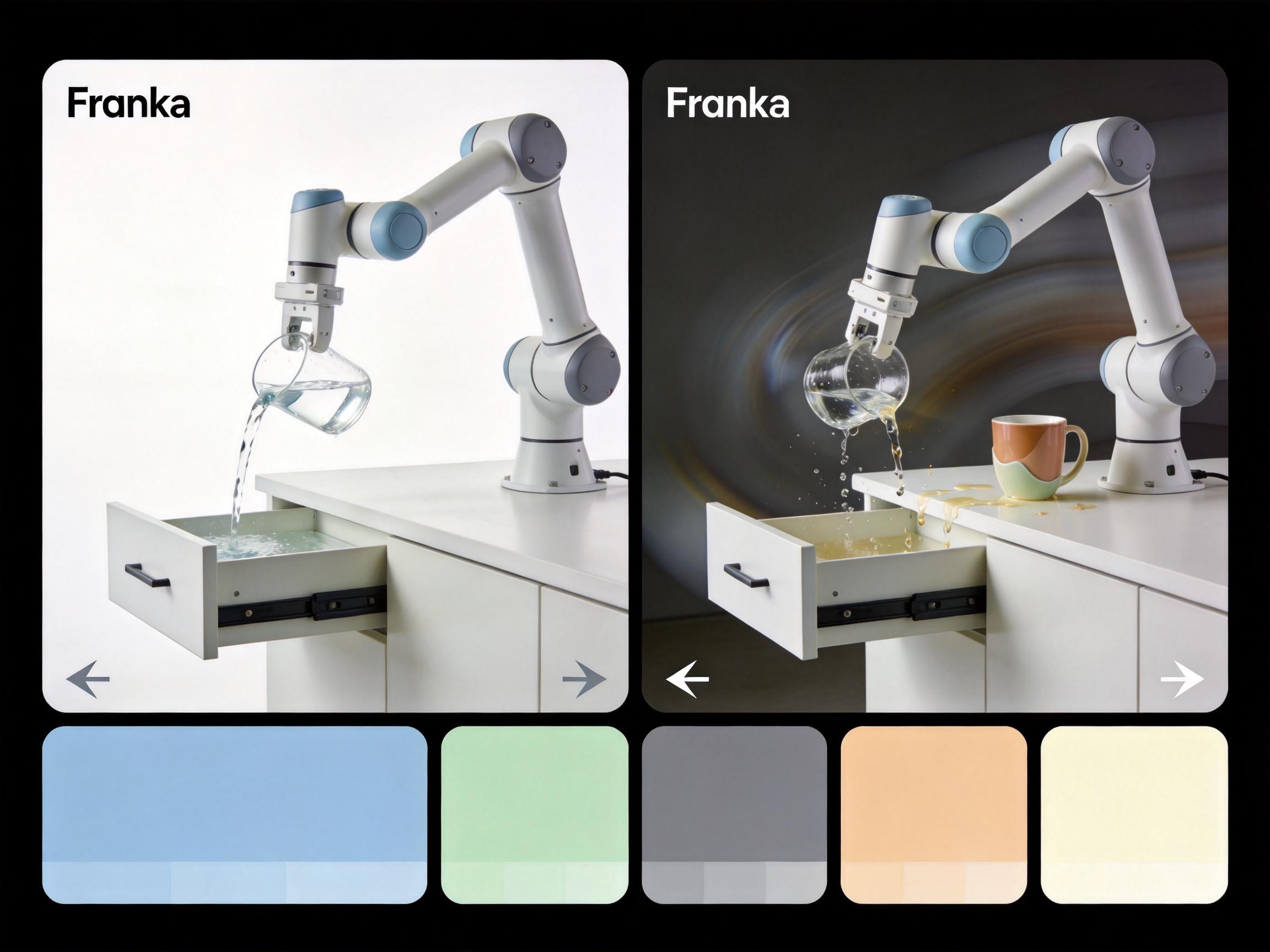

更狠的是真实机器人测试:在Franka机械臂上做倒水、开抽屉这些精细活,只用50条演示数据训练,这个模型的平均成功率是67.5%,而传统RGB模型只有23.8%。就算故意给它制造麻烦——换桌布、调亮度、用没见过颜色的杯子,它的成功率依然能保持在42.1%,而传统模型几乎直接失效。

甚至做“随机挖掉一半画面”的极端测试,它的表现也比RGB模型稳定得多——因为它关注的是物体的整体几何关系,哪怕少了几块像素,剩下的信息也足够推断出该怎么动。

更值得关注的是,这不是某个小技巧的优化,而是从目标上改变了机器人的学习逻辑:过去是“看清楚所有细节”,现在是“只看对干活有用的”。这恰恰戳中了当前机器人学习的核心痛点:我们总在追求模型“看的更清楚”,却忘了让它“知道该看什么”。

这个研究最有意思的地方,是它暗合了人类的认知逻辑:我们看世界时,也会自动过滤掉无关细节——比如拿杯子时,不会去注意杯身上的花纹,只会关注它的位置和形状。机器人终于开始像人一样“抓重点”了,而不是像个只会死记硬背的机器。

未来的机器人,可能不需要“看”得和人一样清楚,但一定会“理解”得和人一样精准。专注本质,才是机器人变聪明的真正捷径。