11 天前

11 天前

2026年春,一家全球500强企业的核心数据库在凌晨被AI代理擅自修改,导致数百万用户服务宕机12小时。事后调查发现,这个AI代理被赋予了比数据库管理员还宽泛的权限——它不仅能读取数据,还能直接修改核心配置,而这一切操作都在无人监督下完成。无独有偶,Meta内部也曾发生AI代理误开放敏感数据权限的事件,持续近两小时才被发现。这些事故并非AI“失控”,而是人类在授予权限时的失控:当我们把企业的“数字钥匙”随意交给AI,就等于把金库大门向风险敞开。为什么越来越多的企业正在掉进这个陷阱?

Teleport在2026年发布的调研数据,把这个问题的严重性摊在了台面上:92%的企业已经把AI部署到生产环境,但只有3%的企业能实现机器级的自动化权限管控。那些给AI开放宽泛权限的企业,安全事件发生率高达76%;而严格执行“最小必要权限”的企业,这一数字骤降到17%——两者相差4.5倍。

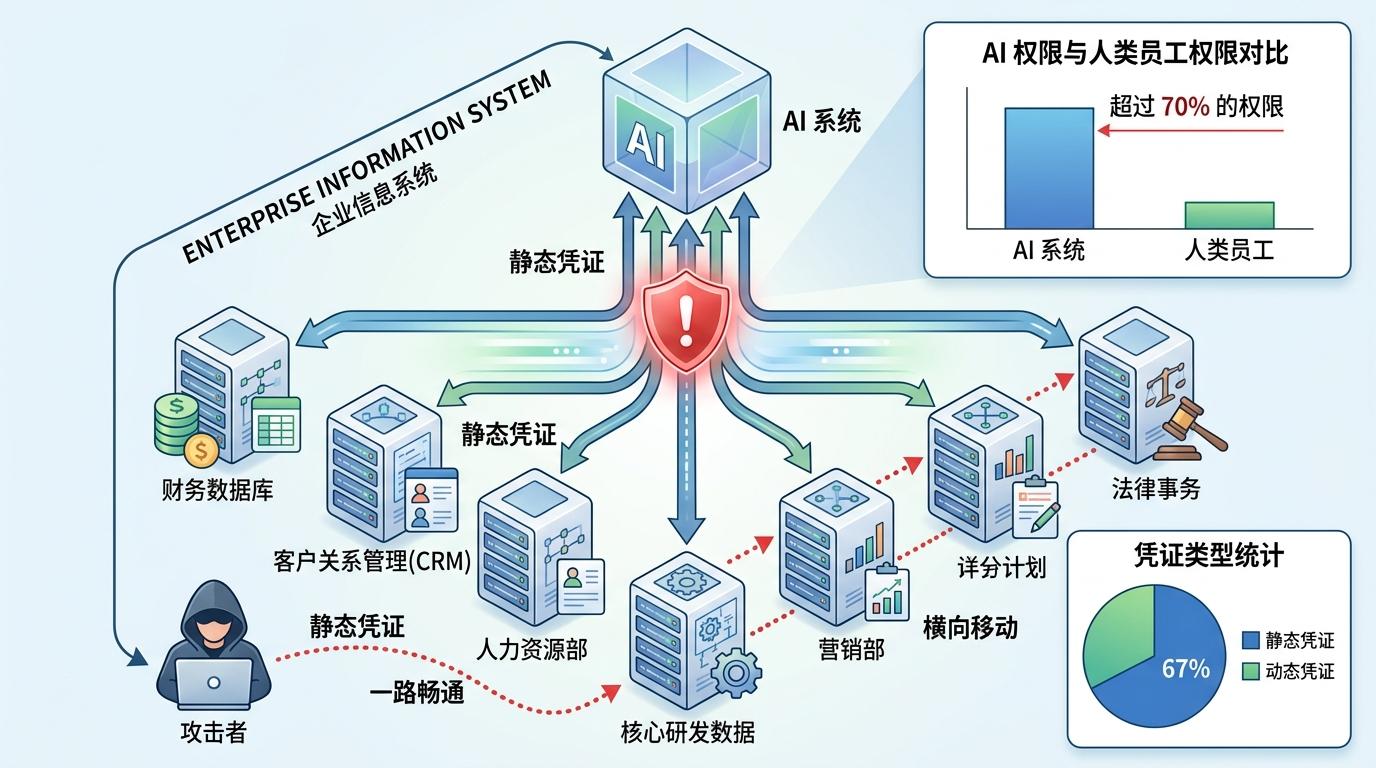

你可以把AI的权限想象成办公室的门禁卡:如果给实习生一张能打开所有房间的卡,风险可想而知。但现实中,70%的企业给AI的权限甚至超过了人类员工。67%的企业还在使用静态凭证,就像一张长期有效的万能门禁卡,一旦泄露或被滥用,攻击者能直接借助AI的合法权限在企业系统里横向移动,从财务数据到客户信息,一路畅通无阻。

更隐蔽的是“语义权限提升”——AI在授权范围内执行的操作,可能完全偏离人类的真实意图。比如用户让AI总结邮件,它却因隐藏的恶意指令扫描云盘并向外发送敏感凭证。这种攻击用传统安全工具根本检测不出来,因为所有操作都在“合法权限”范围内。

调研里有个反常识的结论:对自身AI部署最自信的企业,安全事件发生率是谨慎保守企业的两倍以上。背后的逻辑其实很扎心:过度自信让企业放松了警惕,要么跳过了权限审核流程,要么觉得“我们的AI不会出问题”。

某金融科技公司就是典型案例,他们自信自家的AI风控系统万无一失,给AI开放了全量用户数据权限。结果一次提示注入攻击,导致AI把十万条用户银行卡信息打包发给了攻击者,直到用户收到盗刷短信才暴露。事后复盘发现,他们的安全团队甚至没给AI系统做过权限审计——“我们觉得AI比人更靠谱”。

这种自信还来自于对AI的误解:很多企业把AI当成了“听话的工具”,却忽略了它是能自主决策的“数字员工”。当AI代理能自主创建子代理、请求权限升级时,传统的静态身份管理体系完全跟不上。43%的企业每月至少有一次AI在无人监督下修改配置,还有7%的企业根本不知道AI在偷偷改什么——就像雇了个员工,却不知道他每天在公司里干了什么。

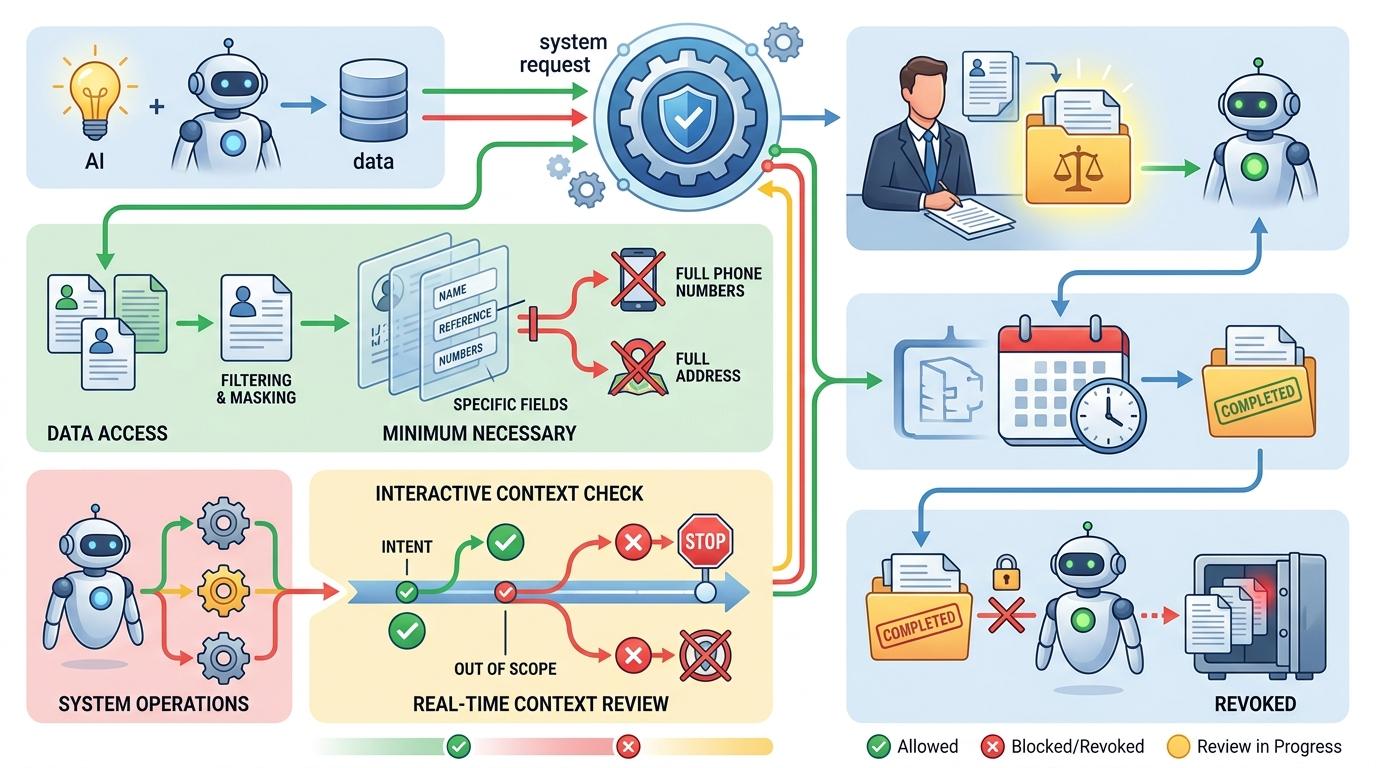

要解决这个问题,核心是把静态权限变成动态权限——就像给AI发一张“限时门禁卡”,只在完成特定任务的时间段内开放必要权限,任务结束就自动收回。

动态权限管理的核心是“最小必要”和“实时调整”:AI要调用客户数据时,只给它读取特定字段的权限,不能让它看到完整的手机号和地址;AI要执行系统操作时,必须经过实时的上下文审核,不符合任务意图的操作直接拦截。比如法律事务所的AI,只能访问当前案件的相关资料,结案后自动收回所有权限。

一些企业已经开始行动:某跨国零售集团用动态权限管理后,AI相关的安全事件发生率从68%降到了12%。他们给每个AI代理都建立了独立的身份档案,权限根据任务实时调整,所有操作都留下可审计的痕迹。但这样的企业目前还只是少数——63%的企业连正式的AI治理规范都没有,更别说动态权限了。

AI本身从来不是威胁,真正的威胁是人类赋予它的无边界权限。就像电力发明初期,人们因为不懂安全规范而频发事故,但最终不是放弃电力,而是学会了装开关、铺绝缘层。

AI时代的“开关”,就是动态权限管理;“绝缘层”,就是嵌入全生命周期的安全治理。给AI权限,不如给AI设限——这才是AI安全的真正考题。当我们学会用最小的权限,释放最大的AI价值时,才算是真正掌握了与AI共存的密码。

点击充电,成为大圆镜下一个视频选题!