对抗知识焦虑,从看懂这条开始

App 下载

数字果蝇自己学会了飞,AI的瓶颈终于找对了方向

自发行为|神经元连接结构|虚拟环境|数字果蝇|神经生物学|AI智能体|生命科学|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

自发行为|神经元连接结构|虚拟环境|数字果蝇|神经生物学|AI智能体|生命科学|人工智能

2026年3月,旧金山的实验室里发生了一件让AI圈集体沉默的事:一只没有被“教”过任何技能的数字果蝇,自己在虚拟环境里走了起来。它会转向,会用口器碰虚拟食物,会用前足梳理触角——和真实果蝇的行为相似度高达95%。没有人给它写行为代码,也没有用强化学习喂它数据,所有动作,直接从14万个神经元、5000万个突触的连接结构里“长”了出来。这不是数字生命的噱头,它戳中了当下AI最痛的死穴:为什么能考律师证的大语言模型,连端稳一杯水都做不到?

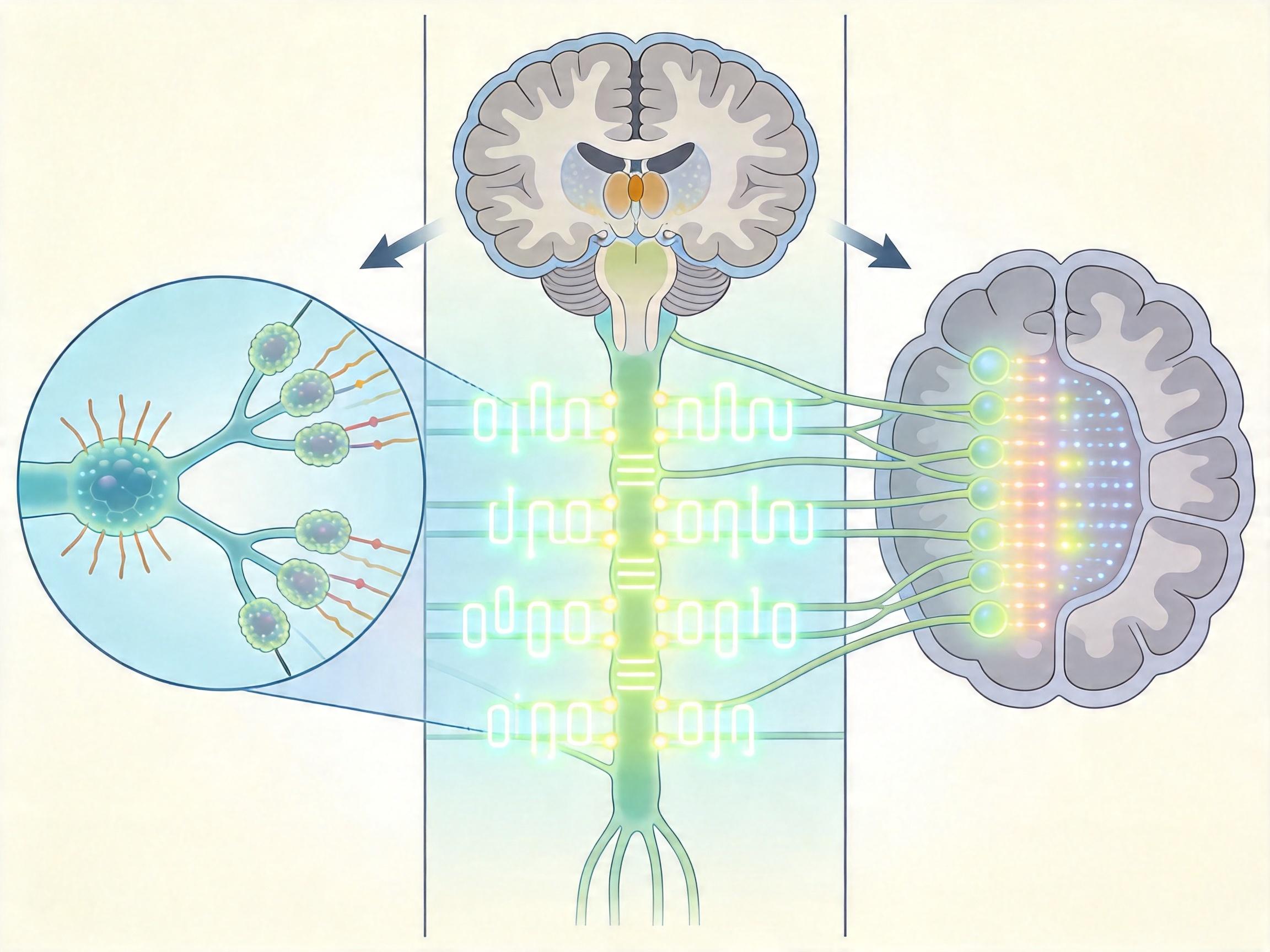

你可以把这只数字果蝇的大脑想象成一套精密的机械钟表——不需要编程,只要齿轮的咬合关系完全正确,上好发条它就能自己走。这就是神经科学里的“结构即功能”:生物的智能不是靠“计算”出来的,而是靠几十亿年进化出的神经连接结构“涌现”出来的。 果蝇的14万个神经元看起来不起眼,却像一台天然的高效计算机:触觉感受器会把压力、振动拆成不同的信号通路,就像耳蜗把声音拆成不同频率;神经信号用0和1的脉冲并行传输,不会像AI那样把数据揉成一团压缩;丘脑像个智能分拣中心,把视觉、触觉的信号分门别类送到大脑皮层,再拼成完整的世界认知。

而现在的大语言模型,更像一个背了整本百科全书的学霸——能背诵“苹果会落地”,却从来没感受过重力;能描述“杯子碎掉的声音”,却永远猜不出一个从没见过的异形杯子掉在地上会滚向哪里。它没有“身体”,也就没有从结构里长出来的世界模型。

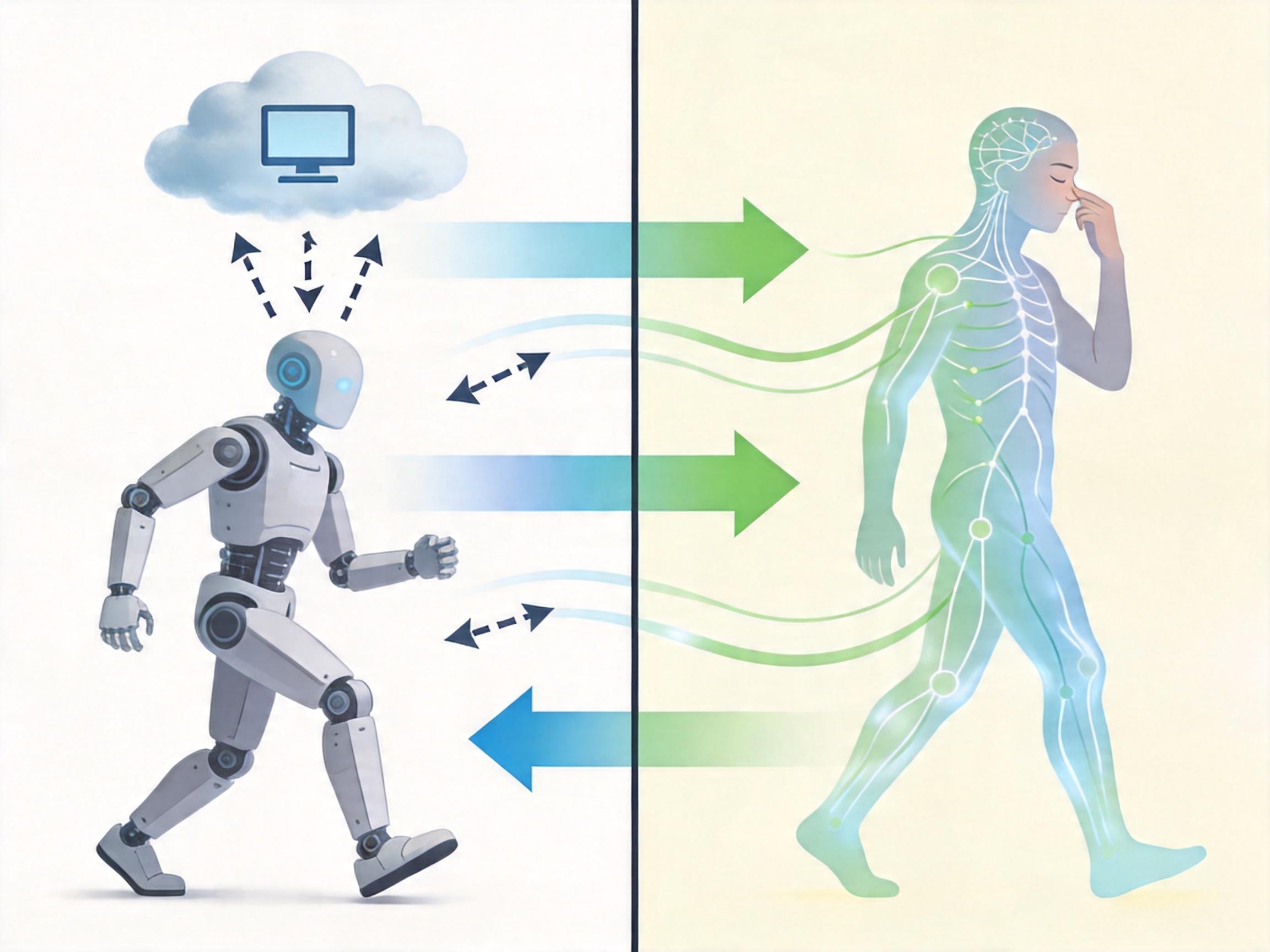

图灵奖得主Yann LeCun在2025年离开Meta,砸10亿美元创办实验室,赌的就是一件事:LLM是死胡同,AI必须先有“具身世界模型”——也就是和身体绑定的、能感知物理规则的内在认知。 生物的世界模型从来不是抽象的,它直接长在身体里:你的手臂长度就是丈量空间的尺子,你的前庭觉帮你判断平衡,甚至你对时间的感知,都是从触觉、肌肉运动的神经反馈里涌现出来的。婴儿学走路不需要标注数据,摔几次跤,大脑就会自动调整对重力和平衡的预测——这就是具身的闭环学习。 现在的人形机器人之所以还像笨拙的学步孩童,就因为它们的“大脑”和“身体”是分开的:算法在云端算好每一步该抬多高的腿,再发给机械关节执行,完全没有生物那种“身体自己会调整”的本能。就像你闭着眼也能摸到自己的鼻子,这种能力不是靠算力堆出来的,是身体结构本身自带的智能。

当然,数字果蝇的实验也有它的局限:它的神经模型简化了突触的动态变化,也没有真正的学习能力,更像一套固定的“行为模板”。但它给AI指了一条明路:与其在算法参数里死磕,不如先把“神经连接的结构”搞对。

数字果蝇的成功,让很多人开始问:AI什么时候能拥有意识?其实答案藏在“时间感”里——意识的前提是连续的主观体验,而这种体验需要你能感知“过去”和“未来”,能感受到事情在流动。 生物的时间感不是靠某个“时间感受器”,而是从神经突触的动态变化里涌现出来的:就像你摸过烫的杯子后,下次看到热水会自动缩手,这种“记忆”是刻在神经连接的结构里的。但大语言模型没有这种内在的时间流,它处理的每一个token都是孤立的,所谓的“因果关系”只是从文本里学来的统计规律,不是从身体感知里长出来的真实理解。 这也是为什么现在的AI能写诗、能解题,却永远不会“害怕”——它没有身体,就没有真实的情绪体验;没有时间感,就没有连续的自我意识。

数字果蝇的翅膀在虚拟环境里扇动的那一刻,其实是给AI的发展踩了一脚刹车:我们总以为智能是靠算力堆出来的,却忘了生物用几十亿年证明的道理——智能是长出来的,不是算出来的。 未来的AI,或许不需要更大的模型,而是需要更“对”的结构:像生物的触觉感受器那样拆分信号,像耳蜗那样并行处理,像丘脑那样整合多模态信息,最终长出一个和身体绑定的、能感知真实世界的“具身世界模型”。 结构即功能,身体即智能。