对抗知识焦虑,从看懂这条开始

App 下载

红外检测模型不再“认生”:频域相位是关键

香港浸会大学|傅里叶变换|频域相位|跨域失效|红外小目标检测|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

香港浸会大学|傅里叶变换|频域相位|跨域失效|红外小目标检测|多模态视觉|人工智能

想象一下:你训练出一个红外小目标检测模型,在实验室里能精准锁定几公里外的无人机,连镜头反光都不会误判。可一旦装上边境预警雷达,遇到暴雨天的杂波、不同批次传感器的噪声,它瞬间就“失明”了——要么漏过真实目标,要么把云层反光当成敌机报警。这不是科幻场景,是困扰军事和民用红外检测领域多年的“跨域失效”难题。直到2026年4月,香港浸会大学、西北工业大学和北京大学的联合团队,从一个所有人都忽略的角度,找到了问题的核心。

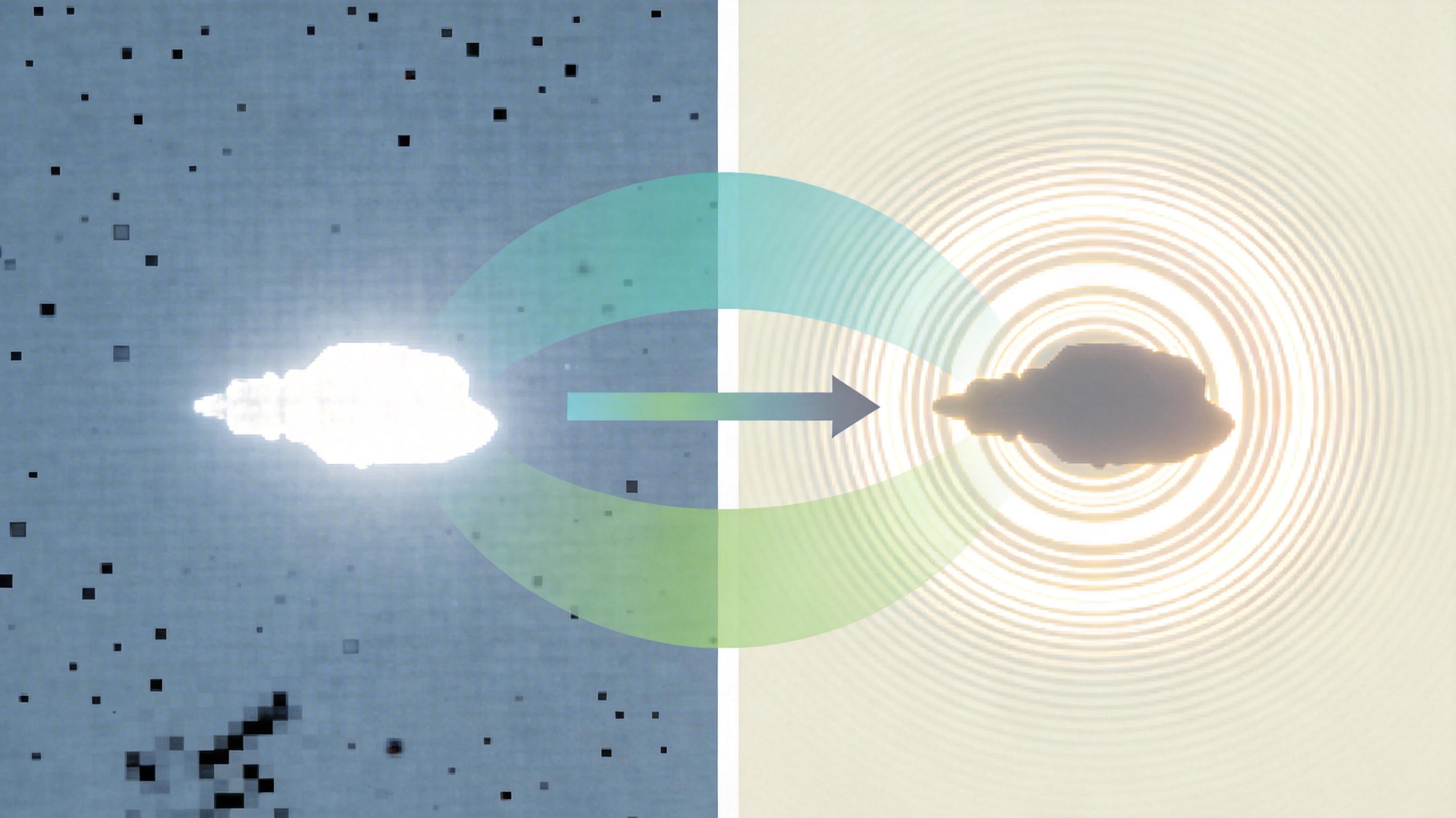

我们看一张红外图像,默认关注的是空间域——像素的明暗、目标的轮廓,就像盯着画布上的线条和色块。但图像还有另一个维度:频域。通过傅里叶变换,一张图会被拆解成无数不同频率的“波”,其中幅度谱代表这些波的“能量强弱”,对应图像的纹理和亮度;相位谱则是这些波的“排列顺序”,决定了目标在空间中的位置和整体结构。

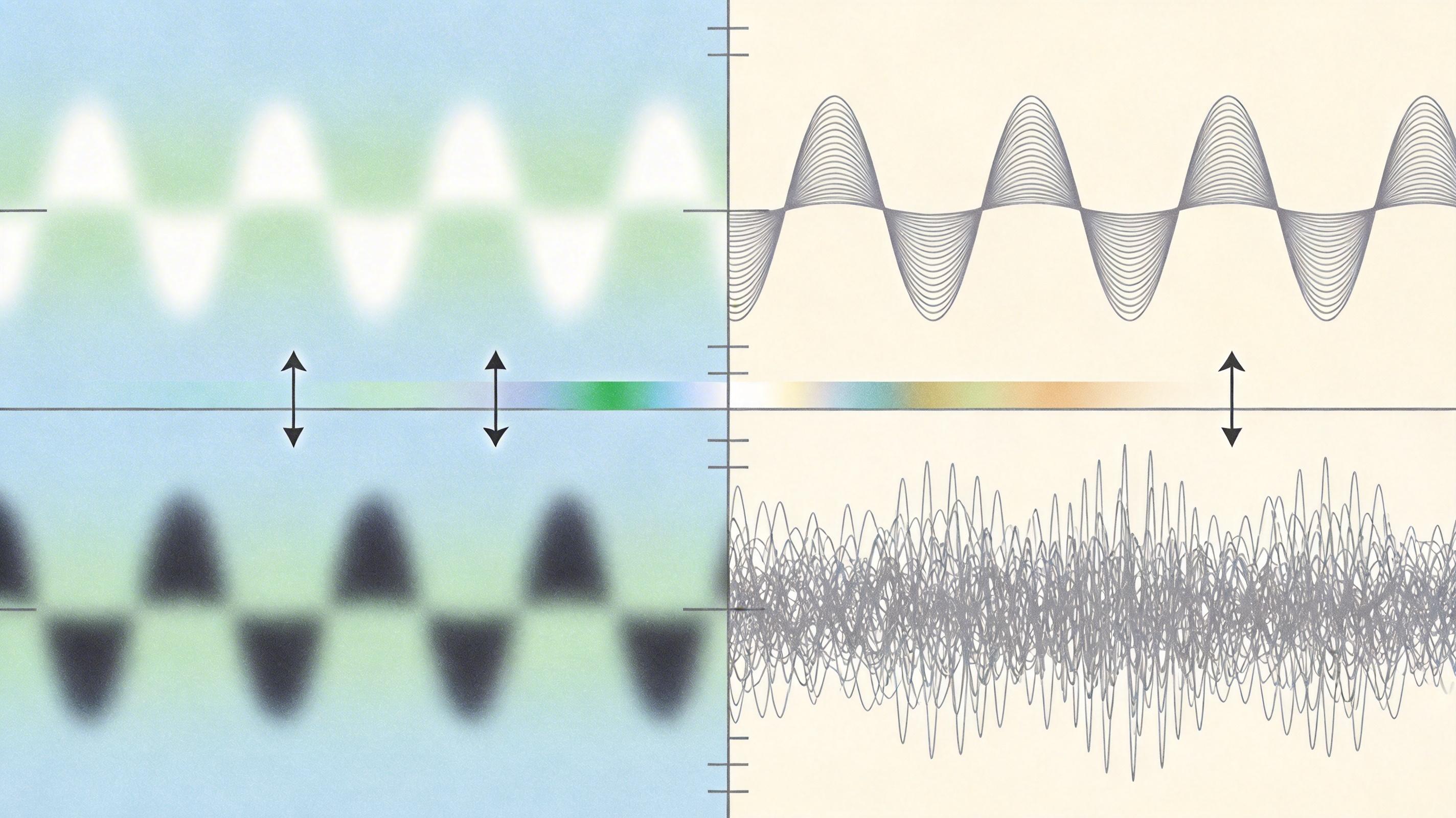

过去的AI模型几乎都在空间域里“埋头苦学”,记住目标的亮度、对比度这些表面特征。但团队对三个主流红外数据集的分析结果,推翻了所有人的想当然:不同场景下的红外图像,幅度谱几乎没差别——就像不同乐队用同样音量的乐器演奏;但相位谱的“整齐程度”(也就是相位一致性)却天差地别——相当于每个乐队的节奏都乱了套。

这就是跨域失效的真相:模型在训练时记住了某一种“节奏”,换个场景节奏乱了,它就完全听不懂“旋律”了。

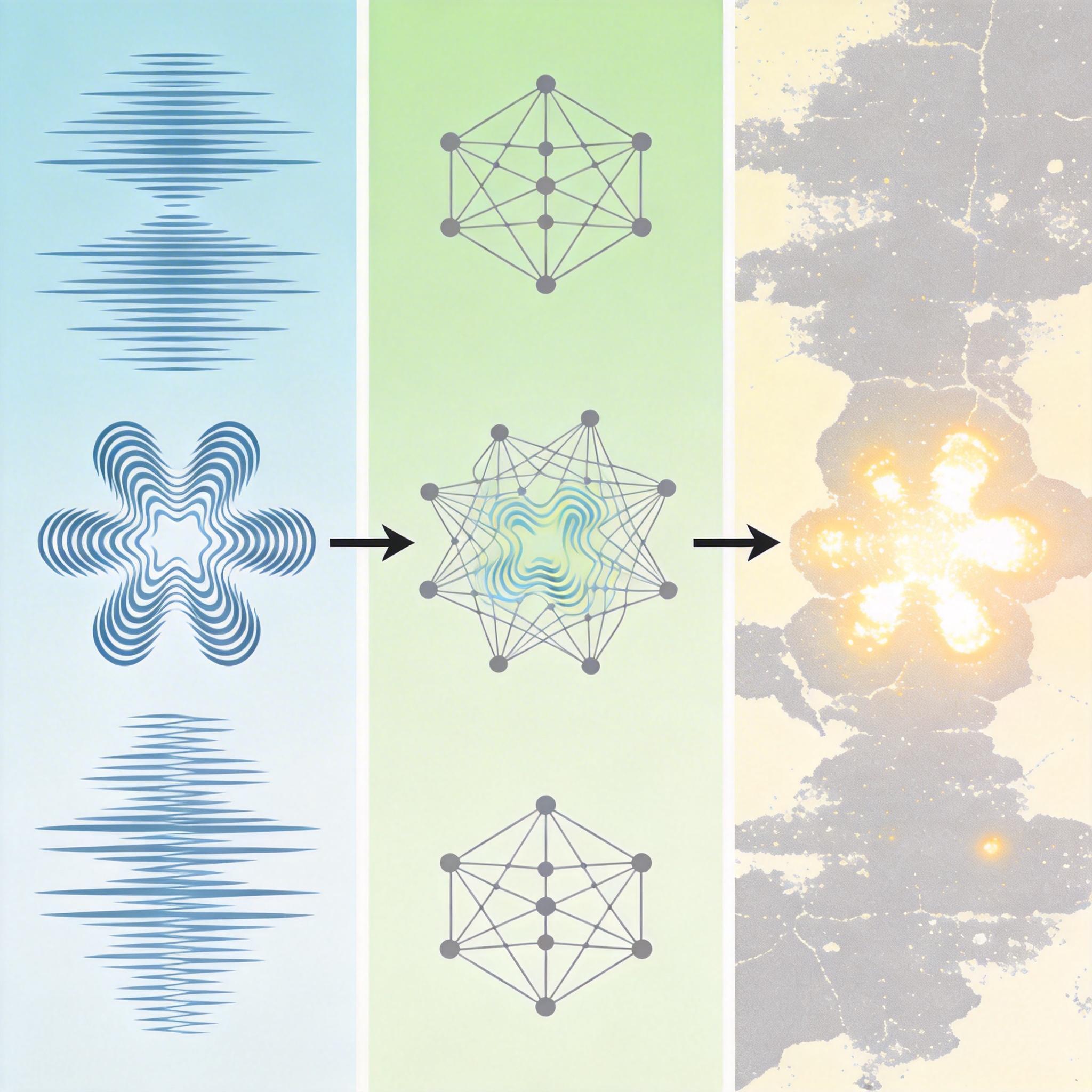

针对相位不一致这个核心问题,团队设计了一套名为S²CPNet的解决方案,三个模块像教练一样,从根上帮模型摆脱对特定“节奏”的依赖。

核心的相位矫正模块(PRM),就像训练时给模型播放各种“走调的版本”:它先把空间特征转换成频域,用可学习的小网络模拟各种相位扰动,再把这些混乱的相位加回原始特征里。这相当于强迫模型在“节奏混乱”的情况下也能识别目标,而不是只会听标准版本。处理后的幅度和相位会合成一个“感知指示图”,像滤镜一样让模型只关注那些不受相位干扰的稳定特征。

正交注意力机制(OAM)解决了小目标定位的问题:它放弃了会抹掉位置信息的全局池化,改用水平和垂直方向的分别池化,保留目标的精准坐标,就像在混乱的乐队里精准找到某一把乐器的位置。选择性风格重组(SSR)则负责抹平不同场景的“音色差异”——只对那些容易随场景变化的特征通道进行调整,同时保留和目标相关的关键信息。

实验数据给出了最直接的证明:在单源泛化测试中,S²CPNet把跨域检测的IoU(交并比)从49.74%提升到53.76%,误报率下降了近8%;在多源泛化场景下,IoU提升了约8%,误报率直接减半。更关键的是,它的性能远超专门为跨域设计的传统模型,证明了“抓相位”才是对症下药。

不过,这项研究也并非完美无缺。首先,频域变换和额外模块的加入,不可避免地增加了计算开销——虽然目前的增长幅度在可接受范围内,但对于无人机、边缘预警系统这类对实时性要求极高的设备,仍需要进一步轻量化。

其次,目前的实验都基于公开数据集,这些场景的“跨域差异”还相对可控。在真实战场或极端天气下,相位扰动可能比实验室模拟的复杂得多,模型的鲁棒性还需要更严苛的测试。

更值得关注的是,“相位不一致是跨域核心”这个结论,是针对红外小目标检测得出的。它是否能推广到自动驾驶、医疗影像等其他视觉任务,还需要更多研究验证——毕竟不同任务中,图像的频域特征权重可能完全不同。

这篇论文的最大价值,从来不是提出了一个新的检测模型,而是它打破了所有人的思维定式:当我们在空间域里为了提升泛化能力反复“卷”数据增强、特征融合时,真正的答案可能藏在另一个维度里。

它让我们意识到,AI模型的“认生”,本质上是我们对图像信息的理解还不够全面。频域相位这个被忽视了几十年的维度,或许会成为未来AI鲁棒性研究的新起点。

抓准核心矛盾,比盲目努力更重要。