对抗知识焦虑,从看懂这条开始

App 下载

省一半带宽还更清晰,视频传输的新解法

带宽优化|视频超分辨率|TCL团队|西北大学|MetaSR|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

带宽优化|视频超分辨率|TCL团队|西北大学|MetaSR|多模态视觉|人工智能

你有没有过这种经历:地铁里刷高清视频,画面要么卡成PPT,要么糊成马赛克——平台为了省带宽,只能在“流畅”和“清晰”里二选一。2026年4月,西北大学和TCL的团队拿出了一个破局方案:MetaSR。它能在相同画质下砍掉50%的传输带宽,或者用同样的带宽把画质拉高一截。关键是,它没在编码格式上死磕,而是换了个所有人都没想到的思路——给视频“搭信息顺风车”。

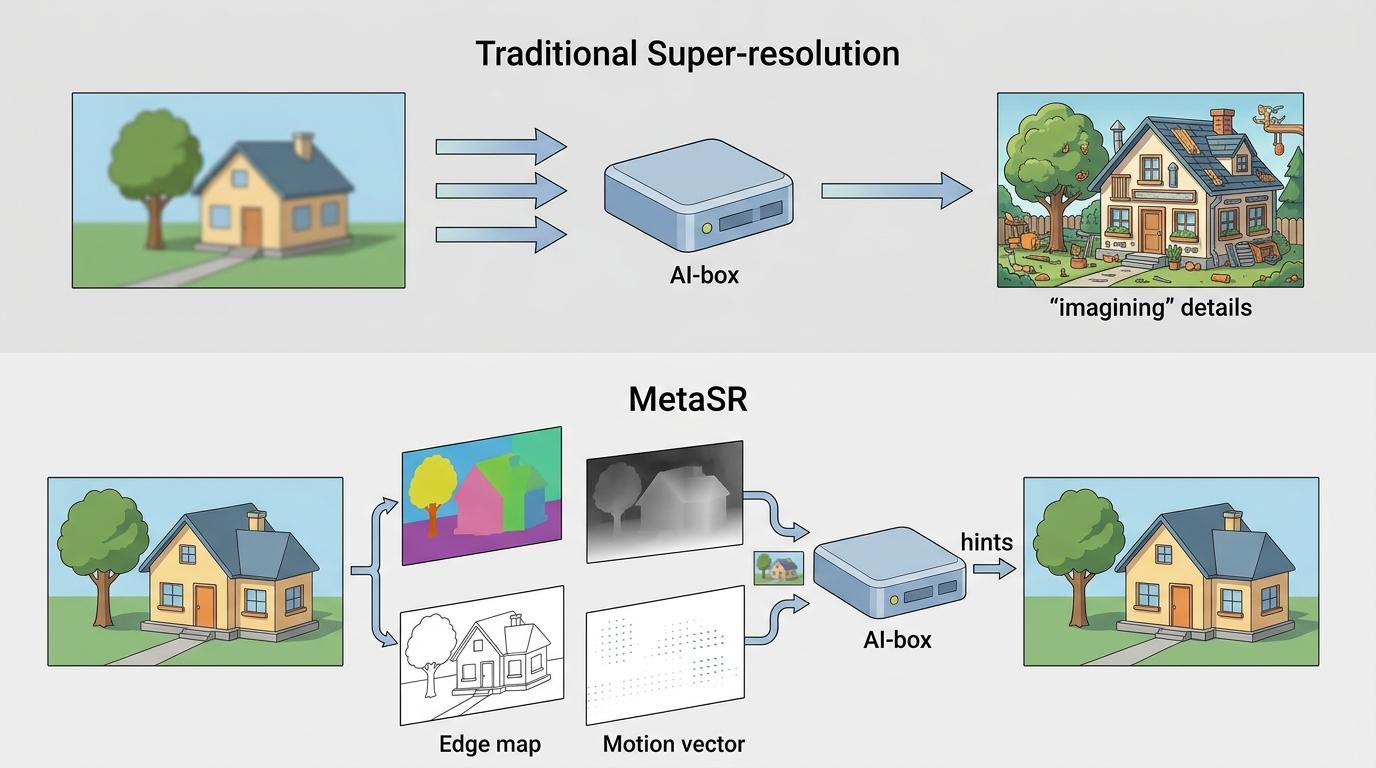

传统超分辨率的逻辑,是只传低清视频,让接收端的AI自己“脑补”高清细节——就像让一个没见过大象的人,只凭模糊影子画大象,难免会画出长鼻子的河马。MetaSR反其道而行之:发送端多做一步,生成视频的“元数据”——比如勾勒物体轮廓的边缘图、标注远近的深度图——这些数据压缩后只有几KB,却能给AI当“提示卡”。

你可以把这个过程想象成寄快递:以前只寄一个写着“易碎品”的空箱子,让收件人自己猜里面是什么;现在不仅寄箱子,还附一张物品的线稿图,收件人拼起来自然又快又准。而MetaSR最聪明的地方,是它不会给所有快递都塞同一张线稿——它会先看箱子里装的是书本、海鲜还是玻璃制品,再决定递哪张提示卡。

这就是MetaSR的核心:内容自适应元数据编排。它把元数据当成了要精打细算的“带宽货币”,每一分钱都要花在刀刃上。 比如遇到满屏文字的视频,它就优先传边缘图——保证文字的笔画清晰可读;遇到高速运动的体育赛事,就侧重传深度信息——让AI能准确还原球员的动作轨迹;如果是平滑的卡通画面,它甚至会少传或不传元数据——因为这种内容AI自己也能猜个八九不离十。

背后的逻辑是经典的率失真优化:在总带宽固定的情况下,让画质损失降到最低。MetaSR首次把元数据纳入这个优化框架,就像给带宽做了一次“精准扶贫”——把资源从不需要的地方抽走,集中投给最需要细节的区域。实验数据最有说服力:在网络噪声大的恶劣环境下,它能让画质的核心指标PSNR提升1.0dB,相当于模糊的视频突然变得锐利清晰;而在相同画质下,它能砍掉一半的带宽消耗。

当然,MetaSR目前还只是个亮眼的“概念验证”。它现在只测试了边缘图和深度图两种元数据,面对更复杂的视频内容——比如快速切换的多场景镜头、低光下的人脸——还需要更多类型的元数据来适配。而且它目前只在单帧图像上验证了效果,要用到连续的视频上,还得解决时序一致性的问题:总不能前一帧的人脸是清晰的,后一帧突然糊成一团。 更现实的问题是硬件门槛:它依赖的CogVideoX-2B模型需要A100级别的GPU才能高效运行,这意味着短期内还没法直接装到手机或智能电视里。而且它的代码还没开源,其他团队想复现或优化,还得等一等。不过这些都不是致命的问题——毕竟,方向对了,剩下的就是技术迭代的事。

MetaSR的出现,其实戳中了视频传输行业的一个痛点:我们一直在编码格式上死磕效率,却忘了从内容本身找优化空间。它不是在“压缩数据”,而是在“智能分配信息”——这才是未来视频传输的核心方向。 以后我们刷视频,可能再也不用在“流畅”和“清晰”里做选择了。因为真正的高效,从来不是一味地砍成本,而是把每一份资源都用在最需要的地方。好的技术,懂内容,更懂分寸。