1 个月前

1 个月前

想象你坐在一辆自动驾驶车里,前方路口红灯转绿,旁边的电动车正在犹豫要不要加速。你知道人类司机可能会先慢半秒观察,或者平稳跟车,甚至稍微给点油快速通过——但你的AI只会做同一种选择:踩着固定的油门,沿着几乎分毫不差的轨迹往前开。这不是科幻场景,而是当前自动驾驶VLA模型的真实困境:它们在训练中陷入了“策略囚笼”,只会模仿单一的“标准答案”,丧失了探索多样驾驶策略的能力。直到Curious-VLA的出现,才打破了这个囚笼的门锁。

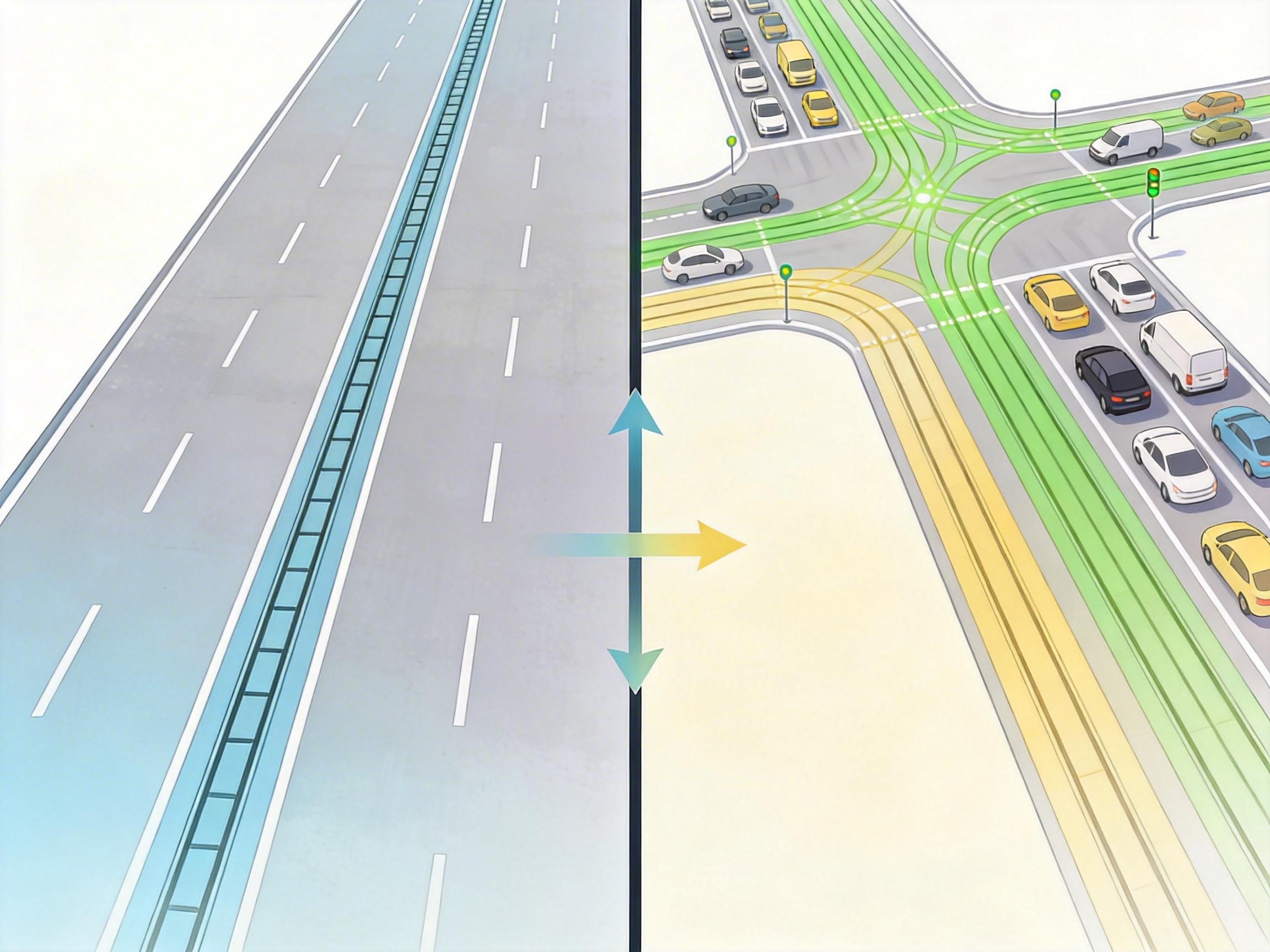

你可以把自动驾驶VLA模型的训练想象成学开车:如果教练只让你练一种固定路线,哪怕练一万次,遇到突发情况你还是会慌。当前主流VLA模型就是这么学的——在模仿学习阶段,它们被要求精准复刻人类司机的某一条轨迹,把“和示范轨迹一模一样”当成唯一目标。

这种训练逻辑的问题在于,真实驾驶根本没有“标准答案”。同一个路口,早0.5秒刹车和晚0.5秒刹车都是安全的;同一段拥堵路,跟紧前车和保持车距都是合理的。但模仿学习会把这些多样的选择全部当成“错误答案”,逼着模型收敛到一条狭窄的策略上。

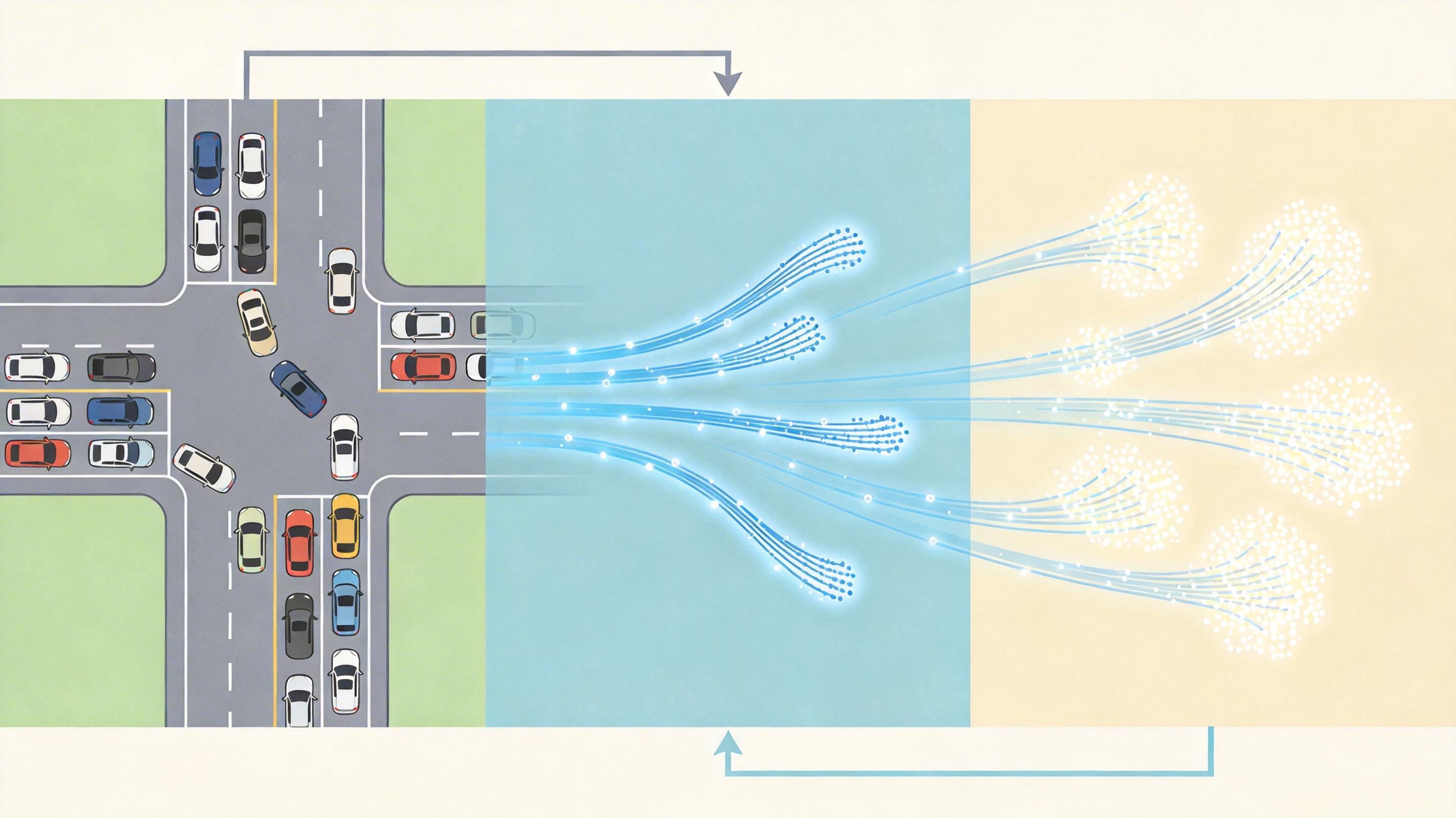

更糟的是,训练时模型会自动优先拟合远期轨迹的误差——就像学开车时只盯着远方的路牌,却忘了脚下的油门和刹车。这导致模型对近距离的关键操作细节完全麻木,策略空间被压缩到极致。等进入强化学习阶段,模型已经只会生成几乎完全相同的轨迹,奖励样本的方差趋近于零,就像给一个只会走直线的人发方向舵,强化学习彻底失去了优化的空间。

Curious-VLA的解决思路直接瞄准了问题根源:先给模型看够多样的“正确答案”,再逼着它主动探索新的可能。

第一步是给训练数据“扩容”。研究团队从Navsim数据集里挑出1.2万段最复杂的驾驶场景——比如多车道汇流、遮挡路口,用扩散模型生成上百条符合交通规则的安全轨迹,再通过PDMS安全评分过滤,最终把训练数据从10万条扩展到14.2万条。相当于给学开车的人看100个老司机过同一个路口的不同操作,而不是只看一个人的。

但光有多样数据还不够,模型还是会盯着远期轨迹忽略细节。于是他们又加了“分步归一化”:把每一个时间步的轨迹坐标单独做标准化处理,让远近轨迹的误差权重变得均衡。就像练开车时,教练既要求你看远方,也逼你盯着仪表盘和前车距离,确保你学到的是完整的驾驶技能,而不是只会画轨迹。

到了强化学习阶段,Curious-VLA又搞了个“聪明采样”:只挑那些能产生多样策略的场景来训练。比如一个空旷的直路,模型怎么开都不会有差异,就直接跳过;但到了人车混行的路口,模型的不同选择会带来完全不同的奖励,就反复练这个场景。同时把奖励函数做了非线性变换,放大好策略和普通策略的差异——就像教练给平稳通过的打100分,给勉强通过的打60分,而不是都给80分,让模型清楚知道什么是真正的好操作。

实验结果给出了最直接的证明:在Navsim基准测试中,Curious-VLA的PDMS得分达到90.3,比之前的SOTA模型提升了1.2分;在nuScenes数据集上,碰撞率降到0.33%,安全性能提升了13%。更惊人的是“Best-of-N”测试——从模型生成的多条轨迹里选最优的,Curious-VLA的得分达到了94.8,和人类司机的轨迹得分完全持平。

这意味着,当AI能生成多样的驾驶策略时,它其实已经具备了接近人类的决策能力。Waymo的公开数据也印证了这一点:他们的多模型并行策略,让自动驾驶车辆在模拟测试中应对突发情况的成功率提升了15%。而2023年的一项安全评估显示,缺乏多样性训练的模型,面对非典型交通事件的事故率比平均水平高出30%以上。

更值得关注的是,Curious-VLA完全抛弃了传统VLA模型外挂的规划模块,只靠多模态大模型的自回归能力就实现了SOTA性能。这不仅简化了系统结构,更意味着它能充分利用大模型的规模效应——模型越大,探索能力越强,性能提升的天花板被彻底打开了。

当我们谈论自动驾驶的未来时,总在说“更安全”“更智能”,但往往忽略了,智能的核心不是“做对题”,而是“会选路”。Curious-VLA的突破,本质上是把AI从“考试机器”变回了“司机”——它不再只会复刻标准答案,而是能像人类一样,在复杂多变的道路上,做出多样而合理的选择。

多样性,才是自动驾驶的安全底色。未来的自动驾驶AI,不该是只会走一条路的“乖学生”,而该是能应对各种路况的“老司机”。Curious-VLA的出现,只是这个转变的开始。

点击充电,成为大圆镜下一个视频选题!