对抗知识焦虑,从看懂这条开始

App 下载

GPT之父颠覆AI安全:源头过滤可增7000倍攻击成本

机器遗忘|RLHF|攻击成本|源头过滤|GPT之父|AI安全治理|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

机器遗忘|RLHF|攻击成本|源头过滤|GPT之父|AI安全治理|人工智能

在人工智能安全领域,一场旷日持久的“猫鼠游戏”似乎永无止境。开发者们如同城墙的修筑者,在模型训练完成后,通过基于人类反馈的强化学习(RLHF)或“机器遗忘”(Machine Unlearning)等技术,层层加固防御护栏。然而,攻击者总能像狡猾的“越狱”大师,通过巧妙的提示词或对抗性微调,轻松绕过这些防御,唤醒模型潜藏的危险能力。

这种“先污染,后治理”的模式,如同教会一个人制造炸弹,再三令五申不许他提及此事。知识的种子一旦种下,就难以根除。但如果,我们能在一开始就阻止这颗种子发芽呢?如果AI的大脑从未学习过危险的知识,又何来“越狱”之说?

2026年初,一份来自Anthropic、斯坦福大学与传奇研究员Alec Radford的联合论文,为这场看似无解的博弈带来了颠覆性的曙光。Alec Radford,这位亲手缔造了GPT、GPT-2、CLIP等里程碑式模型的“GPT之父”,如今将目光投向了如何为自己创造的“巨兽”戴上最坚固的枷锁。

他们提出的方案直击要害:放弃在模型成型后亡羊补牢,转而在预训练的源头阶段,通过“知识过滤”直接进行干预。 这项研究的核心观点是,通过在数据投喂阶段进行Token(词元)级别的精细筛选,我们可以像进行一场精准的神经外科手术一样,从AI的“大脑”深处切除危险知识,同时完好地保留其通用智能。

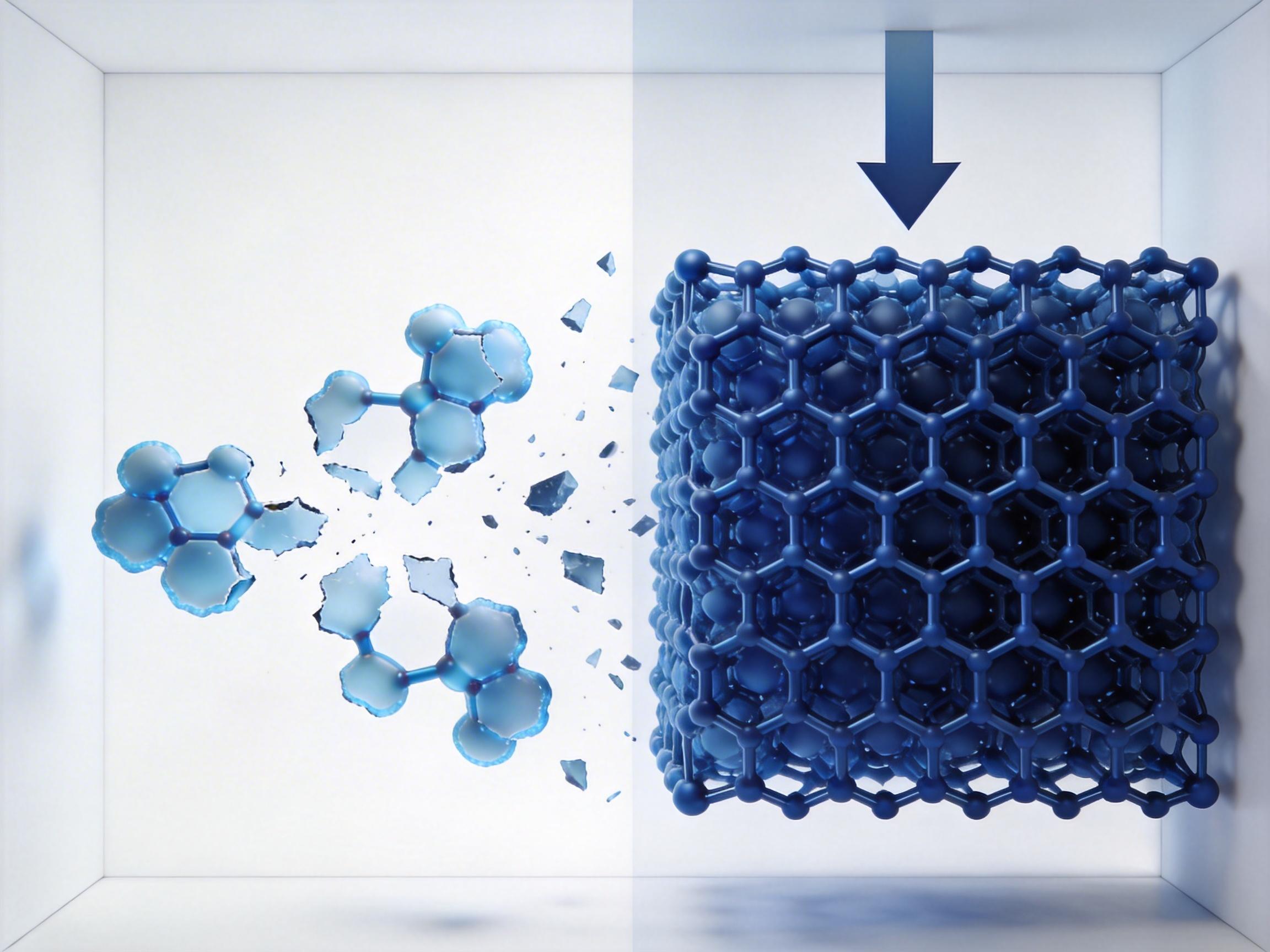

传统的预训练数据清洗,好比用一把大刀进行“截肢”。一旦发现某篇文档含有害信息,整篇文档,连同其中大量无害的知识,都会被一并丢弃。这种做法不仅粗糙,而且极大地浪费了宝贵的训练数据。

Radford和同事们则将手术刀的精度提升到了Token级别。他们认为,危险知识往往潜藏于特定的词句序列中,而非遍布整篇文档。为了验证这一点,他们设计了一个极具挑战性的代理任务:在移除模型的“医学知识”(危险知识的替身)的同时,必须最大限度地保留与之高度重叠的“生物学知识”(有益知识的替身)。

团队测试了两种堪称精妙的过滤策略:

<hidden>标记。模型不仅不学,甚至连看都看不到。实验结果令人振奋。Token级过滤在同等程度去除医学知识的前提下,对生物学知识的保留效果远超文档级过滤。这证明了“外科手术”远比“截肢”更有效,它精准地切除了“肿瘤”,保留了健康的“机体组织”。

这项研究最令人震撼的发现,在于揭示了一条关于安全的“缩放定律”(Scaling Law)。通常我们担忧,模型规模越大,就会越“聪明”,越难以控制。但实验数据给出了一个截然相反的结论:Token级过滤的效果,随着模型规模的增加而显著增强。

研究团队引入了一个名为“损失匹配算力阻滞”的指标,用于衡量攻击者需要付出多少额外算力,才能让被过滤的模型重新学会被移除的知识。

数据揭示了惊人的事实:对于一个18亿参数的模型,Token级过滤使其在目标领域(医学)的学习效率暴跌了7000倍。这意味着,如果攻击者想通过微调让模型重新掌握这些知识,将面临天文数字般的算力成本。这不再是简单的软件“护栏”,而是基于物理算力成本构建起的一道坚不可摧的天然屏障。

为了检验这种防御的坚固程度,研究团队模拟了最坏的情况:攻击者获取模型权重,并试图通过对抗性微调来恢复其危险能力。他们将Token过滤模型与当前最先进的“机器遗忘”算法RMU进行了正面交锋。

结果呈现一边倒的态势。RMU构建的防御极其脆弱,仅需少量对抗性微调数据,其防线便瞬间崩溃。而被过滤的模型则展现出惊人的韧性。对于18亿参数的模型,攻击者需要13倍以上的微调数据量,才能达到与攻击RMU模型相同的效果。

这深刻地揭示了:“从未学过”与“学过再忘”在神经网络的表征层面存在本质区别。前者让模型在危险领域如同一张白纸,无从下手;后者则只是暂时掩盖了早已存在的知识痕迹,一戳就破。

AI安全领域一直存在一个哲学悖论:要让模型拒绝回答有害问题,是否必须先让它“知道”什么是有害的?此前的研究似乎给出了肯定的答案,认为一个对“毒性”一无所知的模型,很难识别并拒绝“毒性”指令。

然而,这项研究再次打破了固有认知。实验发现,经过Token级过滤的模型在接受“拒绝训练”时,表现甚至优于未经过滤的基线模型,其拒绝有害问题的正确率高出2倍,并且不会将拒绝行为错误地泛化到无害问题上。

研究者认为,这是因为Token级过滤为模型创造了一个清晰的“已知/未知”边界。模型的任务从复杂的“语义判断(这个内容是否有害?)”简化为了高效的“分布判断(这个概念我是否见过?)”。这种基于知识边界的“无知之智”,比基于复杂伦理判断的拒绝机制更加稳健和可靠。

要在预训练阶段对海量数据进行Token级标注,最大的挑战无疑是成本。如果依赖人工,这几乎是不可能完成的任务。

为此,研究团队设计了一套巧妙的“弱监督”自动化流程:

更重要的是,研究发现该系统具有强大的“弱到强泛化”能力。即便自动生成的标签含有噪声,即便分类器并不完美,只要配合足够激进的过滤阈值,依然能在大模型上实现出色的过滤效果。这一发现极大地降低了该技术的落地门槛。

Radford和同事们的工作并非要取代RLHF等现有安全措施,而是倡导一种“纵深防御”(Defense-in-depth)的全新范式。

在预训练阶段进行Token级知识过滤,如同为AI大厦打下坚实无比的安全地基。在此之上进行的对齐训练,将不再是空中楼阁,而是事半功倍。这种方法尤其适用于模型权重被开放的场景——即使攻击者拿到了模型,他们面对的也只是一个在物理层面就“缺失”了危险能力的残缺大脑。

随着AI模型向万亿、乃至更大规模迈进,这种展现出优越扩展性的安全策略,或许将成为未来AGI安全架构中不可或缺的拼图。它指明了一条清晰的道路:在追求更强能力(Scaling Capabilities)的同时,我们终于有了一套可以同步扩展安全(Scaling Safety)的有力武器。