对抗知识焦虑,从看懂这条开始

App 下载

美伊营救行动代价惨重,“大模型决策”为何失灵?

人类行为建模|作战决策失误|中情局假旗行动|F-15E飞行员|美军营救行动|军事地缘|AI智能体|社会人文|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

人类行为建模|作战决策失误|中情局假旗行动|F-15E飞行员|美军营救行动|军事地缘|AI智能体|社会人文|人工智能

2026年4月4日,美军用一场跨军种联合行动,从伊朗领土救回了被击落的F-15E飞行员——这是自美以与伊朗开战以来,首次在敌方境内完成高风险搜救。中情局的假旗行动、多源情报的精准定位、特种部队的快速部署,让这场行动被特朗普称为“美国历史上最勇敢的搜救之一”。但光鲜的战果背后,是一架运输机陷入沙地被迫炸毁、3架支援战机被击落的高昂代价。大模型辅助生成的作战方案,为何没能预判到这些意外?这场营救暴露的,正是当前智能化战争最核心的矛盾:AI能把已知风险算到极致,却对战场的“未知未知”束手无策。

在美以对伊朗高层的定点清除行动中,外界曾热议“AI杀死了哈梅内伊”,但这种说法并不准确——真正发挥作用的,是“人类行为建模+多源情报融合”的组合拳。

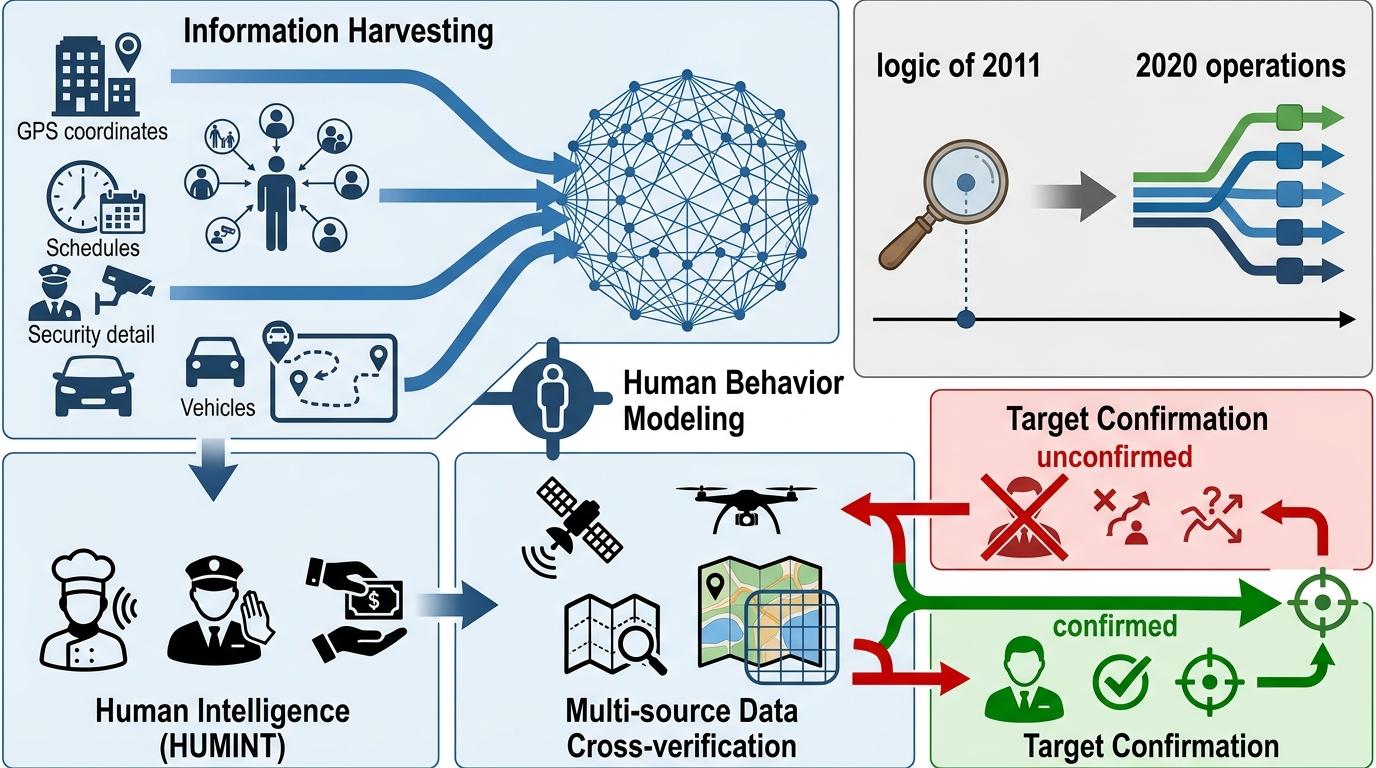

所谓人类行为建模,就是用大数据把目标人物的所有关联信息编织成一张网:从居所位置、家人随行人员,到出行规律、安保配置,甚至日常用车的型号和路线,都被系统拆解成可分析的变量。2011年猎杀本·拉登的行动,是这套逻辑的雏形;到苏莱曼尼遇袭时,它已经形成了成熟的操作流程:先通过人工线人获取关键线索,比如收买目标身边的厨师或司机,再用卫星、高空无人机的多源数据交叉验证,最终确认目标行踪的可信度。

在这次飞行员营救中,这套逻辑同样发挥了作用:AI整合了飞行员的求救信号、伊朗军队的部署动态、山区地形数据,甚至通过分析伊朗社交媒体的实时信息判断搜捕节奏,最终把营救范围缩小到几平方公里的区域。但它的局限也很明显——这套体系擅长“处理已知”,却无法应对“未知变量”:比如临时跑道下的沙地承载力、伊朗军队突然调整的搜捕路线,这些不在训练数据里的“长尾事件”,恰恰成了行动的致命漏洞。

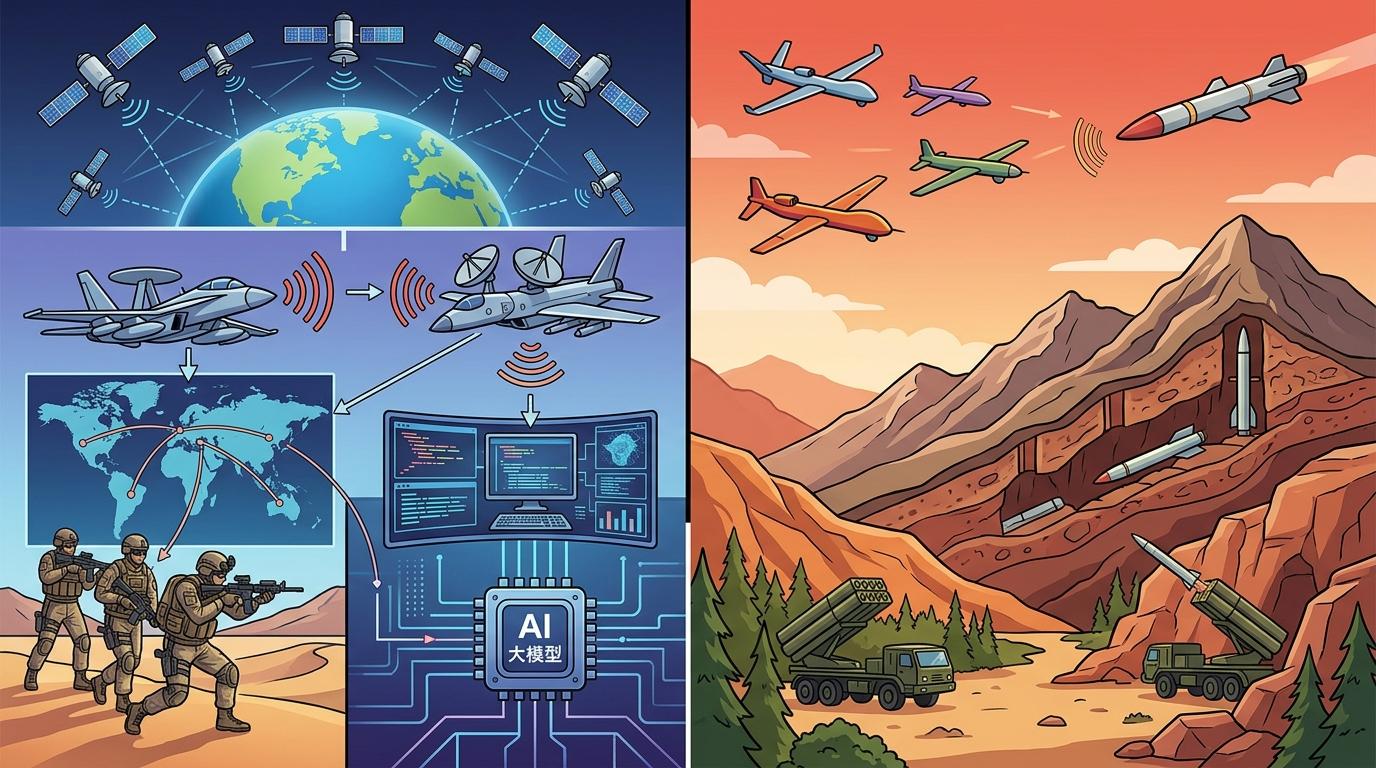

从2017年启动“马文项目”开始,美军就一直在用AI重构作战决策链条。到2026年的美伊战场,这套体系已经进化到“大模型+专用模型+人类判断”的成熟模式:过去需要几小时甚至几天的情报分析,现在AI能在数秒内完成;传统的作战方案推演,大模型能结合卫星数据、武器参数、敌方部署,快速生成十多套备选方案,甚至能模拟出每套方案的伤亡概率和资源消耗。

但这次营救行动的失误,暴露了大模型的两大核心问题:首先是“数据缺口”。美军使用的Claude大模型是2025年才嵌入机密系统的,对伊朗战场的特殊地形、伊朗军队的游击战术学习时间不足,根本没把“沙地陷车”这种小概率事件纳入推演。其次是“黑箱效应”——大模型的决策基于概率统计,它能给出“成功概率95%”的结论,却无法解释那5%的风险到底是什么。当指挥官被AI的高效率麻痹,就容易忽略那些看不见的隐患。

更关键的是,大模型擅长的是“战术优化”,而非“战略预判”。它能算出如何最快突破伊朗的防空网,却无法预判伊朗会用低成本无人机打消耗战;它能精准定位一个目标,却看不到这场战争的政治僵局——这也是美以迟迟无法达成战略目标的根本原因:AI能解决“怎么打”的问题,却回答不了“为什么打”和“打到什么时候”。

很多人把智能化战争理解为“AI主导一切”,但军事专家吴明曦的判断更清醒:“单纯拥有AI算力并不能形成战斗力。”

在美伊战场上,美军的大模型能快速处理情报,却离不开遍布太空的卫星网络、能压制伊朗雷达的电子战飞机、能全球部署的特种部队——这些都是国家综合国力的体现。而伊朗能在美以的压制下持续反击,靠的也是一套“非对称体系”:把导弹分散部署在山区和地下设施,用低成本无人机消耗美军的昂贵拦截弹,这套体系恰恰避开了AI擅长的“精准打击”,直击美军的成本软肋。

从俄乌冲突到美伊战争,智能化战争的本质其实是“体系的对抗”:AI只是这个体系中的一个节点,它能放大体系的优势,也会暴露体系的短板。美军在营救行动中的失误,与其说是AI的失败,不如说是“过度依赖AI”的失败——当指挥官把AI的方案当成“标准答案”,就失去了人类最宝贵的能力:对战场不确定性的感知和应对。

从越南战争的“地毯式轰炸”到今天的“AI精准打击”,战争形态一直在变,但战争的本质从未改变:它永远是政治、经济、科技、人心的综合博弈。

这次美伊营救行动像一面镜子,照出了智能化战争的真实面目:它能让作战更高效、更精准,却不能消除战争的风险和代价;它能让指挥官更快做出决策,却不能替人类承担决策的后果。未来的智能化战争,不会是AI的独角戏,而是“人机协同”的新战场——真正的决胜关键,从来都不是AI有多聪明,而是人类如何用AI的同时,保持对战争的敬畏和对全局的判断。

AI是工具,战争的最终决策者永远是人。