对抗知识焦虑,从看懂这条开始

App 下载

AI终于能读懂地球的全部语言了

光谱分析|遥感数据|中山大学|上海AI Lab|Earth-Agent|气候变化|多模态视觉|地球环境|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

光谱分析|遥感数据|中山大学|上海AI Lab|Earth-Agent|气候变化|多模态视觉|地球环境|人工智能

当你打开卫星地图,能看到的只是城市、山脉、海洋的RGB彩色画面——这也是过去AI能“看懂”的全部地球语言。但地球本身的表达远不止于此:植被叶片的光谱振动、大气水汽的浓度波动、地表温度的细微起伏,这些藏在数据里的信号,才是理解气候变暖、作物旱情、城市热岛的关键。2026年5月,上海AI Lab与中山大学的团队发布了Earth-Agent,第一次让AI同时听懂了地球的“彩色画面”“光谱私语”和“数据报告”三类语言。它是怎么做到的?

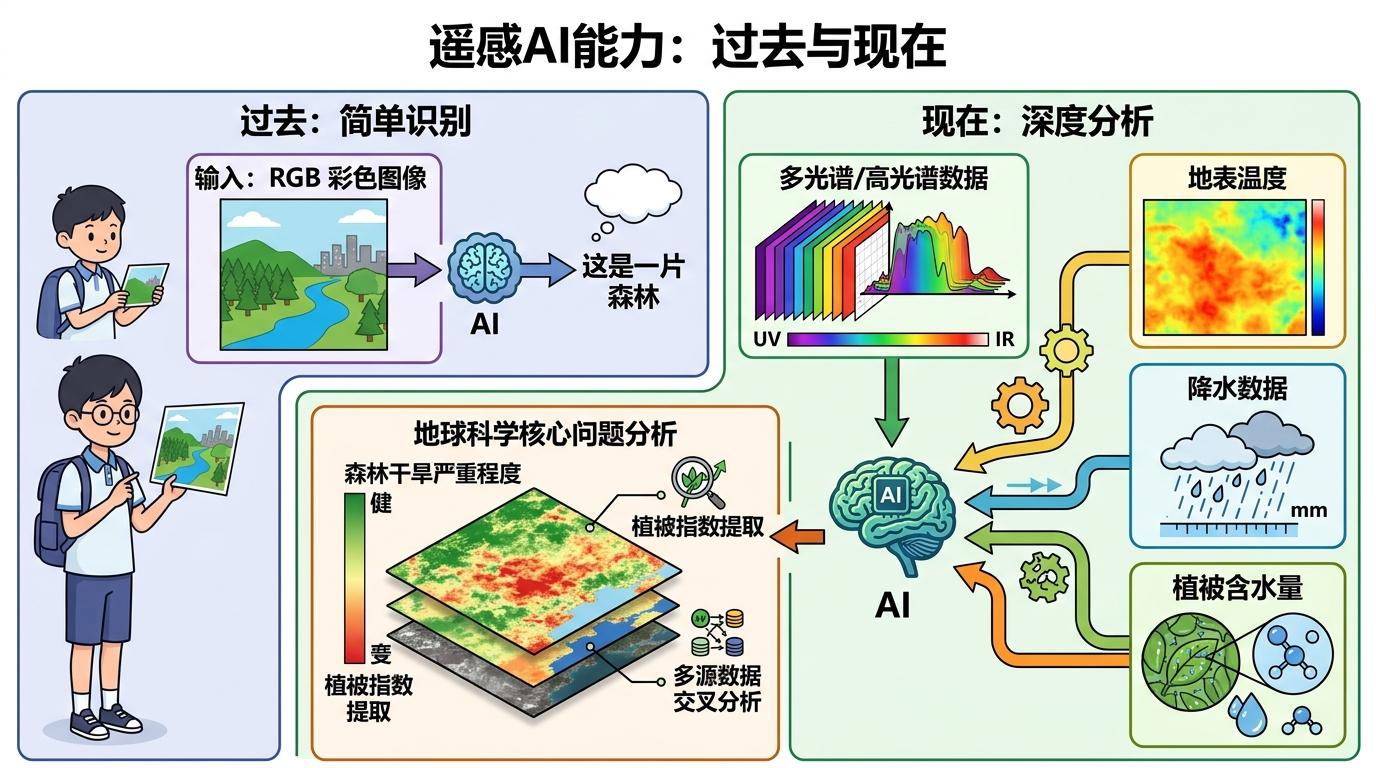

过去的遥感AI,就像只会看彩图的小学生——面对RGB图像能说出“这是一片森林”,但递过去光谱数据(记录着从紫外到红外的数百段光线信息),它就只会发呆。地球科学的核心问题,比如“这片森林的旱情有多严重”,恰恰需要从光谱数据里提取植被含水量,再结合地表温度、降水数据做交叉分析。

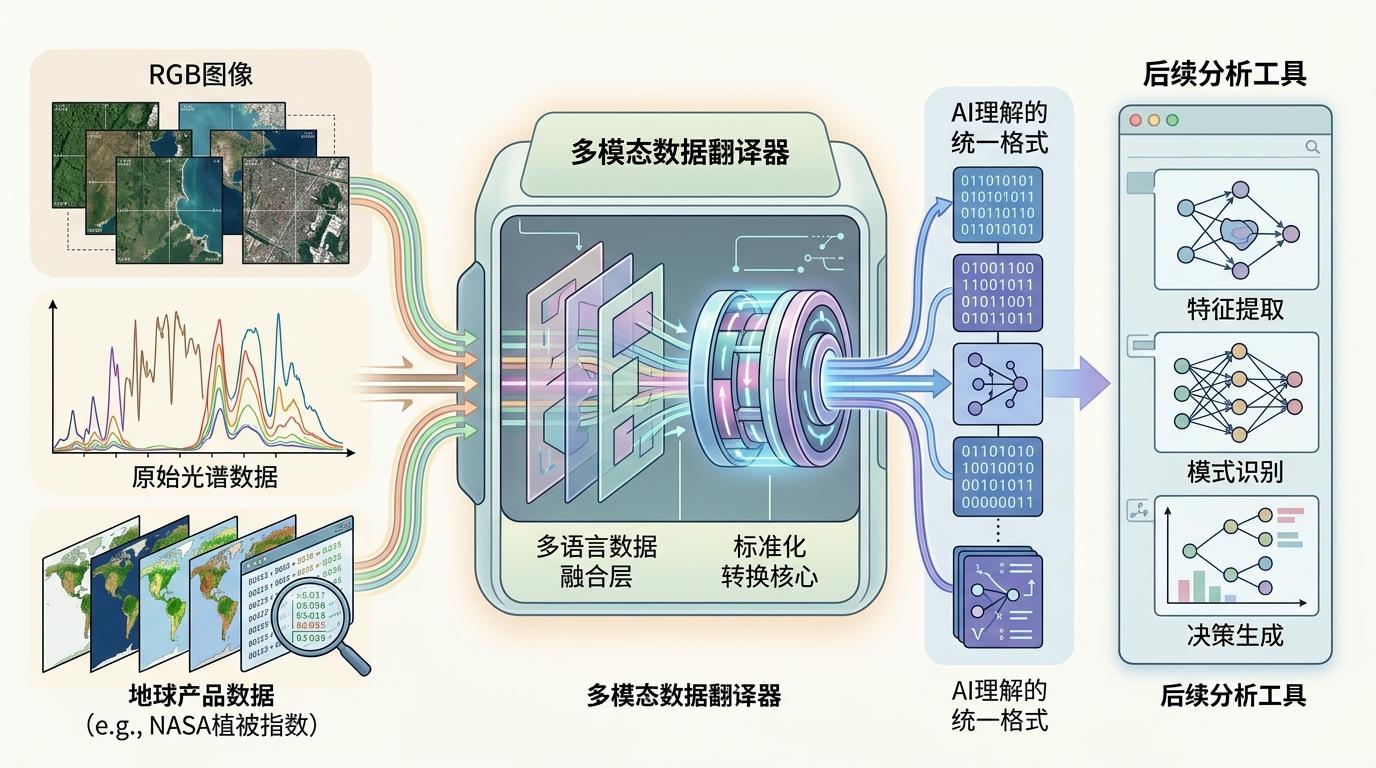

Earth-Agent的第一个突破,就是把RGB图像、原始光谱数据、地球产品数据(比如NASA预处理好的全球植被指数数据集)统一放进了同一个“翻译器”里。你可以把这个翻译器想象成一个多语言同声传译员:不管地球用哪种“语言”说话,它都能转换成AI能理解的统一格式,再传递给后续的分析工具。

这个统一架构解决了三个关键问题:一是不用再为不同数据单独训练模型,二是能同时调用多模态数据做交叉验证,三是突破了传统AI只能处理单张或少量图像的限制——它一次能处理数百张卫星影像,覆盖一个城市甚至一个流域的范围。

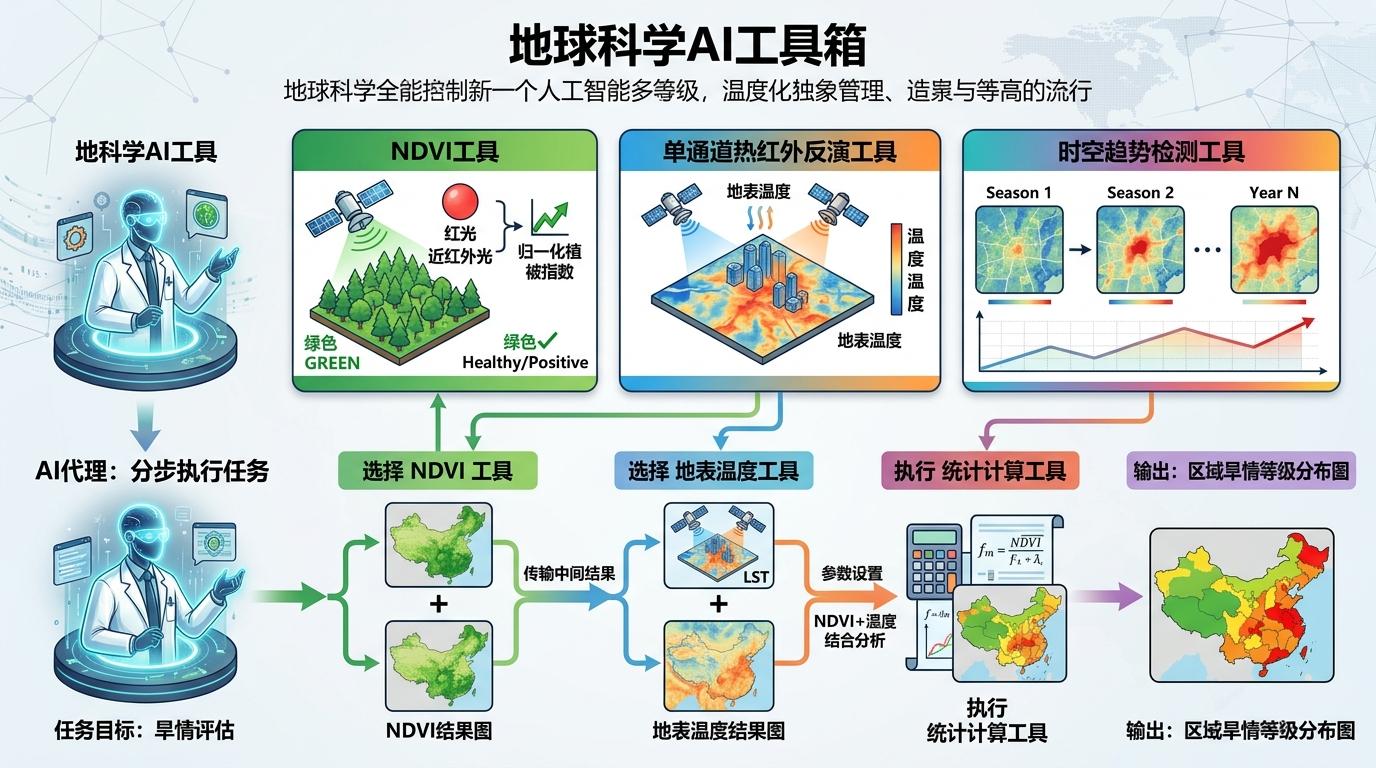

光能听懂地球的语言还不够,AI得会用专业工具分析这些信息。Earth-Agent的第二个核心创新,是给AI配了一个装满104种专业工具的“工具箱”,分成了指数计算、参数反演、视觉感知、时空分析、统计计算五大类。

你可以把这个工具箱理解成地球科学家的百宝箱:需要算植被健康指数,就调用NDVI工具;需要反演地表温度,就用单通道热红外反演工具;需要分析城市热岛的季节变化,就调出时空趋势检测工具。AI会像人类科学家一样,根据任务目标一步步选择工具、设置参数、传递中间结果——比如先算NDVI判断植被长势,再结合地表温度数据评估旱情,最后用统计工具计算区域平均旱情等级。

为了保证AI的每一步操作都符合科学逻辑,团队还设计了双层评估体系:不仅看最终结果对不对,还要检查工具调用的顺序、参数设置的准确性。比如要算地表温度,必须先调用云掩膜工具剔除云层干扰,再用反演工具,少一步或者顺序错了,都会被判定为不合格。这种“过程+结果”的双重评估,让AI的推理过程第一次变得可追溯、可验证。

不过Earth-Agent还远不是完美的。团队在测试中发现,AI偶尔会出现“工具幻觉”——比如调用一个不存在的工具,或者给工具设置错误的参数。比如在处理纽约市地表温度的任务中,有AI错误地调用了海冰浓度反演工具,结果自然完全偏离。

这种幻觉的根源,在于大语言模型对工具的理解还停留在文本描述层面,没有真正“理解”工具的功能和适用场景。团队的下一步计划,是引入具备视觉理解能力的多模态模型,让AI能“看到”工具处理前后的数据变化,从而更准确地判断工具的适用性。

另外,目前的104个工具还只是地球科学工具的冰山一角。团队基于MCP开放协议构建了工具生态,未来允许全球的地球科学家贡献自己的专业工具——就像给手机装APP一样,让Earth-Agent的能力持续扩展。

当我们谈论Earth-Agent的意义时,本质上是在谈论地球观测的“自动化革命”。过去,一个地球科学家要完成一项区域旱情分析,需要下载数据、处理影像、调用工具、手动计算,整个流程可能需要几天甚至几周。现在,Earth-Agent能在几分钟内完成同样的工作,而且能处理更大范围的数据。

更重要的是,它第一次让AI具备了地球科学的“思维方式”——不是简单地识别图像,而是像人类科学家一样,用专业工具一步步推导结论。听懂地球的全部语言,才能真正读懂地球的情绪。未来,当AI能实时分析全球的光谱、温度、降水数据,我们或许能更早地预警森林火灾、作物病虫害,甚至更精准地预测气候变化的影响。