对抗知识焦虑,从看懂这条开始

App 下载

AI接管终端命令行,开发者变身为"指挥者"

权限隐患|自动化脚本|运维工程师|终端命令行|AI产业应用|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

权限隐患|自动化脚本|运维工程师|终端命令行|AI产业应用|人工智能

凌晨两点,运维工程师李凯盯着终端里一行长达78字符的find命令,手指悬在键盘上不敢动——这行代码管着整个电商平台的日志归档,改错一个参数就是百万级损失。他打开浏览器准备查第17次文档,突然想起同事提过的新工具:对着终端输入"帮我解释这个命令",AI用三句话拆解了每个参数的作用,甚至标出了其中一个容易遗漏的权限隐患。10分钟后,李凯不仅搞定了归档,还让AI生成了自动校验的脚本。这不是科幻场景,而是2026年开发者的日常:AI已经钻进了终端这个最硬核的开发阵地。

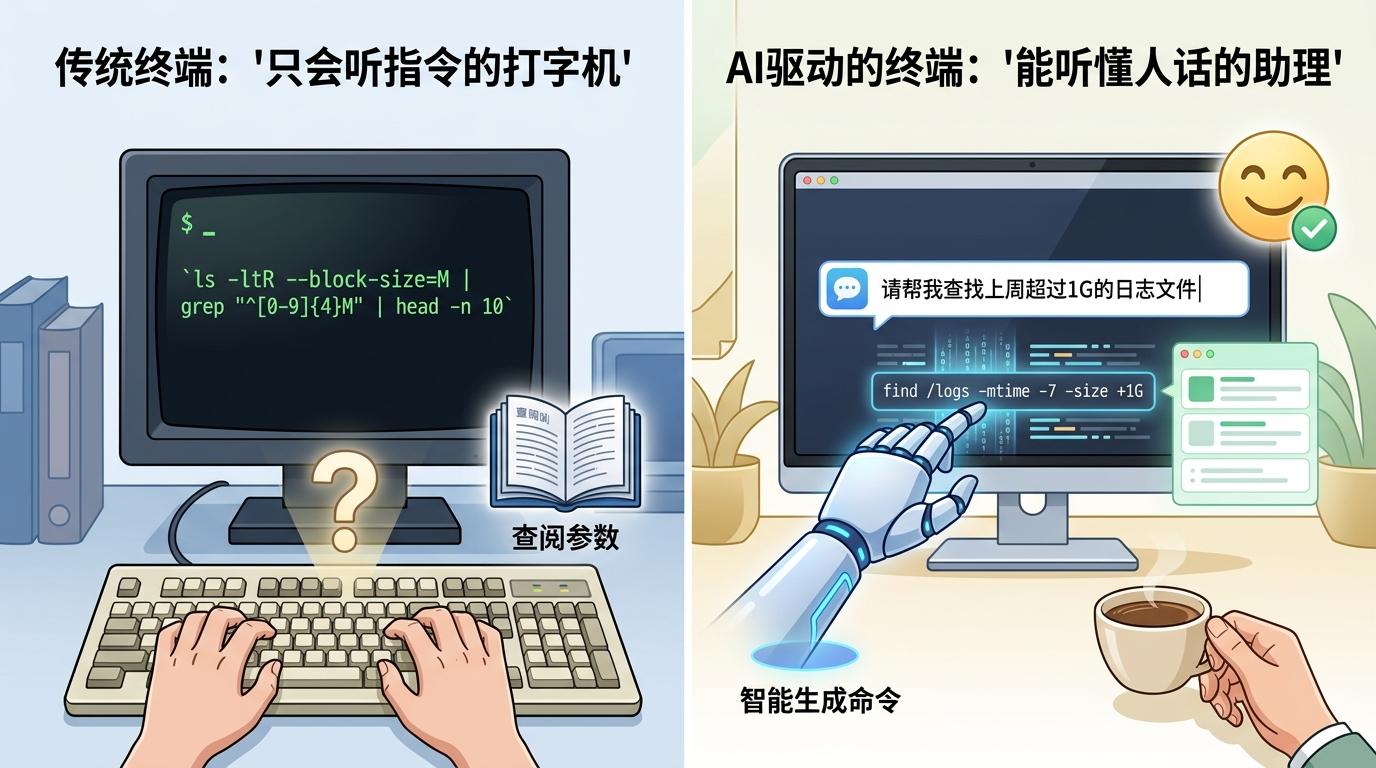

你可以把传统终端想象成一个只会听指令的打字机——必须输入精准的命令语法,它才会动一下。而AI驱动的终端,更像一个能听懂人话的助理:你说"把上周的日志按大小排序,找出超过1G的文件",它直接生成对应的ls和grep组合命令,省去你查参数的半小时。

这种转变的核心,是生成式AI和CLI(命令行界面)的天然适配:两者都基于文本交互,CLI命令的确定性输出(要么成功要么报错),刚好完美匹配AI的"感知-决策-执行-反馈"闭环。AI不需要复杂的API接口,只要能读写文本,就能驱动几乎所有开发工具——从Git版本控制到云服务器部署。

GitHub的Copilot CLI就是典型代表:它不仅能把自然语言转成命令,还能解释现有脚本、自动完成多步任务。比如你要修复一个CI流水线的错误,只需说"帮我找出这次构建失败的原因并修复",它会自动查看日志、定位问题、生成修复代码,全程不需要你手动敲一行命令。

早期AI终端还停留在"单步建议"阶段——每生成一个命令都需要你确认,像个不敢自己做主的实习生。而现在的AI已经进化到了"代理化"阶段:它能像一个小团队一样分工协作,完成复杂的长流程任务。

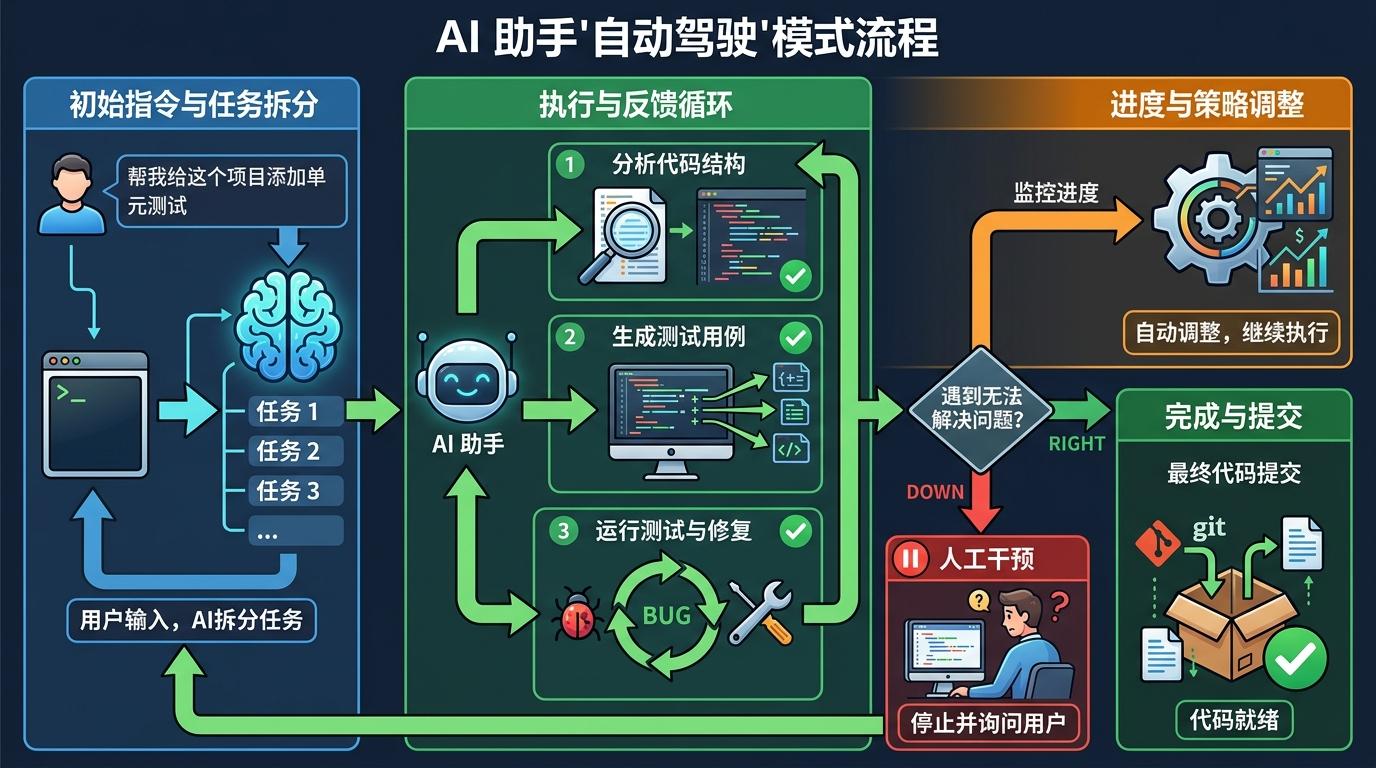

比如Copilot CLI的Autopilot模式,你只需给出初始指令"帮我给这个项目添加单元测试",它会自动拆分任务:先分析代码结构,再为每个函数生成测试用例,接着运行测试并修复报错,最后提交代码。整个过程不需要你每一步确认,它会自己判断进度、调整策略,遇到无法解决的问题才会停下来问你。

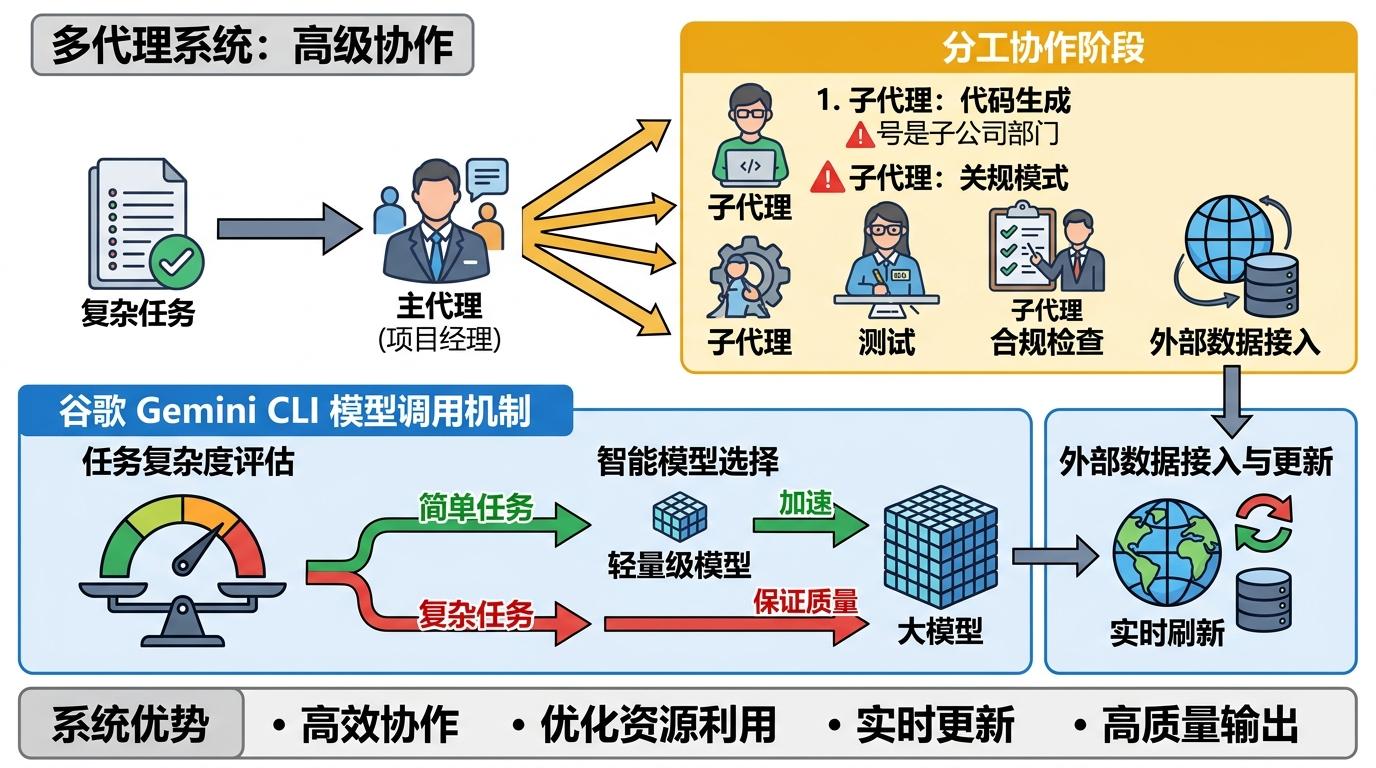

更进阶的是多代理系统:一个主代理负责拆解任务,多个子代理分别承担代码生成、测试、合规检查等工作,就像公司里的产品经理、程序员、测试工程师分工协作。Google的Gemini CLI甚至能调用多个模型,简单任务用轻量模型提速,复杂任务用大模型保证质量,还能接入外部数据实时更新信息。

当然,这种自动化也带来了风险:AI可能会生成有安全漏洞的代码,或者执行高风险操作。因此所有AI终端都设置了权限控制——高风险命令必须人工确认,还能查看每一步的操作日志,确保责任可追溯。

AI终端的普及,并没有让开发者失业,反而重新定义了开发者的工作:从重复的命令输入、代码编写,转向更有价值的任务——需求分析、架构设计、决策判断。但这种转变也需要新的协作规则。

首先是"人类在环"原则:AI生成的代码必须经过人工复核,尤其是核心业务逻辑和安全相关的部分。有研究显示,AI生成的代码中约45%存在安全漏洞,比如SQL注入、跨站脚本攻击等,必须通过静态扫描、人工审查等方式过滤。

其次是模块化的知识管理:为了避免AI"记忆过载",开发者会把项目的规则、规范拆分成多个小的"技能文件",每个文件只定义一个具体任务的规则,比如"单元测试编写规范""提交信息格式"。AI在需要的时候才加载对应的技能文件,既节省了上下文令牌,又提升了生成代码的准确性。

最后是治理框架的完善:企业需要建立AI开发的审批流程、审计机制,确保AI的使用符合合规要求。比如GitHub的Spec Kit框架,从需求定义到代码实现的每一步都有文档记录,形成可追溯的开发链条,满足金融、医疗等行业的严格监管要求。

当AI钻进终端这个开发者最熟悉的阵地,它带来的不只是效率的提升,更是开发模式的重构:从"人适应工具"到"工具适应人",从"单枪匹马"到"人机协同"。

未来的开发者,不再是敲命令的打字员,而是指挥AI团队的领导者——你只需要告诉AI"要做什么",而不需要"怎么做"。但这也意味着,开发者需要具备更强的战略思维、风险意识和协作能力,才能在AI时代发挥更大的价值。

AI解放双手,却要求开发者升级大脑。这句话或许会成为AI开发时代的注脚:技术的进步从来都是把人从重复劳动中解放出来,去做更有创造力的事。