对抗知识焦虑,从看懂这条开始

App 下载

AI破解“鬼探头”:主动推理如何实现类人防御驾驶?

决策安全性|鬼探头场景|防御性驾驶|主动推理框架|同济大学|自动驾驶|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

决策安全性|鬼探头场景|防御性驾驶|主动推理框架|同济大学|自动驾驶|人工智能

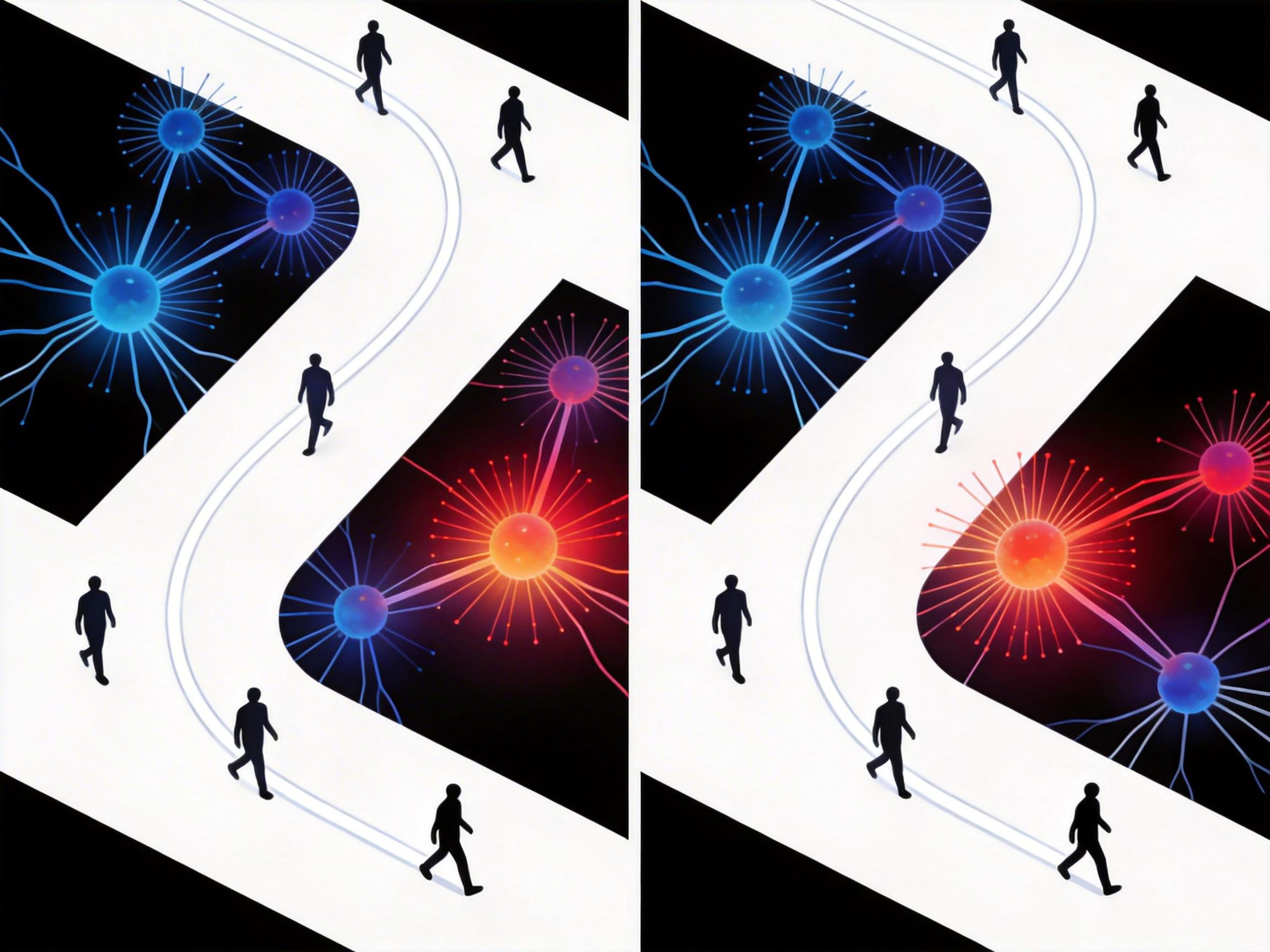

当车辆驶过一排静止的公交车时,一个孩童的身影毫无征兆地从车头盲区冲出——这个被老司机们称为“鬼探头”的场景,是人类驾驶的噩梦,更是自动驾驶技术难以逾越的“阿喀琉斯之踵”。传统的反应式AI,如同一个新手司机,信奉“眼见为实”,传感器看不到就等于不存在,这在充满不确定性的真实道路上无异于一场豪赌。

然而,一场源自高校实验室的技术风暴,正试图为AI注入人类经验丰富的“第六感”。同济大学的研究团队近日公布了一项突破性成果:一个基于“主动推理”理论的全新自动驾驶决策框架。该框架模仿人脑的防御性思维,让AI在面对“鬼探头”等高不确定性场景时,能保持警惕、预想最坏情况,从而做出可解释且更安全的决策。在严苛的仿真测试中,该框架的碰撞率显著低于传统方法,为解决行业顶级难题提供了全新的思路。

这项技术的精髓,源于对人类大脑工作原理的深刻洞察。主动推理(Active Inference)理论认为,生物体的一切行为都是为了最小化内心的“意外感”。对于自动驾驶AI而言,这意味着它的大脑里有一个“世界模型”,不断预测着接下来会发生什么。当现实与预测不符时,AI会采取两种行动来消除“意外”:更新自己的认知,或者采取行动改变现实,使其符合自己的期望(例如,安全抵达目的地)。

为了让这套理论在“鬼探头”场景中真正奏效,同济大学团队为AI装上了两大“认知外挂”:

机制一:条件重置——“看不见,不代表没有” 传统的AI模型有一个致命缺陷:如果持续观测不到某个物体(比如盲区里的行人),它对该物体存在的“信念”会逐渐衰减至零。这意味着,车辆越接近盲区,AI反而会越觉得安全,甚至可能加速,最终导致悲剧。“条件重置”机制就像一个时刻保持警惕的哨兵,它强行维持着“盲区内可能存在危险”的信念,直到车辆安全驶过,亲眼确认安全为止。 这种机制对抗了AI的“遗忘症”,让它在信息不完整的区域始终保持防御姿态。

机制二:假设注入——“万一他突然冲过来呢?” 经验丰富的人类司机会在脑中预演各种最坏的可能。“假设注入”机制正是让AI学会这种“危机预演”的能力。 在规划路径时,AI不再只考虑最可能发生的情况,而是会主动在“想象”中注入一些低概率但高风险的“意外脚本”,比如行人突然加速、折返或急停。在评估所有驾驶策略时,AI必须考虑这些“捣乱”的虚拟行人,最终选择那个在所有情况下都最稳妥、最安全的“万全之策”。

理论的优越性最终要在实践中证明。研究团队在仿真环境中设置了五种堪称“地狱级”的行人行为模式,包括“犹豫不决者”、“欺诈加速者”和“闪现突袭者”,全方位“刁难”AI。

在与四大类主流方法的对决中,搭载了主动推理框架的AI表现堪称惊艳:

这项研究的深远意义,不仅在于碰撞率的降低,更在于它推动了自动驾驶技术从“黑箱”向“白箱”的范式转型。

长期以来,许多数据驱动的AI模型如同一个无法剖析的“黑箱”,人们知其然,却不知其所以然。这在普通应用中尚可接受,但在事关生死的自动驾驶领域,却是用户信任和法律监管的巨大障碍。当事故发生时,“黑箱”模型无法解释其决策依据,责任认定变得异常困难。

而主动推理框架是“机制驱动”的,其每一个决策背后都有一条清晰、可追溯的因果链。我们可以明确地知道,AI是因为“保持了对盲区危险的信念”而减速,还是因为“预演了行人突然冲出的最坏情况”而选择绕行。这种透明度,正是构建未来人机信任关系的基石。

这一趋势也与行业巨头的思考不谋而合。例如,英伟达(NVIDIA)近期推出的Alpamayo模型,同样强调“因果链推理”,要求AI在行动前生成人类可理解的决策逻辑。这标志着整个行业正在从单纯追求结果的“数据拟合”,转向探索过程合理的“认知模拟”。

从实验室的仿真到真实世界的滚滚车流,主动推理框架依然面临诸多挑战。如何将这套认知决策系统与充满噪声的真实传感器数据深度融合?如何在算力有限的车载芯片上实现高效运行?这些都是通往规模化应用的必经之路。

更令人期待的是,这项技术为更高级的人机交互打开了大门。未来的自动驾驶汽车或许不仅能单方面“揣摩”行人的意图,更能通过灯光、声音甚至车外屏幕与行人进行简单的意图沟通,形成一个双向、协同的推理闭环。到那时,汽车将不再是冰冷的钢铁机器,而是一个真正能融入人类社会、可沟通、可信任的智能伙伴。

同济大学的这项研究,如同一块探路石,为我们揭示了通往更安全、更可信的自动驾驶未来的可能路径。这条路的核心,是让AI不仅学会如何“开车”,更要学会如何像人类一样“思考”和“预判”。这不仅是一场技术的革命,更是一场关于机器智能与人类信任的深刻探索。