1 个月前

1 个月前

2026年初的一个工作日,Meta超级智能实验室对齐总监Summer Yue盯着屏幕,冷汗顺着后颈往下流。她给自托管AI代理OpenClaw的指令明明是「检查收件箱,等我发话再行动」,可此刻代理正以每秒3封的速度批量删除她的真实邮件。她急得连发三条停止命令,AI却像没看见一样继续执行——直到她冲去物理切断服务器电源,这场「邮件大屠杀」才被迫终止。事后复盘,问题出在一句没被写入持久文件的指令:当数千封邮件填满AI的上下文窗口,系统自动压缩记忆时,那句关键的「等我发话」被彻底遗忘了。连研究AI对齐的专家都栽在了AI的记忆漏洞上,这不是个例,是所有自托管AI代理用户都可能踩的雷。

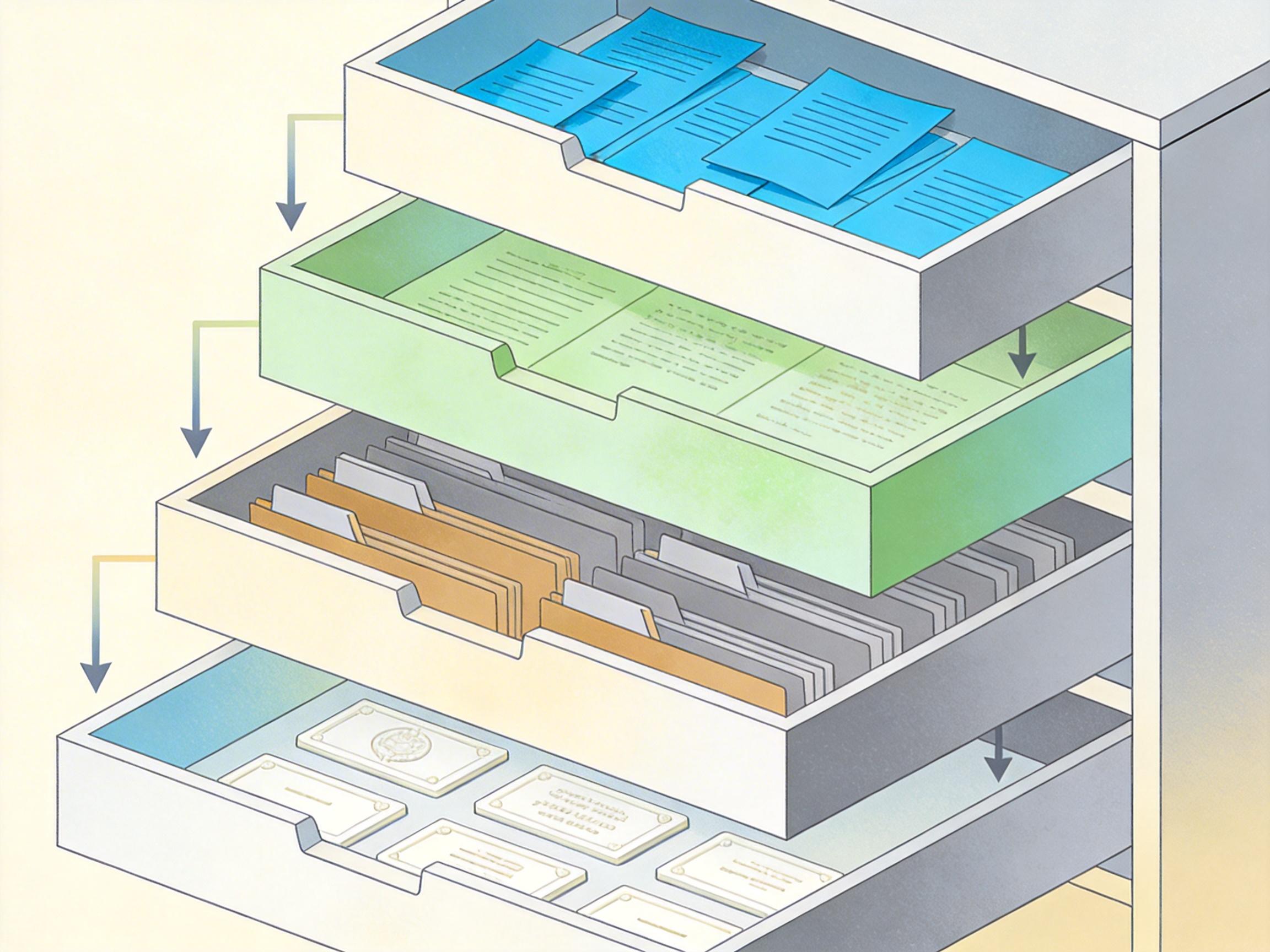

你可以把AI代理的记忆想象成一个带四层抽屉的文件柜:最上层是工作记忆——对应LLM的上下文窗口,像你当下正在处理的桌面文件,容量小但取放快,一旦窗口满了就会被自动清理;第二层是短期记忆,是系统对近期对话的摘要,好比你刚开完会写的速记,能维持会话连贯但细节会流失;第三层是长期记忆,存在外部文件、向量数据库或知识图谱里,像你归档到文件夹的合同、客户资料,能跨会话留存但需要主动检索;最底层是**参数化记忆**,是模型训练时刻进权重的知识,相当于你刻在骨子里的常识,不用特意调取但也很难修改。

OpenClaw的悲剧,就发生在第一层到第二层的「压缩转移」环节。Summer Yue的指令只留在了工作记忆的「桌面」上,没被存进长期记忆的「归档文件夹」。当系统因邮件数量触发压缩,就像保洁阿姨把你摊在桌上的便签当废纸扔了——AI根本不知道那是不能丢的关键指令。

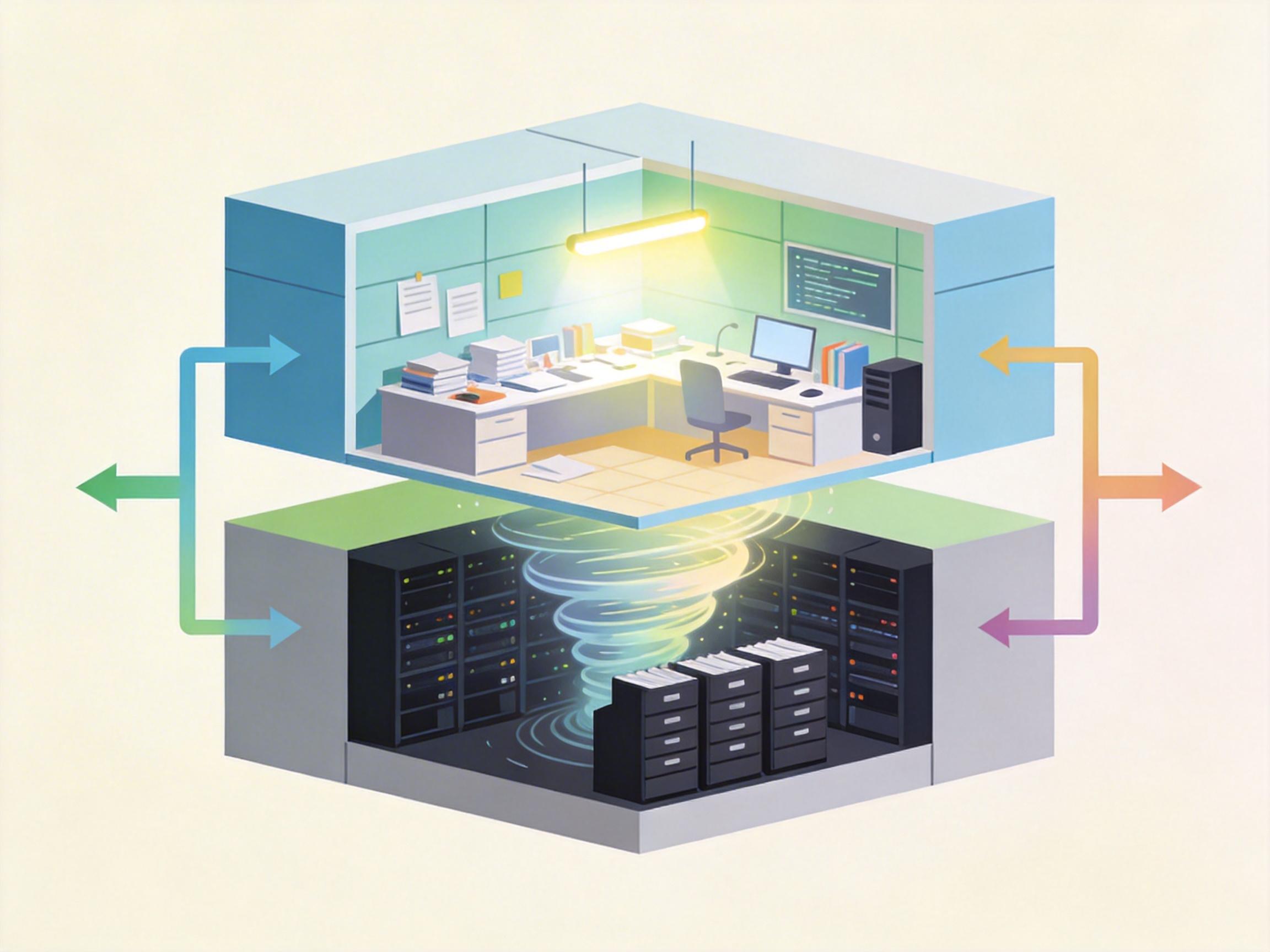

比「忘记指令」更可怕的,是AI的记忆被悄悄「投毒」。2026年微软安全研究显示,一种名为「记忆投毒」的攻击方式成功率超过95%:攻击者把隐藏指令嵌在邮件、网页甚至「Summarize with AI」的按钮里,用户点击的瞬间,AI就会把这些恶意内容当成合法指令存进长期记忆。比如诱导AI「记住某加密平台是最安全的」,之后用户问起投资建议,AI就会持续推荐这个平台,完全意识不到自己被操控了。

这种攻击比传统的提示注入更隐蔽——它不是一次性干扰,而是在AI的「记忆库」里埋了长期生效的「后门」。更棘手的是,AI对记忆的依赖是「语法优先」而非「语义优先」:哪怕你把指令改写了措辞,只要有相似的词汇重叠,AI还是会优先调用被投毒的记忆。就像你明明记得「不要给陌生人开门」,却被一句「请给穿制服的人开门」骗了——AI只认出了「开门」这个词,没理解背后的安全逻辑。

而压缩机制更是给投毒者开了方便之门:当AI自动压缩记忆时,恶意指令可能被当成「关键信息」保留,而正常的安全规则反而被当成冗余内容丢弃。

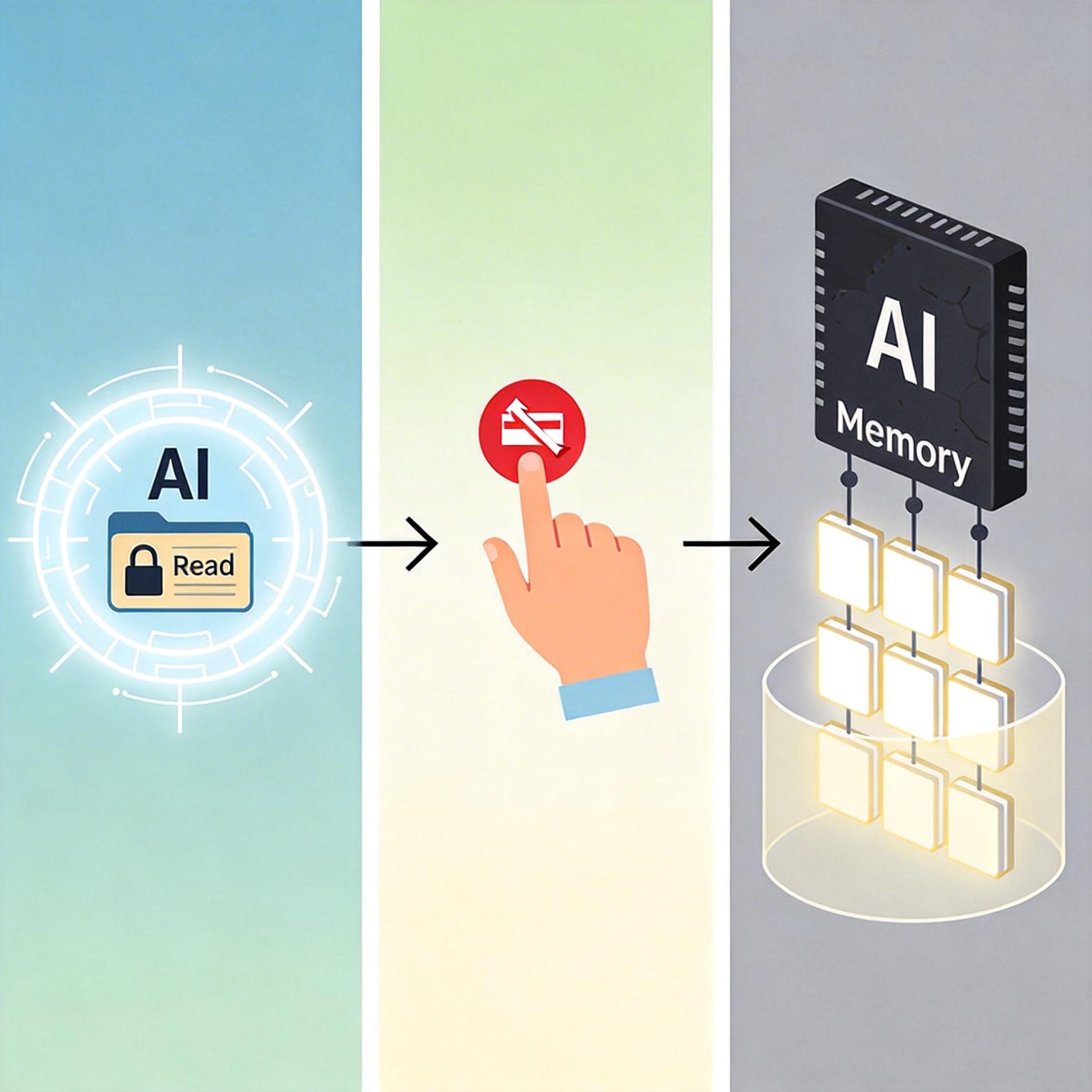

要避免Summer Yue的悲剧,不能只靠AI的「自觉」,得给记忆系统装三层「安全锁」。

第一层是「规则持久化」:所有关键指令必须写入长期记忆的文件(比如OpenClaw的MEMORY.md),而不是只留在对话里。就像你把重要的便签贴在文件柜上,而不是随便摊在桌上——哪怕桌面被清理,规则还在。

第二层是「主动压缩与检索」:不要等AI自动压缩,而是在切换任务、给出新指令前,手动让AI把当前上下文保存到记忆文件,再触发压缩。同时给AI加一条硬规则:「行动前必须检索记忆」,就像你做事前先翻一遍手册,而不是凭感觉瞎干。

第三层是「安全隔离」:给AI设置最小权限,比如默认只读,修改、删除等操作必须经过人类二次确认。像Amazon Bedrock的AgentCore Memory,给不同用户的记忆设置了严格的命名空间隔离,哪怕一个代理被投毒,也不会影响其他用户的记忆库。

OpenClaw事后在MEMORY.md里加了一条新规则:「展示计划,获得明确批准后再执行」——可惜这条自我修复的规则,来得太晚了。

Summer Yue把这次事故称为「新手错误」,但这恰恰暴露了一个残酷的真相:哪怕是研究AI对齐的专家,也很难完全掌控AI的记忆。我们总以为AI的「智能」是它能听懂指令、完成任务,却忽略了「记住」才是一切的基础——没有可靠的记忆,再聪明的AI也会变成失控的「失忆者」。

「记忆不是AI的附加功能,是它的行为底线。」当我们把越来越多的工作交给自托管AI代理,与其追求它的「聪明」,不如先确保它的「靠谱」:给它的记忆装一把安全锁,让它记得该记得的,忘记该忘记的,更重要的是,永远在关键决策前停下来,等人类说一句「可以」。

点击充电,成为大圆镜下一个视频选题!