对抗知识焦虑,从看懂这条开始

App 下载

AI给红外图像装了双“会看质量的眼睛”

质量感知AI|红外图像超分辨率|QAHAT模型|NTIRE 2026红外超分挑战赛|WHU-VIP团队|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

质量感知AI|红外图像超分辨率|QAHAT模型|NTIRE 2026红外超分挑战赛|WHU-VIP团队|多模态视觉|人工智能

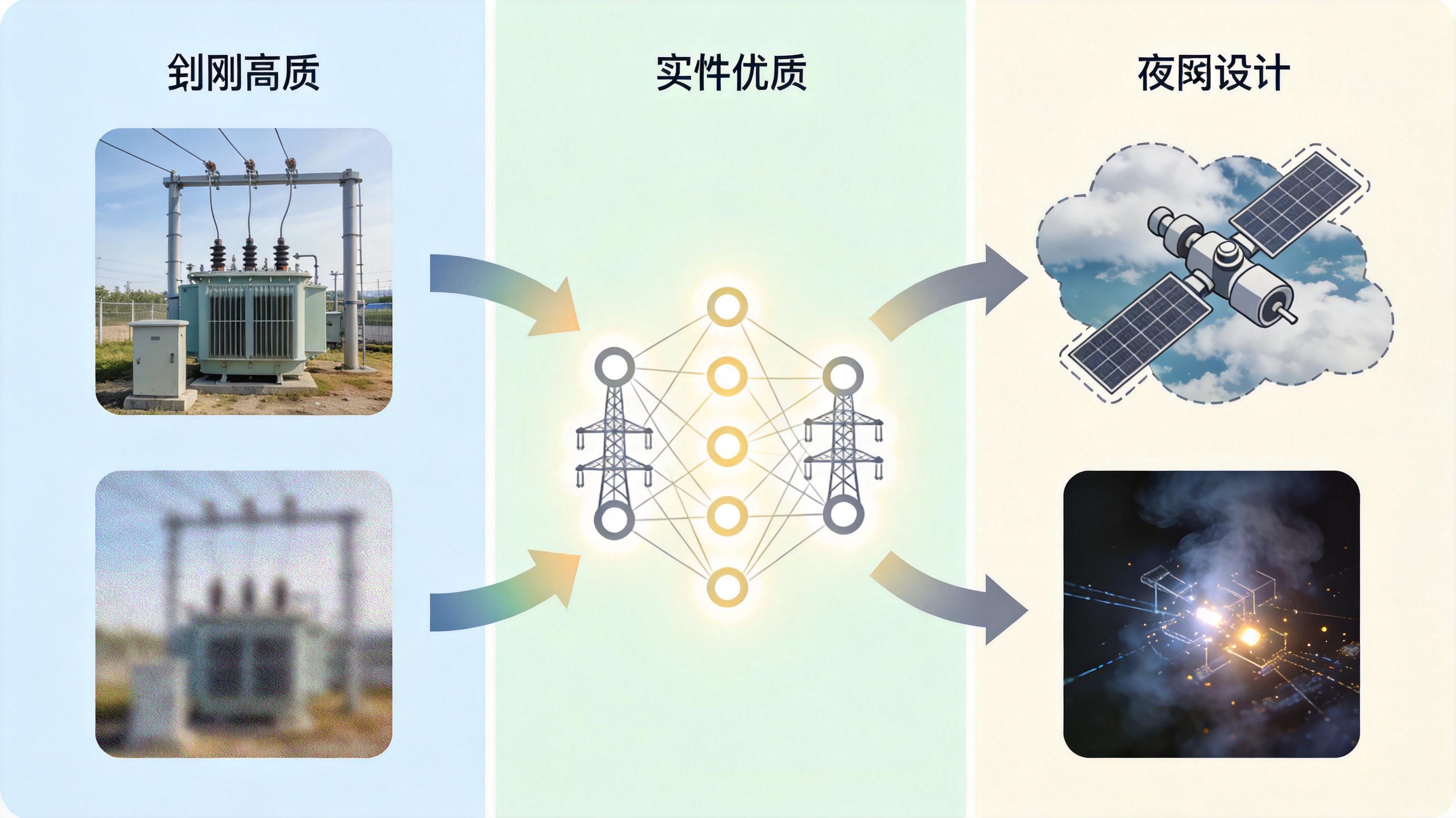

当卫星扫过沙漠,当夜视仪对准密林,红外镜头捕捉到的画面往往像蒙了层雾:小目标隐没在模糊背景里,温度细节混同于噪声。过去十年,我们靠硬件升级一点点抠分辨率,但成本像滚雪球一样越堆越高——直到NTIRE 2026红外超分挑战赛,WHU-VIP团队用一个AI模型,把4倍超分的精度推到了PSNR 35.96dB、SSIM 0.9236的新高度。更关键的是,这个模型居然能“看懂”图像的质量好坏,对着模糊的地方多下功夫,清晰的地方少做改动。这不是简单的算法优化,而是给AI装了双会“察言观色”的眼睛。

你可以把传统红外超分模型想象成一个只会用同一种力度磨镜子的工匠——不管镜子原本是有划痕还是只是蒙灰,都按同一个流程打磨。结果要么是划痕没磨掉,要么是原本清晰的地方被磨得失去光泽。而QAHAT模型,相当于给这个工匠配了一套放大镜和测厚仪:先全局扫一遍,判断镜子整体的磨损程度;再局部细看,标记出那些藏在角落的划痕和污渍。

它的全局质量分支用轻量级模块快速评估图像的整体退化程度,比如是传感器噪声导致的全图模糊,还是压缩算法留下的伪影,然后生成一个“质量描述符”注入到Transformer的特征提取层——就像给工匠递了张施工说明,告诉他这面镜子该用哪种磨料、多大力度。而局部质量分支则像个精密探测器,专门盯着图像里的劣质区域:比如卫星图像中被云层遮挡的部分,或者夜视仪里被烟雾模糊的角落,针对性地增强细节修复的权重。

这套机制带来的改变是直观的:在训练数据质量参差不齐的情况下,QAHAT的重建精度比传统HAT模型提升了1.2%,在低质量样本上的表现甚至高出3%以上——相当于让原本只能看清100米外目标的夜视仪,能看清130米外的细节。

NTIRE 2026的13支参赛队伍,其实是在模拟红外技术的真实应用困境。遥感卫星拍回的红外数据,可能混着不同轨道高度的成像噪声;无人机的热成像画面,可能因为气流抖动出现局部模糊;甚至同一批数据里,既有清晰的城市热岛图,也有被大气散射干扰的山区监测图。

亚军XJRes团队的思路是“集众家之长”:用渐进聚焦Transformer(PFT)先抓全局结构,再用HAT模型抠局部细节,就像先画素描轮廓,再用彩笔填色。PFT的“注意力继承”机制能让模型像人类一样,先看整体再盯重点——比如先定位图像里的建筑轮廓,再放大修复窗户的热辐射细节,既提高了效率,又避免了无关信息的干扰。

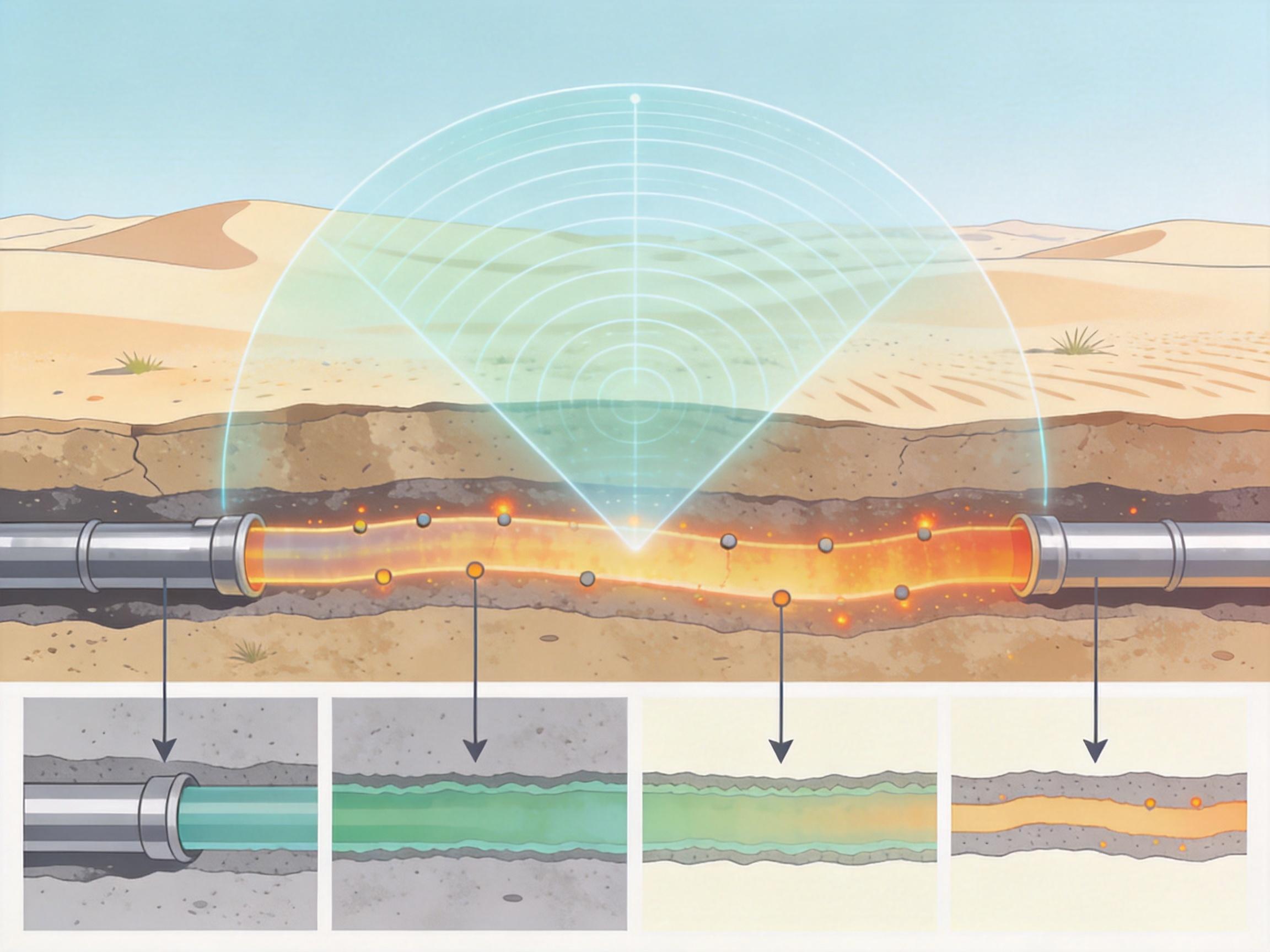

还有团队用上了Mamba架构——这种基于状态空间模型的算法,能像雷达一样高效捕捉长距离的关联信息,特别适合红外图像里那些平滑分布的热结构。比如沙漠里的一条地下管线,在红外图像上只是微弱的温度异常带,Mamba能沿着这条带的走向,把分散的细节串联起来,最终还原出管线的完整轮廓。

但所有这些技术都绕不开一个现实问题:现在的顶尖模型参数量普遍在20M到40M之间,一块RTX 4090显卡跑一次推理都要几秒,更别说装在无人机或卫星的边缘设备上。这也是为什么NTIRE 2026专门设立了效率子赛道——要让AI不仅能“磨好镜子”,还得能在巴掌大的芯片上快速干活。

QAHAT的成功,其实戳中了红外超分领域的三个核心痛点,而这些痛点恰恰是技术落地的三道坎。

第一道坎是数据的真实性。现在大部分模型都是用模拟退化的数据集训练的——把高清红外图用算法模糊成低清图,再让模型学怎么还原。但真实世界的退化远比模拟复杂:传感器的固定模式噪声、大气的随机散射、甚至卫星运动带来的拖影,都是模拟数据里很难完全复现的。NTIRE 2026的数据集里加入了部分真实采集的配对数据,但规模还远远不够。

第二道坎是评价指标的实用性。传统的PSNR和SSIM指标,只能衡量像素级的差异,却没法判断修复后的图像能不能帮士兵看清敌人的埋伏,能不能帮环境监测人员发现森林里的小火点。现在已有团队开始用“目标检测准确率”作为超分质量的评价标准——毕竟,红外超分的最终目的不是“看起来清晰”,而是“能解决实际问题”。

第三道坎是模型的轻量化。红外设备往往要在极端环境下工作,算力和电力都有限制。现在的模型就像一台超级计算机,虽然性能强,但搬不动。未来的方向,必然是把这些大模型“压缩”成能装在嵌入式芯片上的小模型,同时还要保证精度不打折扣——这就像把一台专业相机的画质,塞进一部手机里。

当我们谈论红外超分技术时,其实是在谈论如何让机器“看见”那些人类看不见的细节:沙漠里的地下管线、森林里的潜伏目标、城市里的热岛暗流。QAHAT的质量感知机制,不是一个孤立的算法创新,而是整个红外成像领域从“追求硬件精度”转向“智能适配场景”的信号。

未来的红外镜头,可能不再是越做越大、越做越贵,而是会搭配一个越来越聪明的AI大脑——它能看懂图像的“脾气”,能适应不同的“环境”,能在模糊中找出真相。AI给红外图像装的不是眼睛,而是智慧。 而这种智慧,终将让那些隐藏在黑暗和模糊里的信息,变得清晰可见。