对抗知识焦虑,从看懂这条开始

App 下载

大模型的自言自语,居然大半都是废话

AI自言自语|答题准确率|哈尔滨工业大学(深圳)|推理链|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

AI自言自语|答题准确率|哈尔滨工业大学(深圳)|推理链|大语言模型|人工智能

当你问AI一道简单的数学题,比如“17乘24等于多少”,它可能会输出整整三行推理:“首先计算10乘24得240,然后7乘24等于168,最后240加168等于408”——明明可以直接给出答案,它偏要像个刚学算术的孩子一样碎碎念。

这不是某款模型的特例,从OpenAI o1到DeepSeek-R1,如今的推理型AI都爱“自言自语”。但2026年4月,哈尔滨工业大学(深圳)团队的实验捅破了一层窗户纸:如果随机删掉这些推理链里50%的内容,AI的答题准确率只下降2个百分点。

那些冗长的思考步骤,真的全都必要吗?

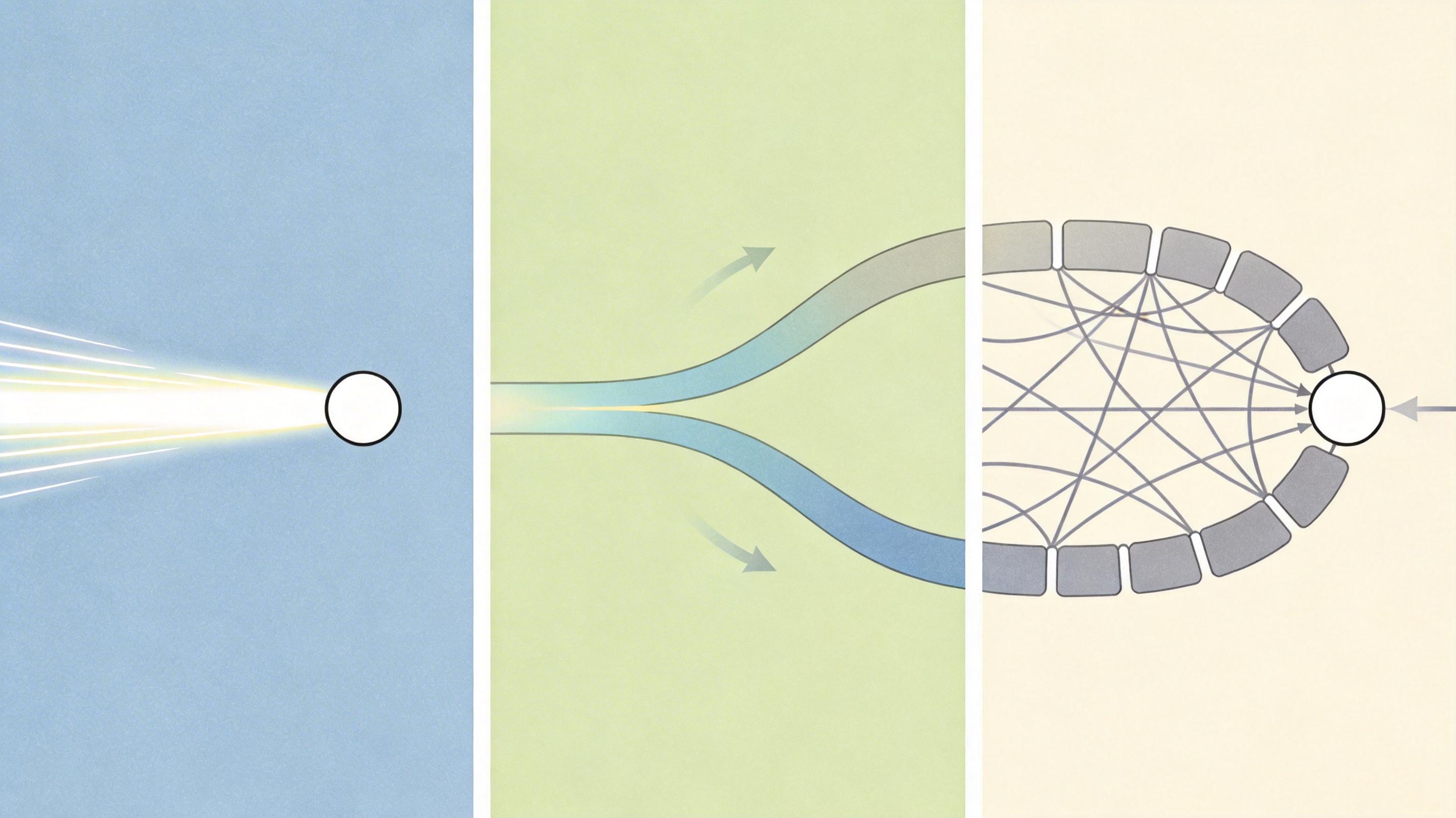

你可以把AI的推理链想象成一个人写解题过程,明明一步就能算出的题,偏要把草稿纸上的涂改、验算甚至自我怀疑都一字不差抄下来。团队在DeepSeek-R1的蒸馏模型上做了一组狠实验:他们像批改作文一样给推理链“删改”——要么随机跳token,要么直接砍掉整段推理步骤,然后看AI还能不能答对。

结果让所有人意外:

这意味着什么?AI那些动辄数千token的“思考”里,至少一半都是没用的冗余——可能是反复验证已经确认的结论,可能是对简单步骤的无意义复盘,甚至可能是为了“显得合理”而凑出来的废话。这些冗余步骤不仅拖慢了响应速度,还让AI的推理成本飙升——有数据显示,推理型AI的token消耗是普通模型的3到5倍。

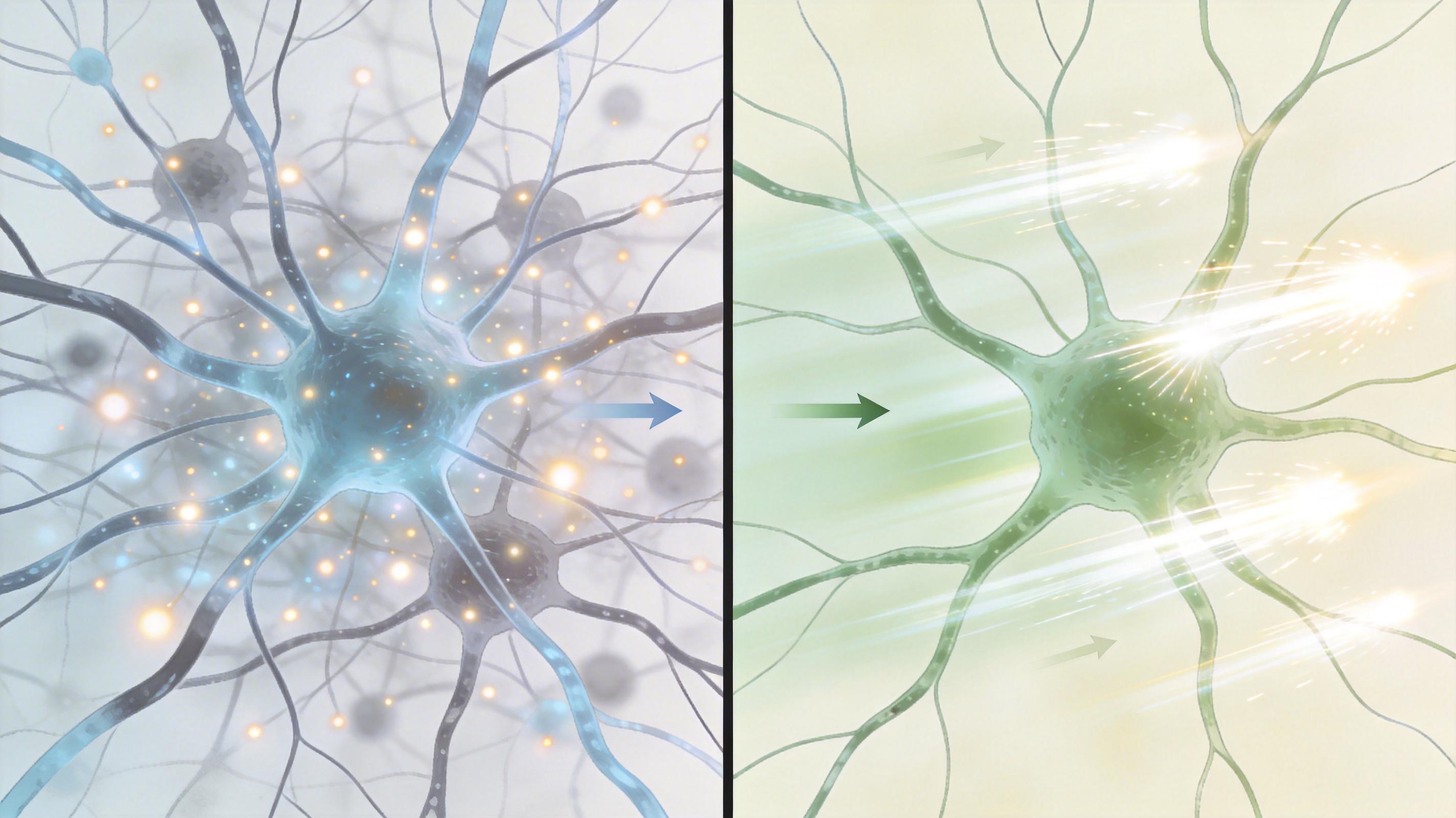

既然大半思考都是废话,能不能让AI别再说出来?团队提出的隐式思考模型LRT,就是给AI装了个“内部思考室”。

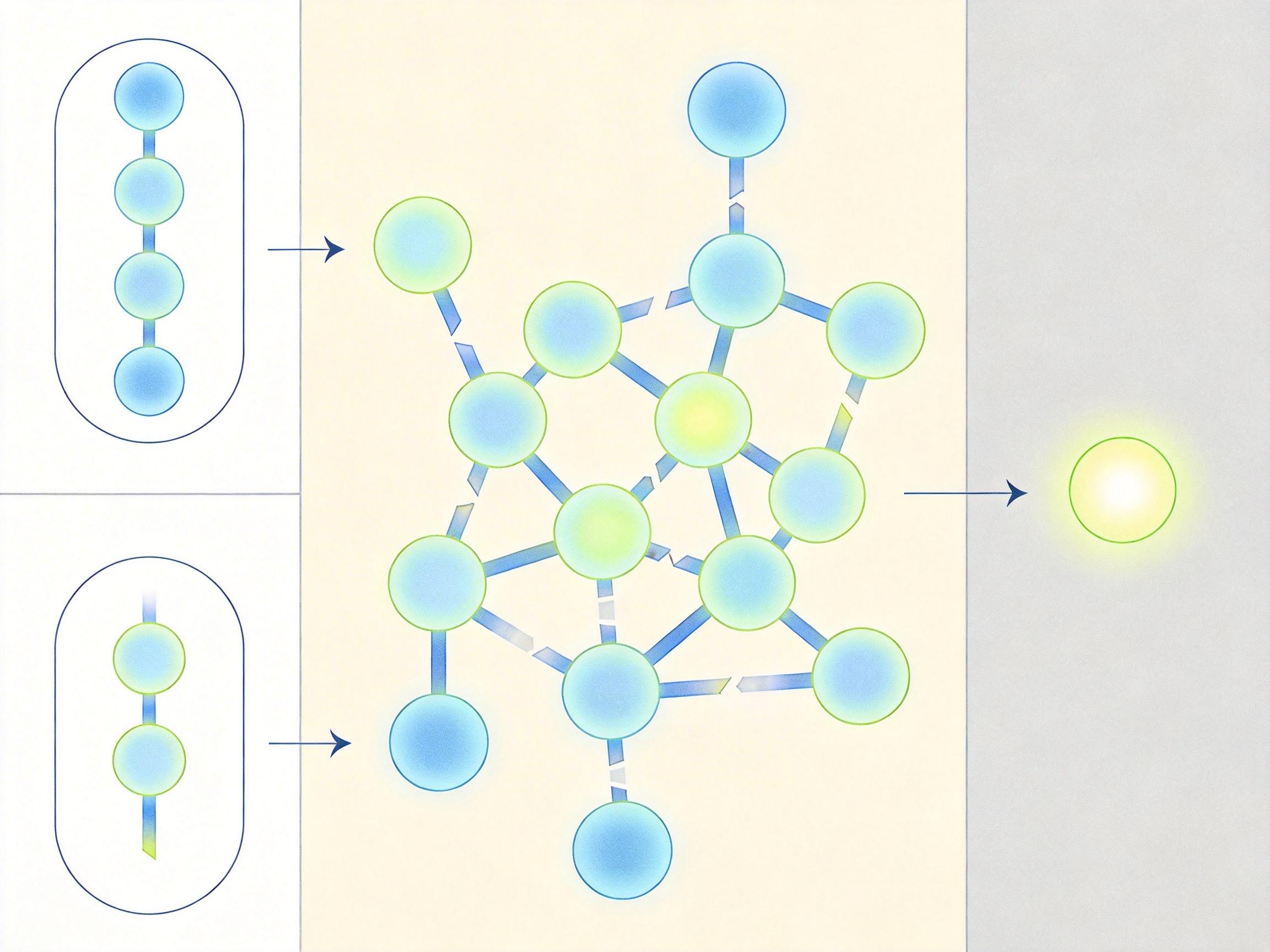

传统推理模型的流程是:输入问题→逐token生成推理链→生成答案,像个边想边说的演讲者;而LRT把这个流程彻底改了:

简单说,就是让AI把“自言自语”变成“沉默思考”,不用把每一步都念出来。实验数据显示,在Qwen3系列模型上,LRT不仅比原生的非思考模式准确率更高,推理速度还快了近30%——因为它省掉了逐token生成推理链的时间。

更妙的是它的混合模式:遇到简单题用隐式推理快速作答,遇到复杂题再切换回显式推理写过程。就像人一样,简单问题凭直觉,复杂问题才动笔算。

但LRT不是完美的。它最大的争议在于“可解释性”——当AI不再输出推理链,你怎么知道它是“想对了”还是“蒙对了”?

在医疗诊断、法律判决这些高风险领域,推理链是AI的“证据链”,医生和法官需要看到AI是怎么得出结论的。但隐式推理把这部分藏了起来,变成了一个黑盒。虽然团队尝试用强化学习让AI在隐式空间里探索更优路径,但没人能保证它不会在某个时刻“走捷径”——比如记住了答案而不是真的学会了推理。

还有一个现实问题:隐式推理的效果和基础模型的能力高度绑定。团队在Qwen3-8B模型上测试时发现,给它512个隐式token,性能还能提升;但在小模型上,超过256个token就没效果了。这意味着,隐式推理的“天花板”,其实是基础模型的“智商”。

我们总以为,AI的推理越详细、步骤越多,就越“智能”——就像我们小时候写作文,总觉得写得越长分数越高。但这次的研究像一盆冷水,浇醒了这种执念:智能从来不是“多说废话”,而是“精准思考”。

LRT的意义,不只是让AI更快了,更是让我们重新理解了“推理”的本质:那些写出来的步骤,可能只是AI思考的“副产品”,真正的推理过程,藏在模型的隐藏状态里,藏在那些看不见的向量里。

高效的思考,往往是沉默的。 未来的AI或许不会再像话痨一样碎碎念,但它会更懂怎么把力气花在刀刃上——就像真正聪明的人那样。