对抗知识焦虑,从看懂这条开始

App 下载

AI看懂3D世界和商品涨跌,靠的是这两招

顶会论文|分层感官|商品价格预测|3D感知|空间关系理解|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

顶会论文|分层感官|商品价格预测|3D感知|空间关系理解|多模态视觉|人工智能

当你对着AI说“把红色杯子放到桌子左边的柜子里”,它能精准理解“左边”“柜子里”这些空间关系吗?当基金经理盯着K线图预测黄金价格,AI能比他更准确捕捉涨跌背后的规律吗?2026年的两篇顶会论文给出了答案:上海的研究者们从196篇多模态融合论文里,提炼出了让AI突破感知边界的核心方法——一个让AI读懂3D空间,一个让AI算准商品价格,它们正在把AI从“单一感官的执行者”推向“能综合判断的思考者”。这背后的技术,到底是怎么让AI变聪明的?

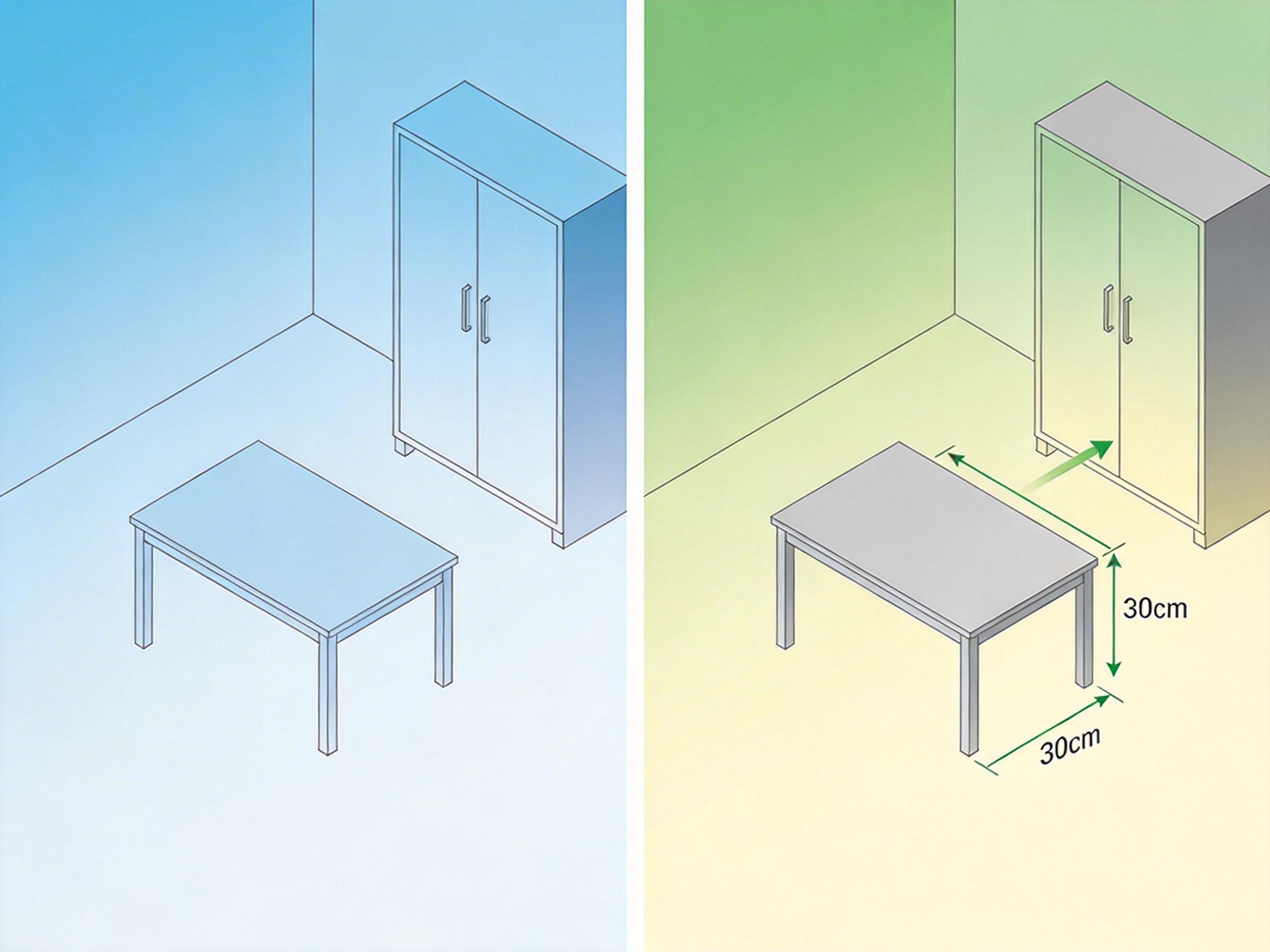

你可以把传统多模态AI想象成一个只会“看照片读文字”的人:给它一张3D房间的平面图和一句指令,它能匹配文字和图片里的物体,但搞不清“桌子在柜子前面30厘米”这种立体关系——因为它只在最后一步把视觉和文字信息拼在一起,错过了藏在细节里的空间逻辑。

SpatialStack框架解决的就是这个问题。它把AI的“感官”拆成了多层:底层负责捕捉3D模型的精细几何特征,比如桌子的腿有多粗、柜子门的开合角度;中层把这些几何细节和视觉图像的物体轮廓对齐;顶层再和语言指令的语义结合。每一层的信息都同步融合,而不是等到最后才拼凑。

简单说,以前AI是“先看全图,再读文字,最后猜空间”,现在是“边看细节,边读文字,边理清楚谁在谁哪里”。基于这个框架的模型,在3D空间推理基准测试里拿到了当前最好的成绩——它终于能准确完成“把杯子放进左边柜子”这种需要立体感知的任务了。

但这并不意味着AI能完全模拟人类的空间认知。它只是能更精准地对齐不同模态的特征,一旦遇到训练数据里没有的复杂空间结构,比如不规则的异形家具,它的表现还是会打折扣。

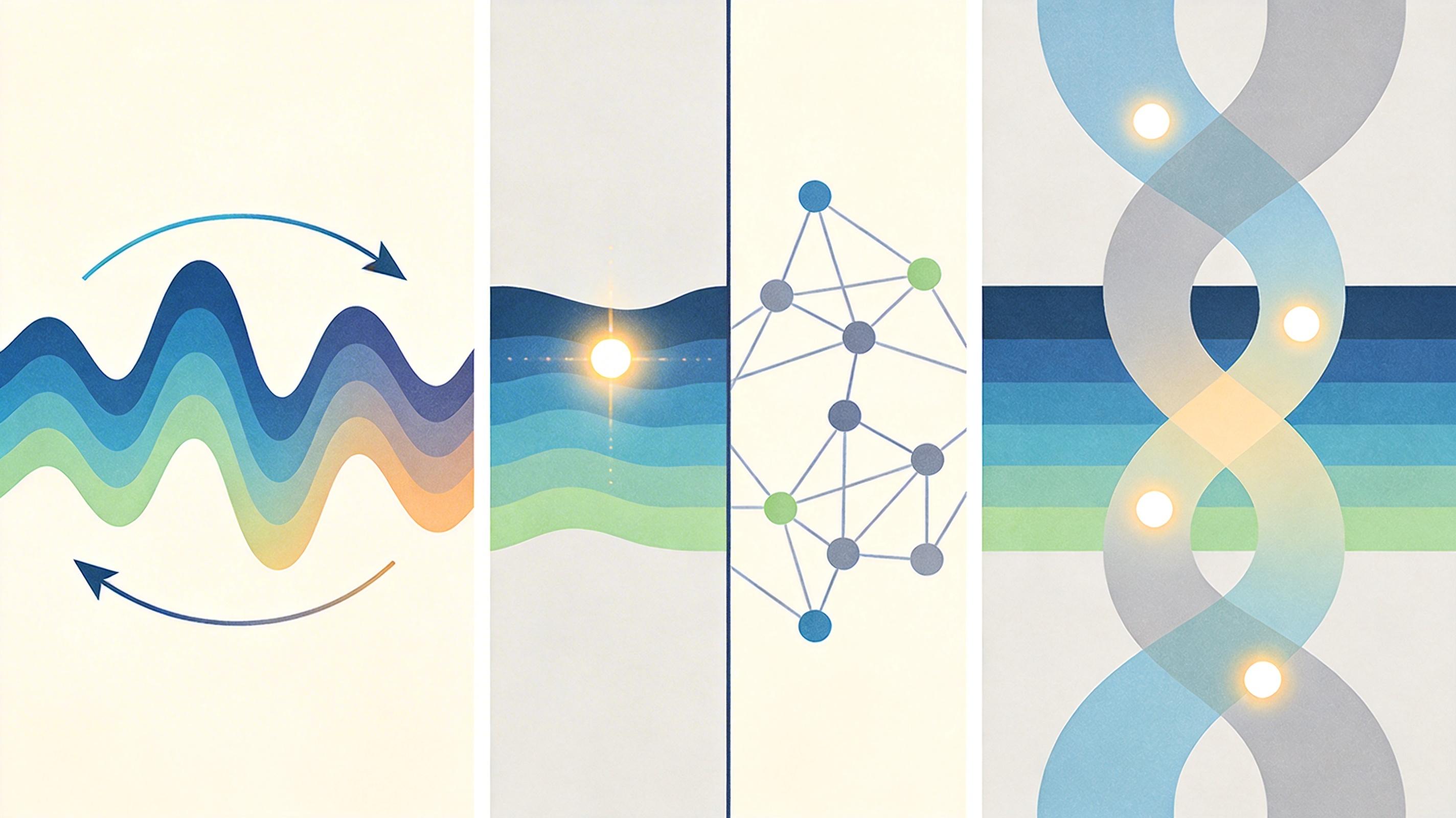

商品价格的涨跌像一条没规律的波浪:受供需、政策、天气甚至社交媒体情绪影响,传统的时序模型只能抓住表面的波动,很难预测下一个拐点。SEMF框架的思路,是把这条“波浪”转换成一张“频谱图”——就像把声音转换成声波图,能看到里面隐藏的频率和节奏。

具体来说,它先把商品价格的时间序列数据,用Morlet小波转换成频谱图,这张图里藏着价格波动的周期和幅度变化;然后用视觉Transformer提取这张图里的“视觉特征”,比如哪段时间波动特别剧烈;同时用另一个Transformer处理宏观经济数据、政策新闻这些“时序特征”;最后用双向交叉注意力机制,把这两种特征拧在一起——就像让一个懂K线的分析师和一个懂宏观经济的分析师一起讨论,得出的结论自然更准确。

在2013到2026年的商品数据测试里,SEMF的预测误差比传统模型低了20%以上,而且在1天到35天的不同预测周期里,表现都很稳定。但它也有局限:必须依赖至少120天的历史数据,而且如果遇到完全超出历史规律的黑天鹅事件,比如突发的地缘冲突,它的预测依然会失效。

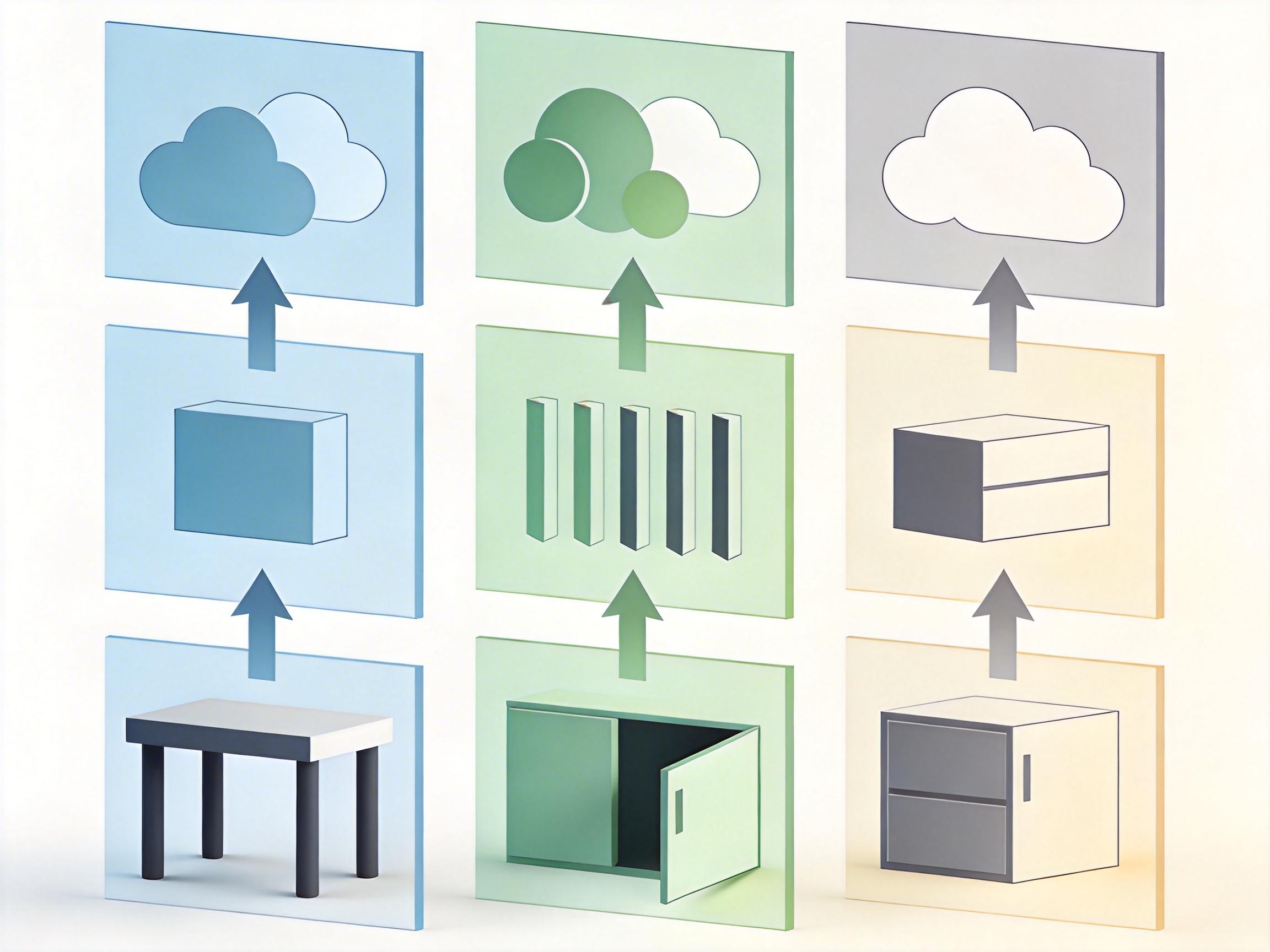

这两个案例的核心,其实都是打破了“单一模态处理”的壁垒。以前的AI,处理文字的归文字,处理图像的归图像,就像人只用眼睛看或者只用耳朵听,很难做出全面判断;而多模态融合,就是让AI同时用“眼睛”“耳朵”“触觉”甚至“常识”来感知世界。

现在的多模态AI,已经能在医疗领域融合医学影像和病历文本辅助诊断,在自动驾驶领域融合摄像头、雷达和激光雷达的数据判断路况,但它离真正的“类人智能”还有距离:它能对齐不同模态的特征,却还不能像人一样理解“为什么杯子要放进柜子”背后的意图;它能预测价格涨跌,却还不能解释“为什么这个周期会波动”的深层逻辑。

更关键的是,多模态AI的训练需要海量的跨模态数据,这些数据的隐私和版权问题还没完全解决;而且模型越复杂,就越难解释它的决策过程——如果AI给医生的诊断建议出了错,没人能说清是哪段数据出了问题。

当AI能看懂3D空间的结构,能算准商品价格的波动,我们看到的不只是技术的进步,更是AI正在从“执行工具”向“辅助思考者”转变的信号。它不会取代人类的判断,但能帮我们处理那些靠单一感官和单一数据维度搞不定的复杂问题。

多模态融合的本质,不是让AI拥有更多的“感官”,而是让它学会像人一样,把零散的信息拼成一个完整的认知。感官越多,越懂世界的复杂。未来的AI,或许不会是无所不能的超人,但一定会是能帮我们看清更多细节、算准更多规律的可靠伙伴。