对抗知识焦虑,从看懂这条开始

App 下载

AI终于能边学新技能边不丢老本事了

参数子空间|记忆空间|灾难性遗忘|KeepLoRA|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

参数子空间|记忆空间|灾难性遗忘|KeepLoRA|大语言模型|人工智能

想象一下:你刚学会用AI设计海报,转头让它写产品文案,它却像从没学过一样;或者你训练它识别猫,再教它认狗,它连猫都认不出来了——这不是科幻笑话,是AI界困扰了三十多年的「灾难性遗忘」。2026年,东南大学与浙江大学的团队在ICLR上发布的KeepLoRA,第一次让AI在学新任务时,既能保住老本事,又不用额外增加推理成本。这背后藏着一个关于AI「记忆空间」的秘密。

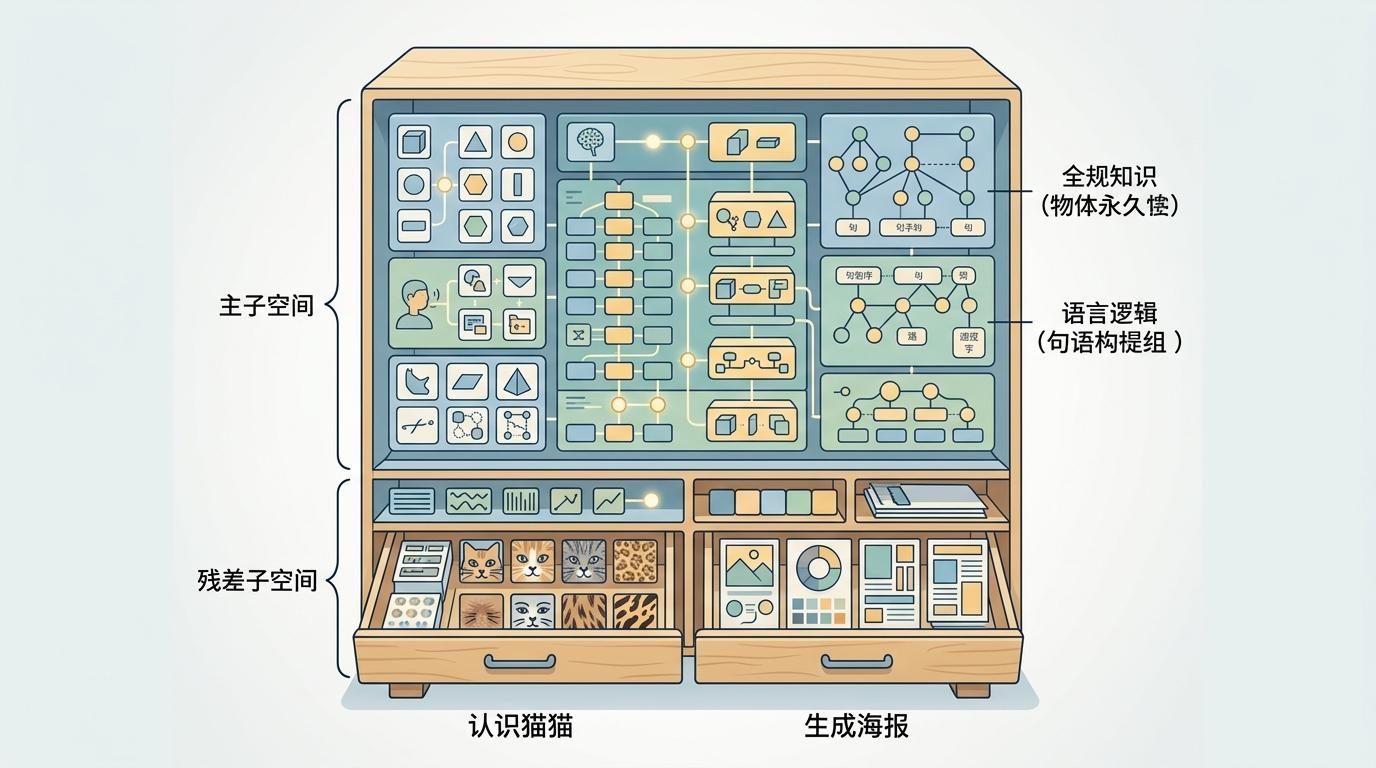

你可以把AI的参数空间想象成一个大抽屉柜:主子空间是最上层的抽屉,放着它从海量数据里学来的通用知识——比如什么是「物体」、什么是「语言逻辑」,这些是AI的基础能力;残差子空间是下层的小抽屉,放着针对特定任务的专属知识——比如识别猫的特征、生成海报的风格。

团队用奇异值分解(SVD)给这个抽屉柜做了「CT扫描」:当他们把下层小抽屉的东西全部清空,AI依然能看懂图片、理解文字,通用能力几乎没受影响;但如果把上层大抽屉的东西拿掉,AI立刻就变成了「白痴」,连最简单的任务都做不了。

这个发现直接推翻了之前的假设:原来AI学新东西时,根本不需要动那些装着通用知识的核心抽屉——只要在专属小抽屉里操作,就不会碰乱老本事。

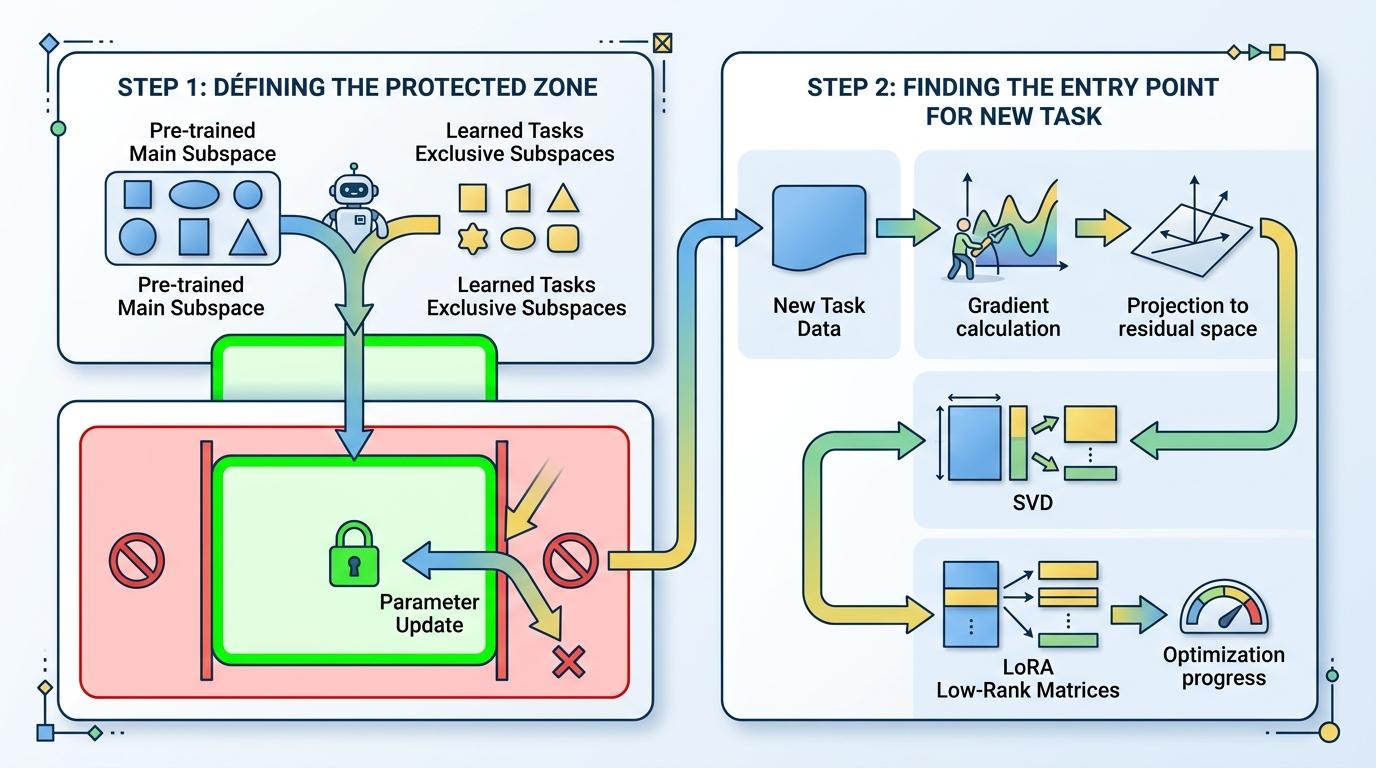

基于这个发现,团队设计了KeepLoRA的核心逻辑:给AI的参数空间装个「防护栏」,把新任务的学习严格限制在残差子空间里。

第一步是搭好防护栏:他们把预训练的主子空间和所有已学任务的专属子空间合并成一个「统一保护区」,任何新任务的参数更新都不能碰这个区域。第二步是找对新任务的「入场口」:在学新任务的第一时间,计算全参数微调的梯度,把它投影到保护区外的残差空间,再用奇异值分解提取最关键的方向,初始化LoRA的低秩矩阵。

训练时,这个初始化的矩阵会被冻结,只优化另一个小矩阵——相当于把新技能的学习路径牢牢锁在专属抽屉里。数学证明显示,这种操作等价于让AI只在不干扰老知识的区域里学新东西,而且效率比全参数微调还高。

最贴心的是,训练结束后,LoRA的参数可以直接合并回原模型,推理时完全没有额外开销——就像你把新文件放进小抽屉后,整个柜子的使用方式和之前一模一样。

为了验证这个方法的效果,团队在两个主流视觉语言模型上做了「记忆力考试」:

在双塔模型CLIP上,KeepLoRA在多任务增量学习中,通用知识保留率比传统LoRA高了12%,新任务的学习效率还提升了8%;在编解码模型LLaVA上,它不仅能记住之前学过的视觉问答能力,学新的图像描述任务时,老任务的准确率只下降了2%——而传统LoRA的下降幅度是15%。

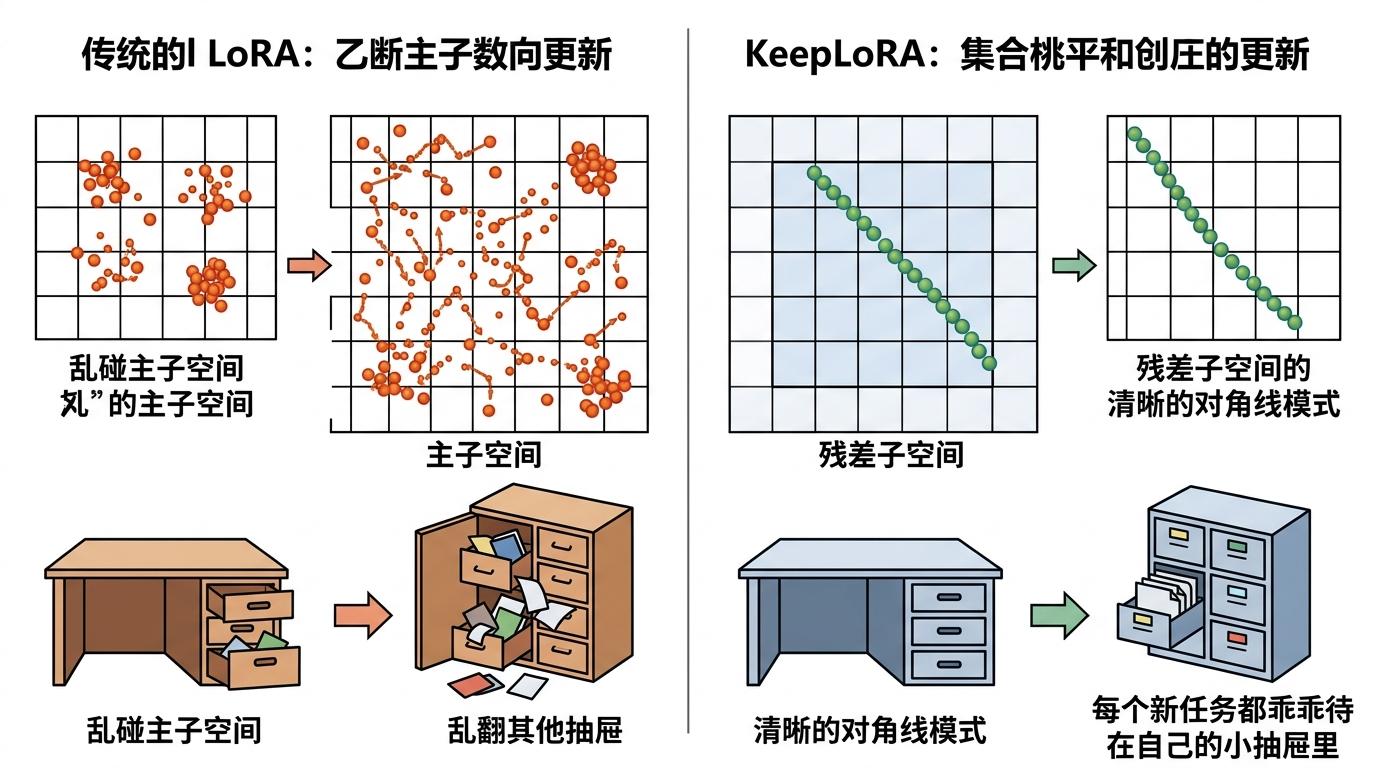

可视化结果更直观:传统LoRA的参数更新像没头苍蝇,到处乱碰主子空间;而KeepLoRA的更新都集中在残差子空间,形成了清晰的对角线模式——就像每个新任务都乖乖待在自己的小抽屉里,绝不乱翻其他抽屉。

当然,它也不是完美的:当任务数量多到把残差子空间占满时,新任务还是会开始干扰老知识——这就像你把下层小抽屉都塞满了,只能往上层大抽屉里塞东西,难免会碰乱里面的东西。

从1989年「灾难性遗忘」被发现,到今天KeepLoRA找到缓解的方法,AI的「记忆能力」终于迈出了从「鱼的7秒记忆」到「能持续学习」的一步。这背后不是简单的算法优化,而是人类终于开始读懂AI的「思维抽屉」——原来它的知识不是混在一起的浆糊,而是有清晰结构的柜子。

不忘旧知,持续成长——这不仅是AI的目标,也是人类对智能的终极想象。未来的AI或许会像人类一样,把学过的每一件事都妥善放进记忆抽屉,在面对新挑战时,既能调用全部经验,又能轻松学会新技能。而KeepLoRA,就是给这个智能抽屉装上的第一把靠谱的锁。