对抗知识焦虑,从看懂这条开始

App 下载

Meta让AI自己当电脑,冯·诺依曼架构要变天

视频模型|冯·诺依曼架构|神经计算机|沙特阿卜杜拉国王科技大学|Meta|AI智能体|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

视频模型|冯·诺依曼架构|神经计算机|沙特阿卜杜拉国王科技大学|Meta|AI智能体|人工智能

想象一下:你打开电脑,没有Windows或MacOS的启动界面,没有CPU和内存的参数跳动——屏幕上直接跳出一个AI模型,它能看懂你的指令,自己完成计算,还能把结果像画一样“渲染”出来。这不是科幻,是Meta和沙特阿卜杜拉国王科技大学的研究团队在2026年4月抛出的现实:他们用视频模型造出了“神经计算机”的原型,让AI不再是电脑里的工具,而是直接变成电脑本身。为什么说这可能是颠覆冯·诺依曼架构的第一步?我们得从它到底怎么运作说起。

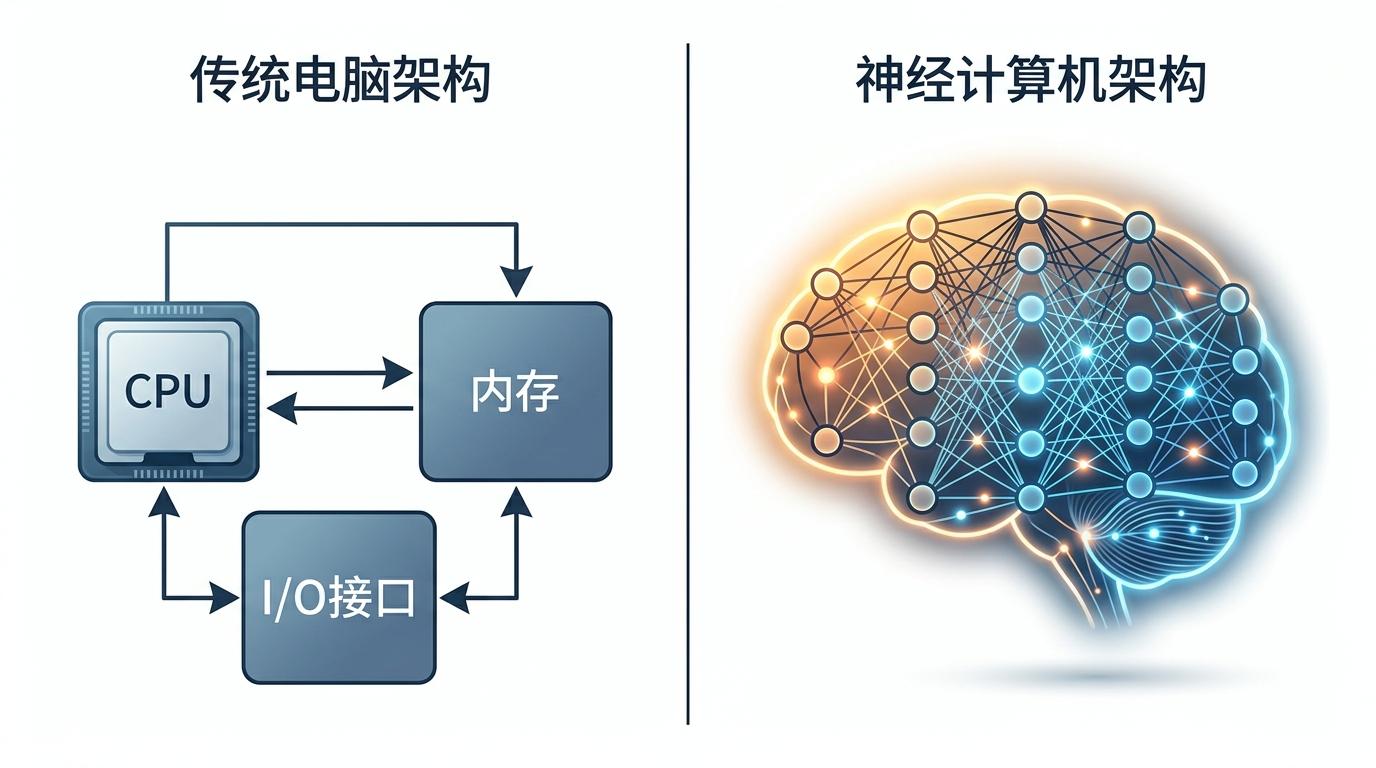

我们先把传统电脑拆成三块:负责算的CPU、负责存的内存、负责传数据的I/O接口——这就是冯·诺依曼架构的核心,也是困扰了行业几十年的“瓶颈”:数据在这三块之间来回跑,速度永远跟不上计算需求。而神经计算机的狠劲,在于把这三块全揉进了一个神经网络里。

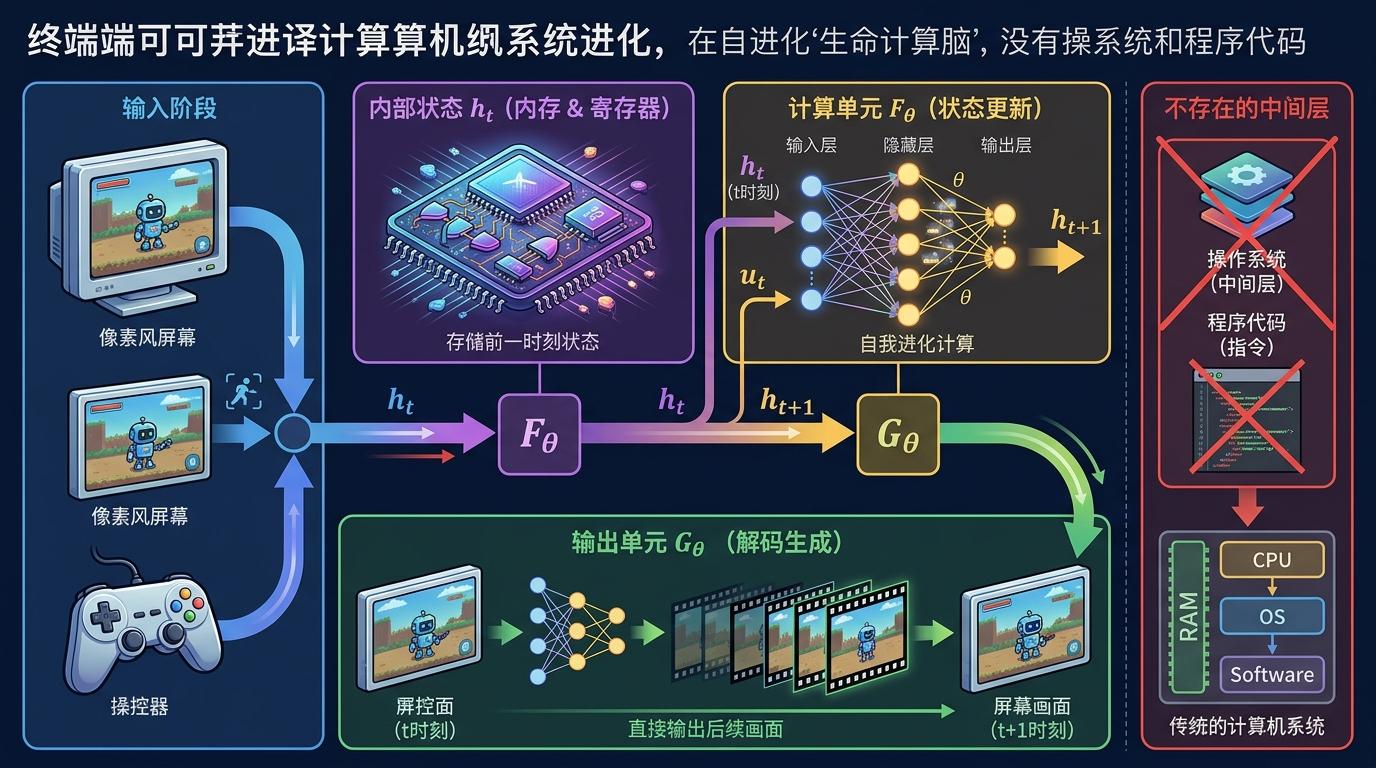

你可以把它想象成一个会自己进化的“活电脑”:它的内部状态h_t既是内存也是CPU寄存器,状态更新函数F_θ就是计算单元,解码器G_θ直接输出屏幕画面——没有操作系统当中间层,没有程序代码当指令,你给它一个初始屏幕和操作指令,它就能像放电影一样算出后续所有画面。

Meta做了两个原型验证这个想法:一个是模仿命令行的NCCLIGen,输入“ls -la”的指令和初始终端截图,它能生成和真实终端一模一样的输出序列,字符级OCR准确率能到54%;另一个是模仿桌面的NCGUIWorld,输入鼠标点击坐标,它能精准渲染出按钮高亮、窗口切换的画面,光标准确率高达98.7%。但这些还只是“皮毛”——真正的目标是实现“完全神经计算机”(CNC):一个图灵完备、能通用编程、行为稳定的AI系统,自己就是完整的计算环境。

但你千万别以为这只是个“高级屏幕模拟器”——实验数据里藏着一个扎心的真相:当让NCCLIGen算“1+1”时,它的准确率只有4%,远不如专门做符号推理的模型。可如果把指令改成“显示1+1的结果:2”,它的准确率直接飙升到83%。这说明现在的神经计算机更像个“高精度渲染器”,还没学会真正的“计算”——它能模仿屏幕的样子,却还没掌握背后的符号逻辑。

更值得关注的是,这恰恰暴露了神经计算机的核心挑战:如何让AI从“模仿画面”升级到“理解计算”。目前的原型用的是视频生成模型,本质是通过海量屏幕数据学习“画面变化规律”,但传统计算机的核心是“符号操作”——比如加减乘除、逻辑判断,这些都是离散的、确定性的,和视频生成的概率性逻辑完全不同。

不过这并不意味着这条路走不通。Meta的论文里已经画出了路线图:首先要解决长视距推理,让模型能处理几十甚至几百步的复杂任务链;然后是给模型加上“符号调节器”,专门负责数学、逻辑这类精准计算;还要设计能稳定复用的“神经程序模块”,让模型像调用函数一样用已学会的技能;最后得有一套监控机制,防止模型的内部状态“跑偏”。

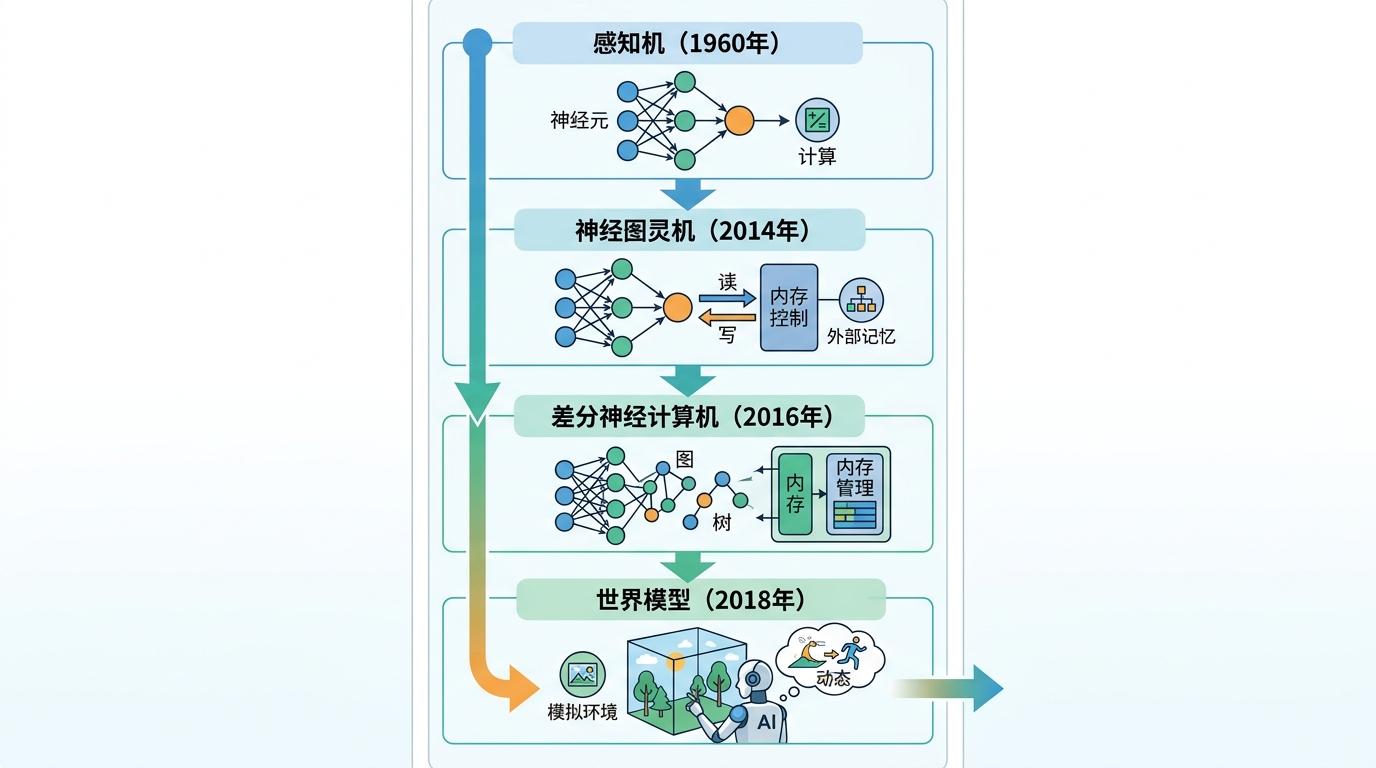

其实神经计算机的想法不是凭空冒出来的,它的脉络能追溯到60年前。1960年,罗森布拉特提出感知机,试图用模拟神经元的网络实现计算;2014年,DeepMind的神经图灵机第一次给神经网络加上了可读写的外部记忆,让AI能像电脑一样存数据;2016年的差分神经计算机又升级了记忆管理,能处理图、树这类复杂数据结构;2018年的世界模型则让AI学会了模拟环境动态。

而Meta的神经计算机,是把这些想法推到了新的阶段:之前的模型都是“用”外部计算环境,神经计算机要“成为”计算环境本身。比如神经图灵机还是神经网络控制器+外部记忆,神经计算机则把计算、记忆、I/O全变成了神经网络的内部状态;世界模型是“预测环境”,神经计算机是“直接执行”。这不是小修小补,是从“程序驱动”到“学习驱动”的范式转变——未来的“编程”可能不再是写代码,而是给AI示范任务、用自然语言下达指令。

现在的神经计算机,还只是个蹒跚学步的孩子:能模仿电脑的样子,却还不会真正的计算;能处理简单任务,却还做不到稳定可靠。但它的意义,不在于现在能做什么,而在于它指出了一条新的路——一条绕开冯·诺依曼瓶颈、让AI和硬件深度融合的路。

未来的某一天,你可能不再需要买CPU、装系统,只要一个训练好的神经计算机模型,就能完成从办公到创作的所有任务。而这一切的起点,就是Meta现在抛出的这个“原型”。计算的未来,或许不在硅芯片里,而在神经网络中。