对抗知识焦虑,从看懂这条开始

App 下载

医学图像分割不再分家,双向协作精度飙升

AI协作模型|细胞核识别|病理切片|医学图像分割|Co-Seg++框架|新药研发|医学健康

当病理医生在显微镜下观察一张组织切片时,他们的眼睛会同时完成两件事:先圈出肿瘤、基质这些不同的组织区域,再把区域里密密麻麻的细胞核逐个区分开——这两个步骤缺一不可,才能判断肿瘤分级。但过去的AI模型却像两个各干各活的实习生:一个只负责画区域,一个只负责找细胞,不仅重复干活浪费算力,还经常因为信息不通导致判断出错。现在,一套名为Co-Seg++的框架彻底改变了这种局面——它让两个AI任务学会了互相帮忙,不仅精度超过了所有单独干活的模型,还把计算量砍到了原来的五分之一。

从各自为战到双向协作的范式革命

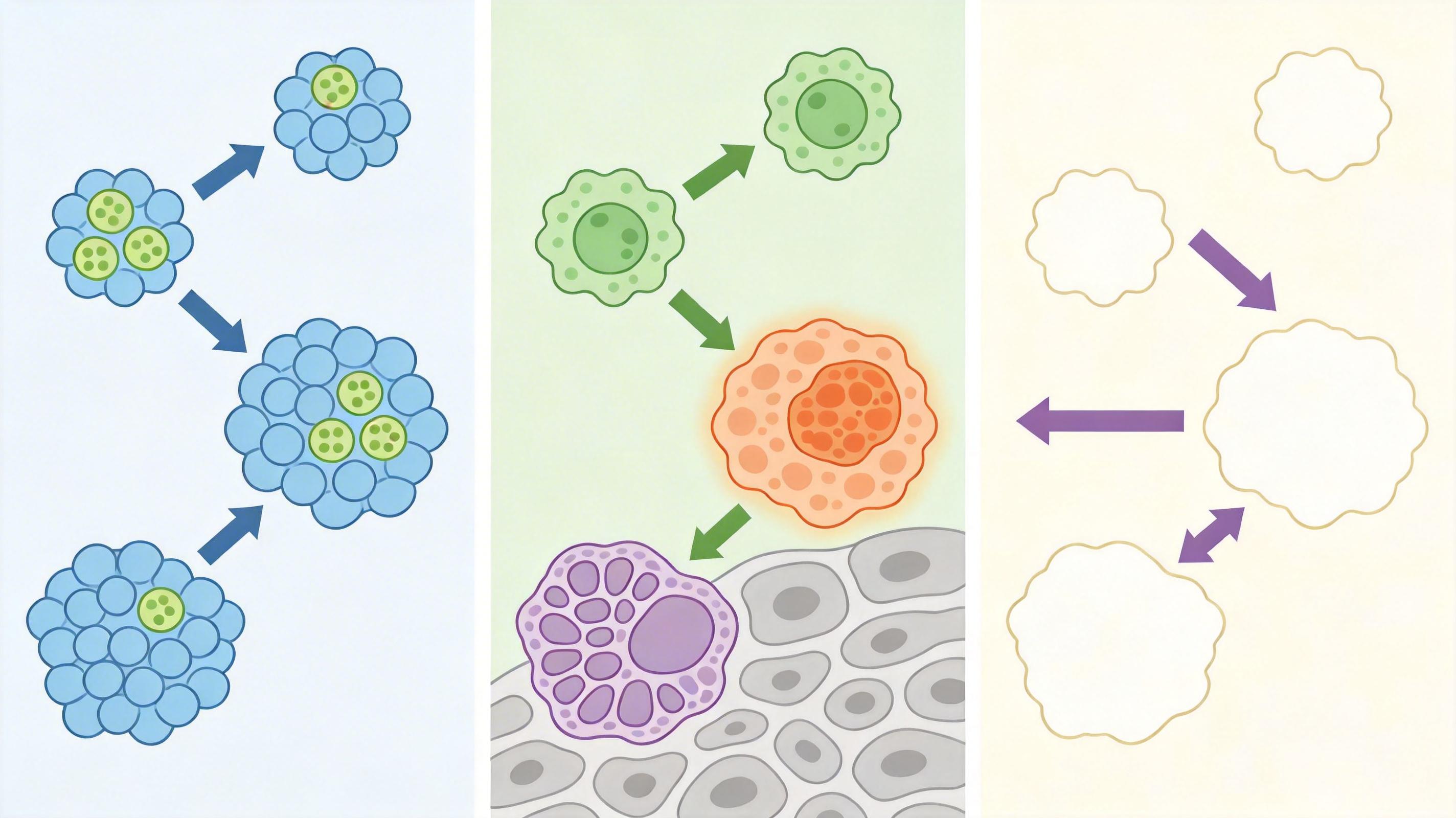

你可以把医学图像分割想象成装修房子:语义分割是给客厅、卧室、厨房贴标签,明确每个功能区的范围;实例分割是把每个房间里的沙发、床、冰箱单独拎出来。过去的AI要么雇两个施工队分别干这两件事,要么让同一个施工队先贴标签再搬家具,全程没有信息共享——比如贴标签时不知道这里要放大床,留的空间可能不够;搬家具时又忘了这里是厨房,把冰箱放进了卧室。

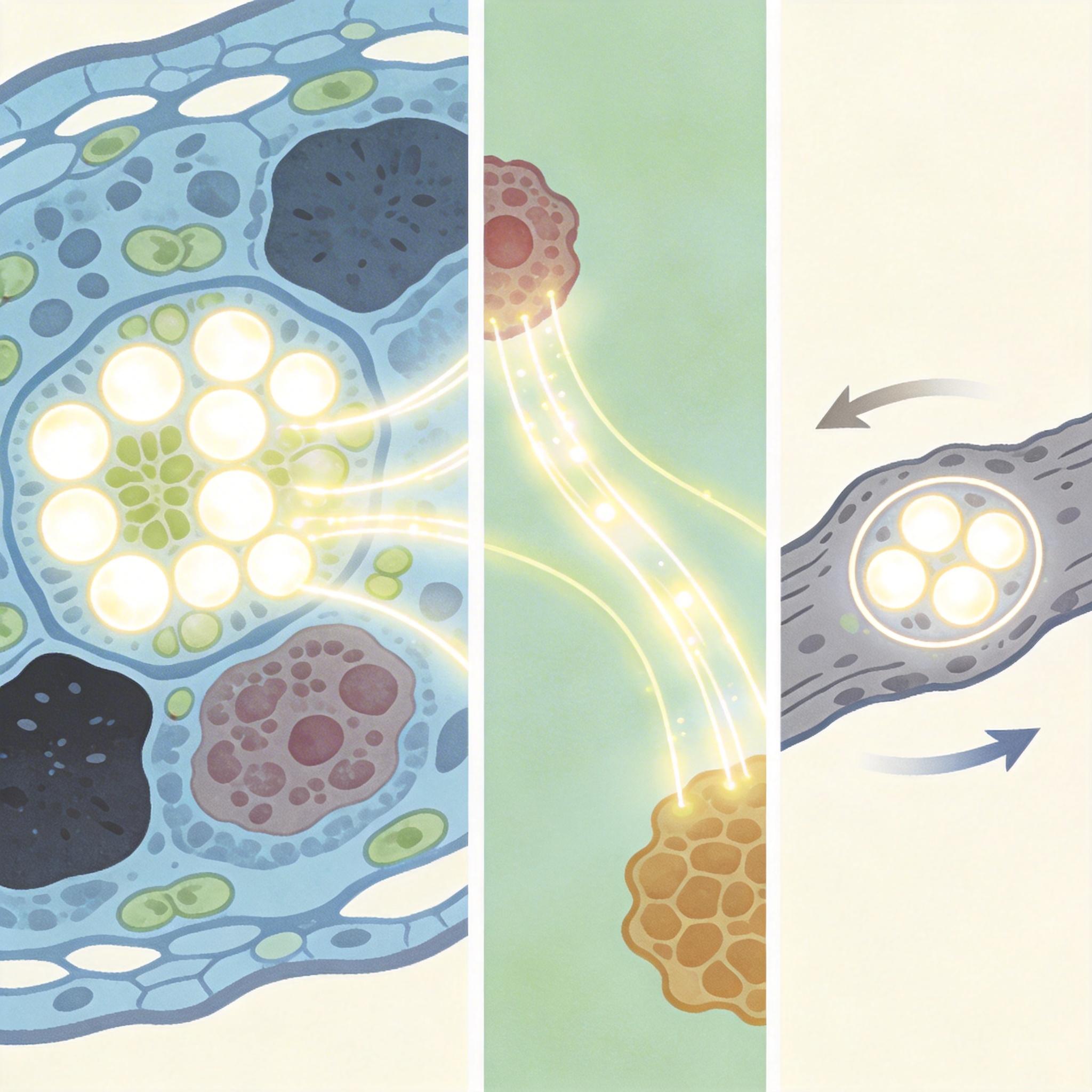

Co-Seg++提出的协作分割范式,相当于给两个施工队配了一个共享的调度中心。它把两个任务的关系用数学公式固定成了双向依赖:先知道房间功能(语义分割),就能更准确地摆放对应家具(实例分割);反过来,看到家具的位置(实例分割),也能修正房间功能的判断(语义分割)。训练时,两个任务的误差会互相传递——如果把冰箱放进了卧室,不仅实例分割会扣分,语义分割也会因为“卧室里出现厨房家电”被提醒修正,直到两者的判断完全自洽。

这个范式最关键的突破,是打破了多任务学习里“各算各的账”的规则。以前两个任务的参数调整是独立的,现在一个任务的优化会直接影响另一个任务的参数,让模型从一开始就学会用全局视角看问题。

让AI学会“全局看问题”的两个核心工具

要实现双向协作,得先解决两个问题:怎么让AI看到整张图的全局关联?怎么让两个任务的信息有效传递?研究者为此设计了两个核心组件。

第一个是空间序列提示编码器(SSP-Encoder)。你可以把它想象成一个“全局侦察兵”:它会同时从两个维度扫描图像——空间维度找不同区域的位置关系,比如“肿瘤区域旁边通常是基质”;序列维度找连续的特征规律,比如“细胞核总是成簇出现在腺体里”。它把这些规律打包成“提示信息”,比如“在这个腺体区域里,要重点找圆形的细胞核”,给后续的分割任务做参考。不同于只能看局部的传统模型,这个编码器能捕捉到相隔很远的特征关联,比如图像左上角的肿瘤和右下角的基质的潜在联系。

第二个是多任务协作解码器(MTC-Decoder),这是两个任务的“协作执行中心”。它会让语义分割和实例分割的特征互相“串门”:当分割细胞核时,它会调用语义分割的结果,只在“腺体区域”里找细胞核,避免在基质里误判;当分割组织区域时,它会参考实例分割的结果,如果某个区域里全是肿瘤细胞核,就把这个区域标记为肿瘤。为了确保两者的判断一致,它还会用KL散度损失来“对账”——如果语义分割标记的肿瘤区域里,实例分割没找到足够的肿瘤细胞核,就同时调整两个任务的参数,直到账对平。

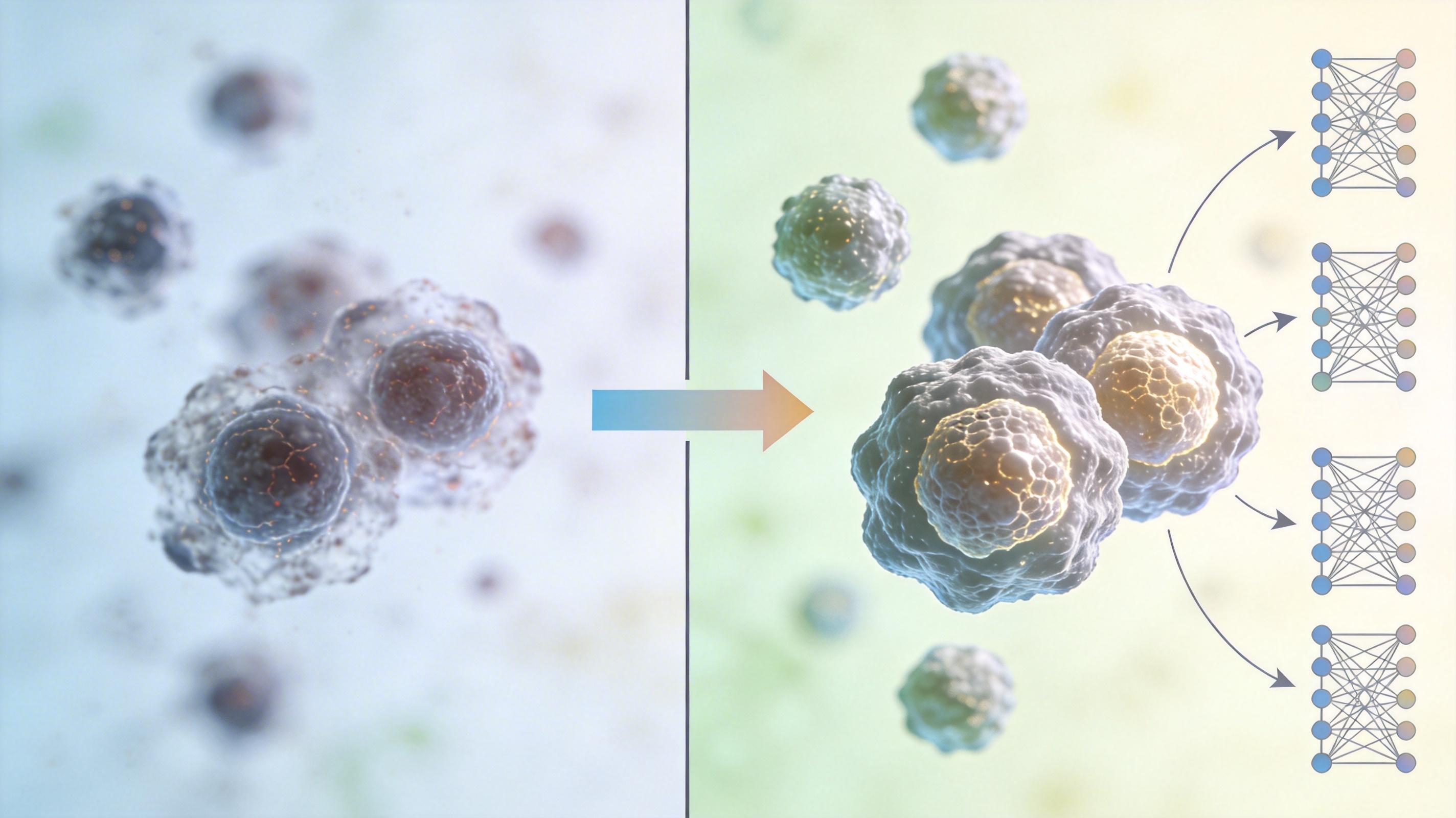

说个直观的数字:在PUMA病理数据集上,这个协作框架让肿瘤区域的分割精度从91.78%提升到了93.15%,细胞核的识别准确率提升了3.71%,同时计算量比独立模型减少了5.6倍。

不止是精度提升,更解决了临床的实际痛点

对于临床应用来说,Co-Seg++的价值不止是数字上的提升,更在于它解决了过去AI模型的两个核心痛点:泛化能力差和数据利用率低。

在跨场景测试中,比如用A医院扫描仪拍的病理切片训练模型,再去分割B医院的切片,传统模型的精度会暴跌10%以上,但Co-Seg++的精度只下降了不到5%。这是因为协作范式让模型学会的是“组织和细胞的关系”,而不是某台扫描仪的成像风格——就像一个经验丰富的病理医生,不管用什么显微镜,都能准确判断组织类型。

在只有10%标注数据的情况下,Co-Seg++的表现依然比传统模型好7%以上。这对于医学影像来说至关重要——高质量的医学图像标注需要专业医生花费大量时间,数据稀缺一直是行业难题。协作范式让模型能从有限的标注里,同时学习两个任务的关联信息,相当于一份数据发挥了两份作用。

当然,它也有局限:目前只在2D图像上验证了效果,对于3D的CT、MRI数据,还需要进一步优化空间关联的捕捉能力;而且对于极其罕见的病例,因为没有足够的关联数据可以学习,精度提升会有限。

从U-Net的单任务突破,到Transformer的全局建模,再到如今Co-Seg++的多任务协作,医学图像分割的发展一直朝着“更像人类医生思考”的方向前进。医生看图像时,从来不会把组织区域和单个细胞分开判断——他们的大脑会同时处理全局和局部信息,用上下文互相验证。

Co-Seg++的最大意义,不是超越了几个百分点的精度,而是证明了AI模型不需要模仿人类的“操作步骤”,但可以模仿人类的“思考方式”——用关联的、全局的视角解决问题。

任务互哺,才是AI理解医学图像的关键。