对抗知识焦虑,从看懂这条开始

App 下载

AI让演唱会巨物,成了能共情的「沉默伙伴」

舞台视觉特效|虚拟分身|巨物美学|机械仿生人Eva|拉斯维加斯Sphere|AIGC|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

舞台视觉特效|虚拟分身|巨物美学|机械仿生人Eva|拉斯维加斯Sphere|AIGC|人工智能

当16K环幕上的机械仿生人Eva缓缓抬起手,拉斯维加斯Sphere场馆里的两万名观众同时屏住了呼吸。那只金属手掌的纹理清晰到能看见螺栓的锈迹,它落下的节奏精准踩在电子乐的重拍上,震得胸腔跟着发麻——没人会把这当成普通的舞台特效。从蔡依林巡演里悬在半空的巨型人像,到Lisa《Bad Angel》里暗黑机械风的虚拟分身,近两年的顶级现场都在疯玩这种「巨物美学」。但你可能没意识到,这些让你头皮发麻的庞然大物,早已不是单纯的视觉道具——AI正在让它们变成能和观众共情的「沉默伙伴」。这股视觉风暴到底是怎么刮起来的?

你或许听过科幻圈里的「BDO」——那些体型远超人类、沉默矗立的巨大物体,光是存在就能唤起敬畏、恐惧与好奇交织的复杂情绪。就像《沙丘》里破沙而出的沙虫,当几百米的体量把人衬得像蝼蚁时,那种本能的震撼是刻在人类基因里的。

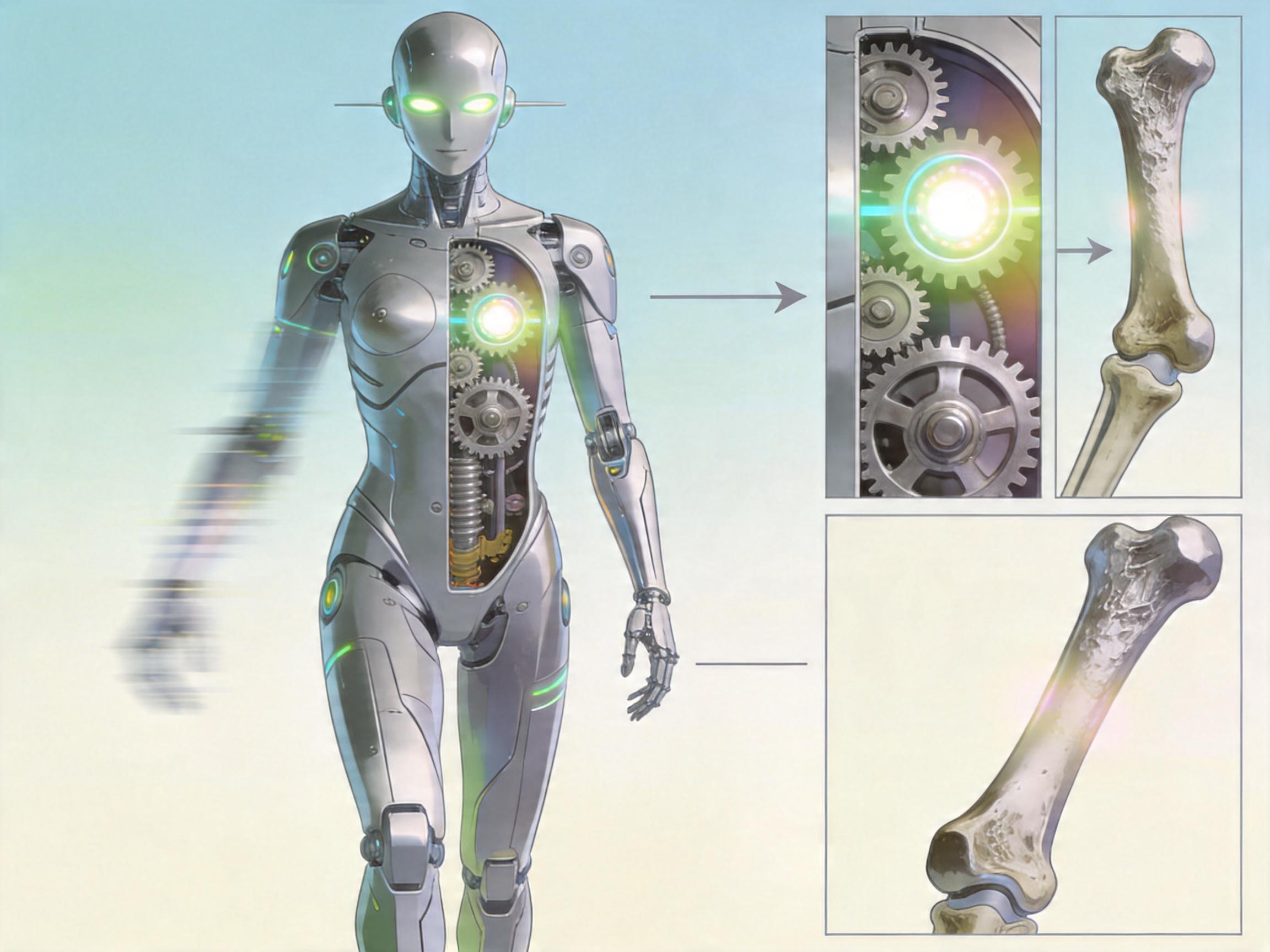

但把这种情绪搬到演唱会现场,靠的绝不是把模型做大这么简单。Anyma的团队在Sphere场馆的演出里,先靠AI生成了上百版Eva的概念图,从金属骨骼的纹理到眼部的光效,每一处细节都在试探观众的情绪阈值。再用虚幻引擎5完成高精度建模,让Eva的每一次呼吸都带着机械齿轮的卡顿感——这种「不完美的逼真」,反而比完全顺滑的动画更能戳中人心。

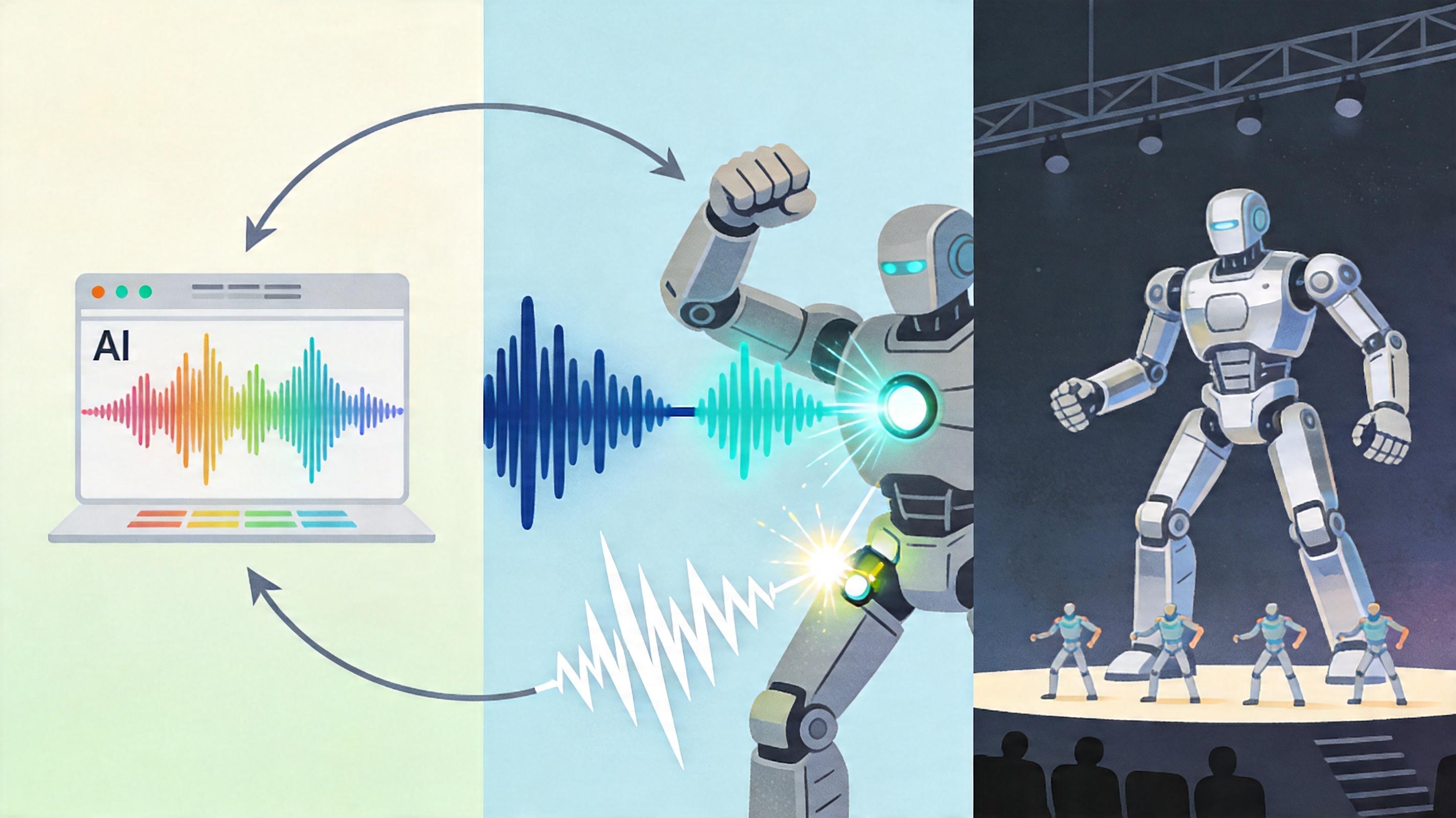

最关键的是「帧级同步」:团队用AI分析电子乐的频谱,把重低音对应Eva的挥拳,把合成器的高音对应眼部的闪光,连现场灯光的爆闪都精准卡在机械关节转动的瞬间。当你在现场感受到的,就不是一个屏幕上的动画,而是一个真真切切站在你面前、和音乐同频呼吸的庞然大物。

你看到的巨物震撼,背后是一条被AI彻底重构的制作流水线。从前设计师要花几个月手绘概念图,现在输入「赛博朋克风格巨型仿生人,带有风化金属纹理」,AI能在几小时内生成几十版方案,还能根据反馈实时调整细节。 到了建模阶段,AI能自动补全机械结构的受力逻辑,避免出现「看起来很酷但现实里站不住」的设计;动画环节,AI能捕捉真实人类的微表情,再转化为机械人的动作——Eva低头时的停顿、抬手时的颤抖,这些细节都是AI从人类情绪数据库里学习来的。 甚至连现场执行都离不开AI:Visibox这类专业软件能实时同步灯光、音响和屏幕画面,哪怕演出中出现即兴调整,AI也能在0.1秒内完成全系统适配。这种效率放在五年前,需要几十人团队花几周时间调试,现在一个设计师就能搞定。 当然,这股浪潮也有隐忧:AI生成内容的版权边界至今模糊,2026年美国最高法院的判决明确「纯AI作品无版权」,但人机协作的作品该怎么界定?Anyma的团队就曾因为一张AI生成的概念图,和原素材摄影师陷入版权纠纷——这也是所有用AI做创作的团队都要面对的难题。

神经科学的研究给出了答案:当我们看到巨物时,大脑的默认模式网络会被抑制——那些关于「我今天要做什么」「我还有多少工作」的自我思考会暂时消失,取而代之的是对当下环境的全神贯注。这种「自我缩小」的状态,恰恰是现代人最稀缺的体验。 AI的加入,让这种体验更上一层楼。它能通过现场的传感器捕捉观众的情绪:当全场观众的心率同步升高时,AI会让Eva的动作放慢,灯光调暗,制造出一种「它在观察我们」的错觉;当全场欢呼时,Eva会扬起手臂,配合着更强的重低音——这种双向的情绪互动,是传统舞台道具永远做不到的。 蔡依林巡演里的巨型人像,会根据歌曲的情绪变化灯光颜色:唱《玫瑰少年》时是暖粉色,唱《怪美的》时是冷黑色。这种看似简单的调整,背后是AI对歌词情感的分析,以及对现场观众反应的实时捕捉。它不再是一个冰冷的装置,而是能读懂情绪的「沉默伙伴」。

当Anyma的巡演宣布登陆上海时,有人在评论区说:「隔着屏幕看都腿软,现场岂不是要窒息?」这种期待,恰恰说明巨物美学的核心从来不是技术,而是情绪的共鸣。 AI让这些庞然大物学会了「共情」——它们不用说话,只要站在那里,只要动作和你的心跳同频,就能把你从日常的琐碎里拽出来,让你重新感受那种被震撼、被包裹、被看见的感觉。 巨物不语,却懂你心跳。 或许未来的演唱会,我们追逐的不再是歌手的高音,而是和这些沉默巨物一起,完成一场跨越尺度的情绪共振。毕竟在这个越来越强调「自我」的时代,偶尔被巨物衬得渺小,反而能让我们更清楚地感受到自己的存在。