对抗知识焦虑,从看懂这条开始

App 下载

金融AI编程不裁员,省出的人接更多项目

合规问责|代码缺陷密度|AI编程助手|银行核心系统|金融科技公司|AI产业应用|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

合规问责|代码缺陷密度|AI编程助手|银行核心系统|金融科技公司|AI产业应用|人工智能

当互联网公司把AI编程助手的提效和裁员直接划等号时,一家深耕银行核心系统的金融科技公司却走了条反常识的路:他们花了数月时间,用真实金融项目反复测试AI代码的缺陷密度、存量系统匹配度,直到确认其质量与人工开发基本持平,才敢小范围推广。更关键的是,省下来的人效没有用来减岗,反而去承接了更多复杂项目。他们为什么要这么做?AI在金融核心系统里,到底是替代者还是辅助者?

金融系统的命门,从来不是开发速度,而是账务一致性、7×24小时高可用、严苛的合规问责——任何一行代码出错,都可能引发连锁风险。这家公司没有像互联网团队那样,只盯着AI生成代码的速度,而是设计了一套近乎苛刻的验证体系:

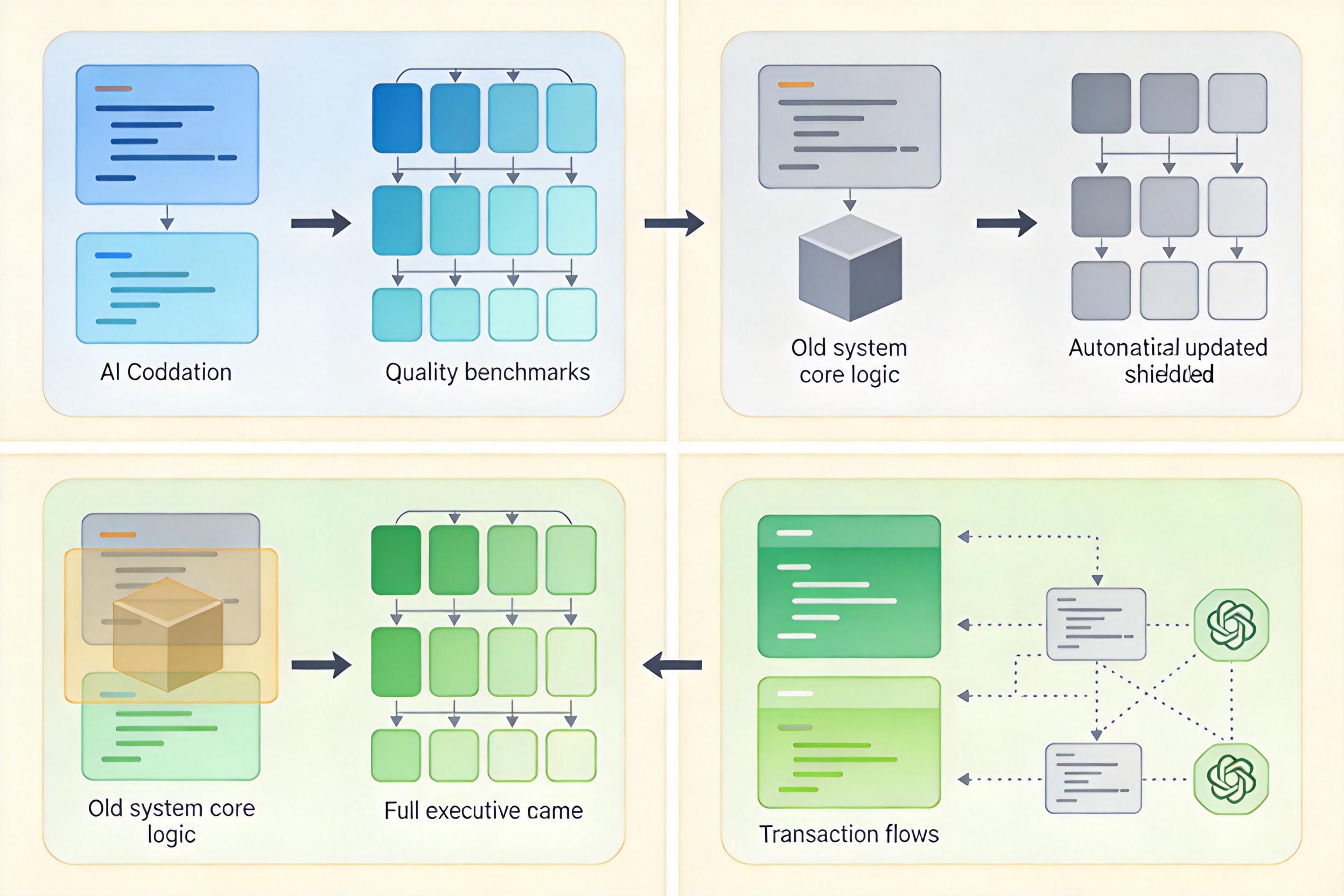

你可以把这个过程想象成给AI安排了一场金融行业的职业资格考试。第一关看代码质量,缺陷密度和人工开发必须基本持平;第二关考任务拆解,能不能把复杂的金融需求拆成机器能执行的小模块;第三关是存量工程匹配度,要能在运行了十几年的老系统里精准找到修改位置,不能碰错核心逻辑;第四关测开发规范兼容性,变量命名、数据字典必须和现有体系完全统一;第五关看功能完整性,不仅要覆盖主流程,异常交易、边界场景一个都不能少;最后一关是文档同步,生成的代码必须能自动更新对应的设计文档,解决金融行业长期存在的“文码不一致”难题。

直到AI在所有关卡都拿到了及格分,他们才允许工程师在真实项目里试用——而且只能当“副驾驶”,负责写标准化的查询、交易代码,核心的账务处理、高可用机制,依然由资深工程师把控。

外界对AI编程的最大误解,是把“提效”等同于“替代”。但在金融核心系统的开发里,AI的能力边界异常清晰:

它擅长处理标准化、重复性的工作——比如生成测试用例,原来5个人要做一个月,现在1个人审核AI生成的结果就行;比如补全文档,原来项目收尾要15个人月来对齐代码和文档,现在3到5个人月就能完成。但涉及复杂的账务一致性、7×24小时高可用机制这些需要经验判断的场景,AI还无法替代人类——它写不出那种经历过无数次故障、被验证过成千上万次的稳健代码。

更重要的是,金融行业的合规要求决定了“责任必须到人”。AI生成的代码可以作为参考,但最终的审核、签字、问责,都必须由工程师来完成。这家公司甚至专门保留了初级工程师的培养路径,他们担心如果只靠AI写代码,会出现“能力断层”——当资深工程师退休后,没人能理解那些老系统的逻辑,也没人能驾驭AI去维护复杂的金融系统。

当AI从“工具”变成“协作伙伴”,开发者的价值评价标准也在悄悄改变。

过去,考核工程师看的是代码行数、提交次数;未来,更重要的是“任务闭环能力”——能不能把一个金融需求拆成AI能执行的步骤,让AI写完代码、生成测试用例,甚至自动部署到测试环境,走完整个流程。还有“教会AI做事的能力”——能不能把自己的金融业务经验,变成AI能理解的规则和模板,让AI生成的代码更贴合行业需求。

比如,有的工程师会把金融系统里常见的异常处理逻辑,整理成AI能识别的提示词,这样AI生成的代码就能自动覆盖那些容易出错的边界场景;还有的工程师会把存量系统的架构知识做成知识库,让AI能快速定位到要修改的代码位置。这些沉淀下来的知识,比单纯写代码更有价值——它能让整个团队的AI使用效率都得到提升。

当然,还有一条底线不能破:所有AI参与的开发过程,必须可追溯、可审计。每一行AI生成的代码,都要记录是谁发起的、谁审核的、修改了什么——这不仅是合规要求,更是金融系统安全的最后一道防线。

当很多行业还在争论AI会不会替代人类时,金融科技行业已经找到了自己的答案:AI不是来抢饭碗的,而是来帮人类把碗做大的。那些省下来的人效,没有用来裁员,而是去承接了更多中小银行的核心系统升级项目,覆盖了更多之前没精力触及的金融场景。

这背后其实是一种更务实的技术观:技术的终极目标,从来不是替代人类,而是拓展人类的能力边界。在金融这个容不得半点差错的行业里,AI的价值不在于它能做什么,而在于它能让人类工程师腾出精力,去做那些更需要经验、判断和创造力的事——毕竟,机器可以生成代码,但只有人类才能理解金融背后的温度和责任。

人机协同,而非替代,才是AI在金融核心系统里的终极归宿。